Hersenen–machine-interface

AI-Doorbraak Verbeterd Brain-Computer Interfaces door het Decoderen van Complexere Hersensignalen

Onderzoekers aan de Chiba University in Japan hebben een nieuw kunstmatig intelligentie-kader ontwikkeld dat complexe hersenactiviteit kan decoderen met aanzienlijk verbeterde nauwkeurigheid, wat een belangrijke stap is naar meer betrouwbare brain-computer interfaces (BCI’s). De doorbraak kan helpen om de ontwikkeling van hulpmiddelen te versnellen die mensen met neurologische aandoeningen in staat stellen apparaten zoals protheseledematen, rolstoelen en revalidatie-robots te bedienen met hun gedachten.

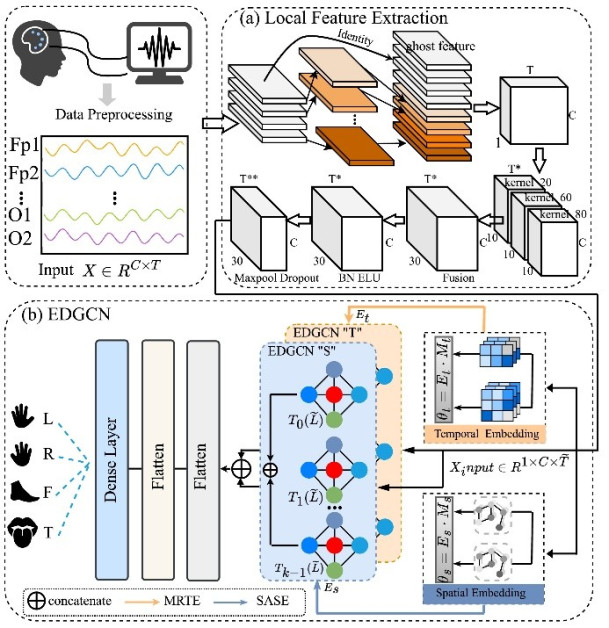

Het onderzoek, geleid door promovendus Chaowen Shen en professor Akio Namiki aan de Graduate School of Engineering van de Chiba University, introduceert een nieuw diep leerarchitectuur genaamd Embedding-Driven Graph Convolutional Network (EDGCN). Het systeem is ontworpen om de complexe elektrische signalen te interpreteren die in de hersenen worden gegenereerd wanneer iemand zich voorstelt dat hij zijn ledematen beweegt – een proces dat bekend staat als motorische verbeelding.

Brain-Computer Interfaces en Motorische Verbeelding

Brain-computer interfaces hebben als doel een communicatiekanaal te creëren tussen de menselijke hersenen en externe machines. In plaats van te vertrouwen op spierbeweging, interpreteren BCI’s neurale signalen en zetten ze om in opdrachten voor digitale systemen of fysieke apparaten.

Een van de meest bestudeerde benaderingen in BCI-onderzoek betreft motorische verbeelding electroencefalografie (MI-EEG). In deze systemen stellen gebruikers zich voor dat ze bewegingen uitvoeren – zoals het opheffen van een hand, het grijpen van een object of het lopen. Zelfs als er geen fysieke beweging plaatsvindt, genereert de hersenen distinctieve patronen van elektrische activiteit die geassocieerd zijn met de verbeelde beweging.

Deze signalen kunnen worden vastgelegd met behulp van electroencefalografie (EEG), een niet-invasieve techniek die hersenactiviteit registreert via elektroden op het hoofd. EEG biedt multi-kanaals tijdsreeksgegevens die de neurale activiteit over verschillende delen van de hersenen weergeven.

Het nauwkeurig decoderen van deze signalen stelt computers in staat om neurale activiteit om te zetten in uitvoerbare opdrachten. In de praktijk kan dit mensen met verlamming of ernstige motorische beperkingen in staat stellen om hulpmiddelen te bedienen door alleen maar bewegingen te verbeelden.

Echter, het bereiken van betrouwbare decoding van MI-EEG-signalen blijft een van de moeilijkste uitdagingen in neurotechnologie.

Waarom Hersensignalen Moeilijk te Decoderen Zijn

Het primaire obstakel in de ontwikkeling van brain-computer interfaces ligt in de inherente complexiteit van EEG-signalen.

Motorische verbeeldingssignalen vertonen een hoge spatiotemporele variabiliteit, wat betekent dat ze zowel over verschillende hersengebieden als over tijd variëren. Ze verschillen ook sterk tussen individuen en zelfs binnen dezelfde persoon van de ene sessie tot de andere.

Traditionele machine learning-modellen hebben vaak moeite met deze variaties. Veel bestaande systemen vertrouwen op vooraf gedefinieerde grafische structuren of vaste parameters die ervan uitgaan dat hersensignalen consistent gedragen. In werkelijkheid zijn neurale signalen veel dynamischer en heterogener.

Eerdere methoden gebruikten vaak technieken zoals gemeenschappelijke spatiale patroonanalyse of conventionele convolutionele neurale netwerken om kenmerken uit EEG-signalen te extraheren. Hoewel deze benaderingen sommige patronen in neurale activiteit kunnen identificeren, falen ze vaak om diepere interacties tussen hersengebieden of evoluerende patronen in de tijd te detecteren.

Als gevolg hiervan vereisen veel BCI-systemen uitgebreide kalibratie en training voordat ze effectief kunnen functioneren voor individuele gebruikers.

Een Nieuwe Benadering: Embedding-Driven Graph Convolutional Networks

Het onderzoeksteam van de Chiba University heeft deze uitdagingen aangepakt door een nieuw diep leerframework te ontwikkelen dat beter in staat is om de complexiteit van hersenactiviteit te modelleren.

Hun oplossing – Embedding-Driven Graph Convolutional Network (EDGCN) – combineert verschillende geavanceerde technieken om de ruimtelijke en temporele structuur van EEG-signalen tegelijkertijd te modelleren.

In het hart van het framework ligt een embedding-gestuurde fusie-mechanisme dat het systeem in staat stelt om dynamisch parameters te genereren die worden gebruikt voor het decoderen van hersensignalen. In plaats van te vertrouwen op vaste architecturen, past EDGCN zijn interne representatie aan om beter variaties tussen subjecten en over tijd te vangen.

De architectuur integreert meerdere gespecialiseerde componenten:

Multi-Resolutie Temporele Embedding (MRTE)

Deze module analyseert EEG-signalen op verschillende tijdschalen. Omdat neurale signalen snel evolueren, kan belangrijke informatie optreden op verschillende temporele resoluties. MRTE extracteert kenmerken uit multi-resolutie macht spectrale patronen, waardoor het systeem in staat is om betekenisvolle neurale activiteit te identificeren die anders gemist zou kunnen worden.

Structuur-Aware Spatiale Embedding (SASE)

Hersensignalen zijn niet geïsoleerd; verschillende hersengebieden interacteren continu. Het SASE-mechanisme modelleert deze interacties door zowel lokale als globale connectiviteitsstructuren onder EEG-elektroden te incorporeren. Dit stelt de AI in staat om de hersenen te representeren als een netwerk in plaats van als onafhankelijke signaalkanalen.

Heterogeniteits-Aware Parameter Generatie

Een van de meest innovatieve aspecten van het EDGCN-framework is zijn vermogen om dynamisch grafische convolution parameters te genereren uit een embedding-gestuurde parameterbank. Dit stelt het model in staat om aan te passen aan de unieke kenmerken van elke subject’s hersensignalen.

Om dit proces te ondersteunen, gebruikten de onderzoekers Chebyshev grafische convolution, een techniek die efficiënt relaties binnen complexe netwerken modelleert.

Orthogonaliteits-Beperkte Kernels

Om de robuustheid verder te verbeteren, introduceert het model orthogonaliteitsbeperkingen binnen zijn convolution kernels. Dit moedigt diversiteit aan in de geleerde kenmerken en reduceert redundantie, waardoor het systeem rijkere representaties van EEG-signalen kan extraheren.

Samen stellen deze componenten EDGCN in staat om zowel lokale neurale activiteitspatronen als grote-schaal interacties tussen hersengebieden te vangen, wat resulteert in een nauwkeurigere decoding van motorische verbeeldingssignalen.

Prestatieresultaten

De onderzoekers testten EDGCN met behulp van breed gebruikt benchmark datasets van de BCI Competition IV, die standaard evaluatie-datasets zijn in het veld van brain-computer interface-onderzoek.

Het model behaalde:

- 90,14% classificatie-accuraatheid op de BCIC-IV-2b dataset

- 86,50% classificatie-accuraatheid op de BCIC-IV-2a dataset

Deze resultaten overtreffen verschillende bestaande state-of-the-art decoding methoden en demonstreren een sterke generalisatie over verschillende subjecten.

Belangrijk is dat het systeem ook een verbeterde aanpasbaarheid vertoonde bij toepassing op cross-subject scenario’s, een cruciale vereiste voor praktische BCI-implementatie. Veel bestaande modellen presteren goed voor een enkele getrainde gebruiker, maar falen wanneer ze worden toegepast op nieuwe individuen. De embedding-gestuurde architectuur van EDGCN helpt deze beperking te overwinnen door beter individuele variabiliteit te modelleren.

Implicaties voor Revalidatie en Hulpmiddelen

Het vermogen om hersensignalen nauwkeuriger te decoderen kan diepgaande implicaties hebben voor hulpmiddelen.

Motorische verbeelding-gebaseerde BCI’s worden al onderzocht voor toepassingen zoals:

- Gedachte-gestuurde rolstoelen

- Neurale prothesen

- Robots voor revalidatie

- Communicatiesystemen voor patiënten met verlamming

Verbeterde decoding-accuraatheid kan deze technologieën aanzienlijk betrouwbaarder en gemakkelijker in gebruik maken.

Onderzoekers geloven dat systemen zoals EDGCN kunnen helpen bij patiënten met aandoeningen zoals:

- Beroerte

- Rugletsel

- Amyotrofe laterale sclerose (ALS)

- Andere neuromusculoskeletale aandoeningen

Met een betere signaalinterpretatie kunnen patiënten mogelijk neurorevalidatie-apparaten bedienen door eenvoudig bewegingen te verbeelden, waardoor een meer natuurlijke interactie met hulpsystemen mogelijk wordt.

Volgens professor Namiki is het decoderen van motorische verbeeldingssignalen niet alleen een technologische uitdaging, maar ook een kans om beter te begrijpen hoe de hersenen beweging en neurale connectiviteit organiseren.

Naar Consumentenklasse Brain-Computer Interfaces

Ondanks decennia van onderzoek, blijven de meeste brain-computer interface-systemen beperkt tot laboratoria of gespecialiseerde klinische omgevingen. Betrouwbaarheid, aanpasbaarheid en gebruiksgemak blijven significante barrières voor bredere adoptie.

Vooruitgang zoals EDGCN kan helpen om BCI’s dichter bij consumentenklasse neurotechnologie te brengen.

Door de mogelijkheid van het systeem te verbeteren om heterogene hersensignalen te verwerken, reduceert het model de noodzaak voor uitgebreide kalibratie en expertafstelling. Dit is een cruciale stap naar het maken van BCI-systemen bruikbaar buiten onderzoeksomgevingen.

Toekomstig onderzoek zal waarschijnlijk focussen op het integreren van dergelijke AI-modellen in draagbare EEG-systemen en wearables. In combinatie met verbeteringen in sensortechnologie en rekenkracht, kunnen deze systemen meer toegankelijke en schaalbare brain-machine interfaces mogelijk maken.

Een Stap naar Diepere Mens-Machine Integratie

De ontwikkeling van EDGCN weerspiegelt een bredere trend in kunstmatige intelligentie en neurologie: het toenemende gebruik van grafische neurale netwerken om biologische systemen te modelleren.

Omdat de hersenen zelf functioneren als een complex netwerk van verbonden regio’s, bieden grafische neurale netwerken een natuurlijke manier om hun structuur en dynamiek te representeren. Naarmate deze AI-modellen geavanceerder worden, kunnen ze diepere inzichten in neurale activiteit en cognitie ontsluiten.

Uiteindelijk kan het verbeteren van de decoding van hersensignalen de weg vrijmaken voor een nieuwe generatie technologieën die mensen in staat stellen om meer naadloos dan ooit tevoren met machines te interacteren.

Als de vooruitgang op het huidige tempo doorgaat, kunnen brain-computer interfaces mogelijk binnenkort overgaan van experimentele onderzoeksinstrumenten naar alledaagse hulpmiddelen die in staat zijn om onafhankelijkheid en mobiliteit te herstellen voor miljoenen mensen wereldwijd.