윤리

AI 사고 데이터베이스는 AI 알고리즘이 더 안전해지도록 도모한다

충분히 큰 시스템은 오류가 발생할 수밖에 없으며, 이러한 오류를 수정하는 데에는 분석할 수 있는 영향을 받은 데이터베이스가 필요하다. FDA가 부작용 약물 반응에 대한 데이터베이스를 유지하거나 National Transportation Safety Board가 항공 사고에 대한 데이터베이스를 유지하는 것과 마찬가지로, AI Incident Database는 AI 시스템의 오류를 카탈로그화하고 이러한 오류를 피하는 새로운 방법을 개발하는 데 도움이 되도록 설계된 데이터베이스이다. AI Incident Database(AIID)의 제작자들은 이 데이터베이스가 AI 회사들이 더 안전하고 윤리적인 AI를 개발하는 데 도움이 될 것이라고 희망한다.

AIID는 무엇인가?

AIID는 Partnership on AI (PAI) 조직의 제품이다. PAI는 2016년에 Facebook, Apple, Amazon, Google, IBM, Microsoft와 같은 대형 기술 회사에서 AI 연구 팀의 구성원에 의해 설립되었다. 이후 조직은 다양한 비영리 단체를 포함한 많은 다른 조직의 구성원을 모집했다. 2018년에 PAI는 AI 오류에 대한 일관된 분류 표준을 만들기 위해 노력했다. 그러나 이러한 분류를 기반으로 할 수 있는 AI 사고의 수집이 없었다. 이 이유로 PAI는 AIID를 만들었다.

TechTalks에 따르면, AIID의 형식은 National Transportation Safety Board가 유지하는 항공 사고 데이터베이스의 구조에 의해 영향을 받았다. 1996년부터 보고서가 수집되기 시작한 이후, 상업용 항공 여행 시스템은 사고를 보관하고 분석함으로써 항공 산업의 안전성을 높일 수 있었다. 비슷한 저장소의 AI 사고가 AI 시스템을 더 안전하고 윤리적이며 신뢰할 수 있게 만들 수 있다는希望이다. AIID는 또한 다양한 산업과 분야의 주목할만한 소프트웨어 오류를 포함하는 Common Vulnerabilities and Exposures 데이터베이스에서 영감을 얻었다.

Sean McGregor는 IBM의 Watson AI XPRIZE를 위한 주요 기술 컨설턴트이다. McGregor는 또한 AIID의 실제 데이터베이스 개발을 감독한다. McGregor에 따르면, AIID의 궁극적인 목표는 AI 시스템이 해를 입히지 않도록 방지하거나, 적어도 부정적인 사고의 심각성을 줄이는 것이다. McGregor는 기계 학습 시스템이 전통적인 소프트웨어 시스템보다 훨씬 더 복잡하고 예측할 수 없으며, 따라서 다른 소프트웨어와 동일한 방식으로 테스트할 수 없다고 지적했다. 기계 학습 시스템은 예상치 못한 방식으로 행동을 변경할 수 있다. McGregor는 딥 러닝 시스템의 학습 능력이 “고장 나면 더 가능성이 높고, 더 복잡하고, 더 위험하다”는 것을 의미한다고 주목했다.

1,000개 이상의 AI 관련 사고 로그

AIID가 처음 만들어진 이후, 1,000개 이상의 AI 관련 사고가 데이터베이스에 로그되었다. 데이터베이스에 있는 모든 사고 중에서, AI 공정성과 관련된 문제가 가장 일반적인 유형의 부정적인 사고였다. 이러한 공정성 사고 중 많은 부분은 정부 기관이 얼굴 인식 알고리즘을 사용하는 경우를 포함한다. McGregor는 또한 로봇과 관련된 사고가 데이터베이스에 추가되는 경우가 점점 더 많아지고 있다고 지적했다.

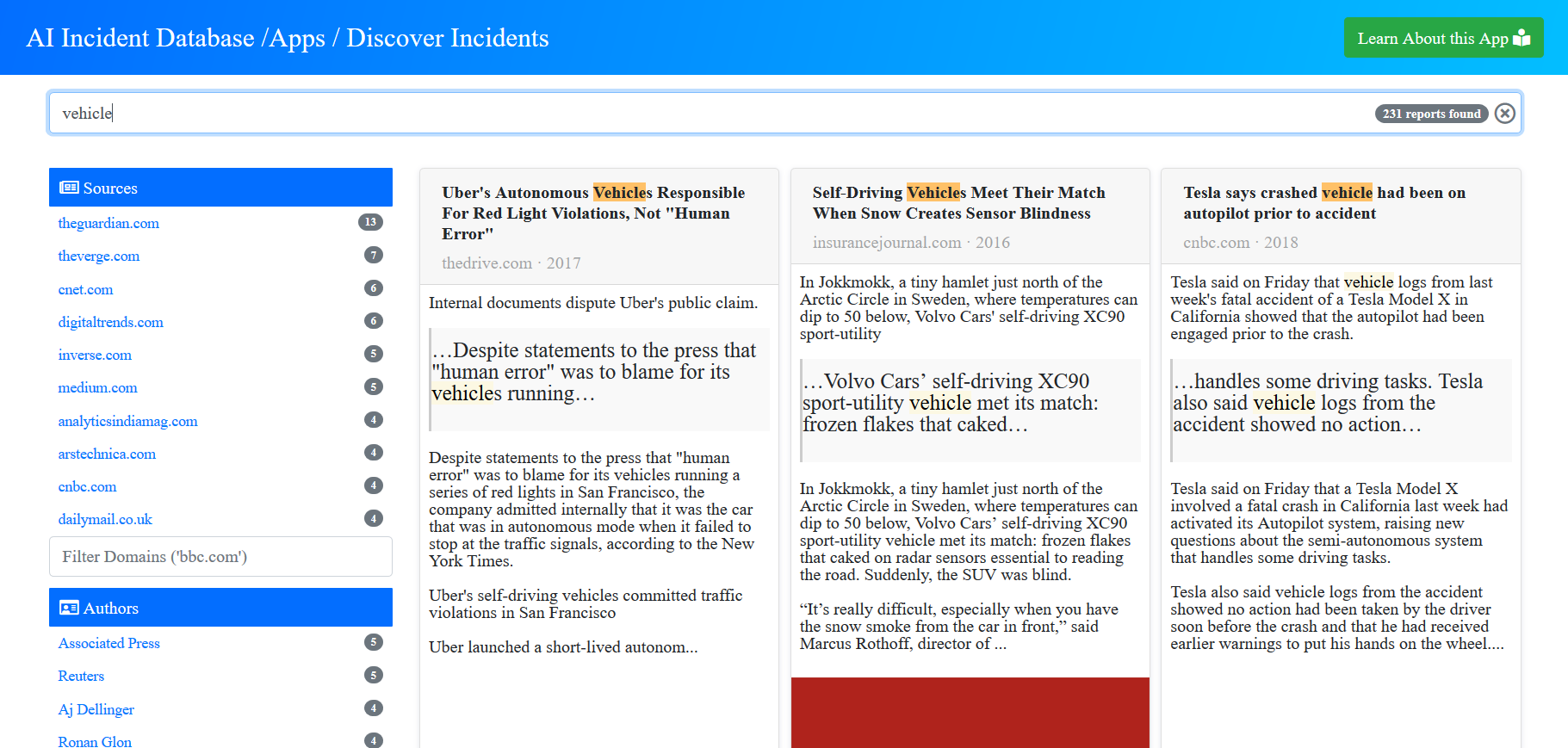

데이터베이스를 방문하는 사람들은 키워드, 사고 ID, 소스 또는 저자와 같은 기준에 따라 사고를 검색하여 데이터베이스를 쿼리할 수 있다. 예를 들어, “Deepfake”을 검색하면 7개의 보고서가 반환되고, “로봇”을 검색하면 158개의 보고서가 반환된다.

AI의 고장과 예상치 못한 방식으로 작동하는 사고에 대한 중앙 집중식 데이터베이스는 연구자, 엔지니어 및 윤리학자들이 AI 시스템의 개발 및 배포를 감독하는 데 도움이 될 수 있다. 기술 회사들의 제품 관리자는 AI 추천 시스템을 사용하기 전에 잠재적인 문제가 있는지 확인하기 위해 AIID를 사용할 수 있다. 또는 AI 엔지니어는 AI 응용 프로그램을 만들 때 수정해야 하는 잠재적인 편향에 대한 아이디어를 얻을 수 있다. 마찬가지로, 위험 담당자는 잠재적인 부정적인 부작용을 확인하기 위해 데이터베이스를 사용할 수 있으며, 이는 잠재적인 피해를 예방하고 예방 조치를 개발하는 데 도움이 될 수 있다.

AIID의 기본 아키텍처는 유연하게 설계되어 데이터베이스에 대한 쿼리와 의미 있는 통찰력을 추출하는 새로운 도구를 만들 수 있다. Partnership on AI와 McGregor는 모든 형태의 AI 사고를 분류할 수 있는 유연한 분류 체계를 개발하기 위해 협력할 것이다. 팀은 한 번 유연한 분류 체계가 만들어지면 자동으로 AI 사고를 로깅하는 시스템과 결합할 수 있을 것이라고 희망한다.

“AI 커뮤니티는 제품, 제어 절차 및 연구 프로그램의 변경을 мотив하기 위해 서로 사고 기록을 공유하기 시작했다”고 McGregor는 TechTalks를 통해 설명했다. “사이트는 11월에 공개적으로 출시되었으므로 시스템의 이점을 실현하기 시작했다.”