Anderson의 관점

‘보호’된 이미지들은 더 어려워지기보다는 AI로 훨씬 쉽게 도난당할 수 있다

새로운 연구에 따르면 AI 이미지 편집을 차단하기 위한 목적으로 설계된 워터마크 도구가 역효과를 낼 수 있다. Stable Diffusion과 같은 모델이 변경을 만드는 것을 방지하는 대신, 일부 보호는 실제로 도움을 준다. AI가 편집 지시를 더密接하게 따르도록 하여, 원치 않는 조작을 훨씬 쉽게 만들 수 있다.

컴퓨터 비전 문헌에는 저작권 이미지를 AI 모델에 훈련시키거나 직접 이미지>이미지 AI 프로세스에서 사용되는 것을 방지하기 위한 보호된 이미지를 만드는 데 전념하는 두드러지고 강력한 연구가 있다. 이러한 시스템은 일반적으로 Latent Diffusion Models(LDMs)인 Stable Diffusion 및 Flux와 같은 시스템을 대상으로 한다. 이러한 모델은 노이즈 기반 절차를 사용하여 이미지의 인코딩 및 디코딩을 수행한다.

정상적인 이미지를 삽입하여 적대적 노이즈를 삽입함으로써, 이미지 감지기를 오류로 인해 이미지 내용을 잘못 추측하게 할 수 있으며, 이미지 생성 시스템이 저작권 데이터를 악용하는 것을 방지할 수 있다.

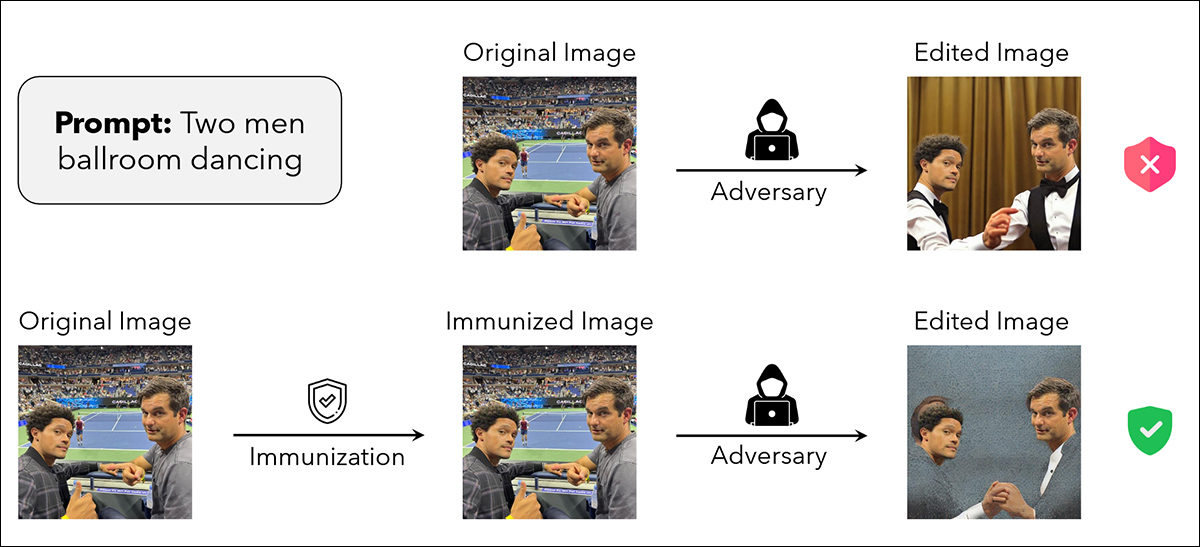

MIT 논문 ‘Raising the Cost of Malicious AI-Powered Image Editing’의 예시. 소스 이미지의 ‘면역화’ 예시(아래 행). 출처: https://arxiv.org/pdf/2302.06588

2023년 Stable Diffusion의 웹 스크래핑 이미지(저작권 이미지를 포함한)에 대한 자유로운 사용에 대한 예술가들의 반발 이후, 연구 현장은 같은 주제에 대한 여러 변형을 생산해왔다. 즉, 이미지들을 보이지 않는 방식으로 ‘중독’시켜서 AI 시스템에 훈련시키거나 생성적 AI 파이프라인에 빨リ 들어가지 않도록 하는 아이디어이다.

모든 경우에, 강제된 섭동의 강도와 이미지의 보호 정도 및 이미지의 품질이 良好하지 않은 정도 간에 직접적인 상관관계가 있다.

연구 PDF의 품질이 완전히 문제를 설명하지는 않지만, 더 많은 적대적 섭동은 품질을 희생하여 보안을 제공한다. 여기서 우리는 2020년 시카고 대학교가 주도한 ‘Fawkes’ 프로젝트의 품질 장애를 볼 수 있다. 출처: https://arxiv.org/pdf/2002.08327

특히 자신의 스타일을 무단 사용으로부터 보호하려는 예술가들에게 관심이 있는 이러한 시스템의 능력은 단지 身分을 은닉하고 다른 정보를 은닉하는 것뿐만 아니라, AI 훈련 프로세스가 실제로 보는 것보다 다른 것을 보도록 설득하여, ‘보호된’ 훈련 데이터에 대해 시각적 및 의미적 영역 간에 연결이 형성되지 않도록 하는 것이다(예: ‘Paul Klee의 스타일’과 같은 프롬프트).

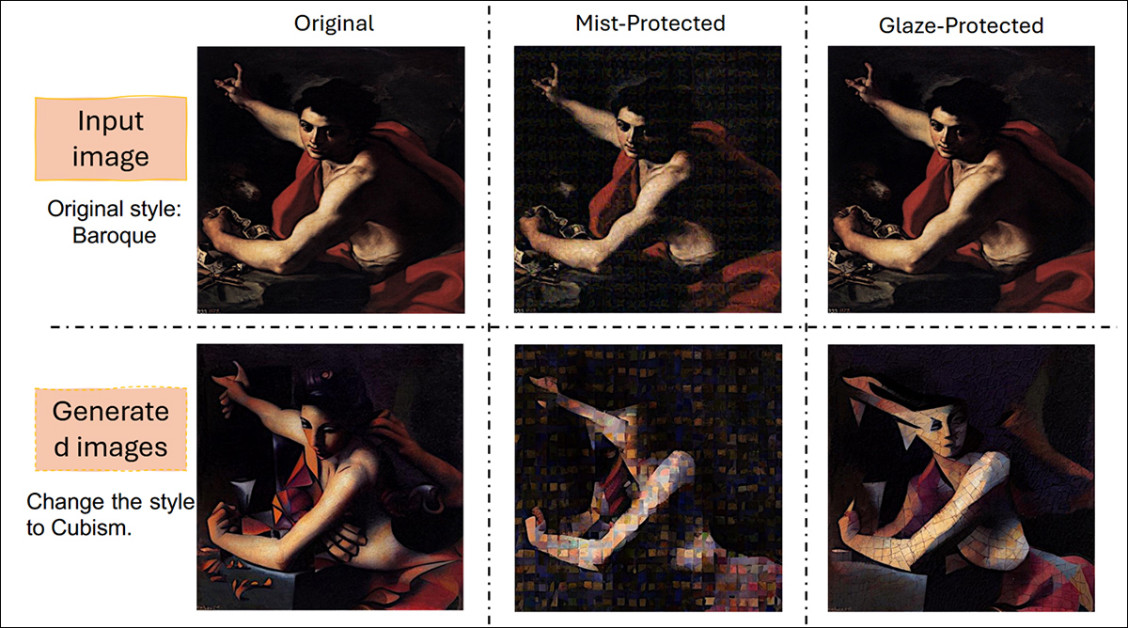

Mist와 Glaze는 두 개의 인기 있는 주입 방법으로, 저작권 스타일을 AI 워크플로우와 훈련 루틴에서 사용하는 것을 방지하거나 적어도 심각하게 방해할 수 있다. 출처: https://arxiv.org/pdf/2506.04394

Own Goal

이제, 미국의 새로운 연구에 따르면 섭동이 이미지의 보호에 실패할 뿐만 아니라, 섭동을 추가하는 것이 실제로 이미지의 악용 가능성을 모든 AI 프로세스에서提高할 수 있다.

이 논문은 다음과 같이 말한다:

‘우리의 실험에서 다양한 섭동 기반 이미지 보호 방법을 여러 도메인(자연 장면 이미지 및 예술 작품)와 편집 작업(이미지-이미지 생성 및 스타일 편집)에서 테스트한 결과, 이러한 보호가 완전히 목표를 달성하지 못하는 것을 발견했다.

‘대부분의 시나리오에서, 확산 기반 편집의 보호된 이미지 생성은 지침 프롬프트에 정확히 부합하는 원하는 출력 이미지를 생성한다.

‘우리의 발견에 따르면, 이미지에 노이즈를 추가하는 것이 생성 프로세스에서 주어진 텍스트 프롬프트와의 연관성을 paradoxically 증가시켜, 예상치 못한 결과로 더 좋은 편집 결과를 가져올 수 있다.

‘따라서, 우리는 섭동 기반 방법이 확산 기반 편집에 대한 강력한 이미지 보호를 제공하지 않을 수 있다고 주장한다.’

테스트에서, 보호된 이미지는 두 가지 친숙한 AI 편집 시나리오에 노출되었다. 즉, 직접 이미지-이미지 생성과 스타일 전송이다. 이러한 프로세스는 AI 모델이 보호된 콘텐츠를 악용하는 일반적인 방법을 반영한다. 즉, 이미지를 직접 변경하거나 스타일 특성을 다른 곳에서 사용한다.

보호된 이미지는 표준 이미지 소스와 예술 작품에서 가져온 이미지로 구성되었다. 이러한 이미지는 파이프라인을 통해 전송되어 추가된 섭동이 편집을 차단하거나 열화시키는지 여부를 확인하기 위해 사용되었다.

대신, 보호의 존재는 종종 모델의 프롬프트와의 정렬을 더 뚜렷하게 만들었으며, 예상과는 달리 깨끗하고 정확한 출력을 생성했다.

저자들은 효과적으로 이러한 인기 있는 보호 방법이 거짓된 보안 감을 제공할 수 있으며, 이러한 섭동 기반 면역 접근 방식은 저자의 방법에 대해 철저히 테스트되어야 한다고 조언한다.

Method

저자들은 세 가지 보호 방법을 사용하여 실험을 수행했다. 이 방법은慎重하게 설계된 적대적 섭동을 적용한다: PhotoGuard; Mist; 및 Glaze.

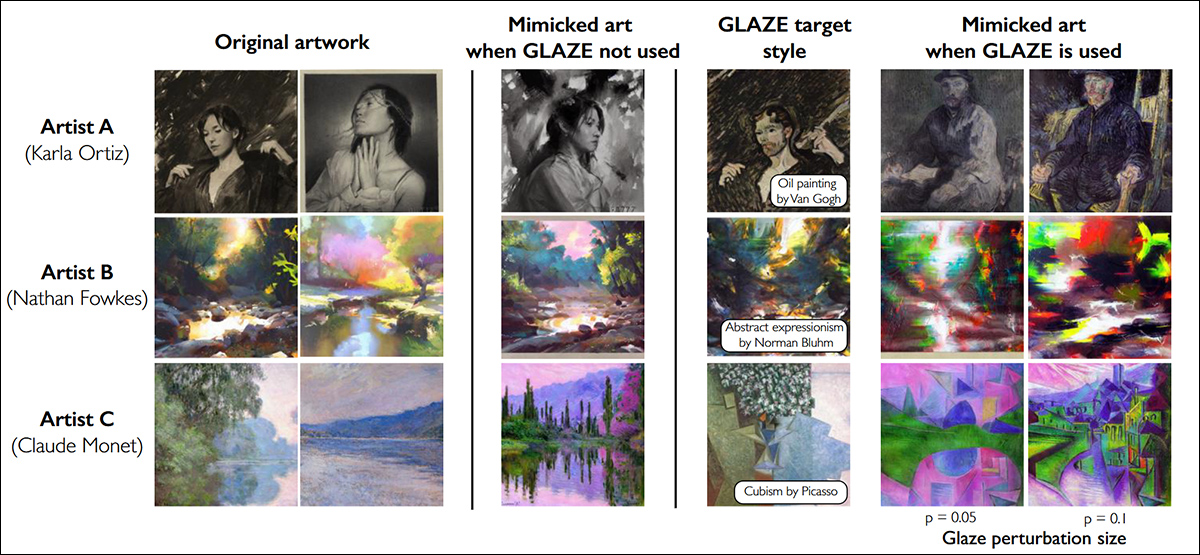

저자들이 테스트한 프레임워크 중 하나인 Glaze. 세 명의 예술가에 대한 Glaze 보호 예시. https://arxiv.org/pdf/2302.04222