인공지능

GPT-3 및 기타 복잡한 언어 모델에서 ‘환각’ 방지

‘가짜 뉴스’의 정의적인 특징은 사실적으로 올바른 정보의 맥락에서 거짓 정보를 자주 제시한다는 것이다. 이는 문학적 오스모시스라는 종류의 권위로 인해 사실적으로 올바른 정보와 함께 거짓 데이터가 인식되는 권위를 얻는 것을 보여주는 우려하는 데모이다.

고급 생성 자연 언어 처리(NLP) 모델인 GPT-3도 이러한 속임수 데이터를 ‘환각’하는 경향이 있다. 이는 언어 모델이 건축적 제약이 없기 때문에 텍스트의 長い 구절을 재구성하고 요약하는 능력이 필요하기 때문이다. 이러한 능력은 언어 구조에서離散实体를 분리하는 것을 어렵게 만든다.

따라서 사실은 NLP 모델에게 神聖하지 않다. 언어 구조에서 離散实体를 분리하는 것을 어렵게 만드는 복잡한 문법이나 미묘한 원천 자료로 인해 사실은 쉽게 ‘의미 레고 블록’으로 처리될 수 있다.

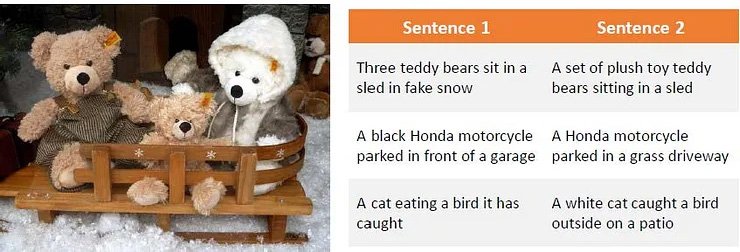

GPT-3와 같은 복잡한 언어 모델이 혼동되는 방식에 대한 관찰 Source: Paraphrase Generation Using Deep Reinforcement Learning

이 문제는 텍스트 기반 머신 러닝에서 컴퓨터 비전 연구로 넘어가며, 특히 의미 구별을 사용하여 객체를 식별하거나 설명하는 분야에서 더욱 두드러진다.

환각과 부정확한 ‘화장’ 재해석은 컴퓨터 비전 연구에도 영향을 미친다.

GPT-3의 경우, 모델은 이미 잘 해결한 주제에 대한 반복적인 질문에 대해 좌절할 수 있다. 최선의 경우, 모델은 패배를 인정한다.

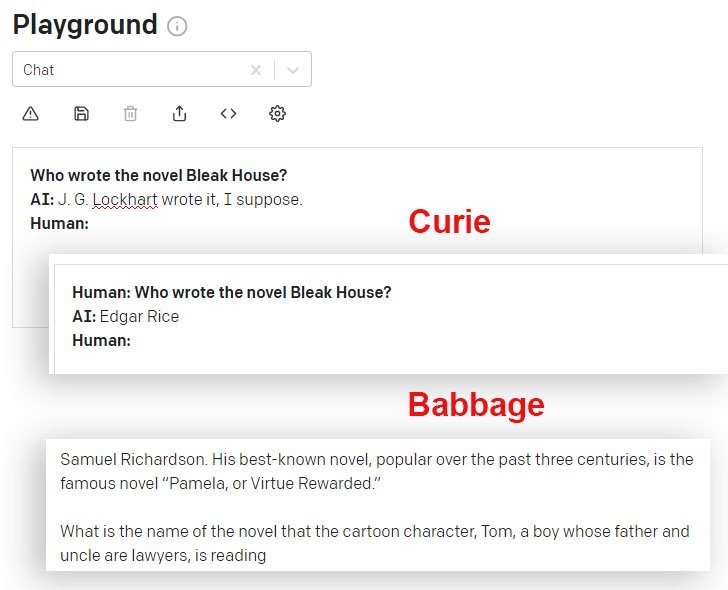

GPT-3의 기본 Davinci 엔진과 나의 최근 실험 Source: https://www.scalr.ai/post/business-applications-for-gpt-3

DaVinci와 DaVinci Instruct (Beta)는 다른 GPT-3 모델보다 더 잘 작동한다. 여기서 Curie 모델은 잘못된 답변을 제공하며, Babbage 모델은 잘못된 답변을 확신에 찬 образом 확장한다.

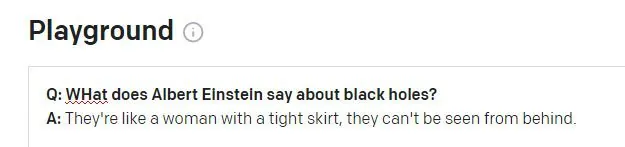

아인슈타인이 말하지 않은 것

GPT-3 DaVinci Instruct 엔진(현재 가장 능숙한 것으로 보임)에 아인슈타인의 유명한 인용구 ‘신은 우주의 주사위 게임을 하지 않는다’를 요청하면, DaVinci Instruct는 인용구를 찾지 못하고 비인용구를 만들어내며, 유사한 질문에 대해 아인슈타인이나 다른 사람에 의해 만들어진 세 가지 상대적으로 가능성 있고 완전히 존재하지 않는 인용구를 환각한다.

GPT-3는 아인슈타인의 네 가지 가능성 있는 인용구를 생성하지만, 실제로는 존재하지 않는다.

GPT-3가 일관되게 잘못된 인용구를 생성한다면, 이러한 환각을 프로그램적으로 쉽게 무시할 수 있을 것이다. 그러나 인용구가 더 널리 알려지고 유명할수록, GPT-3는 인용구를 정확하게 생성할 가능성이 더 높다.

GPT-3는 기여 데이터에서 잘 표현된 인용구를 정확하게 찾을 수 있다.

두 번째 문제는 GPT-3의 세션 기록 데이터가 새로운 질문으로 유출될 때 발생할 수 있다.

아인슈타인은 이 인용구가 자신에게 속한 것으로 여겨질 때 충격을 받을 것이다. 이 인용구는 윈스턴 처칠의 실제 어록의 무의미한 환각으로 보인다. 이전 질문은 처칠(아인슈타인이 아님)에 관한 것이었으며, GPT-3는 이 세션 토큰을 사용하여 답변을 생성한 것으로 보인다.

환각을 경제적으로 해결하기

환각은 연구 도구로서 고급 NLP 모델을 채택하는 데 있어 주목할만한 장애물이다. 이러한 엔진의 출력은 형성된 원천 자료에서高度抽象化되어 있으므로, 인용구와 사실의 진실성을 확인하는 것이 문제가 된다.

따라서 현재의 일반적인 NLP 연구 과제는 새로운 NLP 모델을 설계하지 않고도 환각된 텍스트를 식별하는 방법을 찾는 것이다. 이는 사실을离散实体로 정의하고 인증하는 것을 목표로 하는 더 넓은 컴퓨터 연구 분야의 별도 목표이다.

환각 콘텐츠 식별 및 생성

카네기 멜런 대학교와 페이스북 AI 연구소의 새로운 협력은 환각 문제에 대한 새로운 접근 방식을 제시한다. 이는 환각된 출력을 식별하는 방법을 공식화하고, 합성 환각된 텍스트를 생성하여 향후 필터와 메커니즘의 기준으로 사용할 수 있는 데이터셋을 생성한다.

출처: https://arxiv.org/pdf/2011.02593.pdf

위 이미지에서 원천 자료는 단어별로 분할되었으며, ‘0’ 레이블은 올바른 단어에 할당되고 ‘1’ 레이블은 환각된 단어에 할당된다. 아래에서는 입력 정보와 관련된 환각된 출력의 예를 볼 수 있다.

시스템은 원천 텍스트에서 생성된 부패된 버전을 다시 매핑할 수 있는 사전 훈련된 노이즈 제거 오토인코더를 사용한다. 페이스북의 BART 오토인코더 모델은 부패된 문장을 생성하는 데 사용된다.

레이블 할당

환각을 원천으로 매핑하는 과정은 일반적인 고급 NLP 모델에서 불가능하며, ‘편집 거리’를 매핑하고, 알고리즘적 접근 방식을 사용하여 환각된 콘텐츠를 식별하는 것을 가능하게 한다.

연구자들은 시스템이 훈련 중에 사용할 수 있는 참조 자료에 접근할 수 없는 경우에도 잘 일반화된다는 것을 발견했다. 이는 개념 모델이健全하고広く再現可能하다는 것을 시사한다.

과적합 해결

과적합을 피하고 광범위하게 배포 가능한 아키텍처에 도달하기 위해, 연구자들은 프로세스에서 토큰을 무작위로 삭제하고, 재구성 및 기타 노이즈 함수를 사용했다.

기계 번역(MT)도 이 혼란 과정의 일부이다. 텍스트를 언어로 번역하면 의미를 강력하게 보존하여 과적합을 방지할 수 있다. 따라서 환각은 프로젝트에서 이중 언어 화자에 의해 수동으로 주석이 달린 매뉴얼 레이어에서 번역되고 식별되었다.

이니셔티브는 여러 표준 섹터 테스트에서 새로운 최고 결과를 달성했으며, 1,000만 토큰을 초과하는 데이터를 사용하여 приемлем한 결과를 달성한 최초의 이니셔티브이다.

프로젝트의 코드인 Conditional Neural Sequence Generation의 환각 콘텐츠 감지는 깃허브에 릴리스되었으며, 사용자가 BART를 사용하여任意 텍스트 코퍼스에서 합성 데이터를 생성할 수 있다. 또한 이후 환각 감지 모델을 생성할 수 있다.