인공지능

우리의 무의식적인 딥페이크 탐지 능력이 미래의 자동화 시스템을 구동할 수 있다

호주에서 수행된 새로운 연구에 따르면 우리의 뇌는 복잡한 딥페이크를 인식하는 데 매우 능숙하다고 한다. 즉, 우리가 의식적으로 보는 이미지들이 실제로 진짜인지 여부와 상관없이 말이다.

이 발견은 또한 사람들의 신경 반응(그들의 의견이 아니라)을 사용하여 자동화된 딥페이크 탐지 시스템을 훈련하는 가능성을 더욱 시사한다. 이러한 시스템은 이미지의 딥페이크 특성에 대한 혼란스러운 추정치가 아니라 우리의 직관적 인식 메커니즘을 통해 훈련될 것이다.

‘뇌는 실제와 실제와 유사한 얼굴을 구별할 수 있지만, 관찰자는 의식적으로 구별할 수 없다. 우리의 발견은 뇌 반응과 행동 사이의 불일치를 보여주며, 가짜 얼굴 인식에 대한 연구, 가짜 이미지 식별에 대한 질문, 가짜 이미지 오남용에 대한 보호 기준을 설정하는 방법에 대한 시사점을 제공한다.’

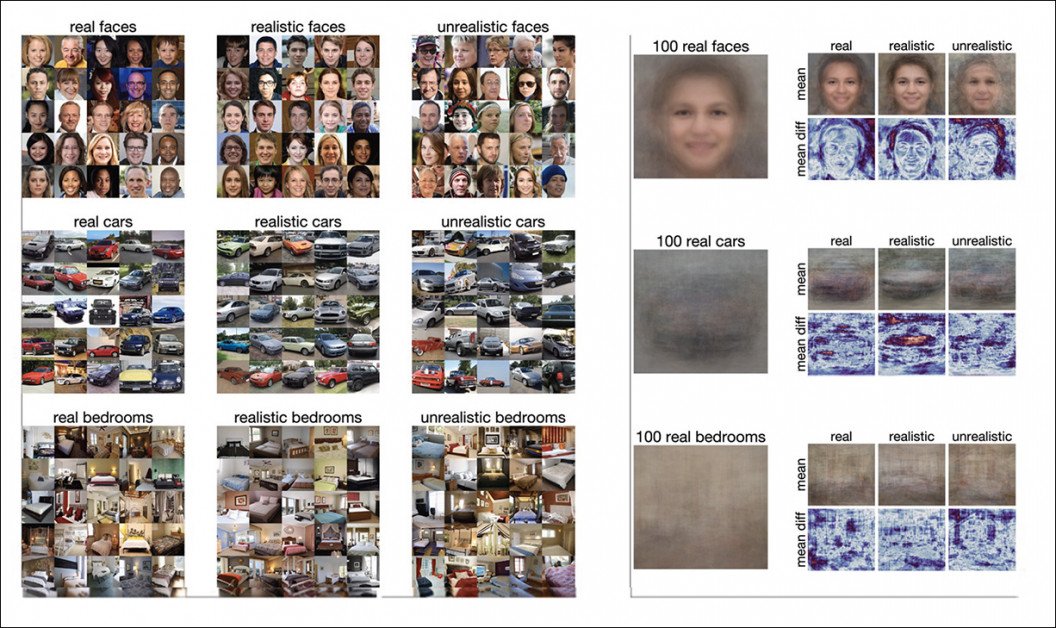

이 결과는 가짜 이미지, 즉 명백하게 가짜 얼굴, 자동차, 실내 공간, 거꾸로 된 얼굴에 대한 사람들의 반응을 평가하기 위한 테스트 라운드에서 나왔다.

실험에 사용된 다양한 반복과 접근법. 두 개의 테스트 그룹이 잠깐 보여진 이미지를 ‘가짜’ 또는 ‘진짜’로 분류해야 했다. 첫 번째 라운드는 Amazon Mechanical Turk에서 200명의 자원봉사자와 함께 수행되었으며, 두 번째 라운드는 EEG 기계에 연결된 더 작은 수의 자원봉사자와 함께 수행되었다. 출처: https://tijl.github.io/tijl-grootswagers-pdf/Moshel_et_al_-_2022_-_Are_you_for_real_Decoding_realistic_AI-generated_.pdf

이 논문은 다음과 같이 주장한다:

‘결과는 관찰자가 짧은 시간 내에 가짜 얼굴을 식별할 수 있음을 보여준다. 그러나 관찰자는 실제 얼굴과 가짜 얼굴을 구별하는 데 더 어려움을 겪었으며, 어떤 경우에는 가짜 얼굴을 실제 얼굴보다 더 실제로 믿었다.’

‘그러나 시간 분해 EEG와 다변량 패턴 분류 방법을 사용하여 실제 얼굴과 가짜 얼굴을 구별하는 뇌 활동을 해독할 수 있었다.’

‘가짜 얼굴 인식과 관련하여 중요한 새로운 증거를 제공하는 행동과 신경 반응 사이의 불일치이다.’

이 논문은 이 새로운 연구가 적용된 사이버 보안 분야에서 여러 가지 의미를 가지고 있으며, 딥페이크 학습 분류기의 개발은 의식적인 평가가 아니라 EEG 기록에서 측정된 가짜 이미지에 대한 무의식적인 반응에 의해 주도되어야 한다고 제안한다.

저자들은 다음과 같이 말한다:

‘이것은 얼굴을 인식하거나 익숙한 얼굴과 낯선 얼굴을 구별할 수 없는 사람들조차도 낯선 얼굴보다 익숙한 얼굴에 대해 더 강한 자율적 반응을 보인다는 연구 결과와 유사하다.’

‘이 연구에서 우리는 실제 얼굴과 실제와 유사한 얼굴을 신경 활동으로부터 해독할 수 있음을 보여주었다. 그러나 이 차이는 행동적으로 관찰되지 않았다. 대신 관찰자는 69%의 실제 얼굴을 가짜로 식별했다.’

新的 연구는 新的 연구로, 시드니 대학교, 맥쿼리 대학교, 웨스턴 시드니 대학교, 그리고 퀸즐랜드 대학교의 4명의 연구자에 의해 수행되었다.

데이터

결과는 명백하게 거짓된 이미지, 초현실적인 이미지, 실제 이미지의 구별 능력에 대한 더广泛한 조사에서 나왔다.

연구자들은 NVIDIA에서 제공한 GAN(생성적 적대적 네트워크)을 사용하여 생성된 이미지들을 사용했다.

NVIDIA에서 제공한 GAN으로 생성된 인간 얼굴 이미지. 출처: https://drive.google.com/drive/folders/1EDYEYR3IB71-5BbTARQkhg73leVB9tam

데이터는 25개의 얼굴, 자동차, 침실을 포함하며, 렌더링 수준은 ‘비현실적’에서 ‘현실적’까지 다양했다. 얼굴 비교를 위한 적절한 비가짜 자료로, 연구자들은 NVIDIA의 FFHQ(프리커즈-페이스-HQ) 데이터셋의 원본 데이터를 사용했다. 다른 시나리오 비교를 위해, LSUN 데이터셋의 자료를 사용했다.

이미지는 최종적으로 테스트 대상자에게 올바른 방향 또는 거꾸로, 다양한 주파수에서 표시되었으며, 모든 이미지는 256×256 픽셀로 크기가 조정되었다.

모든 자료가 수집된 후, 테스트를 위해 450개의 자극 이미지가 선정되었다.

테스트

테스트는 처음에 온라인으로 수행되었으며, jsPsych를 사용하여 pavlovia.org에서 200명의 참가자가 다양한 하위 집합의 총 수집된 테스트 데이터를 평가했다. 이미지는 200ms 동안 표시된 후, 빈 화면이 나타나고 참가자가 이미지가 가짜인지 실제인지 결정할 때까지 유지되었다. 각 이미지는 한 번만 표시되었으며, 전체 테스트는 3-5분 정도 걸렸다.

두 번째 테스트는 더 많은 정보를 제공했으며, 참가자들이 EEG 기계에 연결된 상태에서 수행되었다. 이 테스트는 Psychopy2 플랫폼에서 수행되었으며, 각 20개의 시퀀스는 40개의 이미지를 포함했으며, 전체 테스트 데이터에 걸쳐 18,000개의 이미지가 표시되었다.

수집된 EEG 데이터는 MATLAB에서 CoSMoMVPA 툴박스를 사용하여 해독되었으며, 선형 판별 분석(LDA)下的 leave-one-out 교차 검증 方案을 사용했다.

LDA 분류기는 뇌의 반응과 참가자의 의견 사이의 구별을 할 수 있는 구성요소였다.

결과

연구자들은 EEG 테스트 참가자가 가짜 얼굴과 실제 얼굴을 구별할 수 있는지 여부를 확인하고자 했다. 결과를 집계하고 처리한 결과, 참가자들은 실제 얼굴과 비현실적인 얼굴을 쉽게 구별할 수 있었지만, 실제와 유사한 가짜 얼굴을 구별하는 데 어려움을 겪었다. 이미지가 거꾸로 표시되는지 여부는 거의 차이를 나타내지 않았다.

두 번째 라운드에서 실제와 합성된 얼굴의 행동적 구별.

그러나 EEG 데이터는 다른 이야기를告诉했다.

이 논문은 다음과 같이 말한다:

‘관찰자는 실제 얼굴과 가짜 얼굴을 구별하는 데 어려움을 겪었으며, 가짜 얼굴을 과도하게 분류했지만, EEG 데이터에는 실제와 실제와 유사한 얼굴을 구별하는 데 의미 있는 차이를 보이는 신호 정보가 포함되어 있었다. 이 신호는 비교적 짧은 처리 단계에 제한되었다.’

여기서 EEG의 정확도와 참가자의 의견은 동일하지 않으며, EEG 캡처는 참가자의 인식보다 더 실제에 가깝다.

연구자들은 참가자들이 가짜 얼굴을 암묵적으로 식별할 수 없지만, 이러한 얼굴은 인간 시각 시스템에_distinct한 표현形式을 가지고 있다고 결론지었다.

발견된 불일치는 연구자들이 미래의 보안 메커니즘에 대한 잠재적 적용에 대해 추측하게 했다:

‘サイバーセキュリティ 또는 딥페이크와 같은 적용된 환경에서, 실제와 실제와 유사한 얼굴의 탐지 능력을 조사하는 것은 행동적 성과를 목표로 하는 것보다 신경 영상 데이터에 기계 학습 분류기를 적용하는 것이 더 좋을 수 있다.’

그들은 다음과 같이 결론지었다:

‘가짜 얼굴 탐지에 대한 뇌와 행동 사이의 불일치를 이해하는 것은 가짜 정보의 잠재적으로 유해하고 普遍的な 확산을 다루는 방법에 대한 실질적인 의미를 가질 것이다.’

* 내부 인용문의 하이퍼링크로의 변환.

최초로 게시된 날짜는 2022년 7월 11일이다.