인공지능

NeRF: 드론을 신경 복사 환경에서 훈련시키기

스탠퍼드 대학교의 연구자들은 최근 Neural Radiance Fields (NeRF)에 대한 관심의 급증을利用하여 드론을 사진적으로 현실적이고 정확한 환경에서 탐색하도록 훈련시키는 새로운 방법을 개발했습니다.

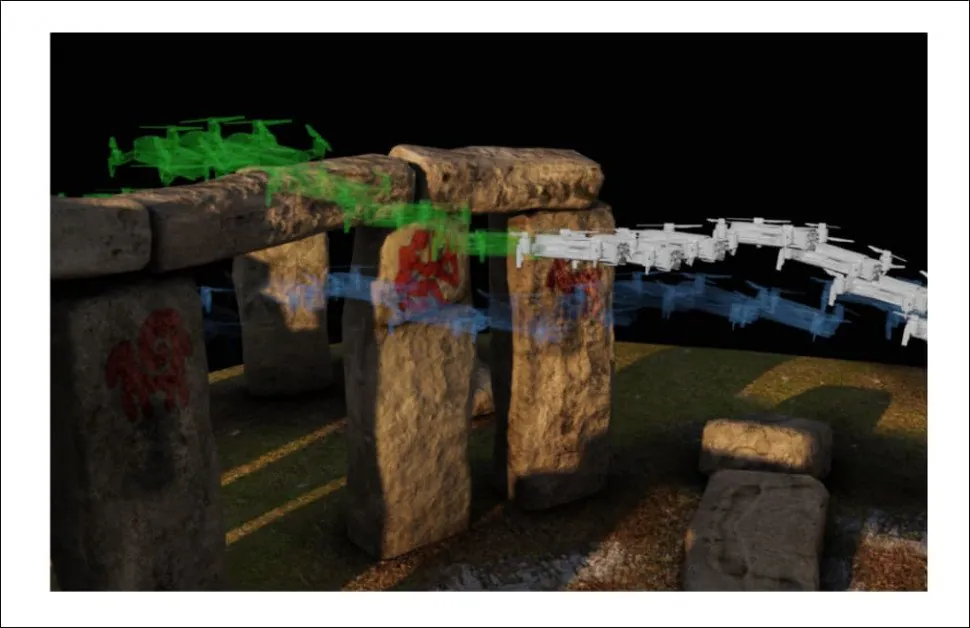

드론은 실제 위치에서 직접 매핑된 가상 환경에서 훈련될 수 있으며, 전문 3D 장면 재구성을 위한 별도의 장비가 필요하지 않습니다. 이 이미지에서 바람 방해가 잠재적인 장애물로 추가되었으며, 드론이 일시적으로 궤도에서 벗어나지만 마지막 순간에 잠재적인 장애물을 피하기 위해 보상합니다. Source: https://mikh3x4.github.io/nerf-navigation/

이 방법은 드론(또는 다른 유형의 객체)을 자동으로 볼륨 정보(충돌 회피를 계산하기 위해), 실제 사진에서 그려진 텍스처(드론의 이미지 인식 네트워크를 더욱 현실적으로 훈련시키기 위해) 및 실제 조명(네트워크에 다양한 조명 시나리오를 훈련시키기 위해)을 포함하는 가상 시나리오에서 상호작용적으로 훈련할 수 있는 가능성을 제공합니다.

소파-객체가 전통적인 AR/VR 워크플로에서 기하학적 캡처와 리텍스처링을 사용하여 매핑하기가 매우 어려웠을 복잡한 가상 환경을 탐색합니다. 그러나 이 환경은 위치에서 촬영한 제한된 수의 사진에서 자동으로 NeRF에서 재구성되었습니다. Source: https://www.youtube.com/watch?v=5JjWpv9BaaE

일반적인 NeRF 구현에는 궤도 메커니즘이 포함되지 않습니다. 대부분의 NeRF 프로젝트는 장면 재조명, 반사 렌더링, 컴포지팅 및 캡처된 요소의 분리와 같은 다른 도전 과제에 집중해 왔습니다. 따라서 새로운 논문의 주요 혁신은 네비게이션할 수 있는 공간으로 NeRF 환경을 구현하는 것입니다. 이는 3D 환경을 기반으로 센서 캡처와 CGI 재구성을 위한 광범위한 장비와 노동집약적인 절차가 필요하지 않습니다.

NeRF as VR/AR

새로운 논문은 신경 복사 세계에서 로봇의 시각 전용 탐색이라고 제목이 붙여졌으며, 스탠퍼드 대학교의 세 부서(Aeronautics and Astronautics, Mechanical Engineering, Computer Science) 간의 협력입니다.

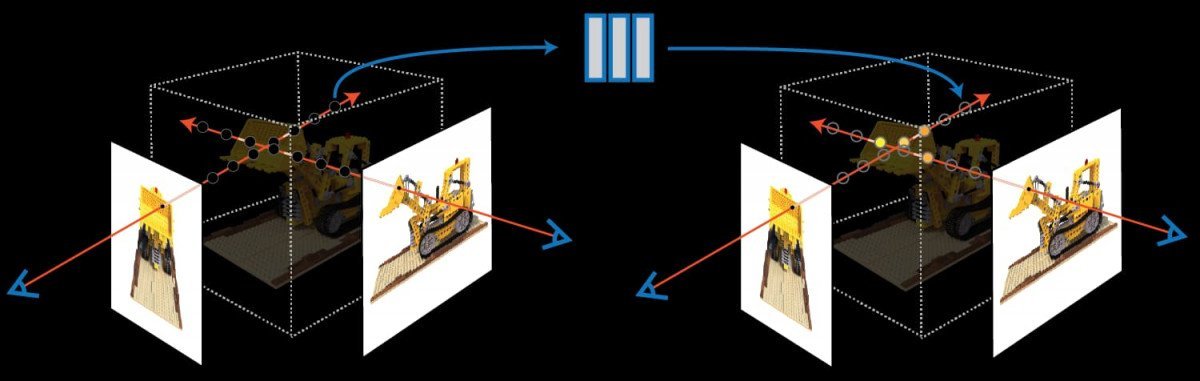

이 연구는 로봇에 사전 훈련된 NeRF 환경을 제공하는 네비게이션 프레임워크를 제안합니다. 여기서 볼륨 밀도는 장치에 대한 가능한 경로를 정의합니다. 또한 로봇의 온보드 RGB 카메라의 이미지 인식에 기반한 필터가 포함되어 로봇이 가상 환경 내에서 어디에 있는지 추정합니다. 이렇게 하면 드론 또는 로봇이 주어진 환경에서 무엇을 기대할 수 있는지 더 정확하게 ‘상상’할 수 있습니다.

프로젝트의 궤도 최적화기가 사진기법과 이미지 해석을 통해 생성된 스톤헨지의 NeRF 모델을 통해 탐색합니다. 궤도 플래너는 아치를 가로지르는 최적의 궤도를 설정하기 전에 여러 가능한 경로를 계산합니다.

NeRF 환경은 완전히 모델링된 오คล루전을 특징으로 하므로, 드론은 더 쉽게 장애물을 계산할 수 있습니다. 이는 NeRF를 위한 신경 네트워크가 오클루전과 드론의 온보드 비전 기반 네비게이션 시스템이 환경을 인식하는 방식 사이의 관계를 매핑할 수 있기 때문입니다. 자동화된 NeRF 생성 파이프라인은 몇 개의 사진만으로 초실제적 훈련 공간을 생성하는 비교적 간단한 방법을 제공합니다.

스탠퍼드 프로젝트에서 개발된 온라인 재계획 프레임워크는 완전히 비전 기반의 내구성 있는 네비게이션 파이프라인을 제공합니다.

스탠퍼드 이니셔티브는 NeRF 공간을 네비게이션할 수 있는 및 몰입형 VR 스타일의 환경으로 탐색하는 가능성을 고려한 최초의 시도 중 하나입니다. 신경 복사 필드는 새로운 기술로, 현재 높은 컴퓨팅 리소스 요구 사항을 최적화하고 NeRF의 신경 네트워크 라이브 렌더 환경의 캡처된 요소를 분리하기 위한 다수의 학술 노력을 받고 있습니다.

Nerf Is Not (Really) CGI

NeRF 환경은 네비게이션할 수 있는 3D 장면이므로, 2020년에 등장한 이후로 종종 CGI 생성을 자동화하는 방법으로 잘못 이해되고 있습니다. 그러나 NeRF는 3D 환경을 모델링하고 텍스처링하는 것보다 라이브 렌더 공간을 제공합니다. 여기서 픽셀 및 조명 정보의 혼합이 유지되고 활성화된 신경 네트워크에서 탐색됩니다.

NeRF의 잠재력을 결정하는 핵심은 환경을 재구성하기 위해 제한된 수의 이미지만 필요로 하며, 생성된 환경이 높은忠實도 재구성을 위한 모든 필요한 정보를 포함한다는 것입니다. 이는 모델러, 텍스처 아티스트, 조명 전문가 및 전통적인 CGI에 기여하는 다른 많은 사람들의 서비스가 필요하지 않습니다.

Semantic Segmentation

NeRF는 효과적으로 ‘Computer-Generated Imagery’ (CGI)를 구성하지만, 완전히 다른 방법론과 고도로 자동화된 파이프라인을 제공합니다. 또한 NeRF는 장면의 이동 부분을 분리하고 캡슐화하여 가상 환경에서 별도의 요소로 작동할 수 있습니다. 이는 현재의 ‘할리우드’ 스타일의 CGI와는 비교할 수 없는 기능입니다.

상하이 테크 대학교에서 2021년 여름에 발표된 협력 프로젝트는 장면의 이동하는 NeRF 요소를 ‘붙일 수 있는’ 요소로 개별화하는 방법을 제공합니다. Source: https://www.youtube.com/watch?v=Wp4HfOwFGP4

NeRF의 아키텍처는 약간의 ‘블랙 박스’입니다. 현재 NeRF 환경에서 객체를 추출하고 전통적인 메시 기반 및 이미지 기반 도구로 직접 조작하는 것은 불가능합니다. 그러나 여러 연구 노력은 NeRF의 신경 네트워크 라이브 렌더 환경의 매트릭스를 분해하는 돌파구를 이루기 시작했습니다.

https://www.youtube.com/watch?v=5JjWpv9BaaE