Anderson의 관점

‘부엉이와 도마뱀’을 광고주의 대상으로 찾기

온라인 광고 분야는 2023년에 740.3억 달러를 지출한 것으로 추정되므로, 광고 회사들이 이 특정한 컴퓨터 비전 연구 분야에 상당한 자원을 투자하는 이유를 쉽게 이해할 수 있다.

광고 산업은 고립적이고 보호적이지만, 가끔씩 더 고급의 사유적인 연구를 Facial과 Eye-gaze 인식 – 포함하여 연령 인식, 인구 통계 통계에 중대한 것을 힌트하는 연구를 출판한다.

광고 콘텍스트에서 자동 얼굴 연령 추정을 실험한 예시에서 연주자 Bob Dylan의 연령을 추적한다. 출처: https://arxiv.org/pdf/1906.03625

이러한 연구는 거의 공공 저장소에 나타나지 않으며, 합법적으로 모집된 참가자를 기반으로 하여 광고와 얼마나, 그리고 어떤 방식으로 참여하고 있는지 결정하기 위한 AI 기반 분석을 수행한다.

Dlib의 Histogram of Oriented Gradients (HoG)가 종종 얼굴 추정 시스템에서 사용된다. 출처: https://www.computer.org/csdl/journal/ta/2017/02/07475863/13rRUNvyarN

동물 본능

이와 관련하여, 자연스럽게 광고 산업은 거짓 양성(분석 시스템이 주체의 행동을 잘못 해석하는 경우)을 결정하고, 화면 기반 광고와 관련하여 두 가지 문제에 초점을 맞춘 두 가지 환경에서 화면을 보고 있는 사람이 콘텐츠와 충분히 참여하지 않는 경우에 대한 명확한 기준을 설정하는 데 관심이 있다.

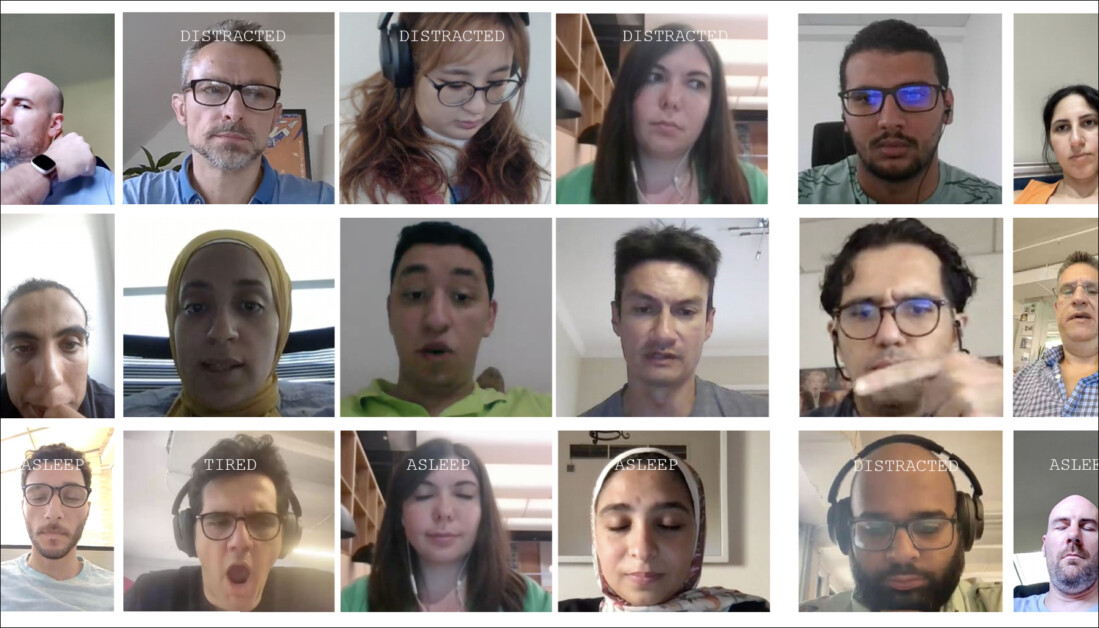

광고 연구 프로젝트의 주제에서 ‘부엉이’와 ‘도마뱀’ 행동의 예시를 보여주는 이미지.

광고 연구 프로젝트의 주제에서 ‘부엉이’와 ‘도마뱀’ 행동의 예시를 보여주는 이미지. 출처: https://arxiv.org/pdf/1508.04028

만약 당신이 광고에서 눈을 돌리고 있다면, 이것은 ‘부엉이’ 행동이다; 만약 당신의 머리 자세는 정적이지만, 당신의 눈은 화면에서 멀어지고 있다면, 이것은 ‘도마뱀’ 행동이다. 분석과 새로운 광고의 테스트에서, 이러한 행동은 시스템이 포착해야 하는 필수적인 행동이다.

SmartEye의 Affectiva 인수를 통해 새로운 논문이 이러한 문제를 해결하며, 기존 프레임워크를 활용하여 모든 조건과 가능한 반응에 대한 결합된 특징 집합을 제공하는 아키텍처를 제안한다.

다양한 분산 신호에 대한 새로운 주의 시스템에서 감지된 진양성과 거짓 양성의 예시, 데스크톱과 모바일 장치별로 별도로 표시됨. 출처: https://arxiv.org/pdf/2504.06237

저자들은 다음과 같이 말한다:

‘제한된 연구가 온라인 광고 중 주의를 측정하는 데에 깊이 들어가지 않았다. 이러한 연구는 주의를 식별하기 위해 머리 자세 또는 시선 방향을 추정하는 데 초점을 맞추었지만, 장치 유형(데스크톱 또는 모바일), 카메라 배치, 화면 크기와 같은 중요한 매개변수를 무시했다. 이러한 요인들은 주의 탐지에 크게 영향을 미친다. ‘

‘본 논문에서는 다양한 분산 요인, 즉 화면 밖을 보는 ‘부엉이’와 ‘도마뱀’ 행동, 말하기, 졸음(하품 및 장기간의 눈 감김), 화면 미사용을 포함하는 주의 탐지 아키텍처를 제안한다. ‘

‘과거 접근 방식과는 달리, 우리의 방법은 장치별 특징, 즉 장치 유형, 카메라 배치, 화면 크기(데스크톱의 경우) 및 카메라 방향(모바일 장치의 경우)을 원시 시선 추정과 함께 통합하여 주의 탐지 정확도를 향상시킨다.’

새로운 연구는 온라인 광고 중 시청자 주의 모니터링이라는 제목으로, Affectiva의 4명의 연구자에 의해 수행되었다.

방법 및 데이터

주로 이러한 시스템의 비밀성과 폐쇄적 성격으로 인해, 새로운 논문은 다른 접근 방식과 직접 비교하지 않고, 성과를 독점적으로 제거 연구로서 제시한다. 따라서 우리는 연구를 제시된 대로 살펴볼 것이다.

저자들은 주의 탐지에 대한 연구가 온라인 광고의 맥락에서 제한적이라고 강조한다. AFFDEX SDK에서는 주의가 머리 자세만으로 추론되며, 참가자가 주의를 기울이지 않는다고 레이블이 지정된다.

AFFDEX SDK의 얼굴 분석 예시. 출처: https://www.youtube.com/watch?v=c2CWb5jHmbY

2019년 협력 연구 딥 러닝을 사용한 비디오 콘텐츠에 대한 시각적 주의 자동 측정에서는 약 28,000명의 참가자가 다양한 주의하지 않는 행동에 대해 주석이 달린 데이터셋이 사용되었다.

2019년 논문에서 화면의 비디오 콘텐츠를 시청하는 시청자의 예상 주의 상태를 보여주는 예시. 출처: https://www.jeffcohn.net/wp-content/uploads/2019/07/Attention-13.pdf.pdf

그러나 저자들은 이러한 이전 노력들이 장치별 요인, 즉 데스크톱 또는 모바일 장치를 사용하는지 여부를 고려하지 않았으며, 화면 크기나 카메라 배치를 고려하지 않았다고 관찰한다. 또한, AFFDEX 시스템은 시선 분산만을 식별하며, 다른 분산 원인을 생략한다.

저자들은 주의 탐지 시스템을 위해 두 가지 상업용 툴킷, AFFDEX 2.0과 SmartEye SDK를 활용하여 아키텍처를 설계했다.

AFFDEX 2.0의 얼굴 분석 예시. 출처: https://arxiv.org/pdf/2202.12059

이전 연구는 저수준 특징, 즉 얼굴 표정, 머리 자세, 시선 방향을 추출한다. 이러한 특징은 이후 높은 수준의 지표를 생성하기 위해 처리된다.

데이터셋: 시선

저자들은 주의 탐지 시스템을 구동하고 평가하기 위해 네 가지 데이터셋을 사용했다. 세 가지 데이터셋은 각각 시선 행동, 말하기, 하품에 초점을 맞추고 있으며, 네 번째 데이터셋은 실제 광고 테스트 세션에서 다양한 분산 유형을 포함한다.

데이터셋은 각 카테고리별로 사용자 지정으로 생성되었다. 모든 데이터셋은 참가자가 광고를 시청하는 집이나 직장 환경에서 웹 기반 설정을 사용하여 기록된 세션을 포함하는 사유 저장소에서 수집되었다.

데이터셋: 말하기

이 контек스트에서, 주의하지 않는 기준 중 하나는 1초 이상 말하는 경우(이 경우에는 순간적인 댓글 또는 기침일 수 있다)이다.

제어 환경에서 오디오를 기록하거나 분석하지 않으므로, 말하는 것을 시각적 입력만으로 감지하기 위해 데이터셋을 생성했다.

데이터셋: 하품

하품 데이터셋이 이미存在하지만, 저자들은 이러한 데이터셋이 광고 테스트 시나리오에 적합하지 않다고 주장한다.

따라서 저자들은 내부 컬렉션에서 735개의 비디오를 사용하여 데이터셋을 생성했다.

데이터셋: 분산

분산 데이터셋은 또한 저자의 광고 테스트 저장소에서 가져왔다.

주의 모델

제안된 주의 모델은 저수준 시각적 특징, 즉 얼굴 표정, 머리 자세, 시선 방향을 처리한다.

이러한 특징은 이후 높은 수준의 지표로 변환된다.

제안된 모니터링 시스템의 스키마.

테스트

저자들은 주의 모델의 성능을 평가하기 위해 테스트를 수행했다.

연구에서 식별된 주의하지 않는 다양한 카테고리.

저자들은 다음과 같이 말한다:

‘尽管 비면적 화면은 ‘노페이스’ 신호를 트리거하는 경우의 27%만을 구성하지만, 이는 주의하지 않는 다른 이유로 트리거되는 경우도 있다. 예를 들어, 참가자가 화면 밖을 보는 경우, 과도한 움직임을 하는 경우, 또는 물체/손으로 얼굴을 크게 가리는 경우 등이다. ‘

결론

결과는 이전 연구에 비해 측정된 nhưng 의미 있는 진전을 나타낸다.

본 연구의 깊은 가치는 시청자의 내부 상태에 접근하기 위한 지속적인 노력을 보여준다.

이 연구는 구조화된 시장 연구 설정을 넘어 확장할 수 있는 미래의 프레임워크를 향한 방향을 제시한다.

이것은 이 연구 분야의 비밀적이고 제한적인 성격에 의해 더욱 강조된다.

* 저자의 인라인 인용을 하이퍼링크로 변환.

2025년 4월 9일 처음 게시.