Anderson의 관점

2020년 인간 코드가 Large Language Models을 사용한 Vibe-Coded 에이전트를 테스트에서 제압하다

ChatGPT 및 기타 Vibe-Coding 도구가 거의 40,000번의 경기에서 테스트되었으며, Large Language Models이 발명되기 전에 작성된 대학원생 코드에 패배했다.

영국에서 수행된 새로운 연구에 따르면, 연구자들은 인간이 작성한 에이전트를 Vibe-Coding을 사용하여 개발된 에이전트와 비교했으며, 후자는 최신 Large Language Models(LLMs)을 사용하여 개발되었으며, 예를 들어 ChatGPT-5와 Claude를 사용하여 개발되었다. 연구 결과, 인간이 작성한 에이전트가 AI를 사용하지 않고 개발된 에이전트를 쉽게 이겼다.

두 집단의 에이전트는 스위스 로잔 연방 기술 연구소의 인공 지능 연구소에서 다른 세대의 학생들에 의해 생성되었다. 비 AI 에이전트는 2020년에 ChatGPT와 LLM 혁명의 시작 이전에 2년 전에 수행된 과제의 일부로 개발되었으며, 새로운 에이전트는 현재 학생들이 최신 및 최고의 LLM을 사용하여 개발하였다.

게임이 조작되어도, Vibe-Coded 솔루션은 승리할 수 없었다. 상위 5위는 일관되게 ‘원시’ 에이전트에 의해 유지되었으며, 대부분의 LLM 에이전트(33개 중 40개)는 38,304개의 도전에서 다양한 변수와 상황에서 매우 간단한 기준 에이전트에 의해 쉽게 패배했다.

이 논문은 다음과 같이 말한다:

‘우리의 연구는 최신의 LLM이 코드를 생성할 수 있지만(즉, 구문 오류가 없음), 생성된 솔루션은 전략적 계획, 최적화 또는 다중 에이전트 경쟁과 같은 차원에서 인간이 설계한 솔루션에 비해 경쟁력이 없음을 보여준다.

‘따라서, 이 연구는 코드 생성의 새로운 전선을 강조하며, 벤치마크, 데이터셋 및 오픈 소스 기준을 개발하여 추론 기반 코드 생성을 강화하는 것을 목표로 한다.’

도전은 다양한 전략을 사용하여 경매에 참여하고, 이긴 항목을 승자에게 배달하기 위한 물류를 조직하는 것이었다.

저자들은 LLM에 몇 가지 이점을 주었으며, 예를 들어 성능을 개선하기 위해 코드에 간섭하는 것이 포함되며, 2020년 코드에는 허용되지 않는다. 그러나 LLM은 그럼에도 불구하고, 결과를 개선할 수 있는 수정된 코드를 제공하거나 사용할 수 없었다:

‘[우리의] 벤치마크에서, 우리는 좋은 솔루션을 제공해도, LLM은 여전히 이를 사용할 수 없다.

‘이 결과는 또한 복잡한 시나리오에서 컨텍스트 학습 및 검색 보강 문제 해결의 한계에 대한 흥미로운 미래 연구 질문을 제기한다.’

테스트에 사용된 LLM은 GPT-5 Thinking, Gemini 2.5 Pro, Claude Opus 4.1 및 DeepSeek R1*이었다.

새로운 논문은 Vibe Coding이 대학원생 CS 학생을 이길 수 있습니까? LLM vs. 인간 코딩 토너먼트에 대한 시장 주도적 전략 계획으로 제목이 붙여졌으며, 소식통은 사우스햄프턴 대학과 옥스포드 대학 및 앨런 튜링 연구소의 한 명의 저자로부터 나왔다. 벤치마크는, 저자들은 곧 발표될 것이라고 말한다.

방법

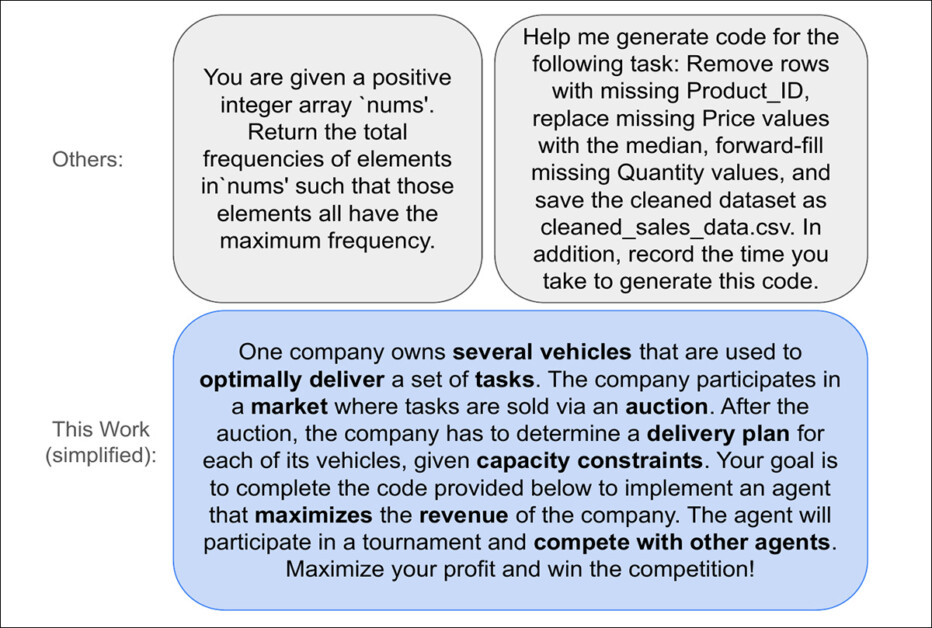

저자들은 전통적인 테스트가 일반적으로 이진 솔루션(정확한 또는 부정확한)이 명확하게 정의된 도전 과제에 중점을 둔 것으로 주장한다. 이러한 테스트는 유닛 테스트를 통해 검증된다. LLM 보조 코드의 한계를 탐구하는 이상적인 방법이 아니라는 것을 주장하면서, 저자들은 더 복잡한 도전 과제 시나리오를 설계했으며, 여러 내부 벤치마크와 里程碑이 있으며, 승리는 가능하지만 쉽지 않은 시나리오를 만들었다:

표준, 유닛 테스트 기반 접근 방식(위)과 저자가 설계한 더 개방형 도전 과제 시나리오(아래, 파란색)의 비교. 소스