인공지능

EAGLE: 다중 모드 대규모 언어 모델의 설계 공간 탐색을 위한 인코더 混合 사용

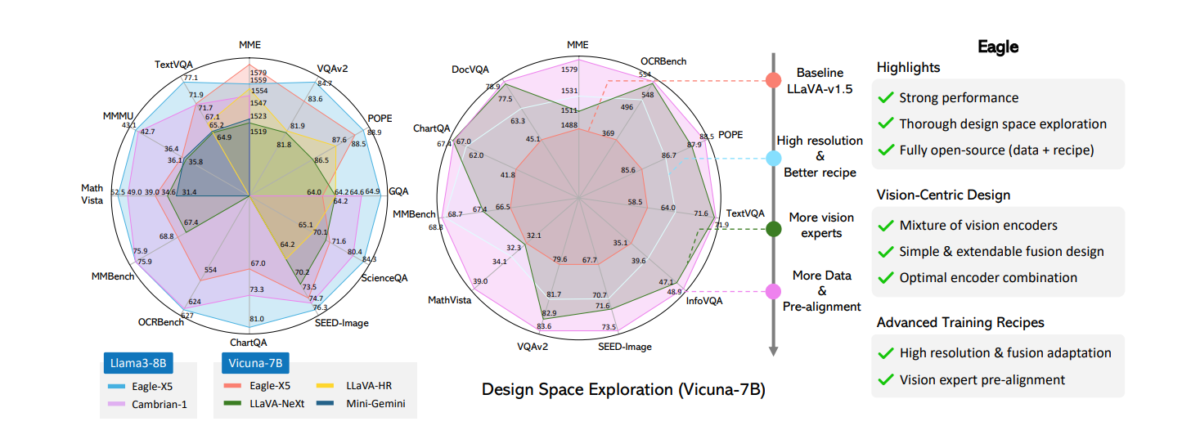

다중 모드 대규모 언어 모델(Multimodal Large Language Models, MLLMs)의 복잡한 시각 정보를 정확하게 해석하는 능력은 중요한 초점이다. 최근 연구에 따르면 향상된 시각 인식은 환각을 크게 줄이고 해상도에 민감한 작업인 광학 문자 인식(Optical Character Recognition, OCR) 및 문서 분석과 같은 작업의 성능을 개선한다. 최근의 몇몇 MLLMs는 여러 비전 인코더를 사용하여 이를 달성한다.尽管它们의 성공에도 불구하고, 비전 인코더의 전문가 선택 및 여러 비전 전문家的 통합과 같은 중요한 측면을 다루는 체계적인 비교와詳細한削除 연구는 부족하다. 본 문서에서는 비전 인코더와 해상도의 혼합을 사용하여 MLLMs의 설계 공간에 대한 광범위한 탐색을 제공하며, Eagle 프레임워크는 인코더의 혼합을 사용하여 다중 모드 대규모 언어 모델의 설계 공간을 탐색하도록 시도한다. 발견된 결과는 다양한 기존 전략에 공통적인 몇 가지 기본 원칙을 나타내며, 이는 간결하면서도 효과적인 설계 접근법으로 이어진다. Eagle는 여러 비전 인코더의 시각 토큰을 단순히 연결하는 것이 더 복잡한 混合 아키텍처 또는 전략만큼 효과적임을 발견했다. 또한, Eagle은 비전 중심 인코더와 언어 토큰 사이의 간격을 메우기 위해 Pre-Alignment을 도입하여 모델의 일관성을 향상시킨다. 결과적으로 Eagle 모델은 주요 MLLM 벤치마크에서 다른 주도적인 오픈 소스 모델을 능가한다.

Eagle의 작업은 다중 모드 대규모 언어 모델(MLLMs)의 일반적인 아키텍처 설계와 관련이 있다. 이전에 언급한 대표적인 오픈 소스 연구 외에도 다른 주목할만한 MLLM 패밀리에는 MiniGPT-4, Lynx, Otter, QwenVL, CogVLM, VILA, GPT-4V, Gemini 및 Llama 3.1이 포함된다. 비전 신호가 언어 모델에 통합되는 방식에 따라 MLLMs를 크로스 모달 어텐션 모델과 프리픽스 튜닝 모델로 나눌 수 있다. 전자는 크로스 모달 어텐션을 사용하여 언어 모델의 다양한 레이어에 시각 정보를 주입하며, 후자는 시각 토큰을 언어 토큰 시퀀스의 일부로 처리하여 직접 텍스트 임베딩에 추가한다. Eagle 모델은 LLaVA 스타일의 다중 모드 아키텍처를 따르므로 프리픽스 튜닝 패밀리이다. MLLM은 빠르게 성장하는 분야이므로 Eagle은 더 자세한 연구와 조사에 대한 참고를 권장한다.

Eagle의 작업은 MLLMs를 위한 비전 인코더 설계 개선을 중점으로 하는 연구와密接 관련이 있다. 초기 연구에서는 일반적으로 CLIP 및 EVA-CLIP과 같은 비전-언어 정렬 작업에 사전 훈련된 비전 인코더를 채택했다. 더 강력한 비전 인코더인 SigLIP 및 InternVL은 더 나은 설계, 더 큰 모델 크기 및 더 효과적인 훈련 레시피를 통해 비전-언어 작업을 개선하기 위해 제안되었다. 모델이 일반적으로 저해상도 이미지에 대해 사전 훈련되고 세부 정보를 인코딩하는 능력이 부족할 수 있으므로 더 높은 해상도 적응이 빈번하게 수행되어 MLLM 입력 해상도를 증가시킨다. 더 높은 해상도 적응 외에도 LLaVA-NeXT, LLaVA-UHD, Monkey, InternLM-XComposer 및 InternVL과 같은 모델은 이미지를 낮은 해상도의 패치로 나누고 개별적으로 처리하여 높은 해상도 입력을 처리한다. 이러한 접근 방식은 추가 비전 전문가를 도입하여 가능하지만 타일링 기술과 약간 다르지만 호환되며 결합할 수 있다.

EAGLE: 다중 모드 대규모 언어 모델을 위한 混合 인코더 설계 공간 탐색

대규모 언어 모델(Large Language Models, LLMs)의 성공은 시각 인식 능력을 가능하게 하여 실제 세계에서 볼 수 있게 하고, 이해하고, 추론할 수 있도록 하는 데 큰 관심을 불러일으켰다. 이러한 다중 모드 대규모 언어 모델(Multimodal Large Language Models, MLLMs)의核心에는 일반적으로 이미지에서 시각 토큰 시퀀스를 생성하는 비전 인코더와 텍스트 임베딩을 결합하여 언어 모델을 입력으로 사용하는 설계가 있다. CLIP은 종종 비전 인코더로 선택되며, 이는 이미지-텍스트 쌍에 대한 사전 훈련을 통해 시각적 표현이 텍스트 공간과 정렬되기 때문이다. 아키텍처, 훈련 레시피 및 비전 토큰이 언어 모델에 주입되는 방식에 따라 주목할만한 MLLM 패밀리에는 Flamingo, BLIP, PaLI, PaLM-E 및 LLaVA가 포함된다. 이러한 모델 대부분은 사전 훈련된 비전 인코더 및 LLM 시퀀스 길이의 제한으로 인해 상대적으로 낮은 입력 해상도를 유지한다. Eagle의 작업은 여러 비전 인코더를 사용하여 인식을 개선하는 모델과 밀접하게 관련이 있다.

Mini-Gemini 및 LLaVA-HR은 저해상도 비전 토큰에 고해상도 시각적 특징을 융합하는 것을 제안한다. 해상도 문제를 넘어서서, 이러한 사전 훈련된 비전 인코더는 텍스트 읽기 또는 객체 위치 지정과 같은 특정 기능이 부족할 수 있다. 이를 해결하기 위해 다양한 모델은 비전 인코더를 다양한 비전 작업에 사전 훈련하여 비전 인코더의 능력을 향상시킨다.

예를 들어, Mousi 및 Brave와 같은 모델은 다양한 비전 인코더에서 비전 토큰을 채널 또는 토큰 방향으로 연결하여 융합한다. RADIO는 여러 비전 인코더의 능력을 단일 모델로統一하기 위해 다중 교사 증류 방법을 도입한다. MoAI, IVE 및 Prismer는 OCR, 감지 또는 깊이 추정과 같은 비전 전문家的 출력을 사용하여 추가 정보를 제공한다. MoVA는 주어진 이미지 및 지침에 따라 최적의 비전 모델을 할당하기 위해 라우팅 네트워크를 설계한다.

최근 연구에 따르면 더 강력한 비전 인코더 설계는 MLLM 환각을 줄이고 해상도에 민감한 작업인 광학 문자 인식(OCR)과 같은 작업의 성능을 개선하는 데 중요하다. 몇몇 연구는 비전 인코더의 능력을 향상시키는 데 중점을 두고 있으며, 이는 사전 훈련 데이터 및 매개변수를 확대하거나 이미지를 낮은 해상도의 패치로 나누는 것과 같다. 그러나 이러한 접근 방식은 일반적으로大量의 훈련 리소스를 필요로 한다. 효율적이면서도 강력한 전략은 다른 작업과 입력 해상도에 사전 훈련된 비전 인코더를 혼합하는 것이다. 이는 CLIP 인코더와 더 높은 해상도 인코더를 융합하거나, 다른 인코더의 특징을 순차적으로 추가하거나, 다양한 인코더의 이점을 최대화하기 위해 더 복잡한 융합 및 라우팅 전략을 채택하는 것을 포함한다. 이러한 “비전 전문가 混合” 접근 방식은 효과적이지만,まだ詳細한 설계 공간 연구와 엄격한 削除 연구가 부족하다. 이는 Eagle이 이 영역을 재조사하도록 мотив한다. 주요 질문은 다음과 같다: 어떤 비전 인코더 조합을 선택해야 하는가? 어떻게 다른 전문가를 융합해야 하는가? 더 많은 비전 인코더와 함께 훈련 전략을 어떻게 조정해야 하는가?

이러한 질문에 답하기 위해 Eagle은 MLLM의 인식력을 개선하기 위한 비전 인코더 混合 설계 공간을 체계적으로 조사한다. 이 설계 공간의 탐색에는 다음 단계가 포함된다: 1) 다양한 비전 인코더의 벤치마크 테스트 및 더 높은 해상도 적응 검색; 2) 비전 인코더 융합 전략 간의 “사과와 사과” 비교; 3) 여러 비전 인코더의 최적 조합 식별; 4) 비전 전문가의 사전 정렬 및 데이터 混合 개선. 이러한 탐색 단계는 다음 이미지에 설명되어 있다.

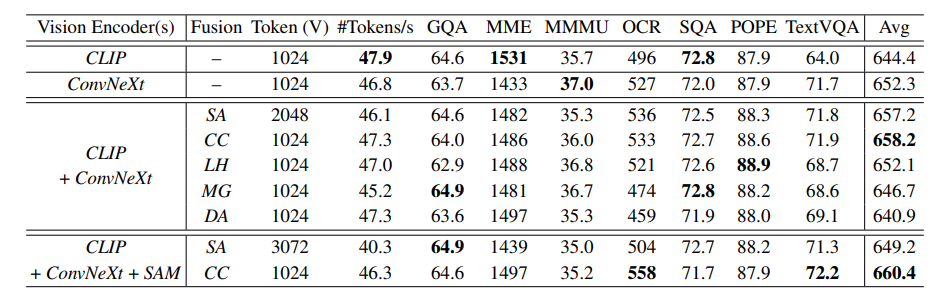

Eagle의 연구는 다양한 작업 및 해상도에 사전 훈련된 비전 인코더의 성능을 다룬다. 라운드 로빈 접근 방식을 사용하여 Eagle은 기본 CLIP 인코더에서 시작하여 각 라운드에서 가장 좋은 성능 개선을 제공하는 추가 전문가를 선택한다.

Eagle의 작업은 MLLM에서 여러 비전 인코더를 사용하는 것이 처음은 아니지만, 체계적인 연구는 다음과 같은 몇 가지 주요 발견으로 이어진다:

- 비전 인코더를 MLLM 훈련 중에 잠금 해제하는 것이 중요하다. 이는 LLaVA 및 기타 모델에서 일반적인 관행인 여러 비전 인코더 또는 교사와 함께 비전 인코더를 잠금하는 것과는 대조된다.

- 최근 제안된 몇몇 융합 전략은重大한 이점을 나타내지 않는다. 대신, 단순한 채널 연결이 효율성과 성능의 균형을 제공하는 경쟁력 있는 융합 전략으로 나타난다.

- 추가 비전 전문가를 포함하면 일관된 이익이 있다. 이는 단일 인코더를 확대하는 것 외에도 MLLM의 인식을 체계적으로 향상시키는 유망한 경로이다. 특히 비전 인코더가 잠금 해제된 경우 개선이 두드러진다.

- 사전 정렬 단계가 중요하다. Eagle은 비전 전문가가 언어 모델과 함께 훈련되기 전에 비전 전문가가 개별적으로 고정된 LLM과 함께 미세 조정되는 사전 정렬 단계를 도입한다. 이 단계는 비전 인코더 混合 설계에서 MLLM의 성능을 크게 향상시킨다.

Eagle: 방법론 및 아키텍처

이전의 방법과 달리 비전 인코더 간의 새로운 융합 전략 또는 아키텍처에 중점을 두지 않고, Eagle은 다양한 비전 인코더를 융합하기 위한 최소한의 설계를 식별하는 것을 목표로 하며, 이는詳細한 削除 연구와 불필요한 구성 요소를 제거함으로써 지원된다. 다음 그림과 같이 Eagle은 기본 CLIP 인코더를 다양한 아키텍처, 사전 훈련 작업 및 해상도를 갖는 비전 전문가 집합으로 확장한다. 이러한 전문가와 함께 Eagle은 다양한 융합 아키텍처 및 방법을 비교하고 여러 인코더와 함께 훈련 전략을 최적화하는 방법을 탐색한다.

마지막으로 Eagle은 모든 발견을 결합하고 다양한 해상도 및 도메인 지식의 여러 전문가 비전 인코더로 접근 방식을 확장한다. LLaVA-1.5와 동일한 사전 훈련 데이터(595k개의 이미지-텍스트 쌍)를 사용하여 Eagle은 감독된 미세 조정 단계로 이동하여 여러 작업에서 데이터를 수집하고 이를 다중 모드 대화로 변환한다. 이는 LLaVA-1.5, Laion-GPT4V, ShareGPT-4V, DocVQA, synDog-EN, ChartQA, DVQA 및 AI2D를 포함하며, 총 934k 샘플이 된다.

모델은 먼저 이미지-텍스트 쌍에 대해 1에포크 동안 배치 크기 256으로 사전 훈련되며, 전체 모델이 고정되고 프로젝터 레이어만 업데이트된다. 두 번째 단계에서는 모델이 감독된 미세 조정 데이터에 대해 1에포크 동안 배치 크기 128으로 미세 조정된다. 이 탐색을 위해 Eagle은 Vicuna-7B를 기본 언어 모델로 사용한다. 학습률은 첫 번째 단계에서 1e-3, 두 번째 단계에서 2e-5로 설정된다.

강력한 CLIP 인코더

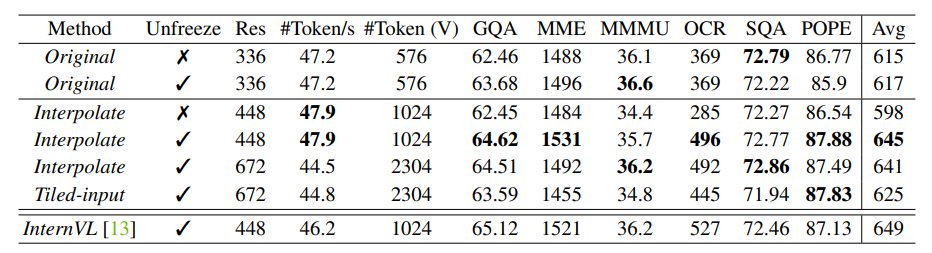

Eagle은 CLIP 모델로 탐색을 시작하며, 이는 많은 MLLM의 주요 선택이 되었다. CLIP 모델은 다중 모드 작업을 향상시키는 것으로 알려져 있지만, 그들의 제한도 잘 문서화되어 있다. 예를 들어, 많은 기존 MLLM은 CLIP의 사전 훈련된 해상도(예: 224 × 224 또는 336 × 336)를 입력 해상도로 사용한다. 이러한 경우, 인코더는 일반적으로 해상도에 민감한 작업인 OCR 및 문서 이해를 위한 세부 정보를 캡처하는 데 어려움을 겪는다.

입력 해상도를 증가시키기 위해 일반적인 접근 방식은 타일링이며, 입력 이미지를 타일로 나누고 개별적으로 인코딩한다. 더 간단한 방법은 입력 해상도를 직접 확대하고 필요한 경우 비전 트랜스포머 모델의 위치 임베딩을 보간하는 것이다. Eagle은 이러한 두 접근 방식을 다양한 해상도에서 고정 및 비고정 비전 인코더와 비교하며, 결과는 위의 표에 포함되어 있다. 발견은 다음과 같이 요약될 수 있다:

- CLIP 인코더를 잠금 해제하면 CLIP의 사전 훈련 해상도와 다른 더 높은 MLLM 입력 해상도로 보간할 때重大한 개선이 나타나며, 해상도가 동일한 경우 성능이 저하되지 않는다.

- 비전 인코더를 고정하고 직접 더 높은 MLLM 입력 해상도로 적응시키면 성능이 크게 저하된다.

- 비교된 전략 중에서 잠금 해제된 CLIP 인코더와 함께 448 × 448으로 직접 보간하는 것이 성능과 비용의 균형에서 효과적이고 효율적임을 입증한다.

- 최상의 CLIP 인코더는 InternVL과 비슷한 성능을 달성하며, 이는 훨씬 더 작은 모델(300M 대 6B)이며 더 적은 사전 훈련 데이터를 사용한다.

CLIP-448을 사용하면 Eagle은 LLaVA-HR 및 InternVL의 설정과 일치시킬 수 있으며, 여기서 CLIP 인코더도 448 × 448 입력을 받고 1024 패치 토큰을 출력하도록 적응된다. 추가 조사를 위해 Eagle은 단순한 입력 해상도를 확대하고 훈련 중에 비전 인코더를 잠금 해제하는 전략을 따른다.

Eagle은 기존 인기 있는 융합 전략이尽管 설계 변형에도 불구하고 다음과 같이 범주화될 수 있음을 관찰한다:

- 시퀀스追加: 다른 백본에서 비전 토큰을 더 긴 시퀀스로 직접追加한다.

- 채널 연결: 비전 토큰을 채널 차원으로 연결하여 시퀀스 길이를 증가시키지 않는다.

- LLaVA-HR: 저해상도 비전 인코더에 고해상도 특징을 삽입하는 混合 해상도 어댑터를 사용한다.

- Mini-Gemini: 저해상도 쿼리として CLIP 토큰을 사용하여 고해상도 비전 인코더에 공동 위치한 로컬 윈도우에서 크로스 어텐션한다.

- 변형 어텐션: Mini-Gemini 위에 도입된 새로운 기준선으로, 바니라 윈도우 어텐션이 변형 어텐션으로 대체된다.

LLaVA의 원래 사전 훈련 전략에서와 같이 여러 비전 전문가를同時에 정렬하는 프로젝터를 훈련하는 대신, Eagle은 먼저 각 개별 전문가의 표현을 더 작은 언어 모델(Vicuna-7B 사용)과 다음 토큰 예측监督을 사용하여 정렬한다. 다음 그림과 같이 사전 정렬을 사용하면 전체 훈련 과정은 3단계로 구성된다: 1) 각 사전 훈련된 비전 전문가를 자신의 프로젝터와 함께 고정된 언어 모델로 SFT 데이터에 대해 훈련한다; 2) 첫 번째 단계에서 모든 비전 전문가를 결합하고 이미지-텍스트 쌍 데이터로 프로젝터만을 훈련한다; 3) 전체 모델을 SFT 데이터에 대해 훈련한다.

Eagle: 실험 및 결과

전략을 신중하게 개발한 후, Eagle은 다음과 같은 원칙을 모델에 설정했다: (1) 최적화된 훈련 레시피와 함께 더 많은 비전 전문가를 통합한다; (2) 여러 비전 전문가를 직접 채널 연결을 통해 결합한다; (3) 비전 전문가를 개별적으로 사전 정렬을 통해 사전 훈련한다. 이 섹션에서는 Eagle 모델의 이점을 추가로 демон스트레이션하기 위해, 추가 훈련 데이터를 통합하고 Eagle을 다양한 작업에서 최신 상태의 MLLM과 비교한다. Eagle은 Vicuna-v1.5-7B, Llama3-8B 및 Vicuna-v1.5-13B를 언어 모델로 사용한다. 비전 인코더의 경우 섹션 2.6의 결과에 따라 Eagle 모델은 Eagle-X4로 표시되며, 이는 CLIP, ConvNeXt, Pix2Struct 및 EVA-02의 4개의 비전 인코더를 포함한다. Eagle-X5는 추가 SAM 비전 인코더를 포함한다.

시각적 질문 답변 작업

Eagle은 세 가지 시각적 질문 답변 벤치마크(GQA, VQAv2 및 VizWiz)를 통해 모델 시리즈를 비교한다. 다음 표와 같이 Eagle-X5는 GQA 및 VQAv2에서 최첨단 성능을 달성하여 추가 비전 전문가 통합의 이점을 강조한다.

OCR 및 차트 이해 작업

Eagle의 OCR, 문서 및 차트 이해 능력을 평가하기 위해 모델은 OCRBench, TextVQA 및 ChartQA에서 벤치마크된다. 위의 표와 같이 Eagle은 TextVQA에서 경쟁자를 크게 능가하며, 이는 고해상도 아키텍처와 다양한 비전 인코더의 통합으로 인한 것이다. 특히 Eagle은 복잡한 타일 분할 없이 최대 1024개의 토큰을 지원한다.

다음 그림은 OCR 및 문서 이해 사례의 예를 보여준다. 고해상도 적응 및 더 많은 비전 전문家的 통합으로 인해 Eagle은 이미지 내의 작은 텍스트를 식별하고 사용자 지침에 따라 정보를 정확하게 추출할 수 있다.

다양한 비전 작업에 사전 훈련된 추가 비전 전문가를 도입하는 이점을 더 잘 이해하기 위해, 다음 그림은 ConvNeXt 및 CLIP 비전 인코더만 있는 모델의 결과와 Eagle-X5의 결과를 시각화한다. 전체 비전 인코더 세트를 사용하면 모델은 오류를 성공적으로 수정하며, 이는 고해상도 비전 인코더가 사전 훈련된 경우에도 다양한 비전 작업에 사전 훈련된 추가 비전 전문家的 통합이 Eagle의 능력을 더욱 향상시킴을 보여준다.

다중 모드 벤치마크 평가

Eagle은 MLLM의 다양한 관점에서 능력을 보여주기 위해 7개의 벤치마크에서 평가된다. 이는 MME, MMBench, SEED, MathVista, MMMU, ScienceQA 및 POPE를 포함한다. 특히 MME, MMBench 및 SEED는 다양한 실제 작업에 대한 전체 성능을 평가한다. MMMU는 대학 수준의 지식을 요구하는 다양한 도메인의 도전적인 문제에 중점을 둔다. POPE는 MLLM의 시각적 환각을 평가한다. 이 평가에서 사용되는 메트릭은 이러한 벤치마크의 기본 설정에 따라 설정된다. Eagle은 MME의 인식 점수, MMBench의 en_dev 분할, SEED의 이미지 분할, MathVista의 테스트 미니 분할, MMMU의 val 분할, POPE의 F1 점수 및 ScienceQA의 이미지 점수를 보고하며, 이는 다른 모델에서 보고된 점수와 일치한다.

최종 생각

이 문서에서 우리는 다중 모드 대규모 언어 모델의 설계 공간 탐색에 대한 심층 분석인 Eagle에 대해 논의했다. 이전의 연구와 달리 새로운 융합 패러다임 설계에 중점을 두지 않고, Eagle은 체계적인 설계 선택이 중요하다는 것을 발견하며, 유용한 여러 기술을 발견한다. Eagle은 비전 인코더의 훈련 레시피를 최적화하고, 확장 가능하고 효율적인 융합 방법을 식별하며, 다양한 비전 인코더를渐進적으로 결합한다. 결과는 기본적인 설계 공간 고려의 중요성을 강조한다.