Anderson의 관점

AI 개발에 향을 가져다주는 것

새로운 AI 데이터셋은 기계가 냄새를 맡을 수 있도록 냄새 데이터를 이미지와 연관시켜 모델이 냄새를 객체, 장면, 재료와 일치시킬 수 있도록 합니다.

아마도 냄새 출력 기계가 그렇게 복잡한 역사를 가지고 있는 이유로, 후각은 AI 연구 문헌에서 비교적 소홀한 감각입니다. 냄새 비전 사가의 또 다른 엔트리를 제작하려는 경우를 제외하고, 이미지, 오디오 및 비디오 데이터셋과 그로부터 훈련된 AI 모델의 잠재적 활용에 비해 사용 사례는 항상 비교적 ‘니치’로 보였습니다.

실제로, 폭탄 탐지犬, 시체 탐지犬, 질병 감지犬 및 다양한 유형의 개 탐지 장치를 제공하는 시설의 자동화, 산업화 및 대중화를 가능하게 하는 것은 도시 및 보안 서비스에서 주목할만한 이점이 될 것입니다. 높은 수요에도 불구하고, 공급보다 훨씬 많은 공급이 있습니다. 탐지견의 훈련 및 유지 보수는 비싼 사업이며 항상 좋은 가치가 아닙니다.

지금까지 이 연구 분야에 대한 대부분의 연구는 실험실에서 수행되었으며, 일반적으로 수작업으로 제작된 기능을 갖춘 큐레이션된 컬렉션으로 구성되었습니다. 이것은 산업용 솔루션보다 수작업 코티지 산업 솔루션에 더 적합한 프로필입니다.

코 앞서기

이 다소 구식인 분위기에서 미국의 학계와 산업계의 협력을 통해 새로운 협력이 등장했습니다. 여기서 연구자들은 뉴욕시의 실내 및 실외 환경에서 다양한 냄새를 수개월 동안 카탈로그화하고, 처음으로 관련된 냄새와 함께 이미지 데이터를 수집했습니다:

중앙 센서, 즉 냄새 장치의 ‘코’를 참조하십시오. 냄새만으로 훈련된 모델은 그라니트, 플라스틱, 가죽인지 판단하고, 단 하나의 픽셀도 보지 못한 채 방을 식별합니다. 출처

이 연구는 새로운 작업의 저자들이 대중적으로 인기 있는 Contrastive Language-Image Pretraining (CLIP) 프레임워크의 변형을 고안하도록 이끌었습니다. 즉, Contrastive Olfaction-Image Pretraining (COIP)으로, 이는 냄새와 이미지를 연결합니다.

상단: 동기화된 비디오 및 냄새 센서 데이터는 자연 환경에서 카메라-e-코 장치를 사용하여 캡처됩니다. 하단 왼쪽(b): 교차 모달 자체 감독을 통해 공동 임베딩이 학습됩니다. (c): 시스템은 오직 냄새 질의에 따라 시각적 일치를 검색합니다. (d): 개별 냄새 샘플은 환경, 객체 및 재료 카테고리를 분류하는 데 사용됩니다. (e): 시각적 입력 없이 두 가지 유형의 풀과 같은 매우 유사한 냄새를 구별합니다. 출처

새로운 데이터셋인 뉴욕 냄새에는 7,000개의 냄새-이미지 페어링이 포함되어 있으며, 3,500개의 서로 다른 객체를 특징으로 합니다. 테스트에서 훈련된 새로운 데이터는 상대적으로 작은 수의 유사한 이전 데이터셋에서 인기 있는 수작업 기능을 능가하는 것으로 나타났습니다.

저자들은 초기 아웃팅이 야생에서 작동하는 냄새 감지 시스템을 위한 후속 연구를 위한 길을 열어줄 것으로 기대합니다. 즉, 탐지견이 하는 것과 마찬가지로:

‘우리는 이 데이터셋을 야생의 다중 모달 냄새 인식 및 시각과 냄새를 연결하는 단계로 간주합니다.

‘예를 들어, 인간으로서 우리는 끊임없이 우리의 냄새 감각을 사용하여 음식의 품질을 평가하고, 위험을 식별하고, 보이지 않는 물체를 감지합니다.

‘또한 많은 동물, 즉 개, 곰, 쥐는 초인적인 냄새 능력을 보여주므로 기계의 냄새 감지 능력은 인간의 한계에 근접하지 못합니다.’

새로운 논문에서 뉴욕 냄새: 냄새를 위한 대규모 다중 모달 데이터셋이 약속하듯이 데이터와 코드가 공개될 예정이며, 27GB 데이터 파일은 이미 논문의 프로젝트 사이트를 통해 사용할 수 있습니다. 이 논문은 Columbia University, Cornell University, Osmo Labs의 9명의 연구자에 의해 제작되었습니다.

방법

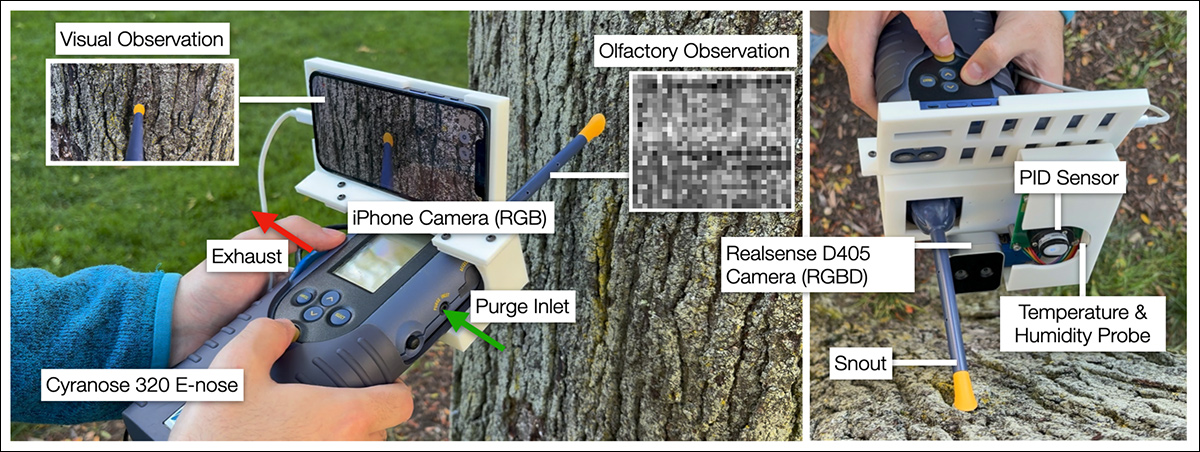

새로운 컬렉션을 수집하기 위해 연구자들은 Cyranose 320 전자 코를 사용했으며, 전방 흡입구 위에 iPhone을 장착하여 등록된 냄새를 시각적으로 캡처했습니다:

휴대용 센서 리그는 카메라-e-코 장치를 사용하여 자연 환경에서 페어링된 비디오 및 냄새 데이터를 수집합니다. 코는 물체를 향하고, 배기 및 퍼지 인렛은 샘플링 중 공기 흐름을 관리합니다. RGB-D 카메라는 깊이를 캡처하고, 휘발성 유기 화합물(VOC) 농도, 온도 및 습도는 프로포셔널-적분-미분(PID) 모듈 및 환경 프로브를 포함한 통합 센서를 통해 기록됩니다.

Cyranose 장치는 2Hz에서 작동하며, 32차원 냄새 시간 단계를 기록합니다. 휘발성 유기 화합물(VOC) 농도는 MiniPID2 PPM WR 센서로 기록됩니다.

휴대용 유닛은 더 컴퓨팅이 가능한 모바일 스테이션으로 데이터를 릴레이하는 날렵한 센서로 작동했습니다.

목표 냄새를 컨텍스트에 넣기 위해 ‘베이스라인 냄새’가 등록되었습니다. 그런 다음 더 구체적인 객체를 Cyranose의 ‘코’로 직접 대상화했습니다. 주변 샘플은 유닛의 측면 포트에서 취하여 주요 냄새 원천에서 오염되지 않도록 충분히 떨어진 위치에서 취했습니다.

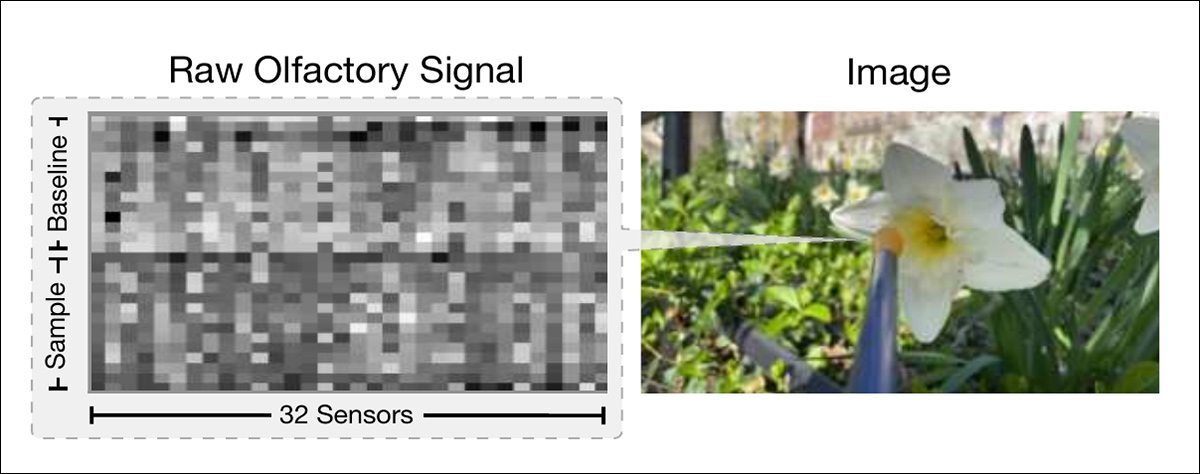

두 샘플은 센서의 주요 흡입구를 통해 취하여 각 10초 녹음이 객체 주변의 다른 위치에서 캡처되도록 하여 데이터 효율성을 개선했습니다. 샘플은 entonces 베이스라인과 결합되어 28×32 행렬을 형성하여 전체 냄새 측정을 나타냅니다:

이 예에서는 꽃에 대한 신호와 해당 이미지를 보여줍니다. 전체 냄새 신호는 14프레임의 대기 기준선과 객체 주변의 두 가지 위치에서 취한 두 개의 10초 샘플을 결합한 28×32 행렬로 구성됩니다.

데이터 및 테스트

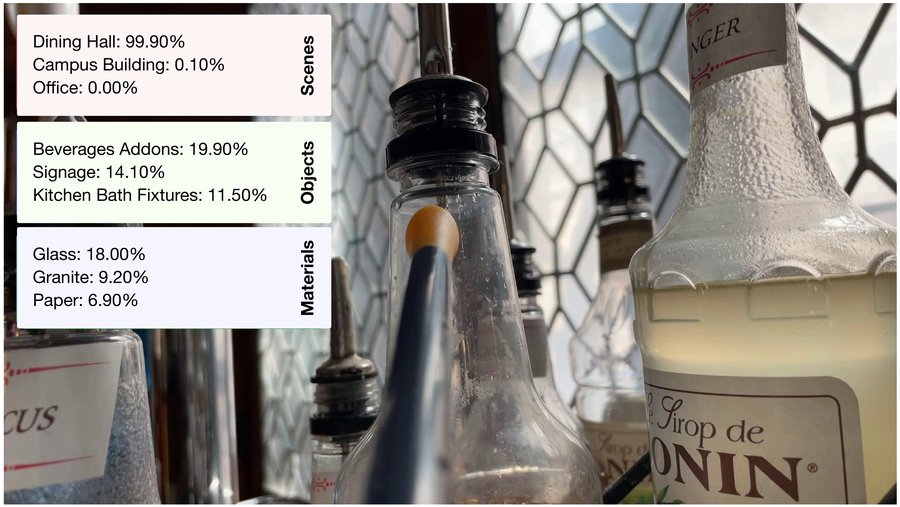

비전 언어 모델(VLM)은 자동으로 iPhone에 의해 캡처된 객체와 재료를 레이블링하기 위해 사용되었습니다. GPT-4o는 이 작업에 사용되었습니다. 그러나 장면 카테고리는 수동으로 레이블링되었습니다:

프로젝트에서 캡처된 다양한 냄새 원천과 환경을 자세히 설명하는 원본 논문에 포함된 광범위한 일러스트레이션의 작은 샘플입니다.

데이터셋은 훈련 및 검증 분할로 나누어졌습니다. 각 객체의 샘플은 동일한 분할에 할당되어 교차 오염을 방지했습니다. 최종 컬렉션에는 7,000개의 냄새-시각 페어링이 포함되어 있으며, 3,500개의 레이블이 없는 객체와 함께 70시간의 비디오 및 196,000개의 원시 냄새 시간 단계가 있습니다.

2개월 동안 60회의 세션에서 데이터가 수집되었으며, 공원, 대학 건물, 사무실, 거리, 도서관, 아파트, 식당 등 다양한 장소에서 수집되었습니다. 각 위치에서 여러 세션이 수행되었습니다. 결과 데이터셋에는 41%의 야외 환경과 59%의 실내 환경이 포함되어 있습니다.

일반적인 목적의 냄새 표현을 개발하기 위해 저자들은 공유된 표현 공간에서 동기화된 이미지-냄새 페어를 연관시키는 대조 모델을 훈련했습니다. 이 접근 방식은 앞서 언급한 COIP이며, CLIP에서 uyarlanan 손실 함수를 사용하여 공존하는 시각적 및 냄새 신호의 임베딩을 정렬합니다.

훈련에는 시각적 인코더와 냄새 인코더가 사용되었으며, 모델이 일치하는 냄새와 이미지를 공유된 표현 공간에서 더 가까이 가져오도록 가르치는 것이 목표였습니다. 결과적인 표현은 냄새-이미지 검색, 장면 및 객체 인식, 재료 분류 및 세부적인 냄새 차별화와 같은 다양한 다운스트림 작업을 지원합니다.

모델은 두 가지 유형의 냄새 입력을 사용하여 훈련되었습니다. 원시 냄새 신호와 냄새 인쇄와 같은 축소된 수작업 요약입니다. 후자는 냄새 연구에서 널리 사용되는 기능으로, 각 센서의 응답을 하나의 숫자로 압축하여 샘플링 중 피크 저항과 대기 기준선의 평균 저항을 비교합니다.

원시 입력은 뉴욕 전역에서 기록되었으며, 32개의 화학 센서에서 시간에 따라 기록된 시간 시리즈로 구성되며, 각 센서의 전기 저항이 냄새에 반응하여 어떻게 변경되는지 캡처합니다.

데이터셋의 큐레이션을 위해 이 처리되지 않은 신호는 직접 신경망에 피드되며, 수작업 기능과 비교하여 원시 냄새 신호 또는 감소된 요약을 사용하여 끝에서 끝까지 학습을 허용했습니다. 모델은 원시 입력과 뉴욕시의 다양한 환경에서 수집된 냄새 인쇄로 훈련되었으며, 두 입력 유형은 모두 대조 학습을 사용하여 평가되었습니다.

교차 모달 검색

교차 모달 검색은 각 냄새 샘플과 그에 대응하는 이미지를 공유된 표현 공간에 임베딩하고, 오직 냄새 입력만으로 올바른 이미지를 검색할 수 있는지 테스트함으로써 평가되었습니다.

랭킹은 이미지 임베딩과 쿼리 냄새의 근접성에 의해 결정되었으며, 성능은 평균 랭크, 중앙값 랭크 및 리콜을 사용하여 측정되었습니다:

다양한 냄새 인코더에 대한 교차 모달 검색 정확도, 즉 각 모델이 냄새 질의에서 올바른 이미지를 식별하는 정도를 보여주는 결과입니다. 원시 냄새 신호와 냄새 인쇄를 사용하여 훈련된 아키텍처의 결과를 비교합니다.

이 결과에 대해 저자들은 다음과 같이 말합니다:

‘대조적 전처리에서 냄새 인쇄를 사용하면 모든 메트릭에서 우연에 비해 더 나은 성능을 보여줍니다. 그러나 원시 냄새 신호에 대한 냄새 인코더를 훈련하면 아키텍처에 관계없이 냄새 인쇄 인코더보다 상당한 개선이 이루어집니다.

‘이것은 원시 냄새 데이터에 있는 더 풍부한 정보를 보여주며, 시각과 냄새 사이에 더 강한 교차 모달 연관성을 잠금으로 해제합니다.’

원본 논문에 포함된 일곱 번째 일러스트레이션의 세부 사항입니다. 여기서 모델이 냄새와 일치하는 이미지를 연결하는 예가 표시됩니다. 각 행은 냄새 질의로 시작하며, 공유된 임베딩 공간에서 상위 순위 이미지 예측이 표시됩니다. 각 질의에 대한 올바른 이미지는 녹색으로 표시되어, 책, 식물, 조적물 및 기타 재료의 냄새가 시각적 및 의미적으로 관련된 장면으로 모델을 끌어당기는 방식을 보여줍니다.

저자들은 또한 검색 결과가 명확한 의미적 패턴을 보인다고 주목합니다:

‘검색 결과는 종종 의미적 그룹화를 나타냅니다. 책의 냄새는 다른 책의 이미지를 검색하고, 잎의 냄새는 잎의 이미지를 검색합니다.

‘이 결과는 학습된 표현이 의미 있는 교차 모달 구조를 캡처한다는 것을 시사합니다.’

장면, 객체 및 재료 인식

오직 냄새 입력만으로 냄새를 인식하는 모델의 능력은 장면, 객체 및 재료를 식별하는 데 사용되었습니다. 이를 위해 냄새 신호만을 사용하여 분류를 평가하기 위해 선형 프로브(동결된 표현에 훈련된 간단한 분류기)를 사용했습니다.

레이블은 훈련 세트의 페어링된 이미지에서 GPT-4o를 사용하여 파생되었습니다. 그러나 분류 중에는 오직 냄새 신호만을 사용했습니다.

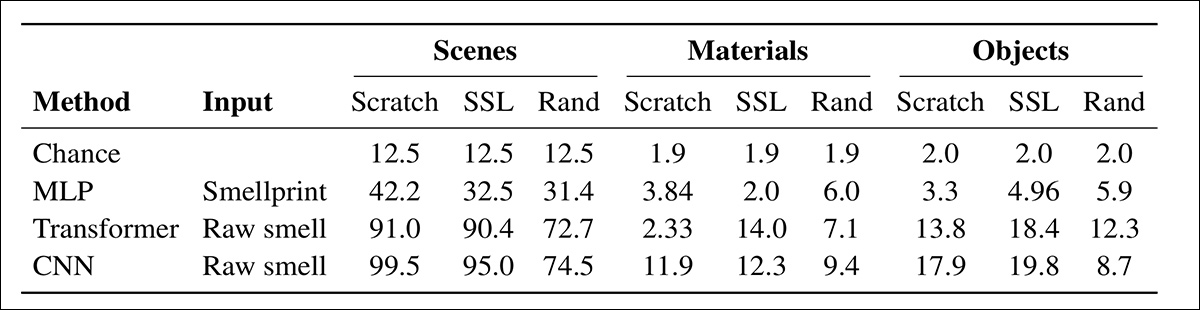

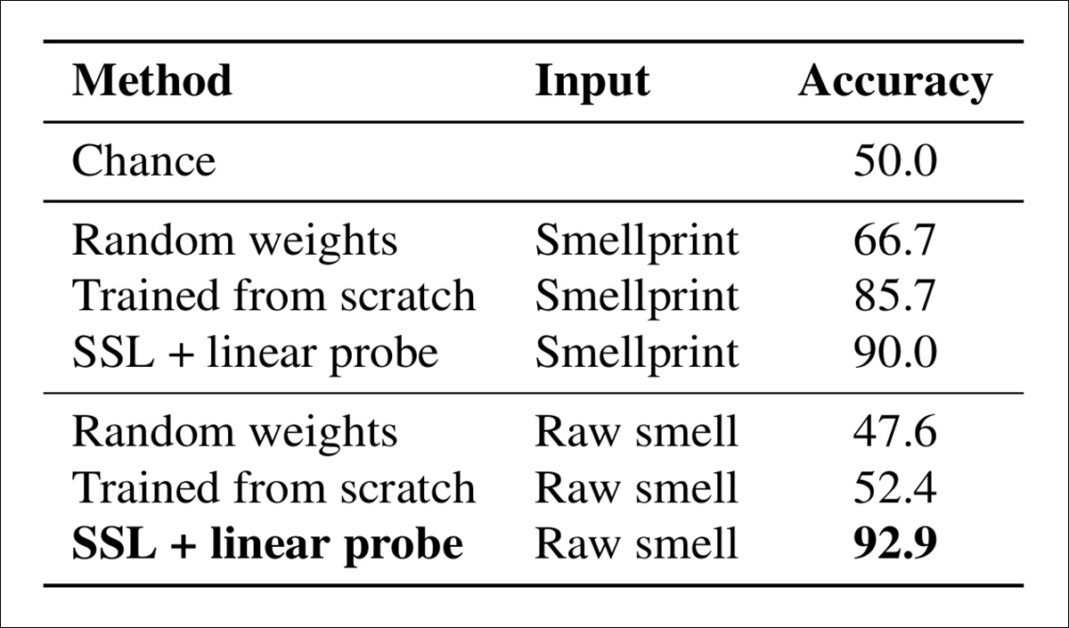

여러 유형의 인코더가 테스트되었습니다. 일부는 임의로 초기화되었으며, 일부는 처음부터 훈련되었으며, 일부는 냄새와 시각을 공유된 표현 공간에서 정렬하기 위해 대조 학습을 사용하여 훈련되었습니다. 원시 데이터와 냄새 인쇄가 평가되었습니다:

오직 냄새 신호만을 사용하여 장면, 재료 및 객체의 분류 정확도가 평가되었습니다. 원시 센서 입력은 냄새 인쇄를 능가하며, 처음부터 훈련된 CNN이最高의 결과를 보여주었습니다. 여기에는 장면에서 99.5%의 정확도가 포함됩니다. SSL 전처리는 일부 경우에 도움이 되었지만 일반적으로 지도 학습에 의해 능가되었습니다. 임의 가중치 기준선은 모델 용량만으로는 불충분함을 나타냅니다.

원시 냄새 데이터를 사용하면 특히 교차 모달 감독을 사용하여 훈련된 모델에서 훨씬 더 높은 정확도가 얻어졌습니다. 저자들은 다음과 같이 말합니다:

‘원시 센서 입력으로 훈련된 모델도 수작업 기능인 냄새 인쇄를 사용하여 훈련된 모델보다 더 높은 정확도를 달성합니다. 이러한 결과는 원시 냄새 신호에서 깊은 학습이 수작업 기능보다 훨씬 더 나은 것을 보여줍니다.’

세부적인 차별화

세부적인 냄새 구분을 학습할 수 있는지 평가하기 위해, 같은 대학 법정에 공존하는 두 가지 풀 종에서 벤치마크가 구축되었습니다. 6개의 30분 세션 동안 교대로 샘플이 수집되어 256개의 예가 생성되었습니다. 선형 분류기가 냄새-시각 대조 학습의 기능에 훈련되었으며, 42개의 샘플로 구성된 보류 세트에서 평가되었습니다:

오직 냄새 입력만을 사용하여 풀 종 분류의 정확도입니다. 모델은 두 가지 유형의 풀을 구별하는 데 사용되었습니다. 성능은 냄새 인쇄와 원시 센서 데이터를 사용하여 비교되었으며, 모델은 임의로 초기화되었거나 처음부터 훈련되었거나 SSL을 사용하여 훈련되었습니다. 최고의 정확도는 92.9%로, 원시 냄새 신호와 SSL을 사용하여 달성되었습니다. 이는 원시 입력과 시각적 지시에 의해 훈련이 세부적인 냄새 차이를 가장 잘 캡처한다는 것을 나타냅니다.

여기서 연구자들은 다음과 같이 말합니다:

‘원시 냄새 센서 신호(수작업 기능 대신)를 훈련하면 모든 변형에서 냄새 인쇄를 사용하는 것보다 더 높은 정확도를 달성합니다.

‘이 결과는 시각적 지시가 제공하는 신호를 사용하여 냄새-시각 학습이 더 세부적인 정보를 보존한다는 것을 시사합니다.’

결론

냄새 합성이 미래에 어느 정도 동안은 풀리지 않는 문제로 남아 있을 가능성이 있지만, 야생에서 작동하는 효과적이고 경제적인 냄새 분석 시스템은 경찰, 보안 및 의료 목적을 넘어 삶의 질 및 도시 모니터링을 위한巨大한 잠재력을 가지고 있습니다.

현재 장비는 일반적으로 비싸고 니치한 것으로 여겨지기 때문에, 탐지 목적으로 ‘olfactory AI’의 실제 진행은 라즈베리 파이 정신의 비전과 경제적인 센서가 필요할 것입니다.

* 저자의 인라인 인용문을 하이퍼링크로 변환한 것입니다.

** 원본 논문에 포함된 추가 일러스트레이션이 있습니다. 그러나 여기서 의미 있게 재현하기에는 너무 축소되어 있습니다.

2025년 11월 28일 금요일에 처음 게시되었습니다.