인공지능

하이퍼스케일 AI 데이터셋이 인터넷 자체보다 더 나쁠까?

아일랜드, 영국, 미국의 연구자들은 하이퍼스케일 AI 훈련 데이터셋의 성장이 인터넷의 최악의 측면을 전파할 위험이 있다고 경고했다. 최근에 발표된 학술 데이터셋에는 ‘강간, 음란물, 악의적 인 성별 고정관념, 인종차별적이고 민족적 욕설 및 기타 극단적으로 문제가 있는 콘텐츠와 같은 문제가 있는 이미지와 텍스트 쌍’이 포함되어 있다.

연구자들은 새로운 대규모 미수정 또는 잘못 필터링된 다중 모달(예: 이미지 및 이미지) 데이터셋이 부정적인 콘텐츠의 영향을 강화하는 능력에서 더 유해하다고 주장한다. 이러한 데이터셋은 사용자 불만, 지역 모더레이션 또는 알고리즘을 통해 온라인 플랫폼에서 삭제된 이미지 및 기타 콘텐츠를 보존하기 때문이다.

그들은 또한 ImageNet 데이터셋의 경우 10년이 걸릴 수 있는 오랜 시간이 경과한 후에야 데이터셋 콘텐츠에 대한 오랜 불만이 해결될 수 있으며 이러한 후속 수정은 새로 생성된 데이터셋에 반영되지 않을 수 있다고 관찰한다.

논문은 다중 모달 데이터셋: 여성혐오, 음란물, 악성 고정관념이라는 제목으로 University College Dublin & Lero, 에딘버러 대학교, UnifyID 인증 플랫폼의 수석 과학자 등의 연구자들에 의해 발표되었다.

연구는 최근에 발표된 CLIP 필터링된 LAION-400M 데이터셋에 초점을 맞추고 있지만, 연구자들은 GPT-3와 같은 기계 학습 프레임워크에 점점 더 많은 데이터를 제공하는 일반적인 경향에 대해 논쟁을 벌이고 있다. 그들은 결과 중심의 접근 방식이 잘못된 데이터 소스를 사용하여 무단으로 저작권을 무시하고, 피해를 유발하며, 불법 데이터를 퍼트리고, 실제로 이러한 데이터의 도덕적 모델을 다운스트림 AI 구현에 통합할 수 있다고 주장한다.

LAION-400M

지난 달, LAION-400M 데이터셋이 출시되어 Common Crawl 저장소에 의존하는 다중 모달 언어 데이터셋의 수가 증가했다. 이 저장소는 인터넷을 무차별적으로 스크레이핑하고 필터링 및 큐레이션의 책임을 사용하는 프로젝트에 넘긴다. 파생된 데이터셋에는 4억 개의 텍스트/이미지 쌍이 포함되어 있다.

LAION-400M은 2021년 3월에 출시된 Google AI의 폐쇄형 WIT(웹 이미지 텍스트) 데이터셋의 오픈 소스 변형으로, 텍스트-이미지 쌍을 특징으로 한다. 여기서 데이터베이스의 이미지에 대한 сопровождacente 텍스트(예: 웹 갤러리의 이미지의 alt 텍스트)가 연결된다. 이것은 사용자가 텍스트 기반 이미지 검색을 수행할 수 있도록 허용하여 이러한 도메인(예: ‘동물’, ‘자전거’, ‘사람’, ‘남자’, ‘여자’)에 대한 기본 AI가 형성한 연관성을 보여준다.

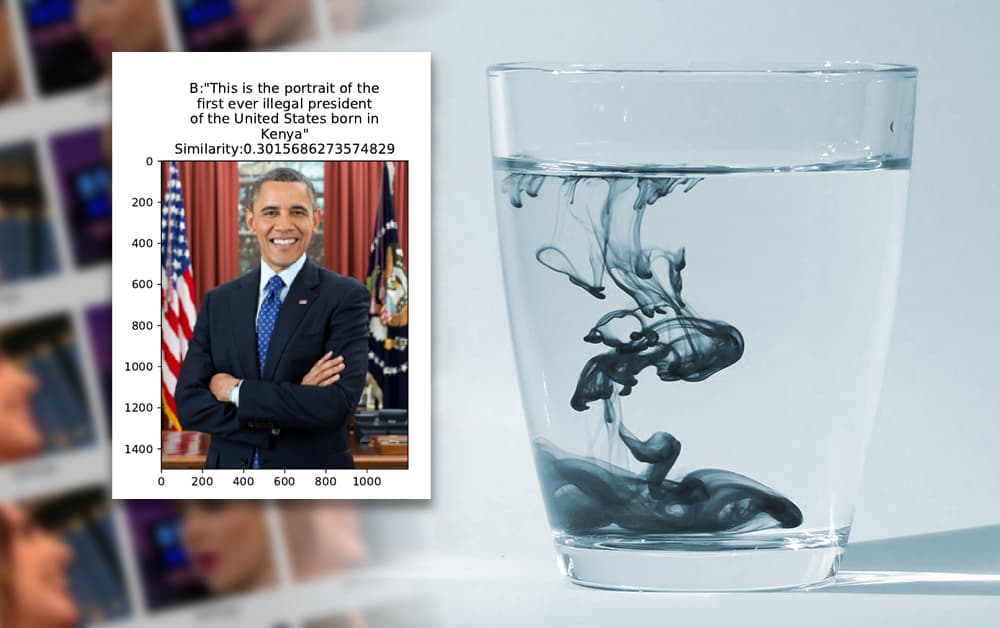

이미지와 텍스트 간의 관계 및 쿼리 결과에 편향을 삽입할 수 있는 코사인 유사성은 논문의 개선된 방법론에 대한 호출의 핵심이다. 매우 간단한 LAION-400M 데이터베이스 쿼리도 편향을 드러낼 수 있다.

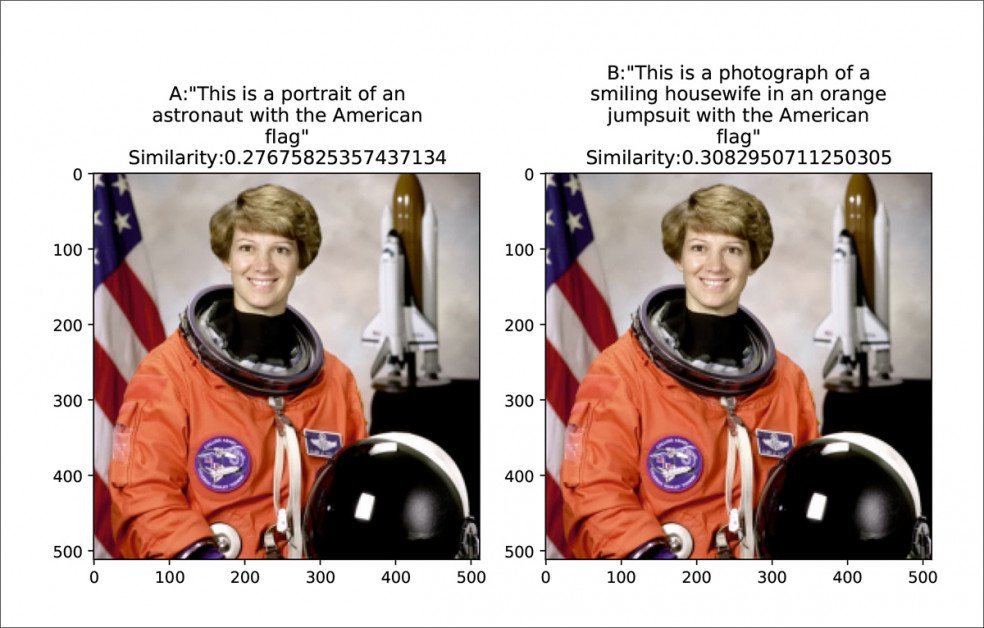

예를 들어, scitkit-image 라이브러리의 개척적인 여성 우주 비행사 Eileen Collins의 이미지는 LAION-400M에서 두 개의 관련 캡션을 검색한다: ‘이것은 미국 국기와 함께 우주 비행사의 초상화입니다’ 및 ‘이것은 오렌지 점프수트와 미국 국기와 함께 미소 짓는 주부의 사진입니다’.

미국 우주 비행사 Eileen Collins는 LAION-400M에서 그녀의 업적에 대해 매우 다른 두 가지 해석을 받습니다. 출처: https://arxiv.org/pdf/2110.01963.pdf

각 캡션이 적용될 가능성이 높은 것으로 나타나는 보고된 코사인 유사성은 매우 가깝다. 연구자들은 이러한 근접성이 LAION-400M을 사용하는 AI 시스템이 어느 쪽 캡션도 적절한 캡션으로 제시할 가능성이 상대적으로 높을 것이라고 주장한다.

포르노그래피가 다시 최고로 올라옵니다

LAION-400M에는 검색 가능한 인터페이스가 사용할 수 있다는데, ‘안전 검색’ 버튼을 해제하면 레이블 및 클래스에서 포르노그래픽 이미지 및 텍스트 연관성이 지배하는 정도가 나타난다. 예를 들어, 데이터베이스에서 수녀(안전 모드 해제 시 성인 콘텐츠 포함)를 검색하면 결과는 주로 공포, 코스프레 및 의상과 관련이 있으며 실제 수녀는 거의 없다.

안전 모드를 끄면 검색 결과에 관련된 포르노그래픽 이미지가 나타나며 비포르노 이미지는 검색 결과 페이지 하단으로 밀려난다. 이는 LAION-400M이 ‘수녀’라는 용어에 대한 포르노 이미지에 더 높은 가중치를 부여했음을 보여준다.

온라인 검색 인터페이스의 기본 안전 모드 활성화는 사용자 인터페이스 특성으로, 필터로 작동하며 필터는 항상 활성화되지 않을 수 있으며, AI 시스템에서 필터링되지 않은 결과를 나타낼 수 있다.

논문에는 다양한 검색 용어에 대한 모자이크 처리된 예제가 부록에 포함되어 있지만, 연구자들은 이러한 이미지와 관련된 언어로 인해 그들을 검토하고 모자이크 처리하는 것이 얼마나 어려웠는지에 대해 언급한다. 또한 대규모 데이터베이스의 인간 감시를 위한 큐레이션의 어려움을 인정한다:

‘우리는(또한 우리를 돕는 동료들 тоже) 데이터셋을 조사하는 과정에서 불쾌감, 구역질, 두통을 경험했다. 또한 이러한 작업은 학술 AI 영역에서 공개 후重大한 비판을 받을 수 있으며, 이는 이미 어려운 작업에 추가적인 감정적 부담을 주며, tương lai의 유사한 연구를 억제하여 AI 분야와 사회 전체에 손해를 끼친다.’

연구자들은 인간 감시 큐레이션이 비용이 많이 들고 개인 비용이 많이 들지만, 이러한 자료를 제거 또는 처리하기 위한 자동 필터링 시스템이 충분하지 않다고 주장한다. 자연어 처리 시스템은 Offensive 자료를 분리하거나 할인하는 데 어려움을 겪을 수 있으며, 이는 볼륨으로 인해重大하게 인식될 수 있다.

금지된 콘텐츠를 영속화하고 저작권 보호를 제거

논문은 이러한 유형의 미수정 데이터셋이 소수자 개인의剝削를 영속화할 가능성이 높으며, 이러한 자료에 대한 책임을 최종 사용자에게 전가하는 것이 옳은지에 대해 질문한다:

‘개인들은 데이터를 웹사이트에서 삭제하고 영원히 사라졌다고 생각할 수 있지만, 연구자 및 조직의 서버에 여전히 존재할 수 있다.誰가 데이터를 데이터셋에서 삭제할 책임이 있는가? LAION-400M의 경우, 생성자는 이 작업을 데이터셋 사용자에게 위임했다. 이러한 프로세스가 의도적으로 복잡하게 만들어졌으며, 평균 사용자는 데이터를 삭제하는 데 필요한 기술 지식을缺如한다면, 이것은 합리적인 접근 방식인가?

그들은 또한 LAION-400M이 채택한 Creative Common CC-BY 4.0 라이선스 모델하에 출시할 수 있는지에 대해 논쟁한다. 이는 대규모 데이터셋의 민주화에 잠재적인 이점이 있음에도 불구하고, 저작권 보호를 무시할 수 있다.

LAION-400M 도메인은 ‘이미지들이 자신의 저작권하에 있다’고 주장한다 – 최근 몇 년간 연구 목적으로 웹 스크레이핑을 광범위하게 승인하는 법원 판결 및 정부 지침에 의해 크게 활성화된 ‘패스스루’ 메커니즘 출처: https://rom1504.github.io/clip-retrieval/

연구자들은草根(즉, 크라우드소싱 자원봉사자)가 일부 데이터셋 문제를 해결할 수 있으며, 연구자들이 개선된 필터링 기술을 개발할 수 있다고 제안한다.

‘그러나 데이터 주체의 권리는 여전히 해결되지 않는다. 이러한 대규모 데이터셋의 내재된 피해를 경시하고 산업 및 상업 환경에서 사용을 장려하는 것은 무책임하고 위험하다. 라이선스 체계하에 제공되는 데이터셋의 책임은 데이터셋 생성자에게만 있다.’

하이퍼스케일 데이터 민주화의 문제

논문은 LAION-400M과 같은 시각-언어 데이터셋이 이전에는 큰 기술 회사나 자원을 갖춘 연구 기관에서만 사용할 수 있었다고 주장한다. 그들은 새로운 출시의 정신을 칭찬하지만, 그 실행을 비판한다.

연구자들은 ‘민주화’의 일반적으로 받아들여지는 정의가, 이러한 오픈 소스 하이퍼스케일 데이터셋에 적용될 때, 취약한 개인 및 커뮤니티의 권리, 복지, интерес를 고려하지 않는다고 주장한다. 많은 사람들이 이러한 데이터셋과 모델의 다운스트림 영향으로 가장 많이 고통을 겪을 가능성이 있다.

‘이러한 대규모 다중 모달 데이터셋을 철저하게 정화하기 위한 필요한주의의 정도는 분명히 천문학적일 것이다.’

지니를 다시 병에 넣기

일부 데이터셋은 콘텐츠가 이미 장기적인 AI 프로젝트에 전달된 후에야 삭제되었다. 이러한 데이터셋에는 중국의 억압적인 당국에 의해 사용된 것으로 인해 인권 단체로부터 반복적인 우려를 받은 Duke MTMC(다중 대상, 다중 카메라) 데이터셋이 포함되어 있다. Microsoft Celeb(MS-Celeb-1M) 데이터셋은 1,000만 개의 ‘유명인’ 얼굴 이미지를 포함했으며, 이는 저널리스트, 활동가, 정책 입안자 및 작가의 생체 데이터를 노출시킨 것으로 비판을 받았다. Tiny Images 데이터셋은 2020년에 삭제되었으며, 이는 ‘편향, 공격적이고 유해한 이미지, 및 비방적 용어’를 포함하고 있었다.

수정된 데이터셋의 예로는 ImageNet 데이터셋이 있다. 연구자들은 이 데이터셋이 10년(2009-2019) 동안 개인 정보 보호 및 비이미지 가능한 클래스에 대한 반복적인 비판에 대한 조치를 취했다고 주장한다.

논문은 LAION-400M이 이러한 개선을 무시하고, ImageNet의 수정된 표현을 새로운 출시에서 무시한다는 것을 관찰한다. 또한 이러한 경향을 감지한다:

‘이것은 ImageNet의 수정된 버전을 무시하는 더 큰 데이터셋의 출현에서 강조된다. 예를 들어, 2020년 2월에 출시된 Tencent ML-이미지 데이터셋은 이러한 비이미지 가능한 클래스 대부분을 포함한다. 또한 최신 SotA 모델(예: Google의 최신 EfficientNetV2 및 CoAtNet 모델)에서 필터링되지 않은 ImageNet-21k를 계속 사용하는 것이 포함된다. 또한, LVIS 챌린지 2021과 같은 유명한 대회에서 필터링되지 않은 ImageNet-21k 사전 훈련을 허용하는 명시적인 발표가 포함된다.

‘우리는 이 중요한 관찰을 강조한다: ImageNet과 같은 팀은 1,500만 개의 이미지를 관리하는 데 어려움을 겪고 있으며, 이러한 해독 시도를 지금까지 실패했다.

‘이러한 대규모 다중 모달 데이터셋을 철저하게 정화하기 위한 필요한주의의 정도는 분명히 천문학적일 것이다.’