인공지능

AnomalyGPT: 산업 이상을 LVLM을 사용하여 감지

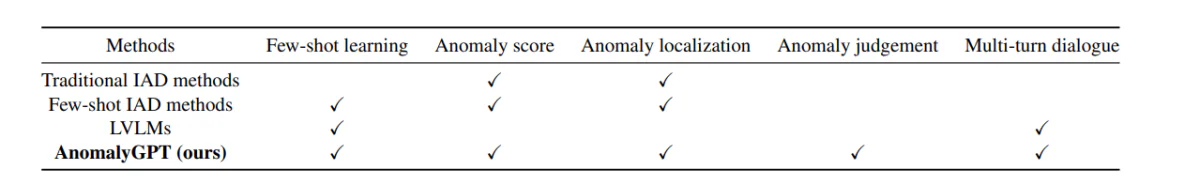

최근에 큰 비전 언어 모델(LVLM)인 LLava와 MiniGPT-4는 이미지 이해와 여러 시각 작업에서 높은 정확도와 효율성을 달성하는 능력을 보여주었습니다. LVLM은 광범위한 훈련 데이터셋으로 인해 일반적인 객체를 인식하는 데优秀하지만, 특정 도메인 지식이 부족하고 이미지 내의 지역화된 세부 사항을 이해하는 데 제한이 있으므로 산업 이상 감지(IAD) 작업에서 그 효과가 제한됩니다. 다른 한편, 기존의 IAD 프레임워크는 이상의 원인을 식별할 수 있지만, 정상 샘플과 이상 샘플을 구별하기 위해 수동으로 임계값을 설정해야 하므로 실제 구현에 제한이 있습니다.

IAD 프레임워크의 주요 목적은 산업 시나리오와 제품 이미지에서 이상을 감지하고 지역화하는 것입니다. 그러나 실제 이미지 샘플의 예측 불가능성과 희귀성으로 인해 모델은 일반적으로 정상 데이터만으로 훈련됩니다. 모델은 일반적인 샘플에서 벗어난 샘플을 구별합니다. 현재 IAD 프레임워크와 모델은 주로 테스트 샘플에 대한 이상 점수를 제공합니다. 또한 각 항목 클래스의 정상 및 이상 인스턴스를 구별하기 위해 수동으로 임계값을 지정해야 하므로 실제 응용 프로그램에 적합하지 않습니다.

IAD 프레임워크의 도전을 해결하기 위해 LVLM의 사용과 구현을 탐색하기 위해, AnomalyGPT라는 새로운 IAD 접근 방식이 도입되었습니다. AnomalyGPT는 수동으로 임계값을 설정할 필요 없이 이상을 감지하고 지역화할 수 있습니다. 또한 AnomalyGPT는 이미지에 대한 관련 정보를 제공하여 사용자와 상호 작용할 수 있습니다.

산업 이상 감지와 큰 비전 언어 모델

기존의 IAD 프레임워크는 두 가지 범주로 분류할 수 있습니다.

- 재구성 기반 IAD.

- 기능 임베딩 기반 IAD.

재구성 기반 IAD 프레임워크에서 주요 목표는 이상 샘플을 해당 정상 샘플로 재구성하는 것입니다. SCADN, RIAD, AnoDDPM, InTra는 생성적 적대적 네트워크(GAN)와 오토인코더, 확산 모델 및 트랜스포머를 사용하는 다양한 재구성 프레임워크를 사용합니다.

다른 한편, 기능 임베딩 기반 IAD 프레임워크에서 주요 목표는 정상 데이터의 기능 임베딩을 모델링하는 것입니다. PatchSSVD와 같은 방법은 정상 샘플을 밀접하게 둘러싸는 초구를 찾으려고 합니다. PyramidFlow와 Cfl과 같은 프레임워크는 정상 샘플을 가우시안 분포에 투영합니다. CFA와 PatchCore 프레임워크는 패치 임베딩에서 정상 샘플의 메모리 뱅크를 설정하고 테스트 샘플 임베딩과 정상 임베딩 간의 거리를 사용하여 이상을 감지합니다.

이 두 가지 방법은 “한 클래스당 한 모델”이라는 학습 패러다임을 따르며, 각 객체 클래스의 분포를 학습하기 위해大量의 정상 샘플이 필요합니다. 정상 샘플의大量 요구는 새로운 객체 범주에 대해 실제로 구현하기 어렵게 만들며, 동적인 제품 환경에서 응용 프로그램이 제한적입니다. 다른 한편, AnomalyGPT 프레임워크는 객체 범주에 대한 컨텍스트 학습 패러다임을 사용하여, 수동으로 임계값을 설정할 필요 없이 이상을 감지하고 지역화할 수 있습니다.

AnomalyGPT의 작동 원리

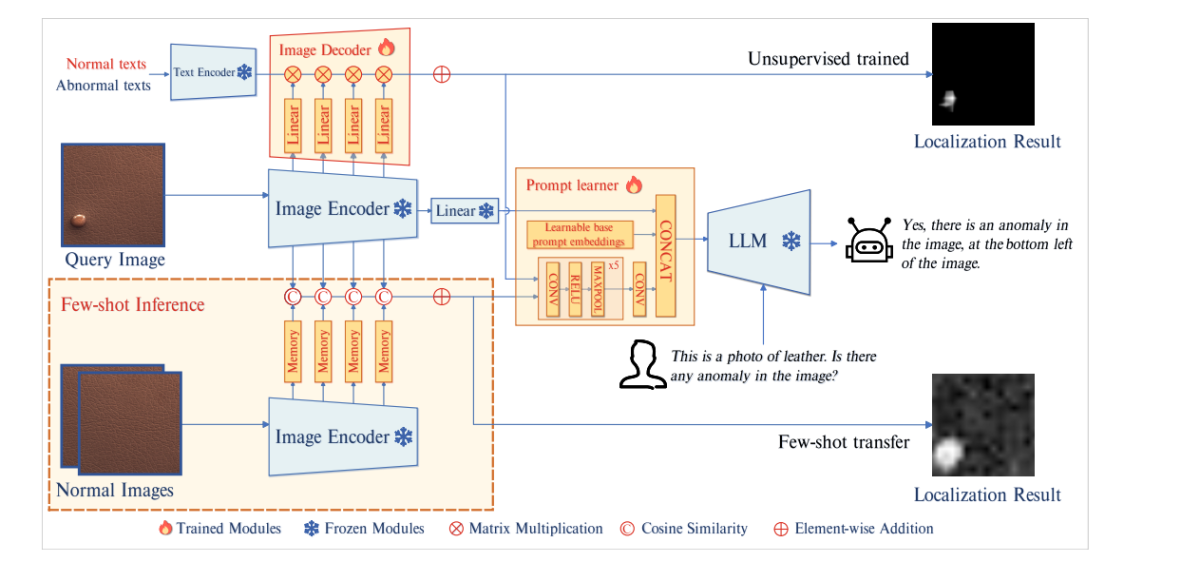

AnomalyGPT는 산업 이상을 감지하고 지역화하는 대화형 IAD 큰 비전 언어 모델입니다. AnomalyGPT 프레임워크는 LLM과 사전 훈련된 이미지 인코더를 사용하여 이미지와 해당 텍스트 설명을 일치시킵니다. 모델은 디코더 모듈과 프롬프트 학습 모듈을 도입하여 IAD 시스템의 성능을 향상시키고 픽셀 수준의 지역화 출력을 달성합니다.

모델 아키텍처

위의 이미지는 AnomalyGPT의 아키텍처를 보여줍니다. 모델은 먼저 쿼리 이미지를 동결된 이미지 인코더에 전달합니다. 모델은 중간 레이어에서 패치 수준의 기능을 추출하고, 이를 이미지 디코더에 입력하여 이상과 정상 텍스트와의 유사성을 계산하여 지역화 결과를 얻습니다. 프롬프트 학습자는 이를 프롬프트 임베딩으로 변환하여 LLM과 함께 사용자 텍스트 입력으로 사용할 수 있습니다. LLM 모델은 프롬프트 임베딩, 이미지 입력, 사용자 제공 텍스트 입력을 사용하여 이상을 감지하고 지역화하며, 사용자에게 최종 응답을 생성합니다.

디코더

픽셀 수준의 이상 지역화를 달성하기 위해, AnomalyGPT 모델은 가벼운 기능 매칭 기반 이미지 디코더를 사용합니다. 디코더의 설계는 WinCLIP, PatchCore, APRIL-GAN 프레임워크에서 영감을 받았습니다. 모델은 이미지 인코더를 4개의 단계로 분할하고, 각 단계에서 중간 패치 수준의 기능을 추출합니다.

프롬프트 학습자

AnomalyGPT 프레임워크는 지역화 결과를 프롬프트 임베딩으로 변환하여 이미지에서 세분화된 의미를 활용하고, 디코더와 LLM 출력 간의 의미 일관성을 유지합니다. 또한, 모델은 디코더 출력과 관련이 없는 학습 가능한 프롬프트 임베딩을 프롬프트 학습자에 통합하여 IAD 작업에 대한 추가 정보를 제공합니다. 최종적으로, 모델은 임베딩과 원본 이미지 정보를 LLM에 입력합니다.

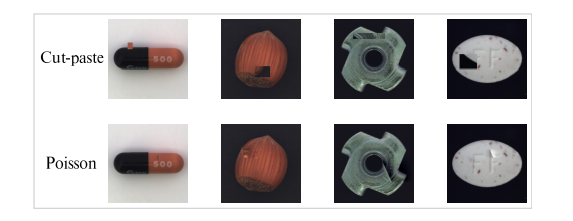

이상 시뮬레이션

AnomalyGPT 모델은 NSA 방법을 사용하여 이상 데이터를 시뮬레이션합니다. NSA 방법은 포이슨 이미지 편집 방법을 사용하여 이미지 세그먼트를 붙여 넣을 때 발생하는 불연속성을 완화합니다. Cut-paste는 IAD 프레임워크에서 시뮬레이션된 이상 이미지를 생성하는 일반적인 기술입니다.

질문과 답변 콘텐츠

AnomalyGPT 모델은 대화형 IAD-vision 언어 모델을 위한 프롬프트 튜닝을 수행하기 위해, 이상 이미지에 대한 텍스트 쿼리를 생성합니다. 각 쿼리는 두 가지 주요 구성 요소를 포함합니다. 쿼리의 첫 번째 부분은 입력 이미지에 대한 설명으로, 이미지에 있는 객체와 해당 속성에 대한 정보를 제공합니다. 쿼리의 두 번째 부분은 객체 내에서 이상의 존재를 감지하거나 이미지에 이상이 있는지 확인하는 것입니다.

데이터셋과 평가 지표

모델은 주로 VisA와 MVTec-AD 데이터셋에서 실험을 수행합니다. MVTec-AD 데이터셋은 3629개의 이미지로 훈련되고, 1725개의 이미지로 테스트되며, 15개의 다른 범주로 나뉩니다. VisA 데이터셋은 9621개의 정상 이미지와 1200개의 이상 이미지를 포함하며, 12개의 다른 범주로 나뉩니다.

결과

양적 결과

Few-Shot 산업 이상 감지

AnomalyGPT 모델은 기존의 few-shot IAD 프레임워크와 비교합니다. 결과는 AnomalyGPT 모델이 기존 모델보다 우수한 성능을 보입니다.

무감독 산업 이상 감지

AnomalyGPT 모델은 무감독 학습 설정에서 단일 모델을 훈련하고, 여러 클래스의 샘플을 사용하여 훈련합니다. 모델은 UniAD 프레임워크와 비교하며, JNLD와 PaDim 프레임워크와도 비교합니다.

질적 결과

결론

AnomalyGPT는 산업 이상을 감지하고 지역화하는 대화형 IAD-vision 언어 모델입니다. AnomalyGPT는 큰 비전 언어 모델의 강력한 능력을 활용하여 산업 이상 감지의 새로운 가능성을 열어줍니다.