Leader di pensiero

Tre tecniche di apprendimento automatico che preservano la privacy per risolvere il problema più importante di questo decennio

By Amogh Tarcar, ricercatore di apprendimento automatico e intelligenza artificiale, Persistent Systems.

La privacy dei dati, secondo gli esperti di diversi settori, sarà il problema più importante di questo decennio. Ciò è particolarmente vero per l’apprendimento automatico (ML), dove gli algoritmi vengono alimentati con grandi quantità di dati.

Tradizionalmente, le tecniche di modellazione dell’apprendimento automatico si sono basate sulla centralizzazione dei dati da diverse fonti in un unico centro di dati. Dopo tutto, i modelli di apprendimento automatico sono più potenti quando hanno accesso a grandi quantità di dati. Tuttavia, ci sono una serie di sfide relative alla privacy che derivano da questa tecnica. L’aggregazione di dati diversi da diverse fonti è meno fattibile oggi a causa di preoccupazioni normative come HIPAA, GDPR e CCPA. Inoltre, la centralizzazione dei dati aumenta la portata e la scala degli abusi di dati e delle minacce alla sicurezza sotto forma di violazioni dei dati.

Per superare queste sfide, sono stati sviluppati diversi pilastri dell’apprendimento automatico che preserva la privacy (PPML) con tecniche specifiche che riducono il rischio per la privacy e garantiscono che i dati rimangano ragionevolmente sicuri. Ecco alcune delle più importanti:

1. Apprendimento federato

L’apprendimento federato è una tecnica di formazione dell’apprendimento automatico che capovolge il problema di aggregazione dei dati. Invece di aggregare i dati per creare un unico modello di apprendimento automatico, l’apprendimento federato aggrega i modelli di apprendimento automatico stessi. Ciò garantisce che i dati non lascino la loro posizione di origine e consente a più parti di collaborare e costruire un modello di apprendimento automatico comune senza condividere direttamente dati sensibili.

Funziona così. Si inizia con un modello di apprendimento automatico di base che viene condiviso con ogni nodo client. Questi nodi eseguono quindi una formazione locale su questo modello utilizzando i propri dati. Gli aggiornamenti del modello vengono periodicamente condivisi con il nodo coordinatore, che elabora questi aggiornamenti e li fonde insieme per ottenere un nuovo modello globale. In questo modo, si ottengono informazioni da dataset diversi senza dover condividere questi dataset.

Source: Persistent Systems

Nel contesto della sanità, questo è uno strumento incredibilmente potente e consapevole della privacy per mantenere al sicuro i dati dei pazienti mentre fornisce ai ricercatori la saggezza della folla. Non aggregando i dati, l’apprendimento federato crea un ulteriore livello di sicurezza. Tuttavia, i modelli e gli aggiornamenti dei modelli presentano ancora un rischio per la sicurezza se lasciati vulnerabili.

2. Privacy differenziale

I modelli di apprendimento automatico sono spesso bersaglio di attacchi di inferenza di appartenenza. Supponiamo che condividiate i vostri dati sanitari con un ospedale per aiutare a sviluppare un vaccino contro il cancro. L’ospedale mantiene i vostri dati al sicuro, ma utilizza l’apprendimento federato per formare un modello di apprendimento automatico disponibile pubblicamente. Alcuni mesi dopo, gli hacker utilizzano un attacco di inferenza di appartenenza per determinare se i vostri dati sono stati utilizzati nella formazione del modello o meno. Quindi, passano informazioni a una compagnia di assicurazioni, che, in base al vostro rischio di cancro, potrebbe aumentare i vostri premi.

La privacy differenziale garantisce che gli attacchi avversari ai modelli di apprendimento automatico non saranno in grado di identificare punti di dati specifici utilizzati durante la formazione, mitigando così il rischio di esporre dati di formazione sensibili nell’apprendimento automatico. Ciò viene fatto applicando “rumore statistico” per perturbare i dati o i parametri del modello di apprendimento automatico durante la formazione dei modelli, rendendo difficile eseguire attacchi e determinare se i dati di un particolare individuo sono stati utilizzati per formare il modello.

Ad esempio, Facebook ha recentemente rilasciato Opacus, una libreria ad alta velocità per la formazione di modelli PyTorch utilizzando un algoritmo di formazione dell’apprendimento automatico basato sulla privacy differenziale chiamato Differentially Private Stochastic Gradient Descent (DP-SGD). Il gif seguente evidenzia come utilizza il rumore per mascherare i dati.

Source: Blog di Opacus di Facebook

Questo rumore è governato da un parametro chiamato Epsilon. Se il valore di Epsilon è basso, il modello ha una privacy dei dati perfetta ma scarsa utilità e accuratezza. Inversamente, se si ha un valore di Epsilon alto, la privacy dei dati diminuirà mentre l’accuratezza aumenterà. La chiave è trovare un equilibrio per ottimizzare entrambi.

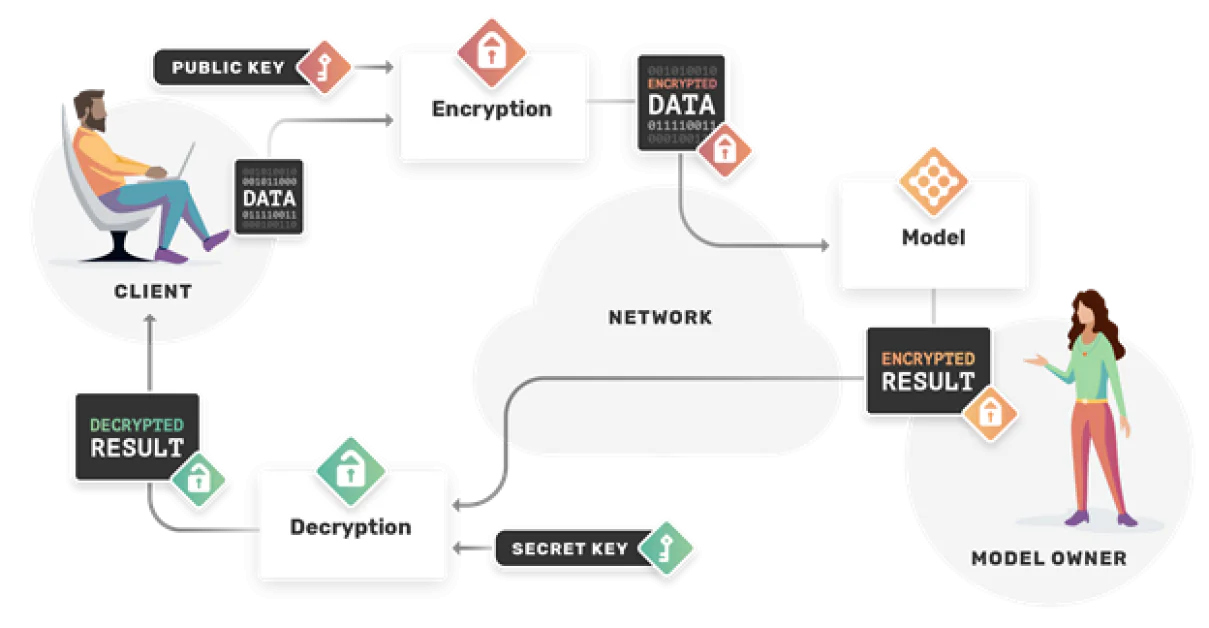

3. Crittografia omodifica

La crittografia standard è tradizionalmente incompatibile con l’apprendimento automatico perché una volta che i dati sono crittografati, non possono più essere compresi dall’algoritmo di apprendimento automatico. Tuttavia, la crittografia omodifica è uno schema di crittografia speciale che consente di continuare a eseguire determinati tipi di calcoli.

Source: OpenMined

Il potere di ciò è che la formazione può avvenire in uno spazio completamente crittografato. Non solo protegge i proprietari dei dati, ma protegge anche i proprietari del modello. Il proprietario del modello può eseguire un’inferenza su dati crittografati senza mai vederli o abusarne.

Quando applicato all’apprendimento federato, la fusione degli aggiornamenti del modello può avvenire in modo sicuro perché si verificano in un ambiente completamente crittografato, riducendo drasticamente il rischio di attacchi di inferenza di appartenenza.

Il decennio della privacy

Mentre entriamo nel 2021, l’apprendimento automatico che preserva la privacy è un settore di ricerca emergente con una ricerca notevolmente attiva. Se l’ultimo decennio è stato quello di desiloare i dati, questo decennio sarà quello di desiloare i modelli di apprendimento automatico mentre si preserva la privacy dei dati sottostanti attraverso l’apprendimento federato, la privacy differenziale e la crittografia omodifica. Questi presentano un nuovo modo promettente per avanzare le soluzioni di apprendimento automatico in modo consapevole della privacy.