Intelligenza Artificiale

NeRF fa un altro passo avanti verso la sostituzione della CGI

I ricercatori del MIT e di Google hanno compiuto un grande passo avanti nella risoluzione di uno degli ostacoli fondamentali per una tecnologia emergente guidata dall'intelligenza artificiale che potrebbe eventualmente sostituire la CGI: separare le immagini del campo di radianza neurale (NeRF) nelle sue componenti visive costituenti, in modo che le immagini possano essere ri-strutturato e ri-illuminato.

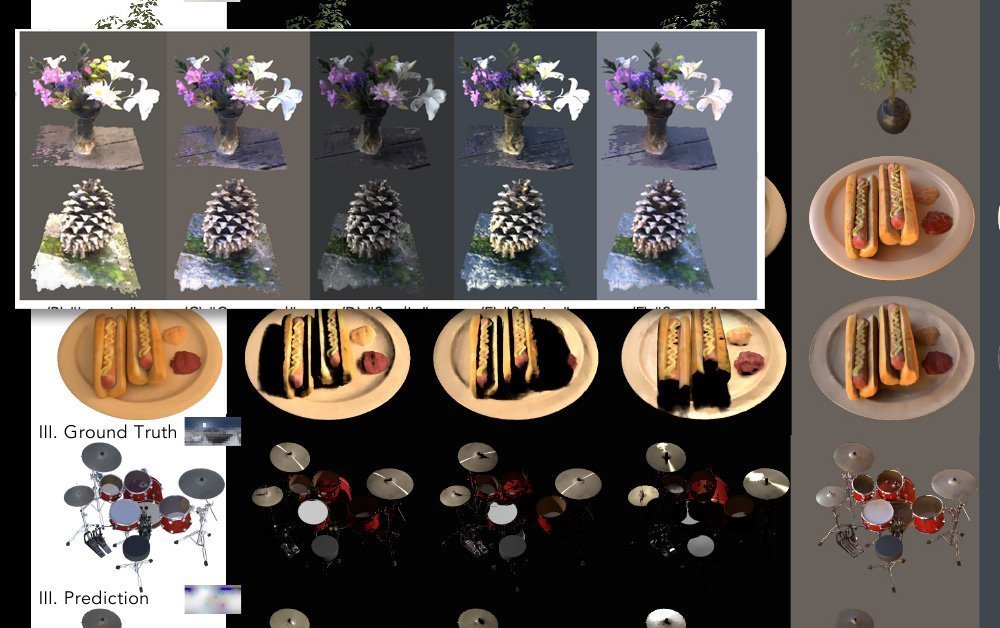

Il nuovo approccio, chiamato NeRFactor, suddivide efficacemente le immagini catturate in normali per oggetto (a cui è possibile assegnare le texture), visibilità della luce, albedo (la proporzione di luce incidente che viene riflessa da una superficie) e funzioni di distribuzione della riflettanza bidirezionale (BRDF).

Isolando queste sfaccettature, è possibile non solo cambiare le texture per singoli oggetti o gruppi di oggetti, ma anche aggiungere nuove e uniche fonti di illuminazione e implementazioni di ombre, escludendo quelle catturate dalle serie di telecamere multiple che generano input per le immagini NeRF.

Normali, visibilità, albedo e BRDF separati sotto NeRFactor. Fonte: https://www.youtube.com/watch?v=UUVSPJlwhPg

Il modello supporta ombre morbide o dure da fonti di illuminazione arbitrarie definite dall'utente e separa i quattro aspetti del video acquisito in modo programmatico, utilizzando una perdita di ricostruzione, i dati di calcoli precedenti di BRDF e una semplice regolarizzazione della fluidità di base.

Il flusso di lavoro di NeRFactor, che estrae separatamente aspetti utilizzabili delle immagini derivate da array di più telecamere. Fonte: https://arxiv.org/pdf/2106.01970.pdf

NeRFactor utilizza una sonda luminosa HDR, un approccio consolidato che ha pervaso la scena visual industrial e artistica sin dalla sua nascita introduzione nel 1998, per valutare i possibili percorsi dei raggi, che consentono un'illuminazione arbitraria. Poiché questo genera un numero ingovernabile di possibili parametri, la sonda luminosa viene filtrata attraverso un percettrone multistrato (MLP), che mappa la geometria percepita sulla sonda senza tentare di calcolare una mappa completa del volume di illuminazione per lo spazio del modello.

Due modelli di campo di radianza neurale vengono utilizzati per dimostrare cinque modelli di illuminazione possibili con NeRFactor. Fare clic sull'immagine per una risoluzione più elevata.

Motivo di riflessione

La nuova ricerca è forse più significativa nel separare gli strati di immagini catturate che controllano la riflessione. Questa rimane una delle maggiori sfide per le immagini del campo di radianza neurale, dal momento che un sistema NeRF veramente nuovo e flessibile dovrà non solo essere in grado di sostituire le trame, ma soprattutto avrà bisogno di un modo per riflettere gli oggetti in movimento (oltre al solo ambiente fisso generale) che normalmente verrebbero presi in considerazione in un flusso di lavoro CGI.

Questo problema è stato notato di recente in relazione a Intel impressionante nuova ricerca nella trasformazione di filmati di videogiochi in video fotorealistici tramite reti neurali convoluzionali. In tali flussi di lavoro, molti aspetti "cotti" del materiale sorgente dovrebbero diventare discreti e intercambiabili, e questo è probabilmente più facile da risolvere per la reilluminazione (che è una funzione della geometria renderizzata in NeRF) che per i riflessi (che utilizzano una geometria "fuori campo" completamente al di fuori dell'ambito del modello).

Pertanto, isolando gli strati nel video NeRF che facilitano la riflessione, NeRF si avvicina di un passo alla soluzione della sua "sfida della riflessione".

L'uso di un ambiente HDR risolve già il problema della generazione di riflessi dell'ambiente mondiale (ad esempio cieli, paesaggi e altri fattori ambientali "fissi"), ma saranno necessari nuovi approcci per introdurre riflessi in movimento e dinamici.

Fotogrammetria con NeRF

Le immagini del Neural Radiance Field utilizzano l'analisi dell'apprendimento automatico per sviluppare uno spazio completamente volumetrico da una scena o un oggetto che è stato catturato da diverse angolazioni.

Diversi schemi basati su NeRF emersi nell'ultimo anno hanno utilizzato un numero eterogeneo di dispositivi di ripresa; alcuni utilizzano 16 o più telecamere, altri solo una o due. In tutti i casi, i punti di vista intermedi vengono "riempiti" (ovvero interpretati) in modo che la scena o l'oggetto possano essere esplorati in modo fluido.

L'entità risultante è uno spazio completamente volumetrico, con una comprensione 3D intrinseca che può essere sfruttata in molti modi, inclusa la capacità di generare mesh CG tradizionali dalla somma analizzata in 3D delle immagini di input.

NeRF nel contesto di una "nuova CGI"

Le immagini del campo di radianza neurale lo sono disegnato direttamente dalle immagini del mondo reale, comprese le immagini in movimento di persone, oggetti e scene. Al contrario, una metodologia CGI "studia" e interpreta il mondo, richiedendo a lavoratori qualificati di costruire mesh, rig e texture che utilizzino immagini del mondo reale (ad esempio, immagini facciali e ambientali). Rimane un approccio essenzialmente interpretativo e artigianale, costoso e laborioso.

Inoltre, la CGI ha avuto continui problemi con l'effetto "valle perturbante" nei suoi tentativi di ricreare sembianze umane, che non presenta alcun vincolo per un approccio basato su NeRF, che si limita a catturare video o immagini di persone reali e a manipolarli.

Inoltre, NeRF può generare la tradizionale geometria mesh in stile CGI direttamente dalle foto, se necessario, e in effetti soppiantare molte delle procedure manuali che sono sempre state necessarie nelle immagini generate al computer.

Sfide per NeRF

Quest'ultima ricerca del MIT e di Google arriva nel contesto di una vera e propria marea di documenti NeRF nell'ultimo anno, molti dei quali hanno offerto soluzioni alle varie sfide sollevate dal documento iniziale del 2020.

Ad aprile, l'innovazione di un consorzio di ricerca cinese ha fornito un modo per farlo isolare discretamente le singole linee temporali delle sfaccettature in una scena NeRF, comprese le persone.

La ricerca cinese consente agli utenti finali di copiare, incollare e ridimensionare gli elementi acquisiti, districandoli dalla linea temporale lineare del video sorgente originale. Fonte: https://www.youtube.com/watch?v=Wp4HfOwFGP4

Questo approccio non solo consente di re-immaginare la scena da qualsiasi angolazione catturata dall'array di telecamere (e non solo la singola vista rappresentata in una tipica acquisizione video), ma consente anche un compositing versatile e persino la capacità di rappresentare due sfaccettature della stessa filmati che vengono eseguiti nei propri intervalli di tempo individuali (o anche all'indietro, se necessario).

La ricerca cinese consente agli utenti finali di copiare, incollare e ridimensionare gli elementi acquisiti, districandoli dalla linea temporale lineare del video sorgente originale. Fonte: https://www.youtube.com/watch?v=Wp4HfOwFGP4

Una delle maggiori sfide per NeRF è ridurre le considerevoli risorse necessarie per addestrare una scena, e questo è stato affrontato in una serie di documenti recenti. Ad esempio, recentemente introdotto il Max Planck Institute for Intelligent Systems KiloNeRF, che non solo accelera i tempi di rendering di un fattore 1000, ma consente anche a NeRF di operare in modo interattivo.

KiloNeRF esegue un ambiente interattivo a 50 fps su una GTX 1080ti. Fonte: https://github.com/creiser/kilonerf

Tuttavia, l'innovazione della velocità NeRF che ha davvero catturato l'immaginazione dei ricercatori e del pubblico nel 2021 è stata la Plen Octrees collaborazione, guidata da UC Berkeley, che offre il rendering in tempo reale dei Neural Radiance Fields:

L'effetto delle capacità interattive di PlenOctrees è stato riprodotto in a interfaccia live basata sul web.

Movimento interattivo dal vivo di un oggetto PlenOctrees in Firefox (il movimento è più fluido e dinamico di quanto rappresentato da questa GIF). Fonte: http://alexyu.net/plenoctrees/demo/

Inoltre, NeRF ricorsivo (da un articolo di maggio 2021 di ricercatori dell'Università di Tsinghua) offre rendering ricorsivo di alta qualità su richiesta. Invece di obbligare l'utente a renderizzare intere scene, incluse parti che potrebbero non essere visibili, Recursive-NeRF offre qualcosa di simile alla compressione con perdita di dati JPEG e può generare sub-NeRF discreti per gestire immagini aggiuntive su richiesta, ottenendo un enorme risparmio di risorse di calcolo.

Mantenimento dei dettagli durante il dump dei calcoli di rendering non necessari con Recursive-NeRF. Clicca sull'immagine per una maggiore risoluzione. Fonte: https://arxiv.org/pdf/2105.09103.pdf

Altri approcci includono FastNeRF, che afferma di ottenere un rendering neurale ad alta fedeltà a 200 fps.

È stato notato che molte delle tecniche di ottimizzazione per NeRF coinvolgono 'cuocendo' la scena, impegnandosi sugli aspetti che si desidera rendere e scartando altri aspetti, il che limita l'esplorazione ma accelera notevolmente l'interattività.

Lo svantaggio di questo è che lo stress si sposta dalla GPU all'archiviazione, perché le scene cotte occupano una quantità eccessiva di spazio su disco; in una certa misura, questo può essere mitigato sottocampionando i dati elaborati, sebbene ciò comporti anche un certo impegno, in termini di chiusura delle vie di esplorazione o interattività.

Per quanto riguarda il motion capture e il rigging, un nuovo approccio delle università di Zheijang e Cornell, rivelato a maggio, ha offerto un metodo per ricreare esseri umani animabili utilizzando campi di peso misto e strutture scheletriche interpretate dal video di input:

Struttura scheletrica derivata in Animatable NeRF. Fonte: https://www.youtube.com/watch?v=eWOSWbmfJo4

Quando arriverà il momento "Jurassic Park" per NeRF?

Nonostante il rapido progresso nella sintesi di immagini tramite campi di radianza neurale, è solo in questo periodo che verrà stabilita una sorta di "legge della termodinamica" che stabilisca quanto possa essere utilizzabile la NeRF. In termini di una cronologia analoga alla storia della CGI, la NeRF si aggira attualmente intorno al 1973, poco prima della primo utilizzo di CGI in Mondo dei robot.

Ciò non significa che NeRF dovrà necessariamente aspettare nove anni per il suo equivalente L'ira di Khan pietra miliare, o decenni per le simili scoperte che la CGI ha raggiunto sotto l'entusiastico patrocinio di James Cameron nel 1989 The Abyss o del 1991 Terminator 2 – e poi, la tecnologia è davvero rivoluzionaria momento di evasione in 1993 Jurassic Park.

Il panorama dell'imaging è cambiato molto dal lungo periodo di stagnazione degli effetti visivi fotochimici, che ha dominato la produzione cinematografica e televisiva dalla nascita del cinema fino ai primi anni Novanta. L'avvento della rivoluzione del PC e l'accelerazione della legge di Moore hanno portato alla rivoluzione della CGI, che altrimenti avrebbe potuto verificarsi già negli anni Sessanta.

Resta da vedere se esiste un ostacolo così implacabile da poter frenare il progresso di NeRF per così tanto tempo e se le successive innovazioni nella visione artificiale non riusciranno nel frattempo a superare completamente NeRF come principale contendente per la corona di CGI, caratterizzando i campi di radiazione neurale come il "fax" di breve durata della sintesi delle immagini neurali.

Finora, NeRF non è stato utilizzato in alcun contesto al di fuori della ricerca accademica; ma è degno di nota che importanti attori come Google Research e molti dei più importanti laboratori di ricerca sulla visione artificiale siano in competizione per l'ultima svolta di NeRF.

Molti dei maggiori ostacoli di NeRF hanno iniziato a essere affrontati direttamente quest'anno; se la ricerca successiva offrirà una soluzione al "problema della riflessione" e i numerosi filoni di ricerca sull'ottimizzazione di NeRF si fonderanno in una soluzione decisiva alle notevoli esigenze di elaborazione e/o archiviazione della tecnologia, NeRF avrà davvero la possibilità di diventare "la nuova CGI" nei prossimi cinque anni.