Kecerdasan buatan

Mengubah Emosi dalam Footage Video dengan AI

Peneliti dari Yunani dan Inggris telah mengembangkan pendekatan deep learning baru untuk mengubah ekspresi dan mood yang tampak dari orang-orang dalam footage video, sambil mempertahankan keaslian gerakan bibir mereka terhadap audio asli dengan cara yang belum pernah dicapai oleh upaya sebelumnya.

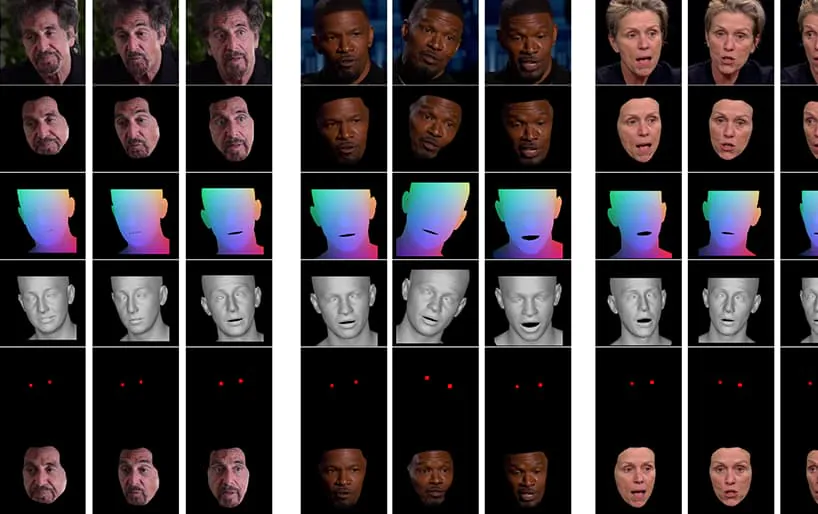

Dari video yang menyertain paper (disematkan di akhir artikel ini), cuplikan singkat aktor Al Pacino memiliki ekspresinya yang halus diubah oleh NED, berdasarkan konsep semantik tingkat tinggi yang mendefinisikan ekspresi wajah individu, dan emosi yang terkait. Metode ‘Reference-Driven’ di sebelah kanan mengambil emosi yang ditafsirkan dari video sumber dan menerapkannya pada keseluruhan urutan video. Sumber: https://www.youtube.com/watch?v=Li6W8pRDMJQ

Bidang ini termasuk dalam kategori yang tumbuh dari emosi deepfaked, di mana identitas pembicara asli dipertahankan, tetapi ekspresi dan mikro-ekspresi mereka diubah. Ketika teknologi AI ini matang, itu menawarkan kemungkinan bagi produksi film dan TV untuk membuat perubahan halus pada ekspresi aktor – tetapi juga membuka kategori baru dari ‘video deepfaked yang diubah emosinya’.

Mengubah Wajah

Ekspresi wajah untuk tokoh publik, seperti politisi, dikurasi dengan ketat; pada 2016, ekspresi wajah Hillary Clinton dibawah pengawasan media yang intens karena dampak negatif potensialnya pada prospek elektoralnya; ekspresi wajah, ternyata, juga merupakan topik minat bagi FBI; dan mereka merupakan indikator kritis dalam wawancara kerja, membuat prospek (yang masih jauh) dari filter ‘kontrol ekspresi’ langsung menjadi pengembangan yang diinginkan bagi pencari kerja yang mencoba melewati pra-layar di Zoom.

Studi 2005 dari Inggris menyatakan bahwa penampilan wajah mempengaruhi keputusan pemilihan, sementara fitur Washington Post 2019 menggunakan ‘klip video di luar konteks’, yang saat ini merupakan hal terdekat yang dimiliki oleh pendukung berita palsu untuk benar-benar mengubah bagaimana seorang tokoh publik tampaknya berperilaku, merespons, atau merasa.

Menuju Manipulasi Ekspresi Saraf

Saat ini, keadaan seni dalam memanipulasi afek wajah cukup rudimenter, karena melibatkan disentanglement dari konsep tingkat tinggi (seperti sedih, marah, gembira, tersenyum) dari konten video yang sebenarnya. Meskipun arsitektur deepfake tradisional tampaknya mencapai disentanglement ini dengan cukup baik, memantulkan emosi di seluruh identitas yang berbeda masih memerlukan bahwa dua set wajah pelatihan mengandung ekspresi yang sesuai untuk setiap identitas.

Contoh tipikal dari gambar wajah dalam set data yang digunakan untuk melatih deepfakes. Saat ini, Anda hanya dapat memanipulasi ekspresi wajah seseorang dengan membuat jalur ekspresi-ke-ekspresi khusus ID dalam jaringan saraf deepfake. Perangkat lunak deepfake 2017 tidak memiliki pemahaman intrinsik dan semantik tentang ‘senyum’ – itu hanya memetakan dan mencocokkan perubahan yang dirasakan dalam geometri wajah di seluruh subjek.

Apa yang diinginkan, dan belum sepenuhnya tercapai, adalah mengenali bagaimana subjek B (misalnya) tersenyum, dan hanya membuat sakelar ‘tersenyum‘ dalam arsitektur, tanpa perlu memetakan ke gambar setara dari subjek A yang tersenyum.

Paper baru ini berjudul Neural Emotion Director: Speech-preserving semantic control of facial expressions in “in-the-wild” videos, dan berasal dari peneliti di Sekolah Teknik Elektro dan Ilmu Komputer di Universitas Teknik Nasional Athena, Institut Ilmu Komputer di Yayasan Penelitian dan Teknologi Hellas (FORTH), dan Fakultas Teknik, Matematika dan Ilmu Fisik di Universitas Exeter di Inggris.

Tim telah mengembangkan kerangka kerja yang disebut Neural Emotion Director (NED), yang mencakup jaringan manipulasi emosi berbasis 3D, 3D-Based Emotion Manipulator.

NED mengambil urutan parameter ekspresi yang diterima dan menerjemahkannya ke domain target. Ini dilatih pada data yang tidak sejajar, yang berarti bahwa tidak perlu dilatih pada set data di mana setiap identitas memiliki ekspresi wajah yang sesuai.

Video, ditampilkan di akhir artikel ini, menjalankan serangkaian tes di mana NED mengimpos keadaan emosional yang tampak pada footage dari dataset YouTube.

Penulis mengklaim bahwa NED adalah metode video pertama untuk ‘mengarahkan’ aktor dalam situasi yang tidak terduga dan tidak terprediksi, dan telah membuat kode tersedia di halaman proyek NED.

Metode dan Arsitektur

Sistem ini dilatih pada dua set data video besar yang telah diberi label ’emosi’.

Keluaran diaktifkan oleh renderer wajah video yang merender emosi yang diinginkan ke video menggunakan teknik sintesis gambar wajah tradisional, termasuk segmentasi wajah, penyelarasan landmark wajah dan pencampuran, di mana hanya area wajah yang disintesis, dan kemudian diterapkan pada footage asli.

Arsitektur untuk pipeline Neural Emotion Detector (NED). Sumber: https://arxiv.org/pdf/2112.00585.pdf

Awalnya, sistem memperoleh pemulihan wajah 3D dan menerapkan penyelarasan landmark wajah pada frame input untuk mengidentifikasi ekspresi. Setelah itu, parameter ekspresi yang dipulihkan ini dilewatkan ke 3D-Based Emotion Manipulator, dan vektor gaya dihitung dengan cara label semantik (seperti ‘gembira’) atau oleh file referensi.

File referensi adalah video yang menggambarkan ekspresi/emosi yang diakui, yang kemudian diterapkan pada keseluruhan video target, menggantikan ekspresi asli.

Bentuk wajah 3D yang dihasilkan akhirnya kemudian digabungkan dengan Koordinat Wajah Rata-Rata Normal (NMFC) dan gambar mata (titik merah di gambar atas), dan dilewatkan ke renderer saraf, yang melakukan manipulasi akhir.

Hasil

Peneliti melakukan studi ekstensif, termasuk studi pengguna dan ablasio, untuk mengevaluasi efektivitas metode ini dibandingkan dengan karya sebelumnya, dan menemukan bahwa dalam sebagian besar kategori, NED outperforms keadaan seni saat ini dalam sub-sektor manipulasi wajah saraf.

Penulis paper membayangkan bahwa implementasi lanjutan dari karya ini, dan alat dengan sifat serupa, akan berguna terutama dalam industri TV dan film, menyatakan:

‘Metode kami membuka sejumlah kemungkinan baru untuk aplikasi teknologi rendering saraf yang berguna, mulai dari pasca-produksi film dan permainan video hingga avatar afektif yang foto-realistik.’

Ini adalah karya awal di bidang ini, tetapi salah satu yang pertama mencoba reenactment wajah dengan video bukan gambar diam. Meskipun video pada dasarnya adalah banyak gambar diam yang berjalan sangat cepat, ada pertimbangan temporal yang membuat aplikasi transfer emosi sebelumnya kurang efektif. Dalam video yang menyertain, dan contoh dalam paper, penulis menyertakan perbandingan visual dari output NED dibandingkan dengan metode terkini lainnya.

Perbandingan yang lebih rinci, dan banyak contoh NED, dapat ditemukan dalam video lengkap di bawah:

3 Desember 2021, 18:30 GMT+2 – Atas permintaan salah satu penulis paper, perubahan dilakukan mengenai ‘file referensi’, yang saya salah nyatakan sebagai foto diam (ketika sebenarnya itu adalah klip video). Juga sebuah perubahan pada nama Institut Ilmu Komputer di Yayasan Penelitian dan Teknologi.

3 Desember 2021, 20:50 GMT+2 – Permintaan kedua dari salah satu penulis paper untuk perubahan lebih lanjut pada nama lembaga yang disebutkan di atas.