Mesterséges Intelligencia

Stabil videó diffúzió: Látens videó diffúziós modellek nagy adathalmazokhoz

Generatív AI már egy ideje mozgatórugója az AI-közösségnek, és a generatív képmodellezés területén, különösen a diffúziós modellek használatával elért előrelépések nemcsak a kutatásban, hanem a kutatásban is jelentős előrelépést segítettek elő a generatív videómodellek számára. valós alkalmazások. Hagyományosan a generatív videomodelleket vagy a semmiből képezik ki, vagy részben vagy teljesen finomhangolják előképzett képmodellekből extra időbeli rétegekkel, kép- és videóadatkészletek keverékén.

A generatív videomodellek fejlődését előretekintve ebben a cikkben arról fogunk beszélni Stabil videó diffúziós modell, egy látens videó diffúziós modell, amely képes nagy felbontású, korszerű képet videóvá és szöveget videóvá tartalom generálni. Beszélni fogunk arról, hogy a 2D-s képek szintetizálására kiképzett látens diffúziós modellek hogyan javították a generatív videómodellek képességeit és hatékonyságát időbeli rétegek hozzáadásával, valamint a modellek finomhangolásával a kiváló minőségű videókat tartalmazó kis adatkészleteken. Mélyebbre fogunk merülni a Stable Video Diffusion Model architektúrájában és működésében, és különféle mérőszámok alapján értékeljük teljesítményét, és összehasonlítjuk a videógenerálás jelenlegi legkorszerűbb kereteivel. Tehát kezdjük.

Stabil videó diffúziós modell és generatív videomodellek: Bevezetés

Szinte korlátlan lehetőségeinek köszönhetően a generatív mesterséges intelligencia már egy ideje a kutatások elsődleges tárgya a mesterséges intelligencia és az ML szakemberek számára, és az elmúlt néhány évben gyors fejlődés tapasztalható mind a generatív képmodellek hatékonysága, mind teljesítménye terén. A generatív képmodellek tanulságai lehetővé tették a kutatóknak és a fejlesztőknek, hogy előrehaladást érjenek el a generatív videomodellek terén, ami fokozott gyakorlatiasságot és valós alkalmazásokat eredményezett. A generatív videomodellek képességeinek javítására irányuló kutatások többsége azonban elsősorban az időbeli és térbeli rétegek pontos elrendezésére összpontosít, kevés figyelmet szentelve annak vizsgálatára, hogy a megfelelő adatok kiválasztása milyen hatással van e generatív modellek kimenetelére.

A generatív képmodellek által elért fejlődésnek köszönhetően a kutatók megfigyelték, hogy a képzési adatok eloszlásának hatása a generatív modellek teljesítményére valóban jelentős és vitathatatlan. Ezenkívül a kutatók azt is megfigyelték, hogy egy generatív képmodell előképzése egy nagy és változatos adatkészletre, majd egy kisebb adatkészletre jobb minőségű finomhangolása gyakran jelentősen javítja a teljesítményt. Hagyományosan a generatív videomodellek a sikeres generatív képmodellek tanulságait valósítják meg, és a kutatóknak még nem kell tanulmányozniuk az adatok hatását, a képzési stratégiákat pedig még tanulmányozni kell. A Stable Video Diffusion Model egy kísérlet a generatív videomodellek képességeinek fokozására azáltal, hogy korábban feltérképezetlen területekre merészkedik, különös tekintettel az adatok kiválasztására.

A legújabb generatív videómodellek diffúziós modellekre, valamint szövegkondicionálási vagy képkondicionálási megközelítésekre támaszkodnak, hogy több következetes videó- vagy képkockát szintetizáljanak. A diffúziós modellek arról ismertek, hogy képesek megtanulni, hogyan lehet fokozatosan zajtalanítani a mintát a normál eloszlásból egy iteratív finomítási folyamat végrehajtásával, és kívánatos eredményeket hoztak a nagy felbontású videó és a szöveg-kép szintézis terén. Ugyanezt az elvet alkalmazva a Stable Video Diffusion Model egy látens videodiffúziós modellt képez a videoadatkészletén, a generatív ellenséges hálózatok vagy GAN-ok használatával, sőt bizonyos mértékig autoregresszív modellekkel is.

A Stable Video Diffusion Model egyedi stratégiát követ, amelyet egyetlen generatív videomodell sem valósított meg, mivel a látens videó diffúziós alapvonalakra támaszkodik rögzített architektúrával, és egy rögzített képzési stratégiával, amelyet az adatok összegyűjtésének hatásának felmérése követ. A Stable Video Diffusion Model célja a következő hozzájárulás a generatív videó modellezés területén.

- Egy szisztematikus és hatékony adatkezelési munkafolyamat bemutatása annak érdekében, hogy a nem kurátoros videóminták nagy gyűjteményét jó minőségű adatkészletekké alakítsák, amelyeket aztán a generatív videómodellek használnak.

- A legkorszerűbb képek videóvá és szövegek videóvá alakítása, amelyek felülmúlják a meglévő kereteket.

- Domain-specifikus kísérletek végzése a 3D-s megértés és a modell mozgásának erős előzetes vizsgálata érdekében.

A Stable Video Diffusion Model most a látens videó diffúziós modellekből és az adatkezelési technikákból származó tanulságokat valósítja meg alapításának középpontjában.

Látens videó diffúziós modellek

A látens videó diffúziós modellek vagy videó-LDM-ek azt a megközelítést követik, hogy az elsődleges generatív modellt egy rejtett térben, csökkentett számítási bonyolultsággal tanítják, és a legtöbb Video-LDM előre betanított szöveg-kép modellt valósít meg, amelyhez időbeli keverési rétegek is hozzáadódnak az előképzésben. építészet. Ennek eredményeként a legtöbb videó látens diffúziós modell vagy csak az időbeli rétegeket képezi, vagy teljesen kihagyja a betanítási folyamatot, ellentétben a stabil videó diffúziós modellel, amely a teljes keretet finomhangolja. Továbbá a szöveg videó adatokká történő szintetizálásához a Stable Video Diffusion Model közvetlenül feltételeket szab egy szöveges promptra, és az eredmények azt mutatják, hogy az eredményül kapott keretrendszer könnyen finomhangolható többnézetű szintézissé vagy kép-videó modellé.

Adatkezelés

Az adatok kurálása nem csak a stabil videó diffúziós modellnek, hanem a generatív modellek egészének is nélkülözhetetlen összetevője, mivel elengedhetetlen a nagy modellek előképzése nagyméretű adatkészletekre a különböző feladatok teljesítményének növelése érdekében, beleértve a nyelvi modellezést vagy a megkülönböztető szöveg-képgenerálást. , és még sok más. A Data Curation-t sikeresen implementálták a generatív képmodelleken, kihasználva a hatékony nyelvi-képreprezentációs lehetőségeket, bár az ilyen megbeszélések soha nem összpontosítottak a generatív videómodellek fejlesztésére. A generatív videomodellek adatainak összegyűjtése során a fejlesztők számos akadállyal szembesülnek, és e kihívások kezelésére a Stable Video Diffusion Model háromlépcsős képzési stratégiát valósít meg, ami jobb eredményeket és jelentős teljesítménynövekedést eredményez.

Adatkezelés a kiváló minőségű videószintézishez

Amint azt az előző részben tárgyaltuk, a Stable Video Diffusion Model háromlépcsős képzési stratégiát valósít meg, ami jobb eredményeket és jelentős teljesítménynövekedést eredményez. Az I. szakasz egy kép előképzése szakasz, amely 2D szöveg-kép diffúziós modellt használ. A II. szakasz az videós előképzés amelyben a keretrendszer nagy mennyiségű videoadaton edz. Végül megvan a III. szakasz videó finomhangolás amelyben a modellt a kiváló minőségű és nagy felbontású videók egy kis részében finomítják.

Mielőtt azonban a Stable Video Diffusion Model megvalósítaná ezt a három szakaszt, létfontosságú az adatok feldolgozása és annotálása, mivel ezek a II. szakasz vagy a videó előképzési szakasz alapjául szolgálnak, és kritikus szerepet játszanak az optimális kimenet biztosításában. A maximális hatékonyság érdekében a keretrendszer először egy lépcsőzetes vágásérzékelési folyamatot valósít meg 3 különböző FPS vagy képkocka másodpercenkénti szinten, és ennek szükségességét a következő kép mutatja be.

Ezután a Stable Video Diffusion Model három különböző szintetikus feliratozási módszerrel megjegyzéseket fűz minden videokliphez. Az alábbi táblázat összehasonlítja a Stable Diffusion Frameworkben használt adatkészleteket a szűrési folyamat előtt és után.

I. szakasz: Képes előképzés

A Stable Video Diffusion Modelben megvalósított háromlépcsős folyamat első szakasza a kép előképzése, és ennek elérése érdekében a kezdeti Stable Video Diffusion Model keretrendszert egy előre betanított képdiffúziós modellre alapozzák, nevezetesen a Stabil diffúzió 2.1 modell, amely erősebb vizuális megjelenítésekkel látja el.

II. szakasz: Videós előképzés

A második szakasz a Video Pre-Training szakasz, és azokra az eredményekre épít, amelyek szerint az adatok kurátora a multimodális generatív képmodellekben gyakran jobb eredményeket és nagyobb hatékonyságot eredményez, valamint erőteljes diszkriminatív képgenerálást. Mivel azonban hiányoznak a nemkívánatos minták generatív videomodellek kiszűrésére szolgáló, hasonló, hatékony leképezések, a Stable Video Diffusion Model az emberi preferenciákra támaszkodik bemeneti jelként a keretrendszer előképzéséhez használt megfelelő adatkészlet létrehozásához. A következő ábra bemutatja a keretrendszer előzetes betanításának pozitív hatását egy kurált adatkészletre, amely segít a kisebb adatkészleteken végzett videó-előképzés általános teljesítményének növelésében.

Pontosabban szólva, a keretrendszer különböző módszereket használ a látens videó diffúzió részhalmazainak kurzálására, és figyelembe veszi az ezeken az adatkészleteken betanított LVD-modellek rangsorolását. Ezenkívül a Stable Video Diffusion keretrendszer azt is megállapította, hogy a kurált adatkészletek használata a keretrendszerek betanításához segít a keretrendszer és általában a diffúziós modellek teljesítményének növelésében. Ezenkívül az adatkezelési stratégia nagyobb, relevánsabb és nagyon praktikus adatkészleteken is működik. A következő ábra bemutatja a keretrendszer előzetes betanításának pozitív hatását egy kurált adatkészletre, amely segít a kisebb adatkészleteken végzett videó-előképzés általános teljesítményének növelésében.

III. szakasz: Kiváló minőségű finomhangolás

A II. szakaszig a Stable Video Diffusion keretrendszer a teljesítmény javítására összpontosít a videó előképzése előtt, a harmadik szakaszban pedig a keretrendszer a teljesítmény optimalizálására vagy további fokozására helyezi a hangsúlyt a kiváló minőségű videó finomhangolása után, és hogyan. keretben valósul meg a II. szakaszból a III. szakaszba való átmenet. A III. szakaszban a keretrendszer a látens kép diffúziós modellekből kölcsönzött képzési technikákra támaszkodik, és növeli a betanítási példák felbontását. E megközelítés hatékonyságának elemzéséhez a keretrendszer három azonos modellel hasonlítja össze, amelyek csak az inicializálásukban különböznek egymástól. Az első azonos modell súlyozása inicializálva van, és a videó betanítási folyamat kimarad, míg a fennmaradó két azonos modell a többi látens videó modelltől kölcsönzött súlyokkal inicializálódik.

Eredmények és megállapítások

Itt az ideje, hogy megnézzük, hogyan teljesít a Stable Video Diffusion keretrendszer a valós feladatoknál, és hogyan viszonyul a jelenlegi legkorszerűbb keretrendszerekhez. A Stable Video Diffusion keretrendszer először az optimális adatmegközelítést használja egy alapmodell betanításához, majd finomhangolást végez több korszerű modell létrehozásához, ahol minden modell egy adott feladatot lát el.

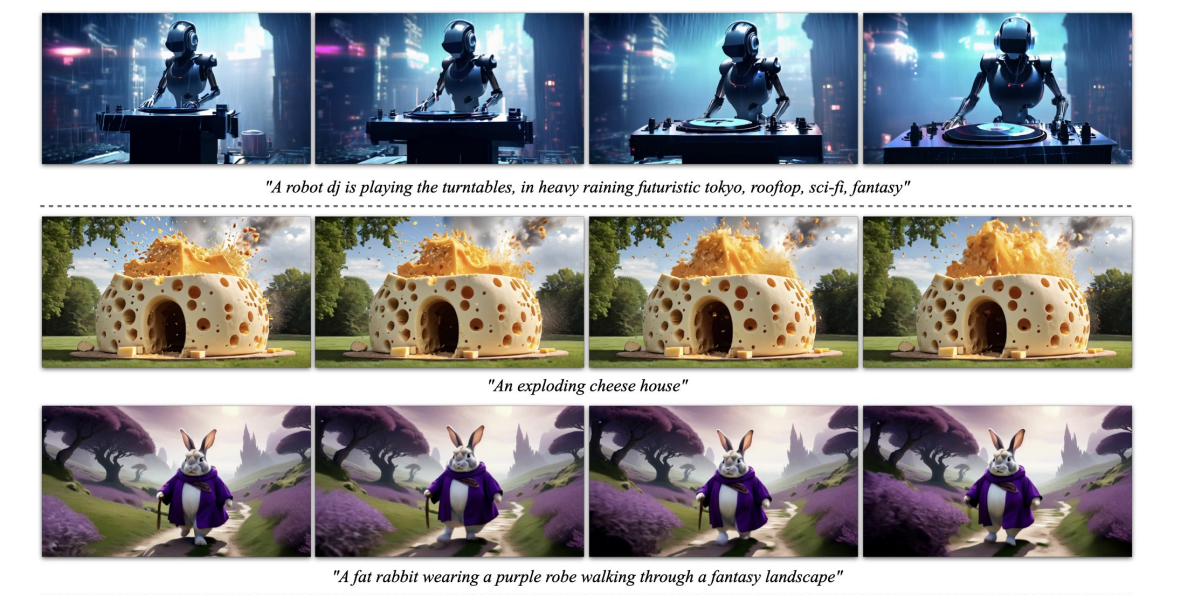

A fenti kép a keretrendszer által generált nagy felbontású képet és videómintákat ábrázolja, míg a következő ábra bemutatja a keretrendszer azon képességét, hogy kiváló minőségű szöveget generáljon videó mintákhoz.

Előképzett bázis Model

Amint arról korábban szó esett, a Stable Video Diffusion modell a Stable Diffusion 2.1 keretrendszerre épül, és a legújabb eredmények alapján a fejlesztők számára kulcsfontosságú volt a zaj ütemezésének elfogadása és a zaj növelése, hogy jobb felbontású képeket kaphassanak a képszórás képzése során. modellek. Ennek a megközelítésnek köszönhetően a Stable Video Diffusion alapmodell hatékony mozgásábrázolásokat tanul meg, és a folyamat során felülmúlja az alapmodelleket szöveget ide videó generálása nulla felvétel beállításban, és az eredmények a következő táblázatban jelennek meg.

Frame Interpolation és Multi-View Generation

A Stable Video Diffusion keretrendszer finomhangolja a képet videómodellre többnézetű adatkészleteken, hogy egy objektum több újszerű nézetét kapja meg, és ez a modell SVD-MV vagy Stable Video Diffusion-Multi View modellként ismert. Az eredeti SVD-modellt két adatkészlet segítségével finomhangolják oly módon, hogy a keretrendszer egyetlen képet ad be, és kimenetként többnézetű képek sorozatát adja vissza.

Amint az a következő képeken is látható, a Stable Video Diffusion Multi View keretrendszer a legkorszerűbb Scratch Multi View keretrendszerhez képest nagy teljesítményt nyújt, és az eredmények egyértelműen demonstrálják az SVD-MV azon képességét, hogy kihasználja a megszerzett tanulságokat. az eredeti SVD keretrendszerből a többnézetű képgeneráláshoz. Ezen túlmenően az eredmények azt is jelzik, hogy a modell viszonylag kisebb számú iterációval történő futtatása segít az optimális eredmények elérésében, ahogyan az SVD keretrendszerből finomhangolt modellek többségénél is.

A fenti ábrán a mutatók a bal oldalon láthatók, és amint látható, a Stable Video Diffusion Multi View keretrendszer megfelelő különbséggel felülmúlja a Scratch-MV és az SD2.1 Multi-View keretrendszert. A második kép a képzési iterációk számának a keretrendszer általános teljesítményére gyakorolt hatását mutatja be a Clip Score szempontjából, és az SVD-MV keretrendszerek fenntartható eredményeket biztosítanak.

Záró gondolatok

Ebben a cikkben a Stable Video Diffusion-ról beszéltünk, egy látens videó diffúziós modellről, amely képes nagy felbontású, legmodernebb kép-videó és szöveg-videó tartalom generálására. A Stable Video Diffusion Model egyedi stratégiát követ, amelyet egyetlen generatív videomodell sem valósított meg, mivel a látens videó diffúziós alapvonalakra támaszkodik rögzített architektúrával, és egy rögzített képzési stratégiával, amelyet az adatok összegyűjtésének hatásának felmérése követ.

Beszéltünk arról, hogy a 2D-s képek szintetizálására kiképzett látens diffúziós modellek hogyan javították a képek képességeit és hatékonyságát. generatív videó modellek időbeli rétegek hozzáadásával és a modellek finomhangolásával a kiváló minőségű videókat tartalmazó kis adatkészleteken. A képzés előtti adatok összegyűjtése érdekében a keretrendszer skálázási vizsgálatot végez, és szisztematikus adatgyűjtési gyakorlatokat követ, végül egy módszert javasol nagy mennyiségű videoadat kurzálására, és a zajos videókat generatív videomodellek számára alkalmas bemeneti adatokká alakítja.

Ezenkívül a Stable Video Diffusion keretrendszer három különálló videomodell képzési szakaszt alkalmaz, amelyeket egymástól függetlenül elemeznek, hogy felmérjék a keret teljesítményére gyakorolt hatásukat. A keretrendszer végső soron egy elég erős videó-reprezentációt ad ki ahhoz, hogy finomhangolja a modelleket az optimális videószintézis érdekében, és az eredmények összehasonlíthatók a már használatban lévő, korszerű videogenerációs modellekkel.