Des leaders d'opinion

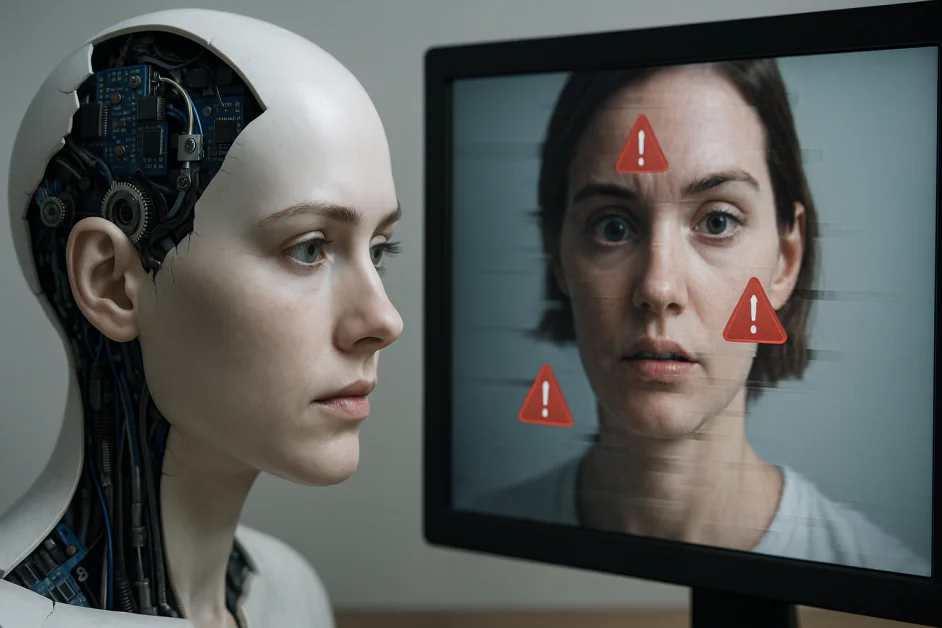

Pourquoi vos images IA comportent des erreurs et comment les améliorer

Les modèles de génération de texte en image pilotés par l'IA ont bouleversé l'art numérique et la création de contenu, permettant à tout utilisateur, quel que soit son parcours, de produire des visuels personnalisables de haute qualité avec seulement quelques mots en une fraction du temps qu'il faudrait à un professionnel humain utilisant des outils de conception ou de photo classiques.

Grâce aux avancées technologiques majeures, la créativité assistée par l'IA devient de plus en plus essentielle aux processus de travail de nombreux secteurs. Cependant, créer une œuvre commerciale avec l'IA ne se résume pas à appuyer sur un bouton magique, car son effet « voilà » ne produit pas toujours des résultats exploitables, surtout pour ceux qui comptent sur elle pour répondre aux normes professionnelles en matière de création artistique et de design.

En réalité, si la maîtrise de l'écriture rapide – le langage compris par l'IA – est la condition première pour obtenir un résultat conforme à sa vision créative, les images générées par l'IA peuvent néanmoins présenter des défauts frustrants, affectant non seulement les débutants, mais aussi les créateurs expérimentés. Surmonter ces difficultés requiert souvent des connaissances et des compétences supplémentaires de la part des utilisateurs et des développeurs.

Ci-dessous, je décrirai les défis les plus fréquents dans la génération d'images IA et partagerai des solutions pratiques pour les contourner.

Complexité de l'ingénierie rapide

L'attrait principal de Génération d'images IA transforme des idées en images presque instantanément, simplement avec des mots. Cependant, la complexité de ingénierie rapide constitue pourtant l'un des obstacles les plus importants à la production d'images significatives. Même de légères variations de formulation peuvent entraîner des résultats radicalement différents. La structure des invites peut également varier d'un modèle à l'autre, ce qui fonctionne bien dans l'un peut produire des résultats médiocres dans un autre. Ce manque de standardisation du langage des invites contraint souvent les utilisateurs à procéder par tâtonnements.

Les bibliothèques et bases de données d'invites simplifient la tâche en proposant des invites pré-testées auxquelles les utilisateurs peuvent se référer ou modifier selon leurs besoins. Les outils de création d'invites visuelles permettent aux utilisateurs de saisir des mots-clés de manière structurée, de sélectionner des attributs, d'ajuster des curseurs, etc., rendant ainsi la création d'une invite efficace plus intuitive. S'inspirer des invites réussies partagées par la communauté est également précieux, car ces exemples concrets illustrent ce qui fonctionne.

Pour améliorer la cohérence, des guides de syntaxe d'invite standardisés suggèrent les meilleures pratiques pour structurer les entrées de mots-clés entre différents modèles. L'utilisation de modèles d'invite favorise des résultats plus prévisibles, aidant les utilisateurs à générer plusieurs images avec un style cohérent. Les modèles émergents comme FLUX sont globalement plus conviviaux, car ils sont conçus pour être moins sensibles à la complexité des invites, ce qui permet aux utilisateurs de créer des scènes cohérentes et complexes à partir d'instructions plus simples.

Inexactitude anatomique

En raison de la façon dont les réseaux neuronaux apprennent à partir d'ensembles de données, les modèles de diffusion ne comprennent pas réellement l'anatomie : ils génèrent des images basées sur la reconnaissance de formes plutôt que sur un cadre biologique structuré. Par exemple, l'IA ne considère pas une main comme une composition de cinq doigts distincts pouvant s'articuler différemment. Elle combine plutôt les moyennes statistiques observées sur les images d'entraînement. Par conséquent, les écarts par rapport aux poses ou aux angles attendus peuvent entraîner des distorsions. Si les modèles modernes se sont considérablement améliorés, des anomalies telles que des doigts supplémentaires, des proportions faciales et corporelles anormales, des connexions et un placement articulaires irréalistes, ou encore des yeux asymétriques et mal alignés restent fréquents.

Modèles de réglage fin avec LoRas (technologie d'adaptation de bas rang) L'accent mis explicitement sur les ensembles de données anatomiques les aide à développer une compréhension plus complète de la structure humaine. Les ControlNets, notamment ceux utilisant l'estimation de pose ou la détection de contours (comme les filtres de Canny), permettent à l'IA de respecter les directives anatomiques.

Les invites faisant spécifiquement référence à des détails corporels réalistes peuvent également améliorer la précision anatomique des figures générées. Le post-traitement avec des outils de correction anatomique permet aux utilisateurs de corriger les zones défectueuses sans régénérer l'image entière.

Incohérence identitaire entre plusieurs générations

L'IA traitant chaque génération comme un processus indépendant, maintenir une apparence cohérente des personnages sur plusieurs images reste un défi, particulièrement problématique pour les œuvres narratives ou les séries, où la continuité des personnages est cruciale. Même en utilisant la même invite, de subtils changements de traits du visage, de vêtements ou de style peuvent apparaître entre les rendus. Le problème peut s'aggraver lors des générations par lots, où la qualité et les caractéristiques visuelles fluctuent de manière imprévisible.

Entraîner un LoRA sur un ensemble d'images d'une personne ou d'un objet spécifique, et utiliser une image de référence comme entrée, peut améliorer le conditionnement, la cohérence et l'uniformité de l'identité. Les techniques d'intégration et les adaptateurs (tels que PuLID, IPAdapter, InstantID et EcomID) contribuent à préserver les traits de caractère d'une génération à l'autre. Lorsque la précision faciale est essentielle, les modèles d'échange de visages ou le post-traitement offrent un affinement plus précis, garantissant que les caractéristiques clés restent identiques d'une génération à l'autre.

Incohérence du contexte

Les arrière-plans générés par l'IA sont sujets à des conceptions irréalistes et structurellement et contextuellement incohérentes, ce qui rend les images moins crédibles. Par exemple, la perspective peut sembler décalée, ou l'éclairage et les ombres peuvent ne pas correspondre au sujet. Cela se produit car les modèles de diffusion perçoivent l'arrière-plan comme un élément secondaire plutôt que comme une partie intégrante de la scène, ce qui entraîne des problèmes de perception de la profondeur, de corrélation des objets et de contexte environnemental.

Cartographie de profondeur Aide les modèles à interpréter les relations spatiales avec plus de précision, facilitant une intégration plus réaliste entre le premier plan et l'arrière-plan. Les guides de perspective renforcent l'alignement géométrique, contribuant ainsi à la cohérence des structures architecturales et des points de fuite. Le rééclairage ciblé LoRa peut apprendre à générer des lumières et des ombres en fonction de l'arrière-plan, garantissant ainsi un comportement naturel des reflets dans toute la scène.

L'affinement des modèles sur des ensembles de données présentant des paramètres spécifiques (comme des paysages urbains, des scènes de nature ou des espaces intérieurs) peut améliorer le réalisme global de l'arrière-plan. Les images d'arrière-plan de référence contribueront également à ancrer la génération dans des compositions du monde réel.

Problèmes de rendu de texte

Entraînée principalement sur des données visuelles et non sur un langage structuré, l'IA peine à générer des mots et des phrases lisibles dans l'image. Le texte peut paraître incomplet, confus, confus ou absurde, avec des polices irrégulières ou un placement mal aligné. Même lisible, il peut néanmoins paraître décalé ou mal intégré à l'arrière-plan.

Contrairement aux humains, la plupart des modèles d'IA ne distinguent pas le texte des éléments environnants et ne le traitent donc pas comme une entité distincte. Ils considèrent plutôt les séquences de caractères comme un autre motif visuel composé de formes abstraites plutôt que comme des symboles sémantiques significatifs.

Pour améliorer la qualité du rendu du texte, les chercheurs entraînent les modèles sur des ensembles de données textuelles spécialisés contenant des exemples typographiques correctement étiquetés, ce qui aide l'IA à mieux comprendre la formation, l'alignement et l'espacement des lettres. Le masquage sensible au texte est une autre technique efficace lorsque des zones vides sont réservées au texte lors de la génération d'images, permettant une intégration plus nette en post-traitement.

Manque de contrôle sur la production

Bien que les résultats puissent être visuellement impressionnants, une limitation importante de la génération d'images par IA provient du manque de contrôle précis sur le résultat final. Les utilisateurs peuvent avoir du mal à orienter le modèle vers des styles spécifiques, à garantir le réalisme ou à peaufiner les détails. Parmi les autres erreurs courantes, on trouve des éléments inattendus dans la scène, des couleurs perturbant l'ambiance et des incohérences de mise en page. Contrairement aux artistes humains, qui s'adaptent intentionnellement, l'IA fonctionne de manière probabiliste, produisant parfois des résultats surprenants ou indésirables.

Des mécanismes de contrôle, tels que ControlNets et LoRa, permettent aux utilisateurs de conditionner la structure par le biais de la pose, de la profondeur ou du guidage des bords. Pour une orientation esthétique plus précise, des modèles personnalisés, entraînés sur des styles particuliers, peuvent améliorer considérablement la cohérence de la direction artistique. De plus, le référencement d'une image spécifique par génération image à image contribue à préserver la pertinence du résultat.

Les outils de masquage et de retouche permettent de modifier des parties spécifiques d'une image sans affecter le reste. Les outils de post-traitement, tels que les convertisseurs ascendants et les optimiseurs, peuvent apporter la touche finale aux résultats IA en améliorant la résolution et la clarté.

Globalement, l'IA doit encore développer une interprétation plus sophistiquée et nuancée des instructions, un défi majeur pour garder le contrôle. De nombreux modèles ont tendance à surinterpréter les instructions, tentant d'extraire des significations profondes ou complexes là où elles ne sont pas prévues. Bien que cela paraisse intelligent, même une instruction détaillée peut produire des résultats imprévisibles. Par exemple, l'IA peut mettre en avant ou inventer des éléments inattendus en fonction des associations apprises. Cela complexifie la création d'instructions, obligeant les utilisateurs à s'adapter au mode de pensée du modèle (qui n'est pas toujours intuitif) et à passer plus de temps à expérimenter différentes formulations pour obtenir le résultat souhaité.

Réflexions finales

Comprendre comment l'IA interprète les données visuelles et identifier ses faiblesses permet de faire des choix plus judicieux en matière de rédaction rapide, d'utiliser des stratégies efficaces de résolution de problèmes et de sélectionner les outils adaptés pour contourner les erreurs de génération. En fin de compte, cela permet aux utilisateurs de travailler avec l'IA comme un partenaire créatif, plutôt que de compter sur la chance ou de considérer ses limites techniques comme des obstacles à la création de contenu exploitable reflétant fidèlement la vision du créateur.