Des leaders d'opinion

Ce que tout data scientist devrait savoir sur les transformateurs de graphes et leur impact sur les données structurées

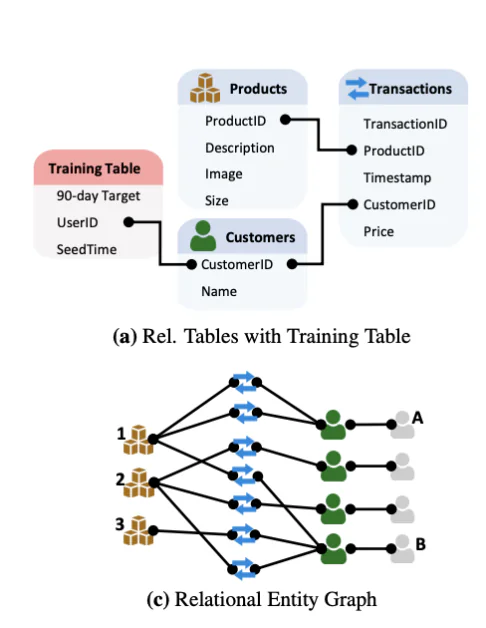

J'ai co-créé les réseaux de neurones graphes à Stanford. J'ai très tôt compris l'incroyable puissance de cette technologie. Chaque point de donnée, chaque observation, chaque élément de connaissance n'existe pas isolément ; il fait partie d'un graphe connecté à d'autres éléments de connaissance. Il est important de noter que la plupart des données commerciales précieuses, souvent stockées sous forme de tables dans des bases de données et des entrepôts de données, peuvent naturellement être représentées sous forme de graphiqueExploiter cette structure relationnelle est essentiel pour créer des modèles d’IA précis et non hallucinants.

Les réseaux de neurones graphes (GNN) ont introduit des architectures de transmission de messages capables de raisonner sur des graphes capturant les connexions entre les éléments de connaissance. Mais tout comme les Transformers ont transformé la compréhension du langage, une nouvelle classe de modèles, les Graph Transformers, apporte des gains similaires aux données basées sur des graphes. Ces modèles combinent la flexibilité des mécanismes d'attention avec des priors de graphes structurels pour modéliser des relations complexes plus efficacement que leurs prédécesseurs GNN.

Pourquoi les graphiques nécessitent plus que la transmission de messages

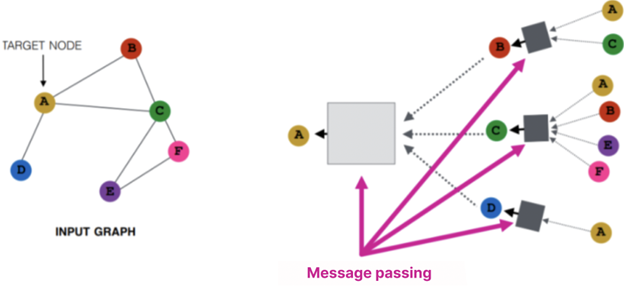

Les réseaux neuronaux graphiques traditionnels (GNN) s'appuient sur message passant, un processus où chaque nœud met à jour son état interne en agrégeant les informations de ses voisins. Imaginez que chaque nœud échange des résumés avec les nœuds voisins, puis utilise ces résumés pour affiner sa propre compréhension. Sur plusieurs couches, cela permet à l'information de se propager à travers le graphe.

Bien que puissant pour apprendre les modèles locaux, le passage de messages présente des limites importantes :

- Surécrasement:L'agrégation des informations sur plusieurs sauts peut entraîner leur compression, entraînant une perte de détails significatifs. Ce phénomène est particulièrement problématique dans les réseaux GNN profonds.

- Contexte limité:Le passage de messages standard ne peut pas facilement capturer les dépendances à longue portée sans de nombreuses couches, ce qui augmente la complexité et le bruit.

- Expressivité:De nombreuses structures graphiques ne peuvent pas être différenciées en utilisant uniquement les informations de voisinage local, ce qui limite les performances du modèle sur les tâches nécessitant des distinctions structurelles fines.

C'est là qu'interviennent les transformateurs de graphes. En remplaçant ou en complétant la transmission des messages par des mécanismes d'attention, ils permettent à chaque nœud de s'occuper directement des autres (même distants) en fonction de leur importance acquise. Il en résulte des représentations plus riches, une meilleure évolutivité et une capacité à raisonner sur des structures complexes avec plus de flexibilité.

Des GNN aux transformateurs de graphes

Le modèle original du Transformer, présenté dans le document emblématique, L'attention est tout ce dont vous avez besoin, a été conçu pour modéliser les relations entre les jetons d'une séquence. Son succès repose sur l'auto-attention, un mécanisme qui permet à chaque entrée de prendre en compte toutes les autres, pondérées par la pertinence acquise.

Transformateurs de graphiques Adaptez ce paradigme en permettant aux nœuds de prêter attention non seulement à leurs voisins, mais aussi à n'importe quel nœud du graphe, soit par une attention entièrement connectée, soit par une approche hybride équilibrant les signaux globaux et locaux. Le défi consiste à introduire une notion de structure dans un modèle conçu pour les séquences non structurées.

Codages positionnels spécifiques aux graphes

Contrairement au texte, les graphiques n’ont pas d’ordre inhérent, ce qui encodage positionnel, qui fait référence aux techniques d'injection d'informations structurelles ou géolocalisées dans un modèle, non triviales. Les transformateurs de graphes abordent ce problème avec différentes méthodes :

- Vecteurs propres laplaciens : dérivés de la matrice laplacienne du graphe, ils fournissent une intégration spectrale qui capture la structure globale.

- Marches aléatoires : capturez la probabilité de traverser d’un nœud à un autre sur plusieurs sauts.

- Codages structurels : inclure des mesures de distance, des degrés de nœud ou des types d’arêtes.

Ces codages positionnels, qu'ils soient spectraux, probabilistes ou structurels, permettent aux transformateurs de graphes de comprendre la position de chaque nœud dans le graphe global. Cette connaissance structurelle est essentielle pour permettre aux mécanismes d'attention de fonctionner efficacement sur des données irrégulières et non ordonnées, permettant ainsi au modèle de capturer des relations invisibles à des méthodes plus simples et purement locales.

Mises en œuvre et cas d'utilisation réels

La mise en production de Graph Transformers nécessite une infrastructure capable de s'adapter aux volumes de données réels. Des bibliothèques comme PyTorch Géométrique (PyG) C'est ce que nous faisons. Basé sur PyTorch, PyG offre un cadre modulaire pour l'implémentation de réseaux neuronaux de neurones et de transformateurs de graphes dans diverses applications, de la modélisation moléculaire aux systèmes de recommandation. Il prend en charge l'apprentissage par mini-lots sur de nombreux petits graphes comme sur de grands graphes uniques, avec prise en charge multi-GPU et torch.compile, ce qui le rend parfaitement adapté aux flux de travail de recherche et d'entreprise.

Ces outils alimentent déjà un large éventail d'applications concrètes. Dans la découverte de médicaments, les transformateurs de graphes permettent de prédire les propriétés moléculaires en modélisant les interactions atomiques sous forme de graphes. Dans la logistique et l'optimisation de la chaîne d'approvisionnement, ils peuvent représenter et analyser des réseaux dynamiques d'expéditions, d'entrepôts et d'itinéraires. Les entreprises de e-commerce les utilisent pour améliorer leurs recommandations en comprenant les comportements d'achat et de navigation des produits sous forme de graphes relationnels. Enfin, en cybersécurité, les modèles basés sur des graphes permettent de détecter les anomalies en analysant les schémas d'accès, la topologie du réseau et les séquences d'événements.

Dans chacun de ces contextes, la capacité d’apprendre à partir de structures complexes et interconnectées, sans s’appuyer uniquement sur des fonctionnalités artisanales, s’avère être un avantage majeur.

Considérations techniques

Malgré leur potentiel, les transformateurs de graphes impliquent de réels compromis techniques. L'auto-attention totale évolue de manière quadratique avec le nombre de nœuds, ce qui fait de la mémoire et de l'efficacité de calcul des préoccupations majeures, notamment pour les graphes denses ou de grande taille. De nombreux graphes réels présentent également des arêtes directionnelles, introduisant des asymétries qui compliquent le codage des informations structurelles. De plus, dans les déploiements pratiques, les entrées sont rarement uniformes : combiner des données structurées en graphes avec du texte, des séries chronologiques ou des images exige des choix architecturaux judicieux et un prétraitement des données rigoureux.

Ces défis ne sont pas insurmontables, mais ils nécessitent une conception réfléchie du système, en particulier lors de la transition des prototypes de recherche aux modèles prêts pour la production.

Et ensuite : les LLM rencontrent les graphistes

L'intégration de grands modèles de langage (MLL) aux structures graphiques est un axe de recherche majeur. Ces systèmes hybrides utilisent les MLL pour encoder le contexte textuel ou extraire des entités, puis ancrent ces informations dans un graphe à des fins de raisonnement et de prise de décision.

En biologie, cela a alimenté des outils comme AlphaFoldDans l'IA d'entreprise, elle permet de mettre en place des systèmes de support client combinant documentation et graphiques comportementaux. Les transformateurs de graphes jouent également un rôle croissant en permettant aux agents IA de prendre des décisions plus judicieuses et plus exploitables, en leur permettant de raisonner sur des représentations d'état structurées et de hiérarchiser les interactions de manière dynamique. Cette fusion aide les agents à mieux comprendre les relations hiérarchiques, à suivre les dépendances au fil du temps et à adapter leur comportement dans des environnements complexes.

Le domaine est encore émergent, mais le potentiel est important.

Conclusion

Les transformateurs de graphes ne sont pas seulement la nouvelle génération de réseaux de neurones artificiels (GNN) ; ils représentent une convergence d'attention, de structure et d'évolutivité. Que vous travailliez dans la finance, les sciences de la vie ou les systèmes de recommandation, le message est clair : vos données forment un graphe, et vos modèles doivent en faire autant.