Intelligence artificielle

Supercharger les réseaux de neurones graphiques avec des modèles de langage à grande échelle : Le guide ultime

Les graphes sont des structures de données qui représentent des relations complexes dans une large gamme de domaines, notamment les réseaux sociaux, les bases de connaissances, les systèmes biologiques et bien d’autres. Dans ces graphes, les entités sont représentées sous forme de nœuds et leurs relations sont représentées sous forme d’arêtes.

La capacité à représenter et à raisonner efficacement sur ces structures relationnelles complexes est cruciale pour permettre des progrès dans des domaines tels que la science des réseaux, la chimie informatique et les systèmes de recommandation.

Les réseaux de neurones graphiques (GNN) sont apparus comme un puissant cadre d’apprentissage profond pour les tâches d’apprentissage automatique sur les graphes. En incorporant la topologie du graphe dans l’architecture du réseau de neurones via l’agrégation de voisinage ou les convolutions de graphe, les GNN peuvent apprendre des représentations vectorielles de faible dimension qui codent à la fois les caractéristiques des nœuds et leurs rôles structurels. Cela permet aux GNN d’atteindre des performances de pointe sur des tâches telles que la classification de nœuds, la prédiction de liens et la classification de graphes dans divers domaines d’application.

Bien que les GNN aient entraîné des progrès importants, certains défis clés persistent. L’obtention de données étiquetées de haute qualité pour la formation de modèles de GNN supervisés peut être coûteuse et chronophage. De plus, les GNN peuvent avoir du mal avec des structures de graphes hétérogènes et des situations où la distribution du graphe au moment du test diffère considérablement des données de formation (généralisation hors distribution).

En parallèle, les grands modèles de langage (LLM) comme GPT-4 et LLaMA ont pris le monde d’assaut avec leurs incroyables capacités de compréhension et de génération de langage naturel. Formés sur des corpus de texte massifs avec des milliards de paramètres, les LLM présentent des capacités d’apprentissage à quelques exemples remarquables, de généralisation entre les tâches et de raisonnement de bon sens qui étaient autrefois considérées comme extrêmement difficiles pour les systèmes d’IA.

Le succès considérable des LLM a catalysé l’exploration de leur utilisation pour les tâches d’apprentissage automatique sur les graphes. D’une part, les capacités de connaissance et de raisonnement des LLM présentent des opportunités pour améliorer les modèles de GNN traditionnels. D’autre part, les représentations structurées et les connaissances factuelles inhérentes aux graphes pourraient être instrumentales pour résoudre certaines limitations clés des LLM, telles que les hallucinations et le manque d’interprétabilité.

Réseaux de neurones graphiques et apprentissage auto-supervisé

Pour fournir le contexte nécessaire, nous allons d’abord passer en revue brièvement les concepts et les méthodes fondamentaux dans les réseaux de neurones graphiques et l’apprentissage de représentation de graphe auto-supervisé.

Architectures de réseaux de neurones graphiques

Architecture de réseau de neurones graphique – source

La principale distinction entre les réseaux de neurones profonds traditionnels et les GNN réside dans leur capacité à fonctionner directement sur des données structurées sous forme de graphe. Les GNN suivent un schéma d’agrégation de voisinage, où chaque nœud agrège des vecteurs de caractéristiques de ses voisins pour calculer sa propre représentation.

De nombreuses architectures de GNN ont été proposées avec différentes instances des fonctions de message et de mise à jour, telles que Graph Convolutional Networks (GCN), GraphSAGE, Graph Attention Networks (GAT) et Graph Isomorphism Networks (GIN) entre autres.

Plus récemment, les transformateurs de graphes ont gagné en popularité en adaptant le mécanisme d’auto-attention des transformateurs de langage naturel pour fonctionner sur des données structurées sous forme de graphe. Certains exemples incluent GraphormerTransformer et GraphFormers. Ces modèles sont capables de capturer des dépendances à longue portée à travers le graphe mieux que les GNN purement basés sur le voisinage.

Apprentissage auto-supervisé sur les graphes

Bien que les GNN soient des modèles de représentation puissants, leur performance est souvent limitée par le manque de grands ensembles de données étiquetées nécessaires pour la formation supervisée. L’apprentissage auto-supervisé est apparu comme un paradigme prometteur pour pré-former les GNN sur des données de graphe non étiquetées en exploitant des tâches de prétexte qui ne nécessitent que la structure de graphe intrinsèque et les caractéristiques des nœuds.

Certaines tâches de prétexte couramment utilisées pour la pré-formation de GNN auto-supervisées incluent :

- Prédiction de propriétés de nœuds : Masquer ou corrompre aléatoirement une partie des attributs/caractéristiques des nœuds et charger le GNN de les reconstruire.

- Prédiction de liens : Apprendre à prédire si un lien existe entre une paire de nœuds, souvent sur la base d’un masquage aléatoire de liens.

- Apprentissage contrastif : Maximiser les similarités entre les vues de graphe du même échantillon de graphe tout en éloignant les vues de différents graphes.

- Maximisation de l’information mutuelle : Maximiser l’information mutuelle entre les représentations locales de nœuds et une représentation cible comme l’incrustation de graphe global.

Des tâches de prétexte comme celles-ci permettent au GNN d’extraire des modèles structurels et sémantiques significatifs à partir des données de graphe non étiquetées pendant la pré-formation. Le GNN pré-formé peut ensuite être affiné sur des sous-ensembles étiquetés relativement petits pour exceller dans diverses tâches en aval comme la classification de nœuds, la prédiction de liens et la classification de graphes.

En exploitant l’auto-supervision, les GNN pré-formés sur de grands ensembles de données non étiquetées présentent une meilleure généralisation, une robustesse aux décalages de distribution et une efficacité par rapport à la formation à partir de zéro. Cependant, certaines limitations clés des méthodes de GNN auto-supervisées traditionnelles persistent, que nous allons explorer en utilisant les LLM pour les résoudre ensuite.

Améliorer l’apprentissage de graphe avec les grands modèles de langage

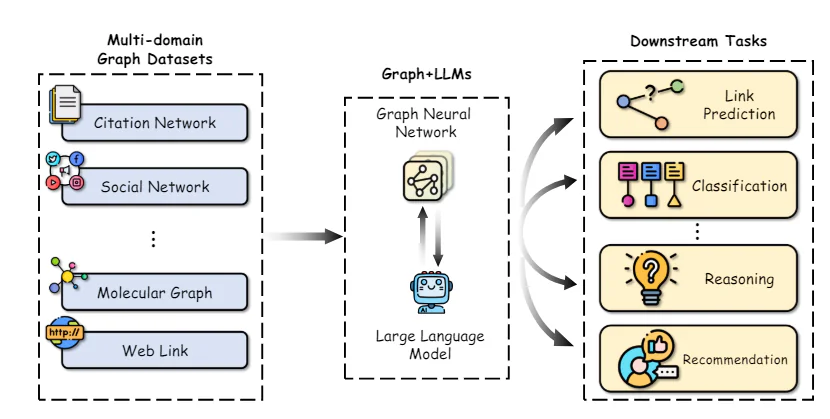

Intégration de graphes et LLM – source

Les capacités remarquables des LLM dans la compréhension du langage naturel, le raisonnement et l’apprentissage à quelques exemples présentent des opportunités pour améliorer de nombreux aspects des pipelines d’apprentissage de graphe. Nous explorons certaines directions de recherche clés dans cet espace :

Un défi clé dans l’application des GNN est l’obtention de représentations de caractéristiques de haute qualité pour les nœuds et les arêtes, en particulier lorsqu’ils contiennent des attributs textuels riches comme des descriptions, des titres ou des résumés. Traditionnellement, des modèles d’incrustation de mots pré-formés ou simples ont été utilisés, qui capturent souvent mal les sémantiques nuancées.

Des travaux récents ont démontré le pouvoir d’utiliser de grands modèles de langage comme encodeurs de texte pour construire de meilleures représentations de caractéristiques de nœuds et d’arêtes avant de les passer au GNN. Par exemple, Chen et al. utilisent des LLM comme GPT-3 pour encoder les attributs textuels des nœuds, montrant des gains de performance significatifs par rapport aux modèles d’incrustation de mots traditionnels sur les tâches de classification de nœuds.

Au-delà de meilleurs encodeurs de texte, les LLM peuvent être utilisés pour générer des informations complémentaires à partir des attributs textuels d’origine de manière semi-supervisée. TAPE génère des étiquettes ou des explications potentielles pour les nœuds en utilisant un LLM et les utilise comme caractéristiques complémentaires. KEA extrait des termes des attributs textuels en utilisant un LLM et obtient des descriptions détaillées pour ces termes pour compléter les caractéristiques.

En améliorant la qualité et l’expressivité des caractéristiques d’entrée, les LLM peuvent transmettre leurs capacités supérieures de compréhension du langage naturel aux GNN, améliorant ainsi les performances sur les tâches en aval.