Leaders d’opinion

Ce que tout data scientist devrait savoir sur les Graph Transformers et leur impact sur les données structurées

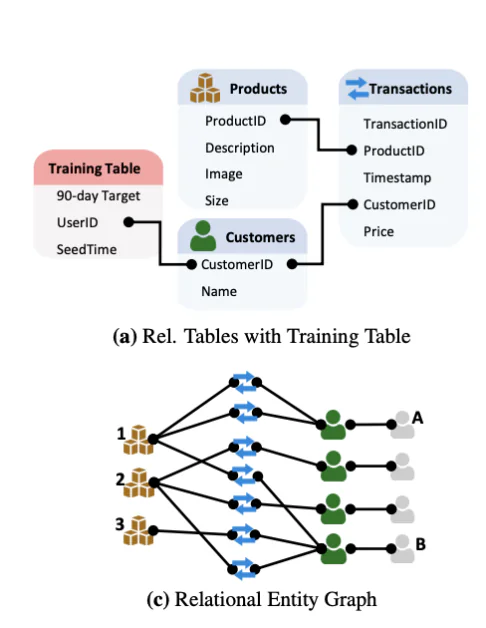

J’ai co-créé les Graph Neural Networks alors que j’étais à Stanford. J’ai reconnu dès le départ que cette technologie était incroyablement puissante. Chaque point de données, chaque observation, chaque pièce de connaissance n’existe pas en isolation ; elle fait partie d’un graphique connecté à d’autres pièces de connaissance. Importamment, la plupart des données commerciales les plus précieuses, souvent stockées sous forme de tableaux dans des bases de données et des entrepôts de données, peuvent naturellement être représentées sous forme de graphique. Exploiter cette structure relationnelle est clé pour construire des modèles d’IA précis et non hallucinants.

Les graph neural networks (GNNs) ont introduit des architectures de transmission de messages qui pouvaient raisonner sur des graphiques en capturant les connexions entre les pièces de connaissance. Mais tout comme les Transformers ont transformé la compréhension du langage, une nouvelle classe de modèles, les Graph Transformers, apporte des gains similaires aux données basées sur des graphiques. Ces modèles combinent la flexibilité des mécanismes d’attention avec des a priori de graphique structurel pour modéliser des relations complexes plus efficacement que leurs prédécesseurs GNN.

Pourquoi les graphiques nécessitent plus que la transmission de messages

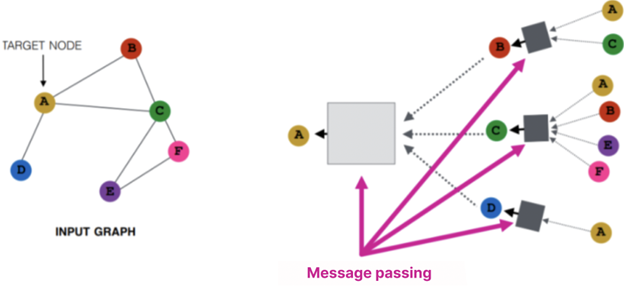

Les graph neural networks (GNNs) traditionnels s’appuient sur la transmission de messages, un processus où chaque nœud met à jour son état interne en agrégeant des informations de ses voisins. Pensez-y comme chaque nœud échangeant des résumés avec des nœuds à proximité, puis utilisant ces résumés pour affiner sa propre compréhension. Sur plusieurs couches, cela permet à l’information de se propager à travers le graphique.

Bien que puissant pour apprendre des modèles locaux, la transmission de messages a des limites importantes :

- Surchauffe : Lorsque les informations sont agrégées sur de nombreuses étapes, elles peuvent devenir compressées, perdant des détails significatifs. C’est particulièrement problématique dans les GNNs profonds.

- Contexte limité : La transmission de messages standard ne peut pas facilement capturer les dépendances à longue portée sans de nombreuses couches, ce qui augmente la complexité et le bruit.

- Expressivité : De nombreuses structures de graphique ne peuvent pas être différenciées en utilisant uniquement des informations de voisinage local, limitant les performances du modèle sur les tâches nécessitant des distinctions structurelles fines.

C’est là que les Graph Transformers interviennent. En remplaçant ou en complétant la transmission de messages par des mécanismes d’attention, ils permettent à chaque nœud de s’attacher directement à d’autres nœuds (même éloignés) en fonction de l’importance apprise. Le résultat est des représentations plus riches, une meilleure évolutivité et la capacité de raisonner sur des structures complexes de manière plus flexible.

Des GNNs aux Graph Transformers

Le modèle Transformer original, introduit dans l’article emblématique, Attention Is All You Need, a été conçu pour modéliser les relations entre les jetons dans une séquence. Son succès réside dans l’auto-attention, un mécanisme qui permet à chaque entrée de considérer chaque autre entrée, pondérée par la pertinence apprise.

Graph Transformers adaptent ce paradigme en permettant aux nœuds de s’attacher non seulement à leurs voisins mais à tout nœud du graphique, soit par une attention entièrement connectée, soit par une approche hybride qui équilibre les signaux globaux et locaux. Le défi consiste à introduire une notion de structure dans un modèle conçu pour des séquences non structurées.

Codages positionnels spécifiques au graphique

Contrairement au texte, les graphiques n’ont pas d’ordre inhérent, ce qui rend le codage positionnel, qui fait référence aux techniques d’injection d’informations structurelles ou de localisation dans un modèle, non trivial. Les Graph Transformers abordent cela avec diverses méthodes :

- Laplacien des vecteurs propres : Dérivés de la matrice laplacienne du graphique, ceux-ci fournissent une embedding spectrale qui capture la structure globale.

- Marches aléatoires : Capture la probabilité de parcourir d’un nœud à un autre sur plusieurs étapes.

- Codages structurels : Incluent des métriques de distance, des degrés de nœud ou des types de bord.

Ces codages positionnels, qu’ils soient spectraux, probabilistes ou structurels, donnent aux Graph Transformers un moyen de comprendre où chaque nœud se situe dans le graphique plus large. Cette prise de conscience structurelle est essentielle pour permettre aux mécanismes d’attention de fonctionner de manière significative sur des données irrégulières et non ordonnées, permettant finalement au modèle de capturer des relations qui seraient invisibles pour des méthodes plus simples et purement locales.

Mises en œuvre et cas d’utilisation dans le monde réel

Intégrer les Graph Transformers dans la production nécessite une infrastructure capable de gérer des tailles de données réelles. Des bibliothèques comme PyTorch Geometric (PyG) le rendent possible. Basé sur PyTorch, PyG fournit un cadre modulaire pour mettre en œuvre des GNNs et des Graph Transformers dans une gamme d’applications, des modèles de molécules aux systèmes de recommandation. Il prend en charge la formation en mini-lots sur de nombreux petits graphiques et un seul grand graphique, avec une prise en charge multi-GPU et torch.compile, ce qui le rend bien adapté aux flux de travail de recherche et d’entreprise.

Ces outils sont déjà utilisés pour alimenter une large gamme d’applications dans le monde réel. Dans la découverte de médicaments, les Graph Transformers aident à prédire les propriétés moléculaires en modélisant les interactions atomiques sous forme de graphiques. Dans l’optimisation logistique et de la chaîne d’approvisionnement, ils peuvent représenter et raisonner sur des réseaux dynamiques d’expéditions, d’entrepôts et d’itinéraires. Les entreprises de commerce électronique les utilisent pour améliorer les recommandations en comprenant le comportement de copurchase et de navigation en tant que graphiques relationnels. Et dans la cybersécurité, les modèles basés sur des graphiques sont utilisés pour détecter les anomalies en analysant les modèles d’accès, la topologie du réseau et les séquences d’événements.

Dans chacun de ces contextes, la capacité à apprendre à partir de structures complexes et interconnectées, sans s’appuyer uniquement sur des fonctionnalités conçues à la main, s’avère être un avantage majeur.

Considérations techniques

Malgré leur potentiel, les Graph Transformers comportent des compromis d’ingénierie réels. L’auto-attention complète augmente quadratiquement avec le nombre de nœuds, ce qui rend l’efficacité de la mémoire et du calcul une préoccupation majeure, en particulier pour des graphiques de grande taille ou denses. De nombreux graphiques du monde réel ont également des arêtes directionnelles, introduisant des asymétries qui compliquent la manière dont les informations structurelles sont encodées. Et dans les déploiements pratiques, les entrées sont rarement uniformes : combiner des données structurées sous forme de graphique avec du texte, des séries chronologiques ou des images exige des choix architecturaux soigneux et un prétraitement de données robuste.

Ces défis ne sont pas insurmontables, mais ils nécessitent une conception de système réfléchie, en particulier lors de la transition de prototypes de recherche à des modèles prêts pour la production.

Que vient-il ensuite : LLMs rencontrent les graphiques

Une direction majeure de recherche est l’intégration de grands modèles de langage (LLMs) avec des structures de graphique. Ces systèmes hybrides utilisent des LLMs pour encoder le contexte textuel ou extraire des entités, puis ancrer ces informations dans un graphique pour la prise de décision et la raisonnement.

En biologie, cela a alimenté des outils comme AlphaFold. Dans l’IA d’entreprise, cela permet des systèmes de support client qui combinent la documentation et les graphiques de comportement. Les Graph Transformers jouent également un rôle croissant dans la capacité des agents d’IA à prendre des décisions plus intelligentes et plus actionnables en leur permettant de raisonner sur des représentations d’état structurées et de prioriser les interactions de manière dynamique. Cette fusion aide les agents à mieux comprendre les relations hiérarchiques, à suivre les dépendances dans le temps et à adapter leur comportement dans des environnements complexes.

Le domaine est encore émergent, mais le potentiel est considérable.

Conclusion

Les Graph Transformers ne sont pas seulement l’itération suivante des GNNs ; ils représentent une convergence de l’attention, de la structure et de l’évolutivité. Que vous travailliez dans la finance, les sciences de la vie ou les systèmes de recommandation, le message est clair : vos données forment un graphique, vos modèles devraient donc aussi le faire.