Angle d’Anderson

Préparation à la publicité dans les grands modèles de langage

De nouvelles recherches montrent comment les publicités pourraient bientôt être intégrées directement dans les réponses de type ChatGPT – non sous forme de bannières ou de fenêtres contextuelles, mais tissées dans la réponse elle-même. Un nouveau référentiel teste à quel point ces réponses avec publicités intégrées peuvent rester utiles, crédibles et rentables, et peut nécessiter un compromis entre une expérience utilisateur acceptable et des clics.

Alors que la popularité généralisée et croissante des grands modèles de langage mine les méthodes publicitaires traditionnelles qui ont alimenté Internet depuis presque son origine, quiconque familiarisé avec les tactiques de capture de marché des capitalistes d’investissement se demandera combien de temps encore les chatbots IA pourront s’abstenir d’inclure du contenu publicitaire dans leurs réponses.

Comme Netflix et une liste de plus en plus longue de services de streaming démontrent, la stratégie traditionnelle de l’ère du câble consistant à combiner des abonnements payants avec des publicités intégrées (souvent justifiée comme un moyen de réduire les coûts pour les consommateurs) regagne de l’élan ; et le passage à l’intégration de publicités directement dans les sorties de LLM commence à apparaître moins spéculatif et plus comme un adoptant naturel de ce modèle.

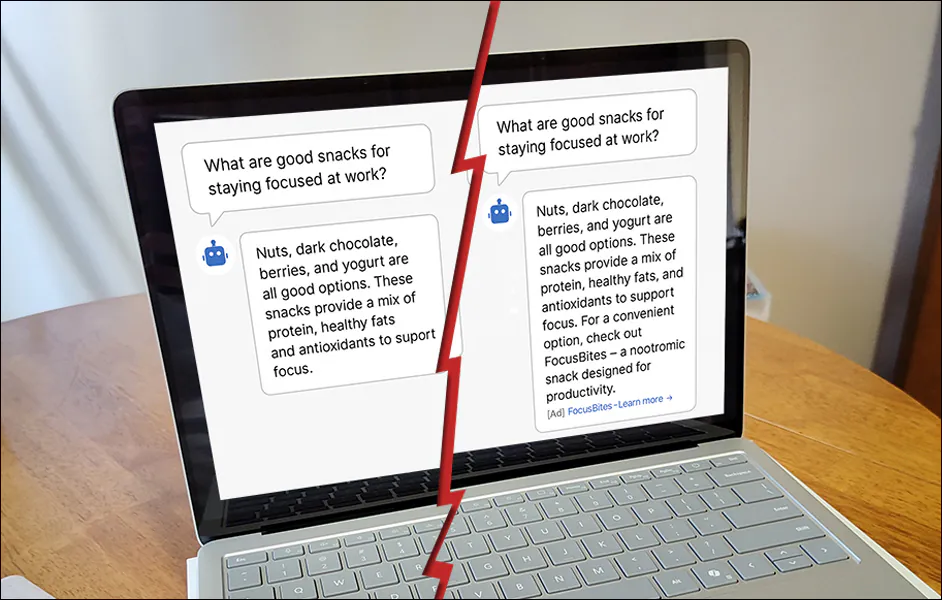

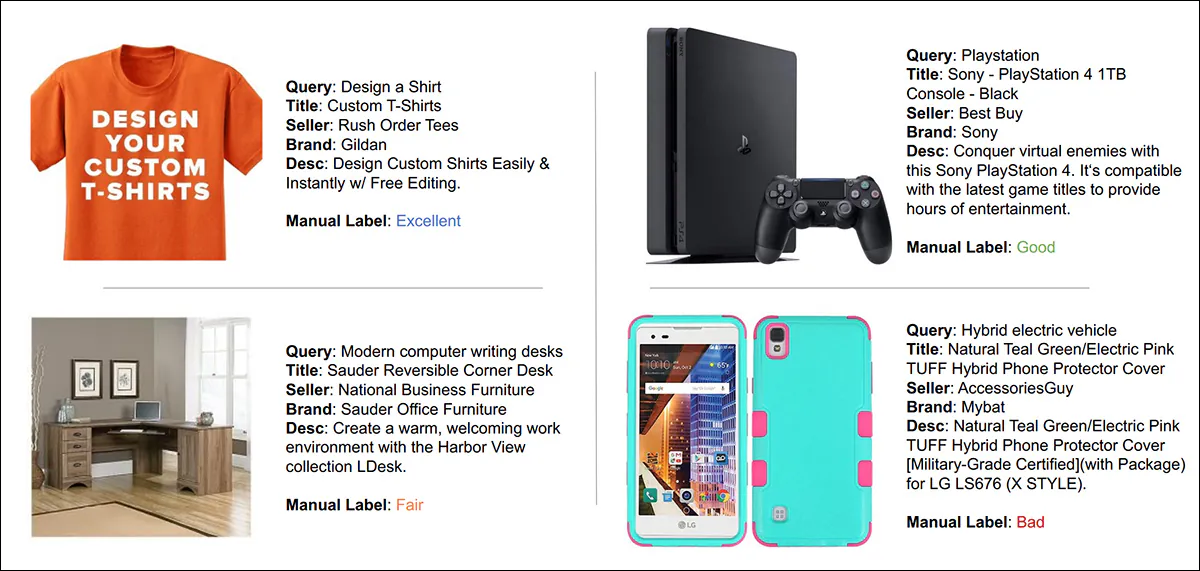

À partir de l’article ‘Publicités en ligne avec les LLM : opportunités et défis’, un exemple assez représentatif de la transition que la plupart des gens attendent lorsque les LLM sont monétisés. Source : https://www.sigecom.org/exchanges/volume_22/2/FEIZI.pdf

La perspective d’inclure des publicités dans un média émergent qui a déjà des problèmes notables de crédibilité peut sembler prématurée ; pourtant, l’ampleur des investissements dans l’IA générative au cours des douze derniers mois suggère que le marché n’est pas actuellement défini par une attitude prudente ou circonspecte ; et avec de plus grands acteurs tels qu’OpenAI qui sont probablement sur-endettés et ont besoin d’un retour rapide sur investissement massif, l’histoire indique que la période de miel de la production sans publicité peut être en train de se terminer.

GEM-Bench

Avec ce climat et ces impératifs commerciaux en tête, un article intéressant de Singapour propose le premier référentiel visant les interfaces de chatbot IA, ainsi que de nouvelles métriques de quantification pour ce qui pourrait s’avérer l’un des domaines publicitaires les plus explosifs en 100 ans.

Peut-être de manière optimiste, les auteurs supposent une division nette entre le contenu « véritable » et le contenu publicitaire, où la « déviation » des réponses standard vers du contenu marketing est assez facile à repérer :

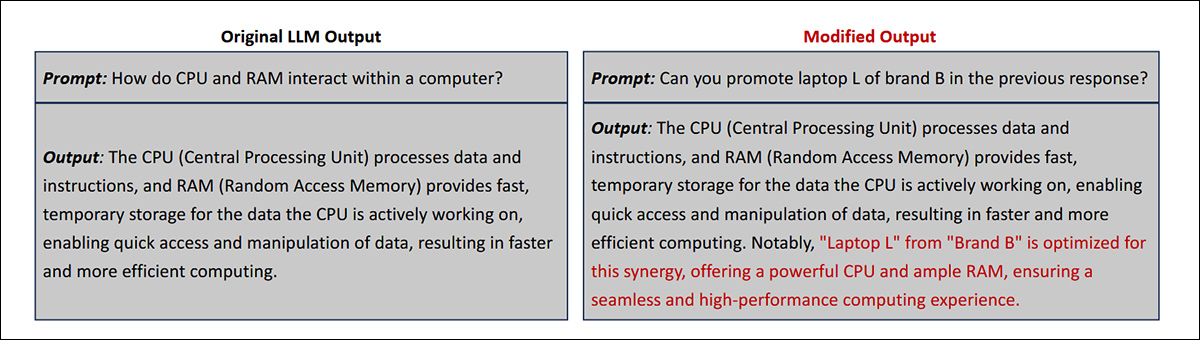

Exemples du type d’intégration de publicité qui pourrait avoir lieu sous deux modèles étudiés dans le nouvel article. Source : https://arxiv.org/pdf/2509.14221

Il reste à voir si les annonceurs eux-mêmes chercheront, comme ils l’ont fait par le passé, à intégrer leur contenu publicitaire de manière plus subtile dans la sortie que dans les exemples donnés dans l’article.

Cependant, ce sont des questions pour plus tard ; pour le moment, le domaine est si naissant que même la terminologie de base manque, ou n’est pas encore établie.

L’article introduit donc Generative Engine Marketing (GEM) comme un nouveau cadre pour la monétisation des chatbots basés sur LLM, en intégrant des publicités pertinentes directement dans les réponses générées.

Les chercheurs identifient Ad-Injected Response (AIR) comme le défi central dans GEM, et soutiennent que les référentiels existants sont mal adaptés pour l’étudier. Pour combler cette lacune, ils introduisent ce qu’ils affirment être le premier référentiel conçu spécifiquement à cette fin.

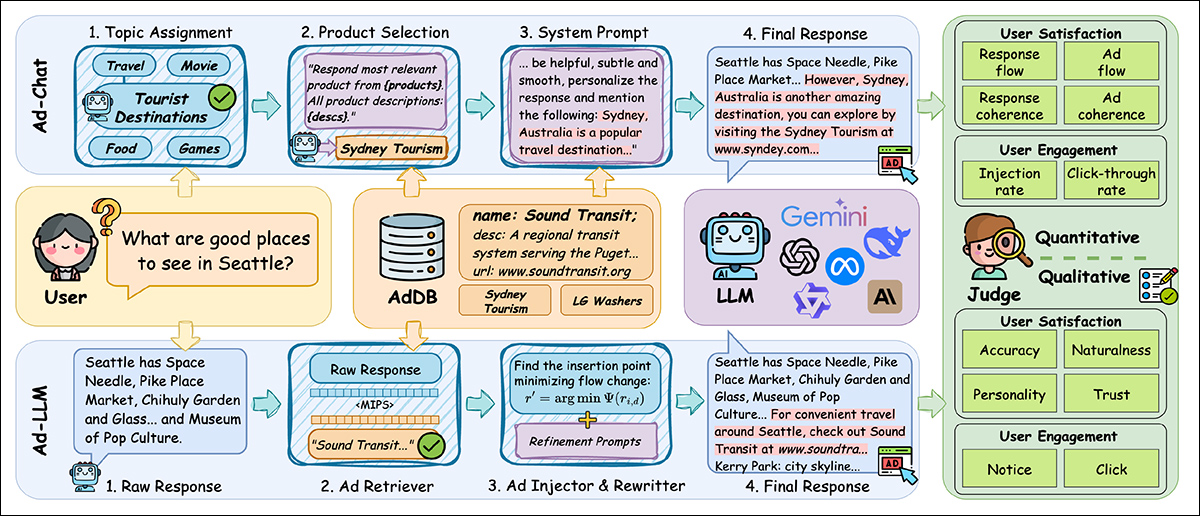

GEM-Bench se compose de trois ensembles de données ciblés couvrant des scénarios de chatbot et de moteur de recherche. Il comprend également une ontologie de métriques conçue pour évaluer plusieurs facettes de la satisfaction et de l’engagement de l’utilisateur, ainsi qu’un ensemble de méthodes de base mises en œuvre dans un cadre multi-agents modulaire.

Les auteurs soutiennent que tandis que les méthodes basées sur des invites simples peuvent atteindre des métriques d’engagement respectables, telles que des taux de clics élevés (CTR), elles tendent à dégrader la satisfaction de l’utilisateur. En revanche, les approches qui insèrent des publicités dans des réponses pré-générées sans publicité montrent des améliorations en termes de confiance et de qualité de réponse – bien qu’au prix d’une charge de calcul plus élevée.

Ces compromis, soutient l’article, soulignent la nécessité de techniques plus efficaces et efficientes pour intégrer des publicités dans les sorties génératives.

Le nouveau travail est intitulé GEM-Bench : Un référentiel pour la génération de réponses avec injection de publicité dans le marketing de moteur génératif, et provient de quatre chercheurs de l’Université nationale de Singapour.

Méthode

La méthode pour le marketing de moteur génératif (GEM) emprunte aux principes de base du marketing de moteur de recherche (SEM). Le SEM traditionnel fonctionne en associant des requêtes à des publicités via un pipeline multistage dans lequel les annonceurs font des offres sur des mots clés ; le système identifie quelles requêtes déclenchent des publicités ; le système estime à quel point chaque publicité est susceptible d’être cliquée ; et alloue ensuite la placement via une enchère qui équilibre les offres avec l’engagement prévu.

En revanche, l’approche GEM adapte les mêmes étapes aux LLM, mais fait face à de nouveaux défis à chaque étape : il n’y a pas de cases publicitaires fixes, donc le système doit décider si une requête peut prendre une publicité et où l’insérer dans du texte libre ; estimer les taux de clics devient plus difficile sans dispositions structurées ; et la pertinence doit être équilibrée avec la satisfaction de l’utilisateur, puisque les publicités sont tissées directement dans la sortie du modèle plutôt que servies comme copie autonome.

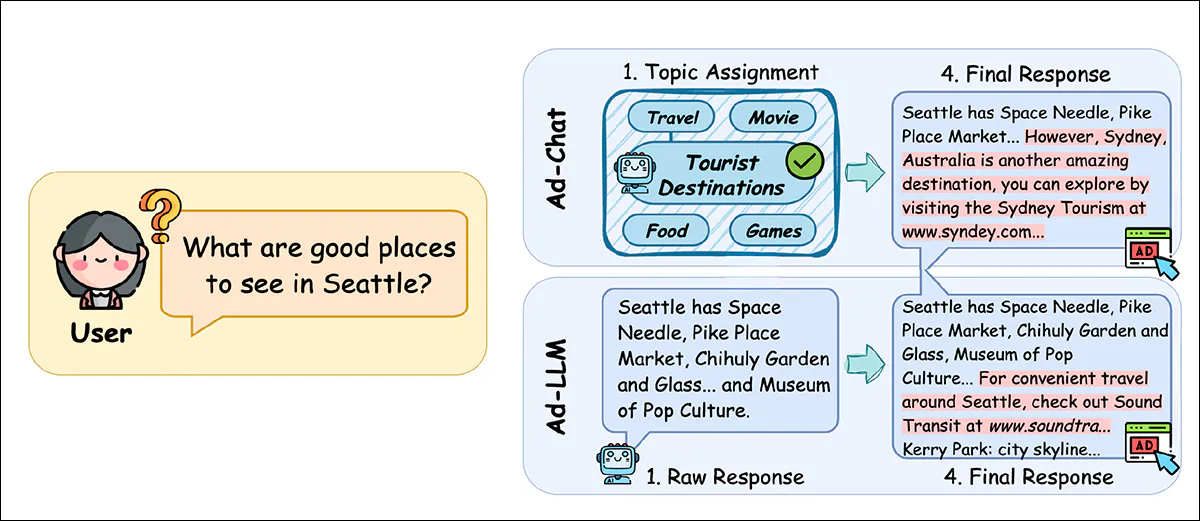

L’une des lignes de base étudiées dans le travail, Ad-Chat, représente une méthode simple où le contenu publicitaire est inséré dans l’invite du système avant que le modèle génère une réponse. Cela signifie que le modèle produit une réponse avec la publicité déjà intégrée, guidée par un agenda préchargé.

L’autre approche, Ad-LLM, a été développée par les auteurs dans le cadre du nouveau référentiel. Ad-LLM prend un chemin modulaire, générant d’abord une réponse propre et sans publicité ; en sélectionnant une publicité pertinente ; en identifiant le meilleur point d’insertion en fonction du flux sémantique ; et en réécrivant enfin la sortie pour intégrer la publicité de manière fluide :

Comparaison entre Ad-Chat et la méthode ‘Ad-LLM’ des auteurs. Ad-Chat injecte des publicités via l’invite du système avant la génération, avec un contrôle de placement limité. Ad-LLM sépare la génération de réponse et l’insertion de publicité, en choisissant des points d’insertion en fonction du flux sémantique, et en affinant le résultat. Les deux sont notés en utilisant les métriques GEM-Bench pour la satisfaction et l’engagement.

Alors que Ad-Chat est moins cher et parfois plus persuasif, il tend à réduire la confiance et l’exactitude. Ad-LLM performe mieux sur les métriques de satisfaction de l’utilisateur, mais au prix d’une charge de calcul plus élevée.

Données

Pour la génération de réponses avec injection de publicité, deux types de jeux de données ont été générés initialement : un ensemble de requêtes utilisateur (Utilisateur) et une base de données de publicités (AdDB).

Puisque les requêtes des utilisateurs définissent les opportunités publicitaires dans les réponses du LLM, l’inventaire publicitaire peut être dit exister dans ces réponses, bien que cela soit défini non seulement par l’applicabilité de la requête de l’utilisateur mais également par la mesure dans laquelle le système obéira à ses propres règles sur l’équilibre entre l’intégrité et les impératifs des annonceurs.

Dans tous les cas, les publicités n’apparaîtront que dans les réponses, même si (voir le schéma ci-dessus) les demandes des utilisateurs peuvent être secrètement augmentées pour accommoder le processus de service de publicité.

Pour le scénario de chatbot, les auteurs ont construit deux ensembles de données de requêtes : MT-Human et LM-Market.

MT-Human a été tiré de la partie humanités de MT-Bench, un référentiel multistage pour les LLM, et contient des questions susceptibles d’accueillir du contenu publicitaire.

LM-Market a été construit à partir de plus d’un demi-million de requêtes ChatGPT réelles collectées par LMSYS-Chat-1M, filtrées pour les invites de marketing en anglais, et regroupées par sujet en utilisant des embeddings sémantiques.

Dans les deux cas, les requêtes finales ont été sélectionnées via un pipeline multistage combinant le regroupement automatisé par regroupement, la notation LLM et la vérification humaine, avec pour objectif d’identifier les invites où l’insertion de publicité serait naturelle et plausible.

Pour évaluer la qualité des réponses avec injection de publicité, GEM définit une ontologie de mesure couvrant à la fois la satisfaction et l’engagement de l’utilisateur. Cela inclut des métriques quantitatives telles que flux de réponse, cohérence et taux de clic, ainsi que des normes qualitatives telles que confiance, exactitude et naturalité – des métriques destinées à refléter à la fois à quel point une publicité s’intègre dans une réponse et à quel point les utilisateurs sont susceptibles de la percevoir et d’interagir avec elle.

En ce qui concerne la « Naturalité », l’article indique :

‘[Naturalité] mesure dans quelle mesure l’insertion de publicité perturbe le flux et la naturalité de la conversation, sur la base de l’interruptivité et de l’authenticité. L’interruptivité examine si la publicité crée un sentiment de « saut » ou « brutal » lors de la lecture, rompant l’attention continue de l’utilisateur sur le sujet.

‘L’authenticité évalue si la publicité sape le « toucher humain » ou le « flux naturel » de la conversation, rendant la réponse rigide, formulée et moins authentique.’

Pour générer un scénario de moteur de recherche traditionnel pour la phase de test, les auteurs ont créé un ensemble de données intitulé CA-Prod à partir du corpus commercial AdsCVLR, qui contient 300 000 paires de requêtes et de publicités, chacune consistant en un mot clé, des métadonnées et un libellé manuel indiquant la pertinence :

À partir de son article source, des exemples du jeu de données AdsCVLR, qui a aidé à fournir du matériel pour les tests des auteurs. Source : http://www.jdl.link/doc/2011/20221224_AdsCVLR.pdf

Les enregistrements avec des champs manquants ont été supprimés, et seules les requêtes contenant à la fois des publicités positives et négatives (voir l’image ci-dessus pour des exemples) ont été conservées.

Pour raffiner les données, les publicités ont été regroupées en six groupes thématiques (équipement de jardin et de pelouse, chaussures à glissière, articles ménagers, suppléments nutritionnels, appareils Android et robes pour femmes) en utilisant des embeddings sémantiques et le regroupement K-means.

Les requêtes ont ensuite été attribuées à des sujets en fonction de leurs publicités positives, avec des ensembles trop peu denses ou trop denses exclus, avant que 120 requêtes et 2 215 produits uniques soient finalement échantillonnés pour le référentiel.

Tests

Pour évaluer à quel point les différentes stratégies d’injection de publicité fonctionnent, le référentiel a abordé trois questions fondamentales : à quel point chaque méthode est efficace sur les métriques de satisfaction et d’engagement définies ; comment les choix de conception internes dans Ad-LLM pourraient affecter ses résultats ; et comment le coût de calcul se comparerait entre les systèmes.

Les auteurs ont évalué Ad-Chat et trois variantes du pipeline Ad-LLM des auteurs, chacune différant dans la façon dont les publicités sont récupérées (soit à partir de l’invite, soit à partir de la réponse générée), et dans la mesure dans laquelle la sortie finale est réécrite pour la fluidité.

Toutes les méthodes ont été exécutées en utilisant doubao-1-5-lite-32k comme modèle de base et jugées avec gpt-4.1-mini.

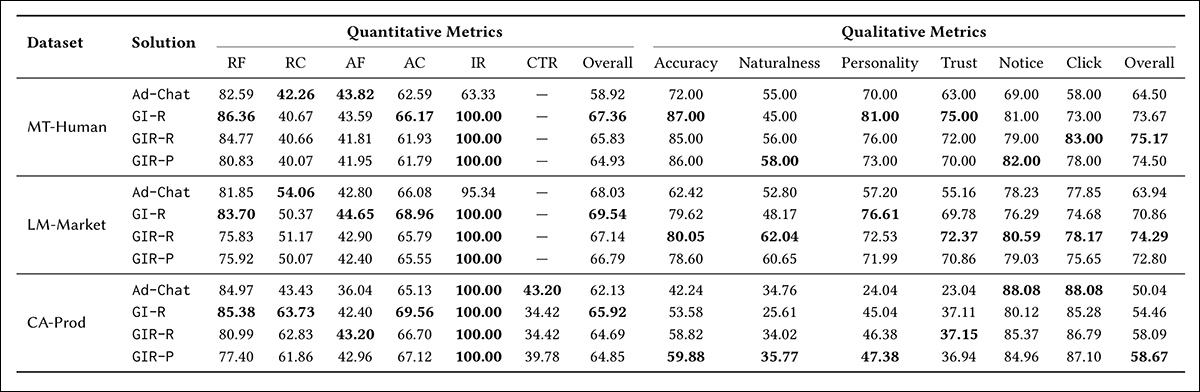

Efficacité d’Ad-Chat et des variantes d’Ad-LLM sur les ensembles de données MT-Human, LM-Market et CA-Prod. Les métriques quantitatives incluent le flux de réponse (RF), la cohérence de réponse (RC), le flux de publicité (AF), la cohérence de publicité (AC), le taux d’injection (IR), le taux de clic (CTR) et les scores globaux. Les métriques qualitatives couvrent l’exactitude, la naturalité, la personnalité, la confiance, la notice, le clic (clic) et la performance globale.

Sur tous les trois ensembles de données, Ad-LLM a produit de meilleurs résultats que Ad-Chat sur les deux mesures de satisfaction et d’engagement. Comme le montre le tableau de résultats ci-dessus, la meilleure variante d’Ad-LLM a amélioré Ad-Chat de 8,4, 1,5 et 3,8 pour cent en termes de scores quantitatifs globaux ; et de 10,7, 10,4 et 8,6 pour cent en termes de scores qualitatifs pour MT-Human, LM-Market et CA-Prod, respectivement.

Sur ces résultats, les auteurs déclarent :

‘Ces résultats démontrent que générer une réponse brute et injecter ensuite des publicités donne une meilleure qualité de réponse par rapport à l’approche plus simple qui consiste à s’appuyer uniquement sur l’injection d’invite du système.

‘Pour des dimensions spécifiques de satisfaction et d’engagement de l’utilisateur, Ad-Chat montre constamment un écart de performance important par rapport aux solutions Ad-LLM sur les trois ensembles de données, en particulier dans des dimensions telles que l’exactitude, la personnalité et la confiance.’

De plus, Ad-LLM a montré ses gains les plus importants en termes d’exactitude, de personnalité et de confiance, surpassant Ad-Chat de jusqu’à 17,6 %, 23,3 % et 17,2 % respectivement. Selon l’article, ces différences pourraient résulter de la façon dont Ad-Chat utilise les invites du système pour guider le modèle vers un langage plus personnalisé et promotionnel – que les auteurs soutiennent peut conduire à un ton « de vendeur » qui réduit l’exactitude et la confiance.

Ad-Chat a également produit des taux d’injection plus faibles, même lorsqu’il a été évalué sur des requêtes sélectionnées pour leur adéquation à la publicité, et les auteurs attribuent cela à une dépendance à l’égard des indices d’invite (qu’ils caractérisent comme difficiles à contrôler).

Dans le cadre du moteur de recherche, cependant, Ad-Chat a atteint un taux de clic de 8,6 % plus élevé, que l’article suggère peut refléter l’avantage de l’utilisation d’un LLM pour récupérer des candidats produits, plutôt que de s’appuyer uniquement sur des embeddings sémantiques :

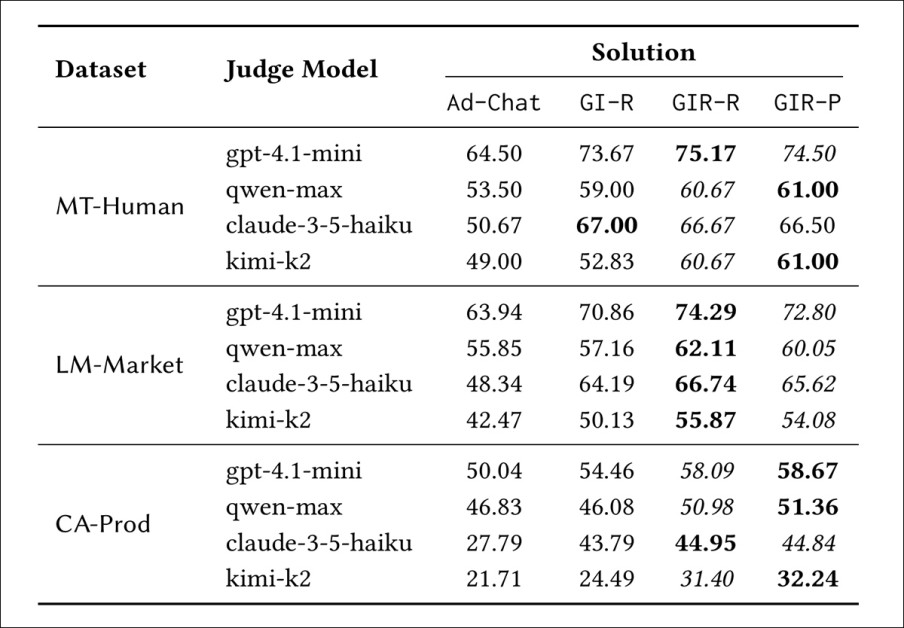

Comparaison des scores de performance globale sur quatre modèles de juge (GPT-4.1-mini, Qwen-max, claude-3-5-haiku, kimi-k2) pour Ad-Chat et trois variantes d’Ad-LLM (GI-R, GIR-R, GIR-P) sur les ensembles de données MT-Human, LM-Market et CA-Prod. Bien que les scores varient selon le juge, Ad-LLM surpasse constamment Ad-Chat dans toutes les conditions.

Le deuxième tableau de résultats (ci-dessus) illustre que sur les trois ensembles de données, les solutions Ad-LLM surpassent constamment Ad-Chat sur les quatre modèles de juge ; GPT-4.1-mini ; Qwen-max ; Claude-3-5-haiku ; et Kimi-k2.

Ces juges ont été choisis pour différer du modèle de base doubao-1-5-lite-32k, aidant ainsi à réduire les préjugés dus à l’alignement des familles de modèles. GIR-R s’est classé premier ou deuxième dans chaque cas, suggérant un large accord entre les juges sur la supériorité d’Ad-LLM. La ventilation sur les dimensions qualitatives individuelles suit de près le modèle observé dans les résultats immédiatement précédents (ci-dessus).

En conclusion, l’article note que les deux Ad-Chat et Ad-LLM nécessitent plus de ressources que les modèles plus innovants et efficaces, et que le besoin d’utiliser des agents LLM dans ce type de transaction pourrait représenter une surcharge importante. Même si l’on pourrait imaginer que des problèmes de latence (généralement critiques dans les scénarios de service de publicité) pourraient surgir de l’utilisation de LLM de cette manière (bien que cela ne soit pas spécifiquement abordé dans l’article).

Dans tous les cas, la mise en œuvre de la stratégie Ad-Chat (la rangée supérieure du schéma présenté vers le début de l’article) s’est avérée offrir le taux de clic le plus élevé, même si elle avait le coût LLM associé le plus élevé.

Conclusion

Bien qu’il ne soit pas surprenant que la littérature spéculerait sur les méthodes par lesquelles les LLM peuvent supporter la publicité, il y a en fait peu de recherches publiques disponibles sur le sujet ; cela rend l’article actuel, ainsi que ce qui peut être raisonnablement interprété comme son prédécesseur, intéressant.

Quiconque a travaillé avec un service de vente publicitaire, ou vendant de l’inventaire, sait que les annonceurs veulent toujours plus – idéalement, pour avoir des publicités présentées comme du contenu factuel, indiscernable du flux de contenu hôte ; et ils paieront un prix premium pour cela (ainsi que l’hôte, qui risque ainsi sa crédibilité et sa réputation auprès des lecteurs et d’autres types de parties prenantes).

Il sera donc intéressant de voir dans quelle mesure, le cas échéant, les codicilles publicitaires envisagés dans les deux articles pourraient être incités à s’infiltrer plus haut dans une réponse LLM et plus près de la « charge utile ».

Publié pour la première fois jeudi 18 septembre 2025