Intelligence Artificielle

Le problème de la boîte noire dans les LLM : défis et solutions émergentes

L'apprentissage automatique, un sous-ensemble de l'IA, implique trois composants : les algorithmes, les données d'entraînement et le modèle résultant. Un algorithme, essentiellement un ensemble de procédures, apprend à identifier des modèles à partir d'un large ensemble d'exemples (données d'entraînement). Le point culminant de cette formation est un modèle d’apprentissage automatique. Par exemple, un algorithme entraîné avec des images de chiens donnerait lieu à un modèle capable d’identifier les chiens dans les images.

Boîte noire dans l'apprentissage automatique

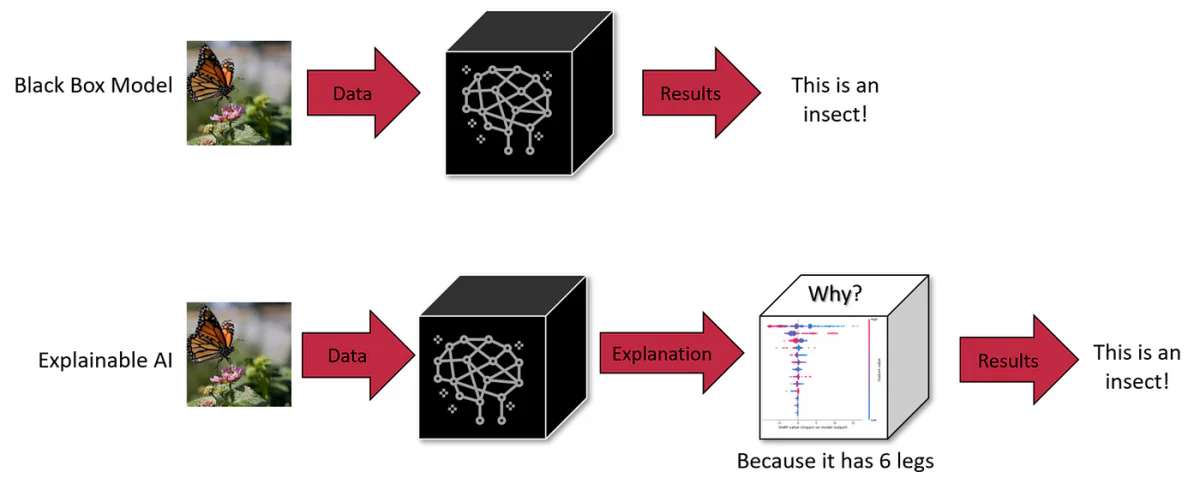

En apprentissage automatique, chacun des trois composants – algorithme, données d'entraînement ou modèle – peut être une boîte noire. Si les algorithmes sont souvent connus du public, les développeurs peuvent choisir de garder le modèle ou les données d'entraînement secrets afin de protéger la propriété intellectuelle. Cette obscurité complique la compréhension du processus décisionnel de l'IA.

Les boîtes noires d’IA sont des systèmes dont le fonctionnement interne reste opaque ou invisible pour les utilisateurs. Les utilisateurs peuvent saisir des données et recevoir des sorties, mais la logique ou le code qui produit la sortie reste caché. Il s'agit d'une caractéristique commune à de nombreux systèmes d'IA, y compris les modèles génératifs avancés comme ChatGPT et DALL-E 3.

Les LLM tels que GPT-4 présentent un défi de taille : leur fonctionnement interne est largement opaque, ce qui en fait des « boîtes noires ». Une telle opacité n’est pas seulement un casse-tête technique ; cela pose des problèmes réels de sécurité et d’éthique. Par exemple, si nous ne pouvons pas discerner comment ces systèmes parviennent à des conclusions, pouvons-nous leur faire confiance dans des domaines critiques comme les diagnostics médicaux ou les évaluations financières ?

L'ampleur et la complexité des LLM

L'ampleur de ces modèles ajoute à leur complexité. Prenez GPT-3, par exemple, avec ses 175 milliards de paramètres, et les modèles plus récents en possédant des milliards. Chaque paramètre interagit de manière complexe au sein du réseau neuronal, contribuant ainsi à des capacités émergentes qui ne sont pas prévisibles en examinant uniquement les composants individuels. Cette ampleur et cette complexité rendent presque impossible la compréhension complète de leur logique interne, ce qui constitue un obstacle au diagnostic des biais ou des comportements indésirables dans ces modèles.

Le compromis : échelle et interprétabilité

Réduire l’échelle des LLM pourrait améliorer l’interprétabilité, mais au détriment de leurs capacités avancées. L’échelle est ce qui permet des comportements que les modèles plus petits ne peuvent pas réaliser. Cela présente un compromis inhérent entre l’échelle, la capacité et l’interprétabilité.

Impact du problème de la boîte noire LLM

1. Prise de décision erronée

L'opacité du processus décisionnel des LLM comme GPT-3 ou BERT peut conduire à des biais et des erreurs non détectés. Dans des domaines comme la santé ou la justice pénale, où les décisions ont des conséquences considérables, l'incapacité de vérifier la solidité éthique et logique des LLM est une préoccupation majeure. Par exemple, un LLM de diagnostic médical reposant sur des données obsolètes ou biaisées peut formuler des recommandations préjudiciables. De même, les LLM dans les processus de recrutement peuvent, par inadvertance, perpétuer les préjugés sexistes. La nature de la boîte noire non seulement dissimule les défauts, mais peut potentiellement les amplifier, ce qui nécessite une approche proactive pour améliorer la transparence.

2. Adaptabilité limitée dans divers contextes

Le manque de compréhension du fonctionnement interne des LLM limite leur adaptabilité. Par exemple, un LLM de recrutement pourrait être inefficace pour évaluer les candidats à un poste qui valorise les compétences pratiques plutôt que les qualifications académiques, en raison de son incapacité à ajuster ses critères d'évaluation. De même, un LLM médical peut avoir des difficultés avec les diagnostics de maladies rares en raison de déséquilibres dans les données. Cette rigidité met en évidence la nécessité de transparence pour recalibrer les LLM pour des tâches et des contextes spécifiques.

3. Biais et lacunes dans les connaissances

Le traitement par les LLM de vastes données d'entraînement est soumis aux limites imposées par leurs algorithmes et leurs architectures de modèles. Par exemple, un LLM en médecine pourrait présenter des biais démographiques s'il est formé sur des ensembles de données déséquilibrés. De plus, la maîtrise d'un LLM dans des domaines de niche pourrait être trompeuse, conduisant à des résultats erronés et trop fiables. Combler ces biais et ces lacunes de connaissances nécessite plus que de simples données supplémentaires ; il faut examiner les mécanismes de traitement du modèle.

4. Responsabilité juridique et éthique

L'opacité des LLM crée une zone d'ombre juridique quant à la responsabilité des préjudices causés par leurs décisions. Si un LLM en milieu médical fournit des conseils erronés entraînant un préjudice pour un patient, il devient difficile de déterminer les responsabilités en raison de l'opacité du modèle. Cette incertitude juridique présente des risques pour les entités déployant des LLM dans des domaines sensibles, soulignant la nécessité d'une gouvernance claire et transparente.

5. Problèmes de confiance dans les applications sensibles

Pour les LLM utilisés dans des domaines critiques comme la santé et la finance, le manque de transparence mine leur fiabilité. Les utilisateurs et les régulateurs doivent s’assurer que ces modèles ne comportent pas de préjugés ou ne prennent pas de décisions fondées sur des critères injustes. Vérifier l'absence de biais dans les LLM nécessite une compréhension de leurs processus de prise de décision, en soulignant l'importance de l'explicabilité pour un déploiement éthique.

6. Risques liés aux données personnelles

Les LLM nécessitent des données de formation approfondies, qui peuvent inclure des informations personnelles sensibles. La nature de boîte noire de ces modèles soulève des inquiétudes quant à la manière dont ces données sont traitées et utilisées. Par exemple, un LLM médical formé sur les dossiers des patients soulève des questions sur la confidentialité et l’utilisation des données. Garantir que les données personnelles ne sont pas utilisées à mauvais escient ou exploitées nécessite des processus transparents de traitement des données au sein de ces modèles.

Solutions émergentes pour l’interprétabilité

Pour relever ces défis, de nouvelles techniques sont développées. Il s’agit notamment des méthodes d’approximation contrefactuelles (CF). La première méthode consiste à inciter un LLM à modifier un concept de texte spécifique tout en gardant les autres concepts constants. Cette approche, bien qu'efficace, est gourmande en ressources au moment de l'inférence.

La deuxième approche consiste à créer un espace d'intégration dédié guidé par un LLM lors de la formation. Cet espace s'aligne sur un graphique causal et permet d'identifier les correspondances se rapprochant des CF. Cette méthode nécessite moins de ressources au moment du test et s’est avérée efficace pour expliquer les prédictions du modèle, même dans les LLM comportant des milliards de paramètres.

Ces approches mettent en évidence l’importance des explications causales dans les systèmes PNL pour garantir la sécurité et établir la confiance. Les approximations contrefactuelles fournissent un moyen d'imaginer comment un texte donné changerait si un certain concept dans son processus génératif était différent, facilitant ainsi l'estimation pratique de l'effet causal des concepts de haut niveau sur les modèles PNL.

Analyse approfondie : méthodes d'explication et causalité dans les LLM

Outils de sondage et d’importance des fonctionnalités

Le sondage est une technique utilisée pour déchiffrer ce que codent les représentations internes des modèles. Il peut être supervisé ou non et vise à déterminer si des concepts spécifiques sont codés à certains endroits d'un réseau. Bien qu’efficaces dans une certaine mesure, les sondes ne parviennent pas à fournir des explications causales, comme le soulignent Geiger et al. (2021).

Les outils d'importance des fonctionnalités, une autre forme de méthode d'explication, se concentrent souvent sur les fonctionnalités d'entrée, bien que certaines méthodes basées sur le gradient étendent cela aux états cachés. Un exemple est la méthode des gradients intégrés, qui propose une interprétation causale en explorant les données de base (contrefactuelles, CF). Malgré leur utilité, ces méthodes ont encore du mal à relier leurs analyses aux concepts du monde réel au-delà des simples propriétés d’entrée.

Méthodes basées sur l'intervention

Les méthodes basées sur l'intervention impliquent de modifier les entrées ou les représentations internes pour étudier les effets sur le comportement du modèle. Ces méthodes peuvent créer des états CF pour estimer les effets causals, mais elles génèrent souvent des entrées ou des états de réseau invraisemblables à moins d'être soigneusement contrôlées. Le modèle causal proxy (CPM), inspiré du concept S-learner, est une approche nouvelle dans ce domaine, imitant le comportement du modèle expliqué sous les entrées CF. Cependant, la nécessité d’un explicateur distinct pour chaque modèle constitue une limitation majeure.

Rapprocher les contrefactuels

Les contrefactuels sont largement utilisés en apprentissage automatique pour l'augmentation des données, impliquant des perturbations sur divers facteurs ou étiquettes. Ces contrefactuels peuvent être générés par édition manuelle, remplacement heuristique de mots-clés ou réécriture automatique de texte. Si l'édition manuelle est précise, elle est également gourmande en ressources. Les méthodes basées sur les mots-clés ont leurs limites, et les approches génératives offrent un équilibre entre fluidité et couverture.

Explications fidèles

La fidélité des explications fait référence à la représentation précise du raisonnement sous-jacent du modèle. Il n'existe pas de définition universellement acceptée de la fidélité, ce qui conduit à sa caractérisation par divers indicateurs tels que la sensibilité, la cohérence, la concordance d'importance des caractéristiques, la robustesse et la simulabilité. La plupart de ces méthodes se concentrent sur des explications au niveau des caractéristiques et confondent souvent corrélation et causalité. Notre travail vise à fournir des explications conceptuelles de haut niveau, en s'appuyant sur la littérature sur la causalité pour proposer un critère intuitif : l'ordre-fidélité.

Nous avons exploré les complexités inhérentes aux LLM, comprenant leur nature de « boîte noire » et les défis majeurs qu'elle pose. Des risques de prise de décision erronée dans des domaines sensibles comme la santé et la finance aux dilemmes éthiques liés aux préjugés et à l'équité, le besoin de transparence dans les LLM n'a jamais été aussi évident.

L'avenir des LLM et leur intégration dans notre vie quotidienne et nos processus décisionnels critiques dépendent de notre capacité à rendre ces modèles non seulement plus avancés, mais également plus compréhensibles et responsables. La recherche de l’explicabilité et de l’interprétabilité n’est pas seulement une entreprise technique mais un aspect fondamental de l’instauration de la confiance dans les systèmes d’IA. À mesure que les LLM s’intègrent davantage dans la société, la demande de transparence augmentera, non seulement de la part des praticiens de l’IA, mais aussi de la part de tous les utilisateurs qui interagissent avec ces systèmes.