Angle d’Anderson

Diffusion d’avatars IA comme en 1999

De nouvelles recherches présentent un moyen de diffuser des avatars 3D réalistes qui apparaissent presque instantanément et s’affinent en temps réel, au lieu de forcer les utilisateurs à attendre la fin de téléchargements massifs.

À banyak égards, les exigences de ressources considérables de l’IA générative et des systèmes de rendu assistés par l’IA ont ramené la préparation des consommateurs à plus de vingt ans en arrière. Seulement en 2023, une allocation de 64 Go de RAM dans un ordinateur portable ou un PC semblait être un gaspillage ; maintenant, avec la popularité croissante de la RAM et/ou du déchargement du CPU, 64 Go est plutôt modeste pour les besoins locaux de l’IA ; et ces éléments autrefois banaux et abordables des PC continuent à augmenter en prix alors que les entreprises luttent pour répondre à la demande de services d’IA.

L’échelle et l’avidité de l’IA et de ses processus et environnements dépassent généralement le matériel de niveau consommateur, et même l’exécution de modèles « épurés » locaux sous forme de versions GGUF entraînera généralement une tension sur le système moyen.

Même les services d’IA basés sur du texte, tels que ChatGPT, sont sujects à une tension importante à la fois au niveau client et serveur. Par conséquent, une fois que l’IA est chargée de fournir des expériences multimédia en ligne en temps réel, nous pouvons raisonnablement nous attendre à des compromis importants en termes de latence et/ou de qualité – similaires aux premiers combats de l’Internet avec les médias en continu, et aux icônes de « tamponnage » animés much-hated de RealPlayer et QuickTime.

La dernière fois que les problèmes de multimédia et de réseau ont créé des frictions dans l’expérience utilisateur, le matériel de niveau consommateur évoluait encore à travers la loi de Moore, s’améliorant presque de manière exponentielle chaque année, même si les systèmes d’exploitation, les réseaux et les autres infrastructures de support évoluaient pour répondre à la demande ; et pendant les dix dernières années, plus ou moins, les capacités de la technologie consommateur ont dépassé les demandes de multimédia (peut-être même au point où le churn devait être déclenché pour maintenir les ventes).

Mais cette surabondance de capacités locales peut bientôt prendre fin, car le matériel local devient moins puissant et plus cher, et que les services basés sur l’IA exigent des ressources serveur et locales plus élevées.

Prendre les devants

Dans l’ère pré-broadband, même avant les premières vidéos en streaming utilisables, les utilisateurs Web étaient habitués à voir des images se préciser lentement, car les JPEG progressifs permettaient à l’utilisateur à bande passante restreinte de regarder l’image en train de se former, parfois très lentement, à mesure que davantage de données d’image étaient chargées localement.

Maintenant, il semble que nous puissions vivre une expérience similaire avec les avatars Gaussian Splat aidés par l’IA :

Cliquez pour jouer. À partir du nouveau projet ProgressiveAvatars, une comparaison de l’affichage de Gaussian avatars. Source

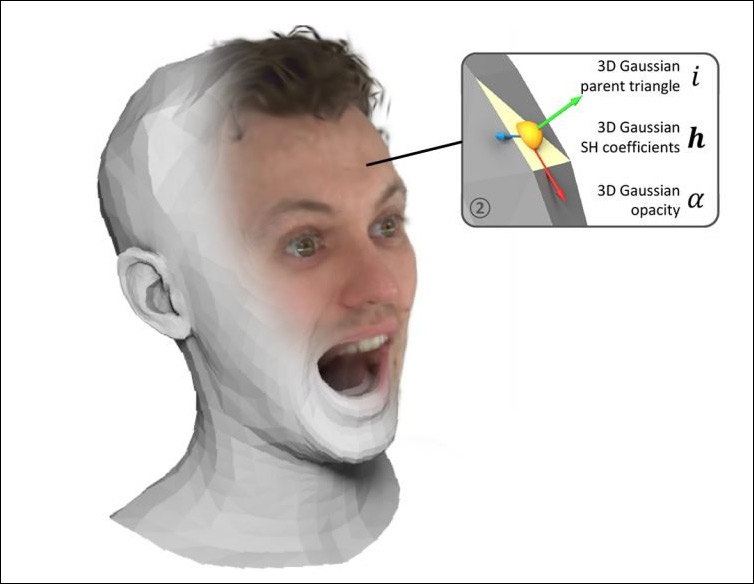

Au-dessus, nous voyons deux versions d’un avatar Gaussian Splat – une représentation humaine rendue possible en partie par une technique de rendu non-AI qui remonte aux premières années 1990, et également par des méthodes plus modernes, telles que le modèle paramétrique humain FLAME, et les approches de formation basées sur l’IA :

Gaussian Splatting utilise une représentation gaussienne de la couleur et des informations 3D à la place d’un pixel ou d’un voxel, et mappe cette texture ultra-réaliste sur un maillage CGI plus traditionnel, qui est lui-même facilité par un ‘humain paramétrique’, un visage et/ou un corps CGI, dans des systèmes tels que FLAME et STAR. Source

À gauche dans la vidéo ci-dessus, nous pouvons voir qu’une mise en œuvre traditionnelle d’un avatar Gaussian Splat a l’air assez horrible pendant que nous attendons que les données se chargent. À droite, une nouvelle mise en œuvre de Chine, appelée ProgressiveAvatars, est capable de se résoudre de manière beaucoup plus élégante à mesure que les données se chargent, présentant une image humaine non alarmante dès le début.

Les auteurs affirment que leur méthode est la première à véritablement « diffuser » un avatar gaussien, et certainement la première à le faire de manière progressive, où l’image se construit de manière élégante, et les zones les plus importantes – telles que les yeux et les lèvres – peuvent être priorisées, de sorte que l’avatar peut devenir conversationnel même lorsqu’il n’est que partiellement chargé :

Click to play. À partir du site du projet ProgressiveAvatars, une illustration du chargement attention-aware.

Avant cela, une approche de « niveau de détail » (LOD) a été utilisée dans les tentatives précédentes pour alléger les « avatars GSplat », similaires aux optimisations de jeux vidéo, où des versions successivement plus détaillées d’une personne sont chargées en fonction de leur occupation de l’espace de l’utilisateur ou de l’attention pour en valoir la peine.

Bien sûr, cela implique une quantité considérable de « doubles » d’avatars redondants, et les auteurs présentent leur approche comme un système plus rationnel. Par implication, une méthode de ce type permet également des changements dans une figure GSplat (c’est-à-dire une personnalisation) sans avoir à propager ces changements à travers une chaîne de « jumeaux » LOD.

Un domaine émergent

Si cela semble être un problème de niche, eh bien, cela valait également pour la vidéo en streaming, à l’époque où obtenir les premiers plugins pour qu’ils fonctionnent était confié au nerd le plus proche. De plus, le potentiel de représentations en streaming basées sur l’IA va au-delà des avatars humains, s’étendant à la génération de villes, aux jeux, et aux versions 3D de pratiquement tout domaine en ligne – tel que le Virtual Try-On pour les achats de vêtements :

Cliquez pour jouer. À partir d’un projet de 2024, un aperçu grossier de l’avenir de l’essai en ligne. D’autres projets visent à ajouter le mouvement et l’interactivité – des aspects exigeants à diffuser et à gérer. Source

Tout comme les approches basées sur le LOD ont été utilisées jusqu’à présent principalement par les jeux vidéo, de nombreuses autres considérations qui étaient autrefois le domaine exclusif du développement de jeux sont susceptibles de se frayer un chemin dans les représentations basées sur les splats.

Par exemple, la plupart de ces premières sorties GSplat dépeignent un seul humain qui fait la grimace et les gestes, ou qui parle peut-être ; mais de nombreuses situations seront nécessaires qui mettent en scène plusieurs humains, ainsi que des caractéristiques environnementales et une ambiance – un scénario dans lequel des systèmes de « triage » très performants détermineront où les données de diffusion doivent être priorisées, afin de maintenir le spectateur dans l’instant.

Le nouvel article est intitulé ProgressiveAvatars : Avatars gaussiens 3D animables progressifs, et provient de trois chercheurs de l’Université des sciences et de la technologie de Chine à Hefei.

Méthode

L’approche utilise initialement une vidéo de la tête d’une personne. Pour chaque trame, un modèle de visage paramétrique FLAME standard est ajusté, de sorte que la forme et l’expression changent au fil du temps, tandis que la structure de maillage sous-jacente reste fixe. Puisque la topologie de base ne change pas, un modèle FLAME stable peut être réutilisé et affiné au lieu d’être reconstruit à partir de zéro à chaque instant, comme c’est le cas dans des travaux antérieurs similaires :

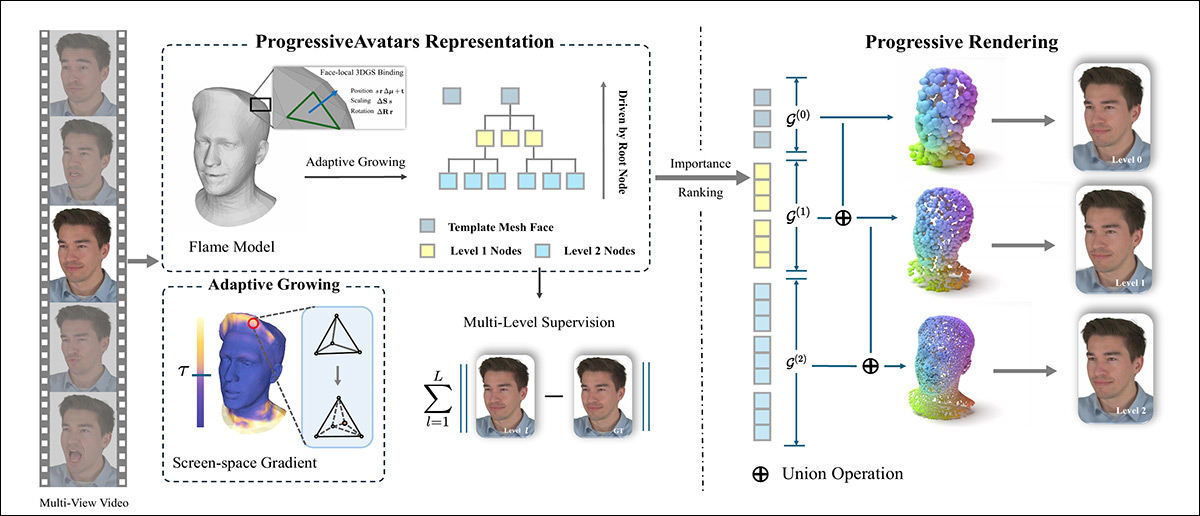

La vidéo de la tête est d’abord ajustée avec un maillage FLAME suivi, après quoi des gaussiennes 3D sont attachées à chaque visage et croissent de manière hiérarchique là où les gradients d’espace d’écran indiquent des détails manquants. Lors de la formation, cette sous-division adaptative construit une représentation multi-niveaux sous la supervision multi-vue, et lors de l’inférence, les scores d’importance par visage déterminent quelles gaussiennes sont diffusées en premier, permettant à l’avatar d’apparaître rapidement et de se raffiner progressivement à mesure que les niveaux de détail plus élevés sont ajoutés.

Au-dessus de cette structure de base, des détails sont ajoutés en couches ; la surface est implicitement sous-divisée en une hiérarchie, et de petites gaussiennes 3D sont attachées aux visages à chaque niveau de détail.

Bien que les couches initiales plus grossières capturent la forme générale de la tête et le mouvement, les couches plus fines suivantes fournissent des rides, des déformations subtiles et des textures à haute fréquence. Les images sont ensuite rendues à partir de ces gaussiennes à l’aide d’un rasteriseur gaussien différentiable et formé contre des images de vérité terrain multi-vue, de sorte que l’avatar apprend à reproduire l’apparence de la personne réelle.

Lors de la formation, cette hiérarchie croît automatiquement : les régions qui nécessitent plus de détails sont sous-divisées davantage, guidées par des signaux d’espace d’écran, de sorte que l’effort de calcul se concentre là où l’œil du spectateur est le plus susceptible de remarquer les erreurs.

Lors de l’inférence, cette même hiérarchie permet le diffusion progressive, dans lequel une version grossière de l’avatar peut être affichée en premier, et, à mesure que des couches supplémentaires sont chargées, de nouvelles gaussiennes peuvent être ajoutées sans altérer ce qui est déjà affiché, permettant un avatar de tête animable qui apparaît rapidement et devient plus net et plus détaillé à mesure que plus de données arrivent.

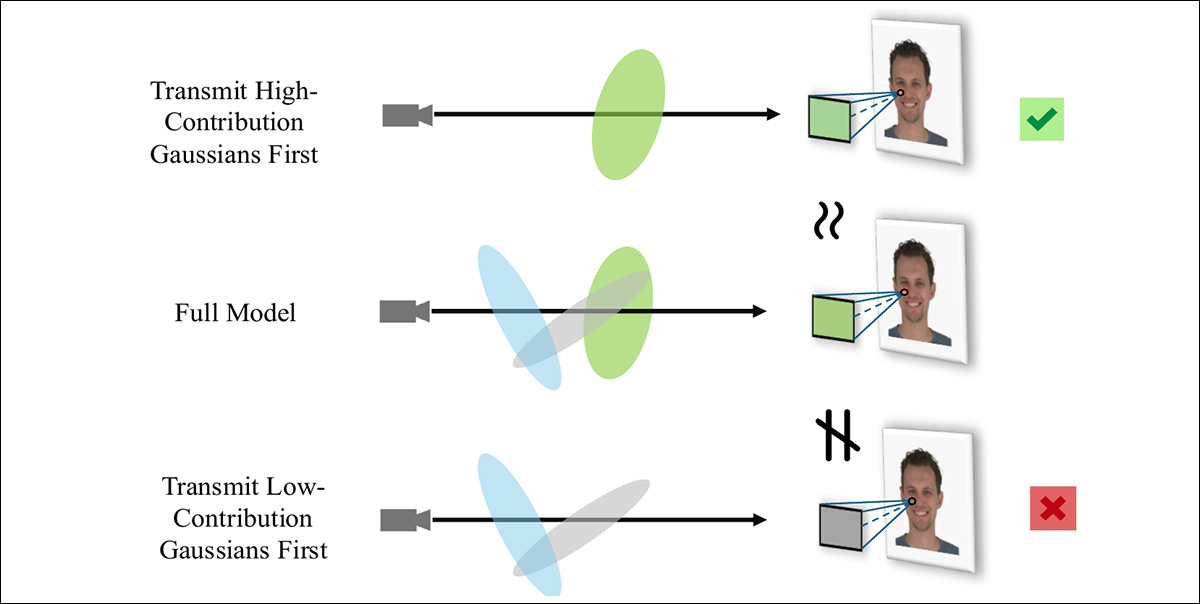

Les auteurs observent que le système entier repose sur la priorisation des données entrantes :

Lorsque toutes les gaussiennes d’un niveau donné sont disponibles, le modèle complet est rendu avec une fidélité maximale ; mais lors de la diffusion, l’envoi des gaussiennes à contribution la plus élevée en premier permet des résultats partiels précoces pour correspondre étroitement à l’image finale, alors que la transmission des gaussiennes à faible contribution en premier déforme l’équilibre des couleurs et met l’accent sur les composants mineurs.

Données et tests

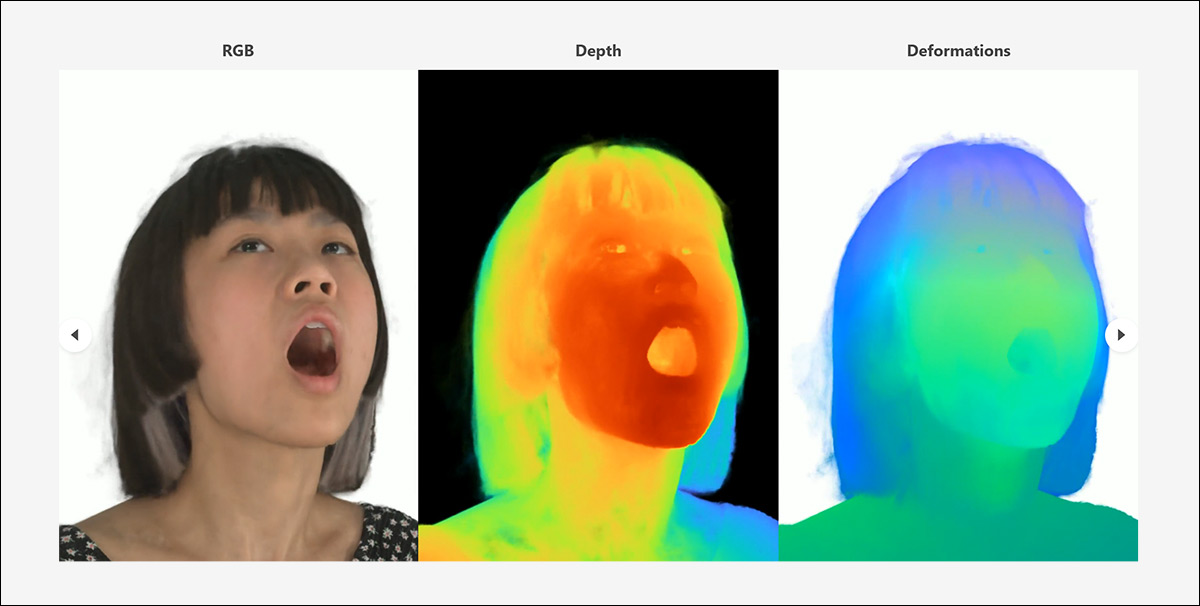

Pour les tests, la nouvelle méthode a été évaluée sur l’ensemble de données NeRSemble, qui se compose de vidéos multi-vue pour chaque sujet couvert, avec des paramètres calibrés sur toutes les vues :

Exemples d’interprétations diverses de sujets inclus dans l’ensemble de données NeRSemble utilisé pour les tests de ProgressiveAvatars. Source

Conformément à la méthodologie originale GaussianAvatars, les images ont été sous-échantillonnées à 802x550px, un masque de premier plan a été généré, et la division de formation/test originale a été adoptée.

L’optimiseur Adam a été utilisé pour les mises à jour de paramètres, avec un taux d’apprentissage de 1×10-2 sur toutes les coordonnées barycentriques. La formation a duré 60 000 itérations, avec la hiérarchie automatiquement étendue toutes les 2 000 itérations.

Initialement, les auteurs ont testé la reconstruction et l’animation – la tâche de conversion de vidéo plate en un système 3D (x/y/x), en utilisant la représentation CGI canonique de FLAME comme maillage ancré. Pour cela, toutes les lignes de base ont été formées à partir de zéro, et les cadres de travail rivaux testés étaient les PointAvatar et les avatars gaussiens mentionnés précédemment.

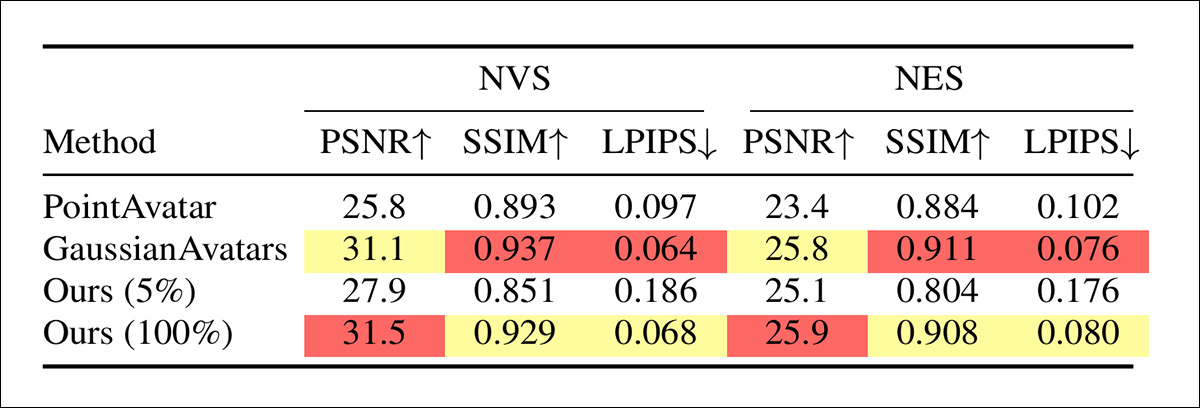

Pour ces tests, les métriques utilisées étaient Peak Signal-to-Noise Ratio (PSNR), Structural Similarity Index (SSIM), et Learned Perceptual Image Patch Similarity (LPIPS) :

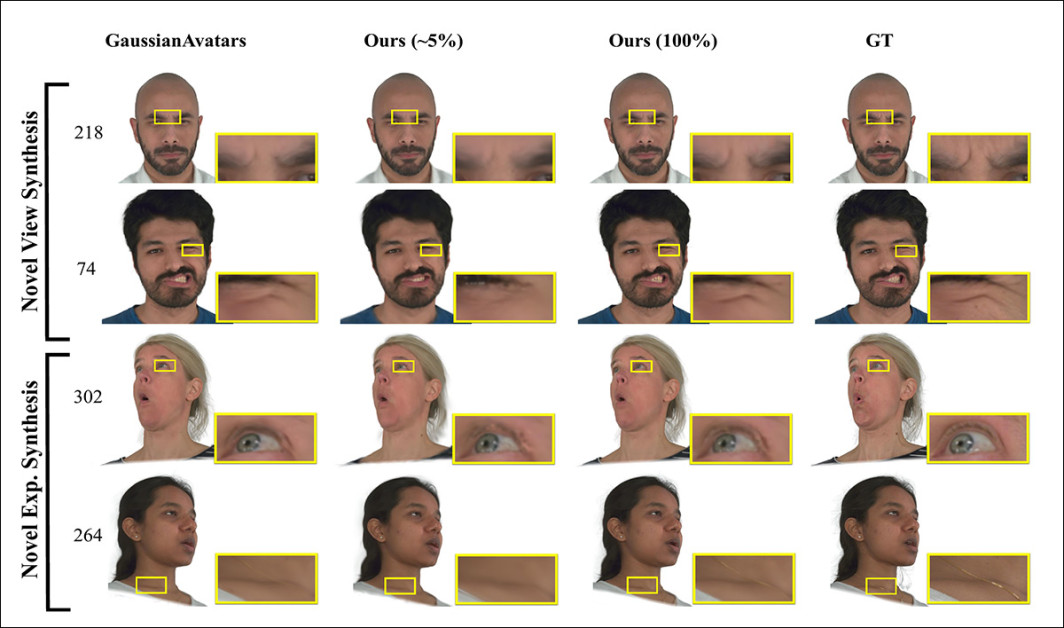

Comparaison qualitative de la synthèse de vues et d’expressions nouvelles. La ligne de base GaussianAvatars a du mal avec les détails fins autour des yeux, des rides et de la texture de la peau, tandis que la méthode proposée préserve déjà la structure faciale clé à environ cinq pour cent des données transmises et converge vers la vérité au sol à mesure que davantage de gaussiennes sont diffusées, correspondant étroitement au modèle complet et aux images de référence (vérité au sol).

En ce qui concerne ces résultats, les auteurs affirment :

‘[Notre] méthode reconstruit des détails plus nets dans plusieurs régions, en particulier autour du cou, des épaules et des vêtements. Ces zones sont relativement grossièrement maillées dans le modèle FLAME par rapport aux zones faciales à haute salience (par exemple, la région péricolaire).

‘Par conséquent, les méthodes antérieures allouent souvent trop peu de gaussiennes 3D à ces régions pour capturer fidèlement leurs détails à petite échelle. En revanche, notre stratégie de croissance adaptative augmente le nombre de gaussiennes et affine la hiérarchie uniquement là où cela est nécessaire, ce qui rend l’allocation insensible à la tessellation non uniforme de FLAME.’

Les auteurs notent en outre que leur approche est au pair avec les méthodes de pointe, ce qui donne un avatar utilisable avec une allocation de bande passante triviale de 5 % :

Comparaison quantitative de la synthèse de vues et d’expressions nouvelles en utilisant PSNR, SSIM et LPIPS. À la transmission complète, la méthode proposée atteint le PSNR le plus élevé sur les deux tâches et reste compétitive avec GaussianAvatars sur les métriques perceptuelles, tandis que le paramètre 5 % illustre le compromis de qualité sous des contraintes de bande passante extrêmes.

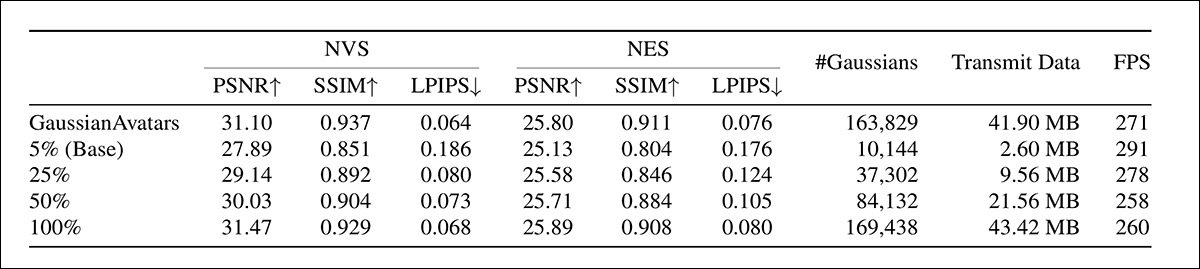

Ensuite, les chercheurs ont testé le rendu progressif lui-même. Cela a été réalisé sur un NVIDIA RTX 4090, avec 24 Go de VRAM, à une résolution de 550x802px. Dans ce scénario, les auteurs soulignent qu’un budget de 25 % utiliserait toutes les gaussiennes de « niveau 1 », ainsi qu’un sous-ensemble de gaussiennes de niveau 2, ce qui donne une idée de la manière dont les groupes de gaussiennes accumulent des détails dans les groupes à numéro plus élevé, et que les groupes à numéro inférieur construisent essentiellement la toile de base :

Performances sous différents budgets de transmission pour la synthèse de vues et d’expressions nouvelles, montrant que la qualité s’approche régulièrement ou dépasse GaussianAvatars à mesure que davantage de gaussiennes et de données sont diffusées, tandis que les vitesses en temps réel sont maintenues, sur un RTX 4090.

Les auteurs commentent :

‘Avec seulement 2,60 Mo transmis (5 % de budget), l’avatar atteint déjà une qualité raisonnable. À mesure que des gaussiennes de niveau supérieur sont diffusées, les structures fines telles que les boutons de chemise, les dents et les cheveux se précisent progressivement, tandis que la stabilité temporelle est maintenue.

‘À 100 % de transmission, notre approche atteint une qualité de rendu comparable aux méthodes de pointe. Notamment, les taux de trames ne diminuent pas de manière significative, probablement parce que la charge de travail 3DGS n’a pas encore saturé le GPU.’

Cependant, les auteurs soulignent que dans les scénarios de réalité virtuelle multi-utilisateurs, le nombre de gaussiennes 3D augmenterait rapidement au point où la rasterisation GPU deviendrait un goulet d’étranglement. Dans ces scénarios plus lourds, l’approche proposée offre un avantage en permettant au système de faire un compromis entre le nombre de primitives et la qualité visuelle, en réduisant la charge sans effondrer le rendu.

Bien que l’article ne le détaille pas, le site du projet présente des comparaisons de test supplémentaires, mettant également en vedette le projet MeGA d’avatar hybride maillage-gaussien :

Cliquez pour jouer. L’une d’une série de vidéos supplémentaires du site du projet, cette vidéo compare la nouvelle approche en termes de synthèse de vues nouvelles.

Conclusion

Le splatting gaussien peut ou non durer, ou même être rappelé plus tard en ce qui concerne l’aube du streaming interactif : les expériences de représentation 3D basées sur l’IA, y compris la vidéoconférence, les achats virtuels, la navigation de route et les applications de divertissement diverses. Il se peut que des technologies ou des approches alternatives l’emportent, ou que GSplat prouve être la représentation vidéo la plus fiable basée sur l’IA.

Si rien d’autre, ce nouvel article intéressant annonce un peu de la portée de ce nouveau domaine, tout en nous rappelant, peut-être de manière nostalgique, de l’Internet à bande passante restreinte d’autrefois.

* Par « 3D », je n’entends pas l’expérience qui nécessite des lunettes spéciales, mais plutôt des expériences où le contenu multimédia a une certaine compréhension des coordonnées X/Y/Z.

Publié pour la première fois mercredi 18 mars 2026