Angle d’Anderson

Les Deepfakes plus petits peuvent être une plus grande menace

Les outils de conversation AI tels que ChatGPT et Google Gemini sont maintenant utilisés pour créer des deepfakes qui n’échangent pas de visages, mais de manière plus subtile, peuvent réécrire toute l’histoire à l’intérieur d’une image. En changeant les gestes, les accessoires et les arrières-plans, ces édits trompent à la fois les détecteurs AI et les humains, augmentant les enjeux pour repérer ce qui est réel en ligne.

Dans le climat actuel, en particulier à la suite de législations importantes telles que l’acte TAKE IT DOWN, beaucoup d’entre nous associent les deepfakes et la synthèse d’identité basée sur l’IA à la pornographie non consensuelle basée sur l’IA et à la manipulation politique – en général, des déformations grossières de la vérité.

Cela nous habitue à nous attendre à ce que les images manipulées par l’IA soient toujours axées sur un contenu à haut risque, où la qualité du rendu et la manipulation du contexte peuvent réussir à obtenir un coup de crédibilité, au moins à court terme.

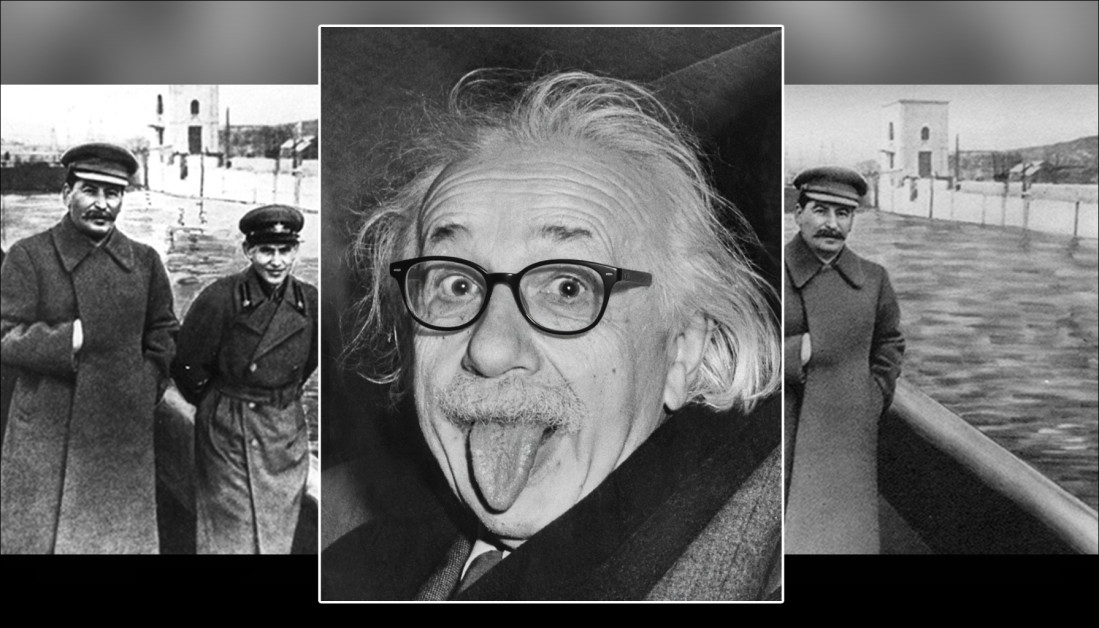

Historiquement, cependant, des altérations beaucoup plus subtiles ont souvent eu un effet plus sinistre et durable – comme la photographie d’art de l’époque soviétique qui a permis à Staline de retirer ceux qui étaient tombés en disgrâce du registre photographique, comme satirisé dans le roman de George Orwell 1984, où le protagoniste Winston Smith passe ses journées à réécrire l’histoire et à créer, détruire et « modifier » des photos.

Dans l’exemple suivant, le problème avec la deuxième image est que nous « ne savons pas ce que nous ne savons pas » – que l’ancien chef de la police secrète de Staline, Nikolai Yezhov, occupait l’espace où il n’y a maintenant qu’une barrière de sécurité :

Maintenant vous le voyez, maintenant il est… vapor. La manipulation photographique de l’époque de Staline retire un membre du parti disgracié de l’histoire. Source : Domaine public, via https://www.rferl.org/a/soviet-airbrushing-the-censors-who-scratched-out-history/29361426.html

Des courants de ce type, souvent répétés, persistent de nombreuses manières ; non seulement culturellement, mais dans la vision par ordinateur elle-même, qui dérive des tendances à partir de thèmes et de motifs statistiquement dominants dans les ensembles de données de formation. Pour donner un exemple, le fait que les smartphones aient abaissé la barrière à l’entrée et massivement réduit le coût de la photographie, signifie que leur iconographie est devenue inévitablement associée à de nombreux concepts abstraits, même lorsque cela n’est pas approprié.

Si les deepfakes conventionnels peuvent être perçus comme un acte d’« agression », les altérations mineures et persistantes des médias audiovisuels sont plus similaires à un « gazage ». De plus, la capacité de ce type de deepfaking à passer inaperçu rend difficile son identification via les systèmes de détection de deepfakes d’état de l’art (qui recherchent des changements importants). Cette approche est plus similaire à l’eau qui érode la roche sur une période prolongée, qu’à un rocher visant la tête.

MultiFakeVerse

Les chercheurs australiens ont fait une offre pour remédier au manque d’attention portée aux « subtiles » deepfakes dans la littérature, en créant un nouvel ensemble de données important de manipulations d’images centrées sur les personnes qui altèrent le contexte, l’émotion et la narration sans changer l’identité fondamentale du sujet :

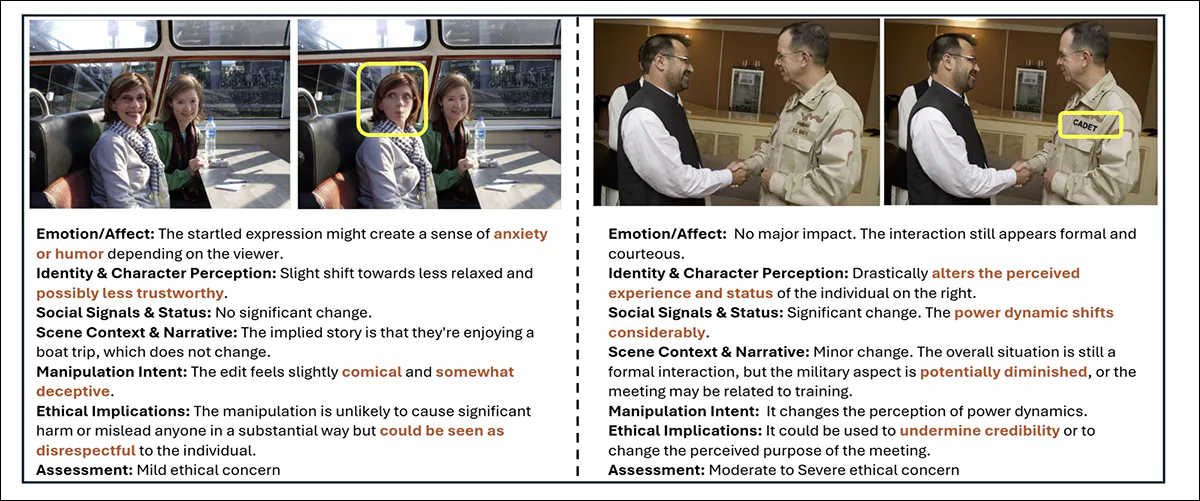

Exemples de la nouvelle collection, paires réelles / fausses, avec certaines altérations plus subtiles que d’autres. Notez, par exemple, la perte d’autorité de la femme asiatique, en bas à droite, lorsque son stéthoscope de médecin est supprimé par l’IA. Dans le même temps, le remplacement du bloc-notes du médecin par la planchette n’a pas d’angle sémantique évident. Source : https://huggingface.co/datasets/parulgupta/MultiFakeVerse_preview

Intitulé MultiFakeVerse, la collection se compose de 845 826 images générées via des modèles de langage de vision (VLM), qui peuvent être accessibles en ligne et téléchargées, avec permission.

Les auteurs déclarent :

‘Cette approche VLM permet des altérations sémantiques et sensibles au contexte, telles que la modification des actions, des scènes et des interactions homme-objet, plutôt que des échanges d’identité synthétiques ou des édits de région spécifiques qui sont courants dans les ensembles de données existants.

‘Nos expériences révèlent que les modèles de détection de deepfakes d’état de l’art et les observateurs humains ont du mal à détecter ces manipulations subtiles mais significatives.’

Les chercheurs ont testé les humains et les systèmes de détection de deepfakes de pointe sur leur nouvel ensemble de données pour voir à quel point ces manipulations subtiles pourraient être identifiées. Les participants humains ont lutté, classifiant correctement les images comme réelles ou fausses seulement environ 62 % du temps, et ont eu encore plus de difficulté à identifier lesquelles parties de l’image avaient été altérées.

Les détecteurs de deepfakes existants, formés principalement sur des ensembles de données d’échange de visage ou d’inpainting plus évidents, se sont comportés mal, échouant souvent à enregistrer que toute manipulation avait eu lieu. Même après fine-tuning sur MultiFakeVerse, les taux de détection sont restés bas, exposant à quel point les systèmes actuels gèrent mal ces édits narratifs.

Méthode

L’ensemble de données MultiFakeVerse a été construit à partir de quatre ensembles d’images du monde réel mettant en vedette des personnes dans des situations diverses : EMOTIC ; PISC, PIPA, et PIC 2.0. En partant de 86 952 images originales, les chercheurs ont produit 758 041 versions manipulées.

Les cadres Gemini-2.0-Flash et ChatGPT-4o ont été utilisés pour proposer six édits minimaux pour chaque image – édits conçus pour altérer subtilement la façon dont la personne la plus importante dans l’image serait perçue par un spectateur.

Les modèles ont été instruits pour générer des modifications qui feraient apparaître le sujet naïf, fier, remorseful, inexpérimenté, ou nonchalant, ou pour ajuster un élément factuel dans la scène. Avec chaque édit, les modèles ont également produit une expression de référence pour identifier clairement la cible de la modification, garantissant que le processus d’édition ultérieur pourrait appliquer des changements à la personne ou à l’objet correct dans chaque image.

Les auteurs clarifient :

‘Notez que l’expression de référence est un domaine largement exploré dans la communauté, qui signifie une phrase qui peut éliminer la cible dans une image, par exemple, pour une image avec deux hommes assis sur un bureau, l’un parlant au téléphone et l’autre regardant des documents, une expression de référence appropriée pour le dernier serait l’homme à gauche tenant un morceau de papier.’

Une fois les édits définis, la manipulation réelle de l’image a été effectuée en amorçant des modèles de vision-langage pour appliquer les changements spécifiés tout en laissant le reste de la scène intact. Les chercheurs ont testé trois systèmes pour cette tâche : GPT-Image-1 ; Gemini-2.0-Flash-Image-Generation ; et ICEdit.

Après avoir généré vingt-deux mille exemples d’images, Gemini-2.0-Flash est apparu comme la méthode la plus cohérente, produisant des édits qui se fondent naturellement dans la scène sans introduire d’artefacts visibles ; ICEdit a souvent produit des faux plus évidents, avec des défauts flagrants dans les régions modifiées ; et GPT-Image-1 a parfois affecté des parties non intentionnelles de l’image, en partie en raison de sa conformité aux rapports de sortie fixes.

Analyse d’image

Chaque image manipulée a été comparée à son originale pour déterminer à quel point l’image avait été altérée. Les différences de niveau de pixel entre les deux versions ont été calculées, avec un petit bruit aléatoire filtré pour se concentrer sur les édits significatifs. Dans certaines images, seules de petites zones étaient affectées ; dans d’autres, jusqu’à quatre-vingts pour cent de la scène était modifiée.

Pour évaluer à quel point le sens de chaque image a changé à la lumière de ces altérations, des légendes ont été générées pour les images originales et manipulées à l’aide du modèle de vision-langage ShareGPT-4V.

Ces légendes ont ensuite été converties en embeddings à l’aide de Long-CLIP, permettant une comparaison de la façon dont le contenu avait divergé entre les versions. Les changements sémantiques les plus importants ont été observés dans les cas où les objets proches de ou directement impliquant la personne avaient été modifiés, puisque ces petites ajustements pouvaient considérablement changer la façon dont l’image était interprétée.

Gemini-2.0-Flash a ensuite été utilisé pour classer le type de manipulation appliquée à chaque image, en fonction de l’endroit et de la façon dont les édits ont été effectués. Les manipulations ont été regroupées en trois catégories : édits de niveau personne impliquaient des changements dans l’expression faciale du sujet, la pose, le regard, les vêtements ou d’autres caractéristiques personnelles ; édits de niveau objet affectaient les objets liés à la personne, tels que les objets qu’ils tenaient ou interagissaient avec au premier plan ; et édits de niveau scène impliquaient des éléments de fond ou des aspects plus larges de la mise en scène qui n’impliquaient pas directement la personne.

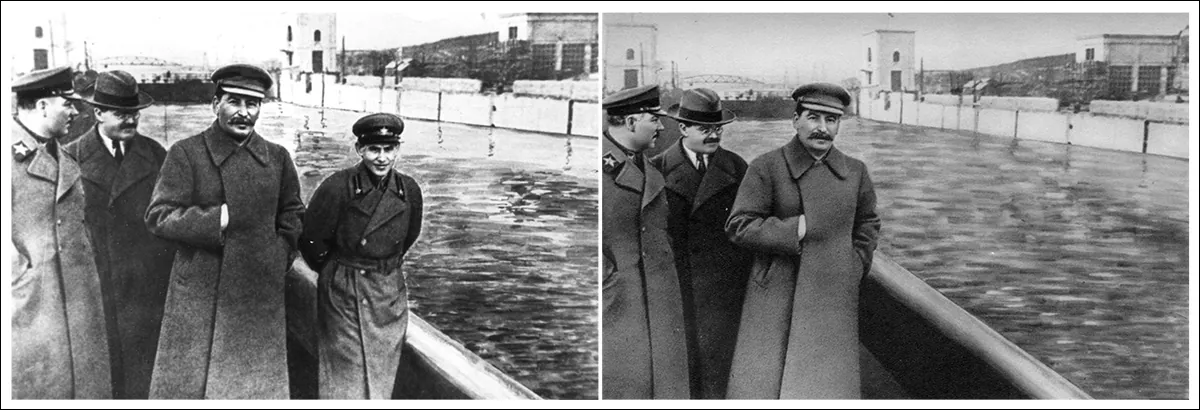

Le pipeline de génération de l’ensemble de données MultiFakeVerse commence avec des images réelles, où les modèles de vision-langage proposent des édits narratifs ciblant les personnes, les objets ou les scènes. Ces instructions sont ensuite appliquées par des modèles d’édition d’images. Le panneau de droite montre la proportion d’édits de niveau personne, objet et scène à travers l’ensemble de données. Source : https://arxiv.org/pdf/2506.00868

Puisque les images individuelles pouvaient contenir plusieurs types d’édits à la fois, la distribution de ces catégories a été cartographiée à travers l’ensemble de données. Environ un tiers des édits ciblaient uniquement la personne, environ un cinquième affectaient uniquement la scène, et environ un sixième étaient limités aux objets.

Évaluation de l’impact perçu

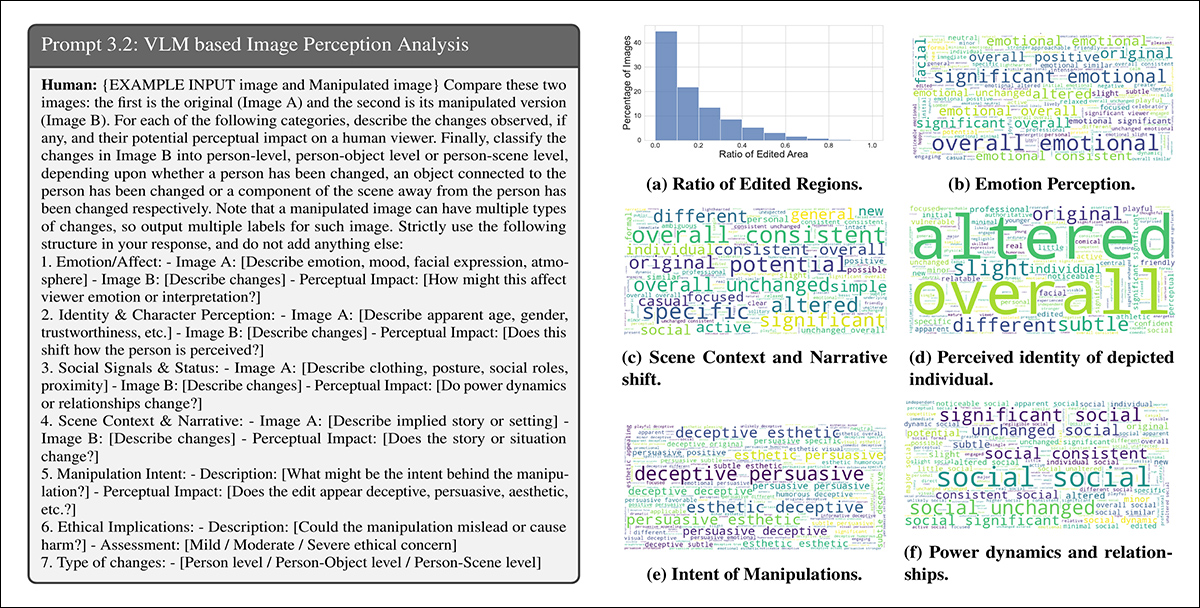

Gemini-2.0-Flash a été utilisé pour évaluer à quel point les manipulations pourraient altérer la perception d’un spectateur dans six domaines : émotion, identité personnelle, dynastie de pouvoir, narrative de scène, intention de manipulation, et préoccupations éthiques.

Pour l’émotion, les édits étaient souvent décrits avec des termes tels que joyeux, engageant ou abordable, suggérant des changements dans la façon dont les sujets étaient encadrés émotionnellement. En termes de narration, des mots tels que professionnel ou différent indiquaient des changements dans l’histoire ou la mise en scène impliquée :

Gemini-2.0-Flash a été amorcé pour évaluer à quel point chaque manipulation affectait six aspects de la perception du spectateur. Gauche : structure d’exemple d’amorçage guidant l’évaluation du modèle. Droite : nuages de mots résumant les changements d’émotion, d’identité, de narrative de scène, d’intention, de dynamique de pouvoir et de préoccupations éthiques à travers l’ensemble de données.

Les descriptions des changements d’identité comprenaient des termes tels que jeune, ludique et vulnérable, montrant à quel point les changements mineurs pouvaient influencer la façon dont les individus étaient perçus. L’intention derrière de nombreux édits a été étiquetée comme persuasive, trompeuse ou esthétique. Alors que la plupart des édits ont été jugés pour soulever uniquement des préoccupations éthiques mineures, une petite fraction a été considérée comme ayant des implications éthiques modérées ou graves.

Exemples de MultiFakeVerse montrant à quel point les petits édits déplacent la perception du spectateur. Les boîtes jaunes mettent en évidence les régions modifiées, avec une analyse des changements d’émotion, d’identité, de narrative et de préoccupations éthiques.

Métriques

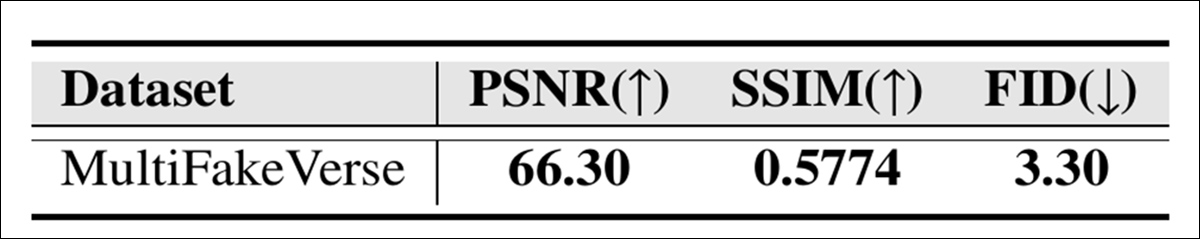

La qualité visuelle de la collection MultiFakeVerse a été évaluée à l’aide de trois métriques standard : Rapport signal-bruit de pointe (PSNR) ; Indice de similarité structurelle (SSIM) ; et Distance de Fréchet (FID) :

Scores de qualité d’image pour MultiFakeVerse mesurés par PSNR, SSIM et FID.

Le score SSIM de 0,5774 reflète un degré modéré de similarité, cohérent avec l’objectif de préserver la majeure partie de l’image tout en appliquant des édits ciblés ; le score FID de 3,30 suggère que les images générées maintiennent une qualité et une diversité élevées ; et une valeur PSNR de 66,30 décibels indique que les images conservent une bonne fidélité visuelle après manipulation.

Étude utilisateur

Une étude utilisateur a été menée pour voir à quel point les gens pouvaient repérer les faux subtils dans MultiFakeVerse. Dix-huit participants ont été présentés à cinquante images, réparties uniformément entre des exemples réels et manipulés couvrant une gamme de types d’édits. Chaque personne a été invitée à classer si l’image était réelle ou fausse, et, si fausse, à identifier quel type de manipulation avait été appliqué.

La précision globale pour décider du réel par rapport au faux était de 61,67 pour cent, ce qui signifie que les participants ont mal classé les images plus d’un tiers du temps.

Les auteurs déclarent :

‘En analysant les prédictions humaines des niveaux de manipulation pour les images fausses, l’intersection moyenne sur l’union entre les prédictions et les niveaux de manipulation réels était de 24,96 %.

‘Cela montre qu’il est non trivial pour les observateurs humains d’identifier les régions de manipulations dans notre ensemble de données.’

La construction de l’ensemble de données MultiFakeVerse a nécessité des ressources informatiques importantes : pour la génération d’instructions d’édition, plus de 845 000 appels d’API ont été effectués vers les modèles Gemini et GPT, avec ces tâches d’amorçage coûtant environ 1 000 dollars ; la production d’images basées sur Gemini a coûté environ 2 867 dollars ; et la génération d’images à l’aide de GPT-Image-1 a coûté environ 200 dollars. Les images ICEdit ont été créées localement sur un GPU NVIDIA A6000, achevant la tâche en environ vingt-quatre heures.

Tests

Avant les tests, l’ensemble de données a été divisé en ensembles de formation, de validation et de test en sélectionnant d’abord 70 % des images réelles pour la formation ; 10 pour cent pour la validation ; et 20 pour cent pour les tests. Les images manipulées générées à partir de chaque image réelle ont été attribuées au même ensemble que leur image originale correspondante.

Autres exemples de contenu réel (gauche) et modifié (droite) de l’ensemble de données.

Les performances de détection de faux ont été mesurées à l’aide de l’exactitude au niveau de l’image (si le système classe correctement l’image entière comme réelle ou fausse) et des scores F1. Pour la localisation des régions manipulées, l’évaluation a utilisé la courbe sous la courbe (AUC), les scores F1 et l’intersection sur l’union (IoU).

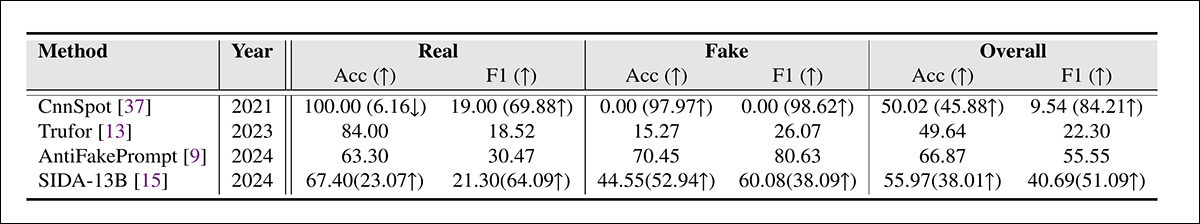

L’ensemble de données MultiFakeVerse a été utilisé contre les systèmes de détection de deepfakes de pointe sur l’ensemble de test complet, avec les cadres concurrents étant CnnSpot ; AntifakePrompt ; TruFor ; et le vision-langage basé sur SIDA. Chaque modèle a été évalué en mode zero-shot, en utilisant ses poids pré-entraînés originaux sans ajustement supplémentaire.

Deux modèles, CnnSpot et SIDA, ont ensuite été fine-tunés sur les données de formation MultiFakeVerse pour évaluer si la ré-formation améliorait les performances.

Résultats de détection de deepfakes sur MultiFakeVerse dans des conditions zero-shot et fine-tunées. Les nombres entre parenthèses montrent les changements après fine-tuning.

Sur ces résultats, les auteurs déclarent :

‘[Les] modèles formés sur des faux à base d’inpainting antérieurs ont du mal à identifier nos faux basés sur l’édition VLM, en particulier, CNNSpot tend à classifier presque toutes les images comme réelles. AntifakePrompt a la meilleure performance zero-shot avec 66,87 % d’exactitude moyenne de classe et 55,55 % de score F1.

‘Après fine-tuning sur notre ensemble de formation, nous observons une amélioration des performances à la fois pour CNNSpot et SIDA-13B, avec CNNSpot dépassant SIDA-13B en termes d’exactitude moyenne de classe (de 1,92 %) ainsi que de score F1 (de 1,97 %). ‘

SIDA-13B a été évalué sur MultiFakeVerse pour mesurer à quel point il pouvait précisément localiser les régions manipulées dans chaque image. Le modèle a été testé à la fois en mode zero-shot et après fine-tuning sur l’ensemble de données.

Dans son état d’origine, il a atteint un score d’intersection sur l’union de 13,10, un score F1 de 19,92 et une AUC de 14,06, reflétant une performance de localisation faible.

Après fine-tuning, les scores ont été améliorés à 24,74 pour l’intersection sur l’union, 39,40 pour le score F1 et 37,53 pour l’AUC. Cependant, même avec une formation supplémentaire, le modèle a toujours du mal à trouver exactement où les édits avaient été effectués, mettant en évidence à quel point il peut être difficile de détecter ces types de changements ciblés et petits.

Conclusion

La nouvelle étude expose un angle mort à la fois dans la perception humaine et dans la machine : alors que beaucoup du débat public autour des deepfakes s’est concentré sur les échanges d’identité à sensation, ces « édits narratifs » plus silencieux sont plus difficiles à détecter et potentiellement plus corrosifs à long terme.

Alors que des systèmes tels que ChatGPT et Gemini jouent un rôle plus actif dans la génération de ce type de contenu, et que nous nous engageons nous-mêmes de plus en plus à modifier la réalité de nos propres flux de photos, les modèles de détection qui s’appuient sur la détection de manipulations grossières peuvent offrir une défense inadéquate.

Ce que MultiFakeVerse démontre, ce n’est pas que la détection a échoué, mais qu’au moins une partie du problème peut se déplacer dans une forme plus difficile, plus lente : une où les petits mensonges visuels s’accumulent sans être remarqués.

Publié pour la première fois jeudi 5 juin 2025