Angle d’Anderson

Les recherches suggèrent que ChatGPT a une grande crédibilité en tant que fournisseur de nouvelles

De nouvelles recherches suggèrent que les étiquettes de vérification des faits de ChatGPT surpassent les likes, les partages et même les marques de nouvelles de confiance lorsqu’il s’agit de façonner ce que les gens croient et veulent partager en ligne.

Une nouvelle étude de 1 000 personnes a constaté que lorsque ChatGPT attribue un score de crédibilité aux actualités politiques, il change souvent ce que les gens croient, et s’ils veulent le partager – peu importe leurs opinions politiques initiales. Les facteurs d’influence plus traditionnels tels que les likes ou les partages n’ont pas eu beaucoup d’effet, mais le jugement de l’IA a fortement façonné la façon dont les nouvelles semblaient dignes de confiance :

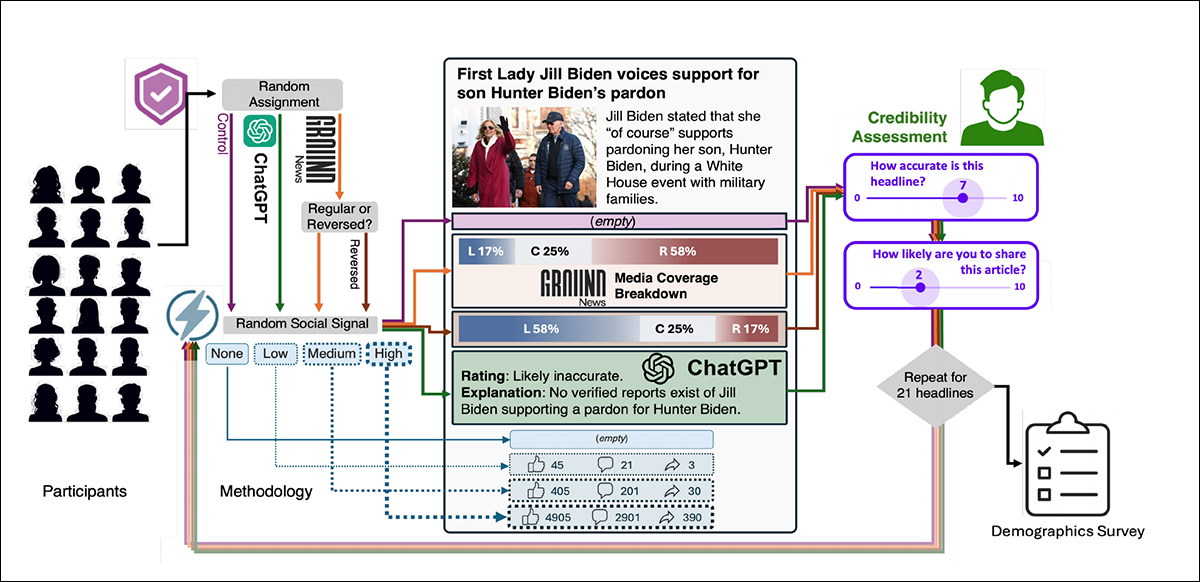

![À partir du nouveau document, une illustration de la façon dont les gens évaluent un titre de nouvelle, en fonction de trois signaux interactifs : si l'histoire correspond à leur identité politique ; combien d'engagement il semble avoir sur les médias sociaux ; et les signaux de crédibilité fournis par les institutions ou les systèmes d'IA. Ces influences combinent pour façonner à la fois l'exactitude perçue et la probabilité de partager le contenu. [ Source ] https://arxiv.org/pdf/2511.02370](https://www.unite.ai/wp-content/uploads/2025/11/figure-1.jpg)

À partir du nouveau document, une illustration de la façon dont les gens évaluent un titre de nouvelle, en fonction de trois signaux interactifs : si l’histoire correspond à leur identité politique ; combien d’engagement il semble avoir sur les médias sociaux ; et les signaux de crédibilité fournis par les institutions ou les systèmes d’IA. Ces influences combinent pour façonner à la fois l’exactitude perçue et la probabilité de partager le contenu. Source

La mesure dans laquelle les résumés d’IA sont considérés comme des sources de nouvelles crédibles est peut-être l’un des sujets les plus importants dans les médias depuis de nombreuses années, notamment parce que les résumés d’IA de Google ont drainé le trafic de la plupart des grands médias en ligne en 2025, sans certitude sur la direction que ce transfert de pouvoir pourrait prendre à long ou même à moyen terme.

Les auteurs du nouveau travail déclarent :

‘Ces résultats mettent en évidence à la fois le potentiel et le risque des rétroactions algorithmiques pour façonner la compréhension publique. Les signaux générés par l’IA peuvent aider à atténuer les préjugés et à améliorer la discernement de la crédibilité, mais leur influence varie en fonction de l’identité politique et comporte des risques éthiques liés à la surextension […]

‘…L’influence disproportionnée de ChatGPT met en évidence un compromis critique : bien que persuasif, les rétroactions de l’IA peuvent remplacer la pensée critique si elles ne sont pas soigneusement formulées.’

Les auteurs suggèrent que les recherches futures devraient se concentrer sur l’amélioration des interventions de crédibilité de l’IA qui sont plus indépendantes et favorisent les faits connus, et ils observent que cela est particulièrement important dans les sujets qui sont polarisés.

En plus de l’ascension apparente de ChatGPT en tant qu’« autorité », et de l’influence inattendument faible des signaux de partage dans les tests (que les auteurs pensent peut être attribuable aux conditions de test légèrement stériles), un autre résultat intéressant des tests des chercheurs concerne les démographiques et le sexe :

Les femmes et les participants minoritaires raciaux (en particulier les utilisateurs noirs et latinos) ont répondu plus positivement aux rétroactions basées sur l’IA qu’aux étiquettes institutionnelles.’

Le nouveau travail s’intitule Les signaux de crédibilité de l’IA surpassent les institutions et l’engagement pour façonner la perception des nouvelles sur les médias sociaux, et provient de trois chercheurs de l’Université de Notre-Dame.

Examinons de plus près les méthodes et les conclusions du document.

Méthode

Quatre hypothèses ont été testées : que les gens évaluent les titres comme plus précis lorsqu’ils reflètent leurs opinions politiques ; que les scores de crédibilité générés par l’IA sont plus influents que les signaux des institutions établies ; que les titres avec un engagement élevé (c’est-à-dire mesuré par les likes, les partages ou les commentaires) sont considérés comme plus fiables ; et que les utilisateurs tendent à accepter le jugement de l’IA sur la précision d’un titre, même lorsqu’il contredit leurs propres croyances.

Les participants à l’étude ont été recrutés sur la plate-forme Prolific, et devaient être fluent en anglais, ainsi que des consommateurs réguliers de nouvelles ; et un processus de randomisation a garanti que les participants représentaient une diversité de points de vue raciaux et de sexe.

Dans l’expérience*, les participants ont été divisés en quatre groupes, chacun montrant un type différent de rétroaction aux côtés des titres de nouvelles.

Dans le premier groupe (la condition de contrôle), aucune information supplémentaire n’a été fournie sur la crédibilité potentielle du titre ; dans le deuxième groupe, les titres ont été étiquetés avec une note de biais de GroundNews, un service qui classe les sources de nouvelles en gauchistes, centristes ou de droite.

Un troisième groupe a vu les mêmes étiquettes GroundNews, mais sciemment inversées, créant une discordance destinée à tester si les utilisateurs détecteraient la distorsion.

Le dernier groupe a été montré des évaluations de crédibilité rédigées par ChatGPT, offrant une brève explication et une note telle que ‘peu probablement inexact’ :

Schéma conceptuel de l’expérience : chaque participant a été montré des titres de nouvelles politiques avec des combinaisons variables d’étiquettes de crédibilité et de signaux d’engagement social. Les réponses ont été collectées sur la façon dont chaque titre semblait précis, et sur la probabilité qu’il soit partagé, avec la séquence complète répétée sur 21 éléments.

Données et tests

Chaque participant a été montré une séquence de 21 titres de nouvelles politiques. Pour chaque titre, le niveau d’engagement social a varié ; parfois, il n’y avait pas de likes ou de partages, parfois beaucoup. Ces signaux d’engagement ont été randomisés pour éviter des modèles fixes.

Les titres eux-mêmes provenaient d’un mélange de perspectives politiques, et ont été étiquetés comme gauchistes, de droite ou centristes.

Après chaque titre, les participants ont été demandés de dire combien ils pensaient que cela était précis, et s’ils considéreraient le partager. Puisque chaque participant avait déjà déclaré son affiliation politique, il a été possible d’analyser si les titres de la même tendance politique étaient évalués plus favorablement.

Les participants ont noté chaque titre deux fois : une fois pour la précision qu’il semblait avoir, et une fois pour la probabilité qu’ils le partagent, avec leurs réponses mesurées sur une échelle de 0 à 10.

Les chercheurs ont ensuite combiné ces réponses avec des données supplémentaires : des informations démographiques et sur l’utilisation des médias de chaque participant ; des étiquettes politiques pour chaque titre ; le type de signal de crédibilité montré ; et le niveau d’engagement social assigné.

Influence de l’identité politique

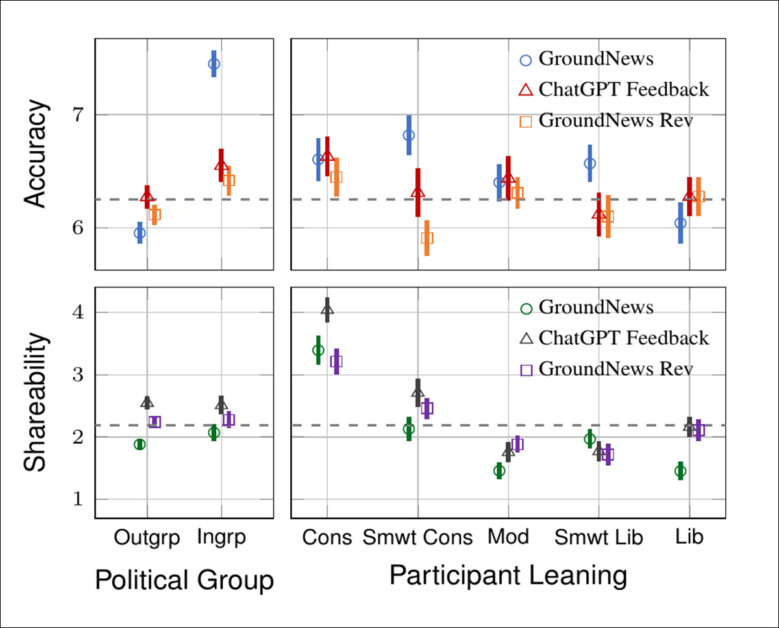

Dans le premier test, qui visait à déterminer si les gens évaluent les titres comme plus précis lorsqu’ils reflètent leurs opinions politiques, les résultats ont indiqué que les participants étaient plus susceptibles de croire les titres qui correspondaient à leurs opinions politiques – mais que cela dépendait du groupe.

Les modérés ont montré le préjugé le plus fort en faveur de leur propre camp, tandis que les libéraux et les conservateurs ont tendance à faire confiance aux titres centristes le plus ; et dans l’ensemble, les titres neutres ont été évalués comme plus précis que les titres gauchistes ou de droite.

Une illustration de la façon dont les notes de précision et de partage ont changé en fonction de la position politique du titre et de l’affiliation politique du participant. Les modérés étaient les plus susceptibles d’évaluer les titres ‘du groupe’ comme précis, tandis que les libéraux et les conservateurs préféraient les titres centristes. Le comportement de partage a suivi un modèle similaire, avec un préjugé de groupe limité en dehors du groupe modéré.

Dans les résultats de cette première expérience, un effet de groupe modeste sur la partageabilité a été trouvé ; mais seulement pour les modérés, qui étaient plus enclins à partager des titres politiquement alignés (c’est-à-dire neutres). Les libéraux et les conservateurs n’ont pas montré cette tendance.

L’analyse de la variance (ANOVA), une méthode utilisée pour détecter les différences entre les groupes, a montré que l’alignement a affecté le partage uniquement lorsqu’il interagissait avec l’identité politique. La crédibilité et le partage étaient liés, mais seulement les modérés ont montré un modèle clair dans les deux.

Credibilité institutionnelle vs. IA

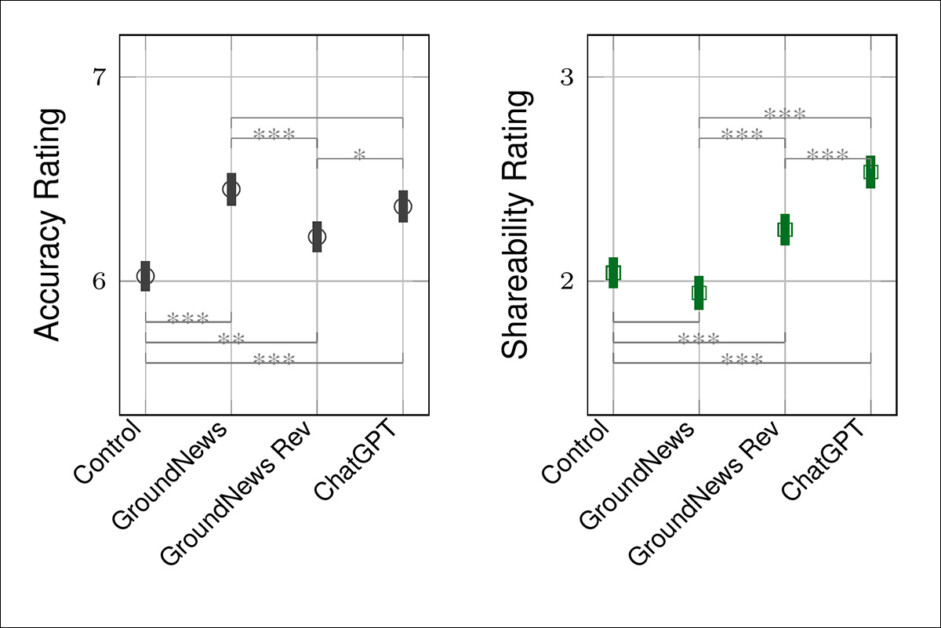

Le prochain test a demandé si les gens font confiance aux notes de l’IA plus que aux sources traditionnelles telles que les sites de notation de nouvelles – notamment lorsque les notes pourraient être en désaccord avec leurs opinions politiques :

Notes de crédibilité et de partageabilité à travers les sources de rétroaction : tous les trois signaux ont augmenté la précision par rapport au contrôle, avec GroundNews obtenant les notes les plus élevées. Cependant, ChatGPT a produit les plus grands gains en partageabilité, suggérant qu’il avait un impact persuasif plus large. Les barres d’erreur montrent les intervalles de confiance à 95 %, et les astérisques marquent les différences pair à pair significatives.

Toutes les rétroactions ont augmenté la précision perçue ; mais GroundNews a été le plus efficace lorsqu’il correspondait à la politique de l’utilisateur.

ChatGPT a augmenté les notes de précision dans l’ensemble, indiquant qu’il a été considéré comme plus neutre. Les conservateurs étaient moins influencés par GroundNews, mais ont répondu à ChatGPT de manière similaire aux autres groupes :

Ici, nous pouvons voir les effets de la rétroaction de ChatGPT sur la précision perçue. Les résultats indiquent que la confiance dans les signaux institutionnels dépend de l’alignement, tandis que la confiance dans les signaux algorithmiques ne dépend pas. ChatGPT a amélioré à la fois la crédibilité et la partageabilité dans l’ensemble des groupes – en particulier pour les conservateurs.

Les métriques sociales ont peu d’impact

La troisième analyse a testé si les signaux d’engagement social visibles tels que les likes, les partages et les commentaires augmenteraient la crédibilité ou la partageabilité en agissant comme une preuve sociale ; mais aucun tel effet n’a été observé.

Les tests ont montré que les niveaux d’engagement, tels que les likes ou les partages, n’ont eu aucun effet réel sur la façon dont les titres semblaient précis, et seulement un faible effet, peu fiable, sur la façon dont ils semblaient partageables ; contrairement aux signaux algorithmiques ou institutionnels, ces signaux sociaux n’ont pas semblé influencer les jugements dans ce contexte, pour les raisons mentionnées plus tôt dans l’article.

La rétroaction de l’IA influence ce que les gens font confiance

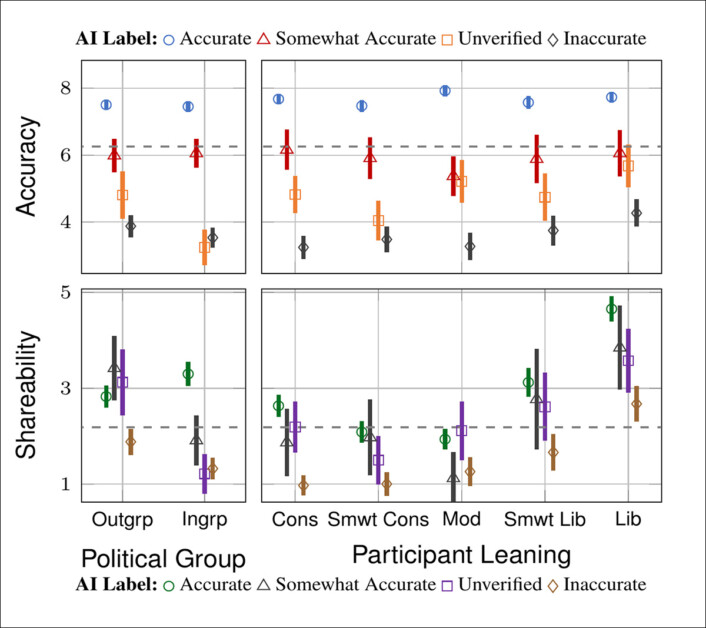

Le quatrième et dernier test a examiné si les utilisateurs ajusteraient leurs jugements de crédibilité et de partage en réponse aux étiquettes générées par l’IA : précis ; plutôt précis ; non vérifié ; ou inexact, tous attribués par ChatGPT.

Les participants ont répondu fortement aux étiquettes de crédibilité générées par l’IA. Les notes de précision ont augmenté ou diminué en fonction de la rétroaction de ChatGPT, avec les effets les plus importants observés lorsque les titres étaient étiquetés précis ou inexact :

La rétroaction de ChatGPT a influencé à la fois les notes de précision et de partageabilité. En haut : les notes de précision ont augmenté avec des étiquettes plus positives, en particulier lorsque les titres étaient marqués ‘Précis’, et ont diminué lorsqu’ils étaient étiquetés ‘Inexact’. En bas : la partageabilité a suivi un modèle similaire mais a montré une plus grande variation par groupe : les libéraux ont répondu plus fortement aux signaux négatifs, tandis que les conservateurs ont montré des changements plus atténués.

L’identité politique a façonné ces effets, les utilisateurs faisant plus confiance à ChatGPT lorsqu’il correspondait à leurs propres opinions.

Le comportement de partage a suivi un modèle similaire : les titres du groupe étiquetés comme précis ont été partagés le plus souvent, en particulier sous des étiquettes ambigües comme plutôt précis.

Ces résultats, selon le document, suggèrent que la rétroaction de l’IA peut modifier le comportement des utilisateurs ; et qu’elle risque également de renforcer les divisions partisanes ou de décourager la pensée critique.

Qui fait le plus confiance à l’IA ?

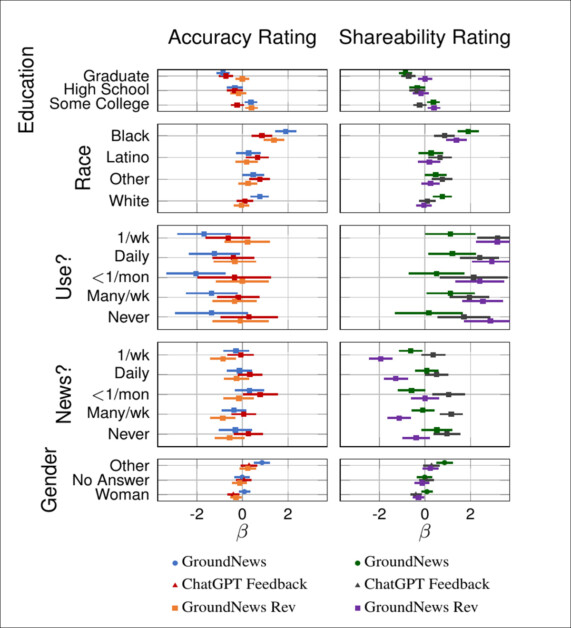

L’analyse de suivi a examiné comment les démographiques des utilisateurs ont façonné les réactions aux étiquettes de crédibilité. La rétroaction de ChatGPT a augmenté les notes de précision dans l’ensemble, mais l’effet a été plus faible parmi les utilisateurs très instruits, et les consommateurs fréquents de médias sociaux, qui ont montré plus de scepticisme.

Ces mêmes groupes ont réagi négativement aux étiquettes GroundNews et Reversed, suggérant, selon le document, que les marqueurs de biais explicites peuvent aliéner les utilisateurs les plus avertis des médias.

En revanche, les femmes et les participants minoritaires raciaux, en particulier les utilisateurs noirs et latinos, ont répondu plus positivement à ChatGPT qu’aux signaux institutionnels :

Réponses démographiques aux types de rétroaction, avec chaque panneau montrant comment un groupe particulier a répondu à différents signaux de crédibilité. Les notes de ChatGPT ont eu l’influence la plus forte et la plus cohérente sur la précision, tandis que les effets sur le partage étaient moins uniformes, avec des variations en fonction de la race, du sexe et de l’utilisation des médias.

Le comportement de partage a répondu à cette division : GroundNews a réduit la partageabilité le plus fortement parmi les utilisateurs de médias sociaux et les amateurs de nouvelles, tandis que les effets de ChatGPT étaient plus mélangés, voire augmentant la partageabilité dans certains groupes, avec les détenteurs de diplômes universitaires réagissant particulièrement aux tous types de rétroaction.

Les auteurs concluent :

‘Ces résultats ont des implications directes pour la conception d’interventions de crédibilité dans les systèmes sociotechniques. Les utilisateurs sont de plus en plus influencés par les rétroactions algorithmiques, qui peuvent remplacer les signaux institutionnels et modérer les préjugés partisans – mais également risquent de promouvoir la surextension.’

‘Les signaux institutionnels restent efficaces pour certains utilisateurs, mais leur impact diminue dans des environnements politiquement polarisés ou [à faible confiance]. Pendant ce temps, les métriques d’engagement telles que les likes et les partages ont été largement ignorées, suggérant une valeur persuasive réduite lorsqu’elles sont présentées sans contexte social.’

‘Pour soutenir une évaluation équitable et éclairée des nouvelles, les interventions basées sur l’IA doivent être transparentes, explicatives et conçues pour améliorer l’autonomie de l’utilisateur. ‘

‘Les travaux futurs devraient examiner ces mécanismes dans des contextes plus écologiquement valides, évaluer les cadres de crédibilité de l’IA alternatifs et développer des systèmes adaptatifs qui favorisent l’engagement critique dans des publics politiquement divers.’

Conclusion

Compte tenu de la tendance de tous les systèmes d’IA génératifs actuels à halluciner et déformer la vérité, il est arguable qu’il est de quelque préoccupation que l’adoption à grande échelle (même si elle ralentit un peu) de ChatGPT représente également un saut de foi considérable que les architectures de ces systèmes ne peuvent justifier ni soutenir.

Un problème avec la confiance dans la représentation de l’IA des nouvelles est le manque de systèmes efficaces qui peuvent contextualiser les sources de nouvelles comme ‘affiliées politiquement’, ou inclinées vers un ou l’autre extrémité du spectre politique.

Même parmi les sources de quatrième état les plus réputées, le choix de ce qui est et ce qui n’est pas couvert est en soi une déclaration politique. Ni ChatGPT ni ses homologues n’est actuellement en mesure de naviguer dans ces couches de biais interprétatif, et le sujet lui-même invite à la discussion plutôt qu’à des conclusions solides.

Un autre problème est que les systèmes de ce type sont arrivés sur la scène en l’un des moments les plus polarisés et divisifs de l’histoire de l’humanité depuis 80 ans, et à un moment où la société est la plus disposée à écouter des ‘voix alternatives’ – telles qu’un tout nouveau genre de technologie qui est vanté comme un filtre essentiel de la vérité du monde, plutôt que ce qu’il est réellement : un prédicteur de probabilités statistiques, alimenté par des quantités élevées d’informations partisanes.

* Détails dont les auteurs ont rendu disponibles en ligne (voir document source, bas de la page 2, pour les URL). Cependant, ces données nécessitent une inscription pour être visionnées, et comme je n’ai pas poursuivi la question à ce stade, je ne peux pas confirmer qu’elles peuvent être visionnées entièrement sans paiement et/ou des types spécifiques de références.

Publié pour la première fois mercredi 5 novembre 2025