Intelligence artificielle

Génération de paraphrases à l’aide de l’apprentissage par renforcement profond – Leaders d’opinion

Lorsque nous écrivons ou parlons, nous nous sommes tous demandé s’il existe un meilleur moyen de communiquer une idée aux autres. Quels mots devrais-je utiliser ? Comment devrais-je structurer la pensée ? Comment vont-ils probablement réagir ? Chez Phrasee, nous passons beaucoup de temps à réfléchir au langage – ce qui fonctionne et ce qui ne fonctionne pas.

Imaginez que vous écrivez la ligne d’objet d’une campagne d’e-mail qui sera envoyée à 10 millions de personnes dans votre liste pour promouvoir 20 % de réduction sur un nouvel ordinateur portable de luxe.

Quelle ligne choisiriez-vous :

- Vous pouvez maintenant bénéficier de 20 % de réduction sur votre prochaine commande

- Préparez-vous – 20 % de réduction supplémentaire

Bien qu’ils transmettent les mêmes informations, l’un a atteint un taux d’ouverture presque 15 % supérieur à l’autre (et je parie que vous ne pouvez pas battre notre modèle pour prédire lequel ?). Bien que le langage puisse souvent être testé par le biais de tests A/B ou de bandits multi-bras, la génération automatique de paraphrases reste un problème de recherche très difficile.

Deux phrases sont considérées comme des paraphrases l’une de l’autre si elles partagent le même sens et peuvent être utilisées de manière interchangeable. Une autre chose importante qui est souvent prise pour acquise est de savoir si une phrase générée par une machine est fluide.

Contrairement à l’apprentissage supervisé, les agents d’apprentissage par renforcement (RL) apprennent en interagissant avec leur environnement et en observant les récompenses qu’ils reçoivent en conséquence. Cette différence nuancée a des implications massives sur la façon dont les algorithmes fonctionnent et sur la façon dont les modèles sont formés. L’apprentissage par renforcement profond utilise des réseaux de neurones comme approximateur de fonction pour permettre à l’agent d’apprendre à surpasser les humains dans des environnements complexes tels que Go, Atari et StarCraft II.

Malgré ce succès, l’apprentissage par renforcement n’a pas été largement appliqué à des problèmes du monde réel, y compris le traitement automatique des langues (NLP).

Dans le cadre de mon mémoire de master en science des données, nous démontrons comment le RL profond peut être utilisé pour surpasser les méthodes d’apprentissage supervisé dans la génération automatique de paraphrases de texte d’entrée. Le problème de génération de la meilleure paraphrase peut être considéré comme trouver la série de mots qui maximise la similarité sémantique entre les phrases tout en maintenant la fluidité de la sortie. Les agents RL sont bien adaptés pour trouver le meilleur ensemble d’actions pour atteindre la récompense attendue maximale dans des environnements de contrôle.

Contrairement à la plupart des problèmes d’apprentissage automatique, le plus grand problème dans la plupart des applications de génération de langage naturel (NLG) ne réside pas dans la modélisation, mais plutôt dans l’évaluation. Alors que l’évaluation humaine est actuellement considérée comme la norme de référence dans l’évaluation de la NLG, elle souffre de désavantages importants, notamment le fait d’être coûteuse, fastidieuse, difficile à ajuster et manquant de reproductibilité entre les expériences et les ensembles de données (Han, 2016). Par conséquent, les chercheurs ont longtemps cherché des métriques automatiques qui soient simples, généralisables et qui reflètent le jugement humain (Papineni et al., 2002).

Les méthodes d’évaluation automatiques les plus courantes pour évaluer les légendes d’images générées par machine sont résumées ci-dessous avec leurs avantages et inconvénients :

Chaîne de génération de paraphrases à l’aide de l’apprentissage par renforcement

Nous avons développé un système appelé ParaPhrasee qui génère des paraphrases de haute qualité. Le système se compose de plusieurs étapes afin d’appliquer l’apprentissage par renforcement de manière efficace sur le plan computationnel. Un bref résumé de la chaîne de haute niveau est présenté ci-dessous avec plus de détails contenus dans le mémoire.

Ensemble de données

Il existe plusieurs ensembles de données de paraphrases disponibles qui sont utilisés dans la recherche, notamment : le corpus de paraphrases Microsoft, la compétition de similarité sémantique de l’ACL, Quora Duplicate Questions et Twitter Shared Links. Nous avons sélectionné MS-COCO en raison de sa taille, de sa propreté et de son utilisation comme référence pour deux articles de génération de paraphrases notables. MS-COCO contient 120 000 images de scènes courantes avec 5 légendes d’image par image fournies par 5 annotateurs humains différents.

Bien qu’il soit principalement conçu pour la recherche en vision par ordinateur, les légendes tendent à avoir une similarité sémantique élevée et sont des paraphrases intéressantes. Étant donné que les légendes d’images sont fournies par différentes personnes, elles tendent à avoir des variations légères dans les détails fournis dans la scène, les phrases générées tendent donc à halluciner des détails.

Modèle supervisé

Bien que l’apprentissage par renforcement ait considérablement amélioré en termes d’efficacité des échantillons, de temps de formation et de meilleures pratiques, la formation de modèles RL à partir de zéro est toujours relativement très lente et instable (Arulkumaran et al., 2017). Par conséquent, au lieu de former à partir de zéro, nous formons d’abord un modèle supervisé, puis nous l’affinons en utilisant le RL.

Nous utilisons un cadre de modèle encodeur-décodeur et évaluons les performances de plusieurs modèles supervisés de base. Lors de l’affinement du modèle en utilisant le RL, nous n’affinons que le réseau décodeur et traitons le réseau encodeur comme statique. Nous considérons donc deux principaux cadres :

- La formation du modèle supervisé à partir de zéro en utilisant un encodeur-décodeur standard/vanille avec des GRU

- L’utilisation de modèles d’intégration de phrases préformés pour l’encodeur, notamment : l’intégration de mots regroupés (GloVe), InferSent et BERT

Les modèles supervisés tendent à performer de manière raisonnable, avec BERT et l’encodeur-décodeur vanille atteignant les meilleures performances.

Bien que les performances tendent à être raisonnables, il existe trois sources d’erreur courantes : le bégaiement, la génération de fragments de phrase et les hallucinations. Ce sont les principaux problèmes que l’utilisation du RL vise à résoudre.

Modèle d’apprentissage par renforcement

La mise en œuvre d’algorithmes de RL est très difficile, en particulier lorsque vous ne savez pas si le problème peut être résolu. Il peut y avoir des problèmes dans la mise en œuvre de votre environnement, de vos agents, de vos hyperparamètres, de votre fonction de récompense ou une combinaison de tout ce qui précède ! Ces problèmes sont exacerbés lors de la mise en œuvre de l’apprentissage par renforcement profond, car vous avez le plaisir de la complexité supplémentaire de la débogage des réseaux de neurones.

Comme pour tout débogage, il est crucial de commencer simplement. Nous avons mis en œuvre des variations de deux environnements de jouets RL bien compris (CartPole et FrozenLake) pour tester les algorithmes de RL et trouver une stratégie répétitive pour transférer des connaissances du modèle supervisé.

Nous avons constaté que l’utilisation d’un algorithme Actor-Critic surpassait REINFORCE dans ces environnements. En termes de transfert de connaissances vers le modèle Actor-Critic, nous avons constaté que l’initialisation des poids de l’acteur avec le modèle supervisé formé et la préformation du critique ont atteint les meilleures performances. Nous avons trouvé qu’il était difficile de généraliser des approches de distillation de politique sophistiquées à de nouveaux environnements, car elles introduisent de nombreux nouveaux hyperparamètres qui nécessitent un réglage pour fonctionner.

Étayés par ces connaissances, nous nous tournons ensuite vers le développement d’une approche pour la tâche de génération de paraphrases. Nous devons d’abord créer un environnement.

L’environnement nous permet de tester facilement l’impact de l’utilisation de différentes métriques d’évaluation en tant que fonctions de récompense.

Nous définissons ensuite l’agent, étant donné ses nombreux avantages, nous utilisons une architecture Actor-Critic. L’acteur est utilisé pour sélectionner le mot suivant dans la séquence et a ses poids initialisés en utilisant le modèle supervisé. Le critique fournit une estimation de la récompense attendue qu’un état est susceptible de recevoir pour aider l’acteur à apprendre.

Conception de la bonne fonction de récompense

La composante la plus importante de la conception d’un système de RL est la fonction de récompense, car c’est ce que l’agent de RL tente d’optimiser. Si la fonction de récompense est incorrecte, alors les résultats souffriront, même si toutes les autres parties du système fonctionnent !

Un exemple classique de ceci est CoastRunners où les chercheurs d’OpenAI ont défini la fonction de récompense comme la maximisation du score total plutôt que la victoire dans la course. Le résultat de ceci est que l’agent a découvert une boucle où il pouvait obtenir le score le plus élevé en frappant des turbos sans jamais terminer la course.

https://www.youtube.com/watch?time_continue=2&v=tlOIHko8ySg&feature=emb_title

Étant donné que l’évaluation de la qualité des paraphrases est en soi un problème non résolu, concevoir une fonction de récompense qui capture automatiquement cet objectif est encore plus difficile. La plupart des aspects du langage ne se décomposent pas bien en métriques linéaires et sont dépendants de la tâche (Novikova et al., 2017).

L’agent de RL découvre souvent une stratégie intéressante pour maximiser les récompenses qui exploite les faiblesses de la métrique d’évaluation plutôt que de générer du texte de haute qualité. Cela tend à entraîner de mauvaises performances sur les métriques que l’agent n’optimise pas directement.

Nous considérons trois approches principales :

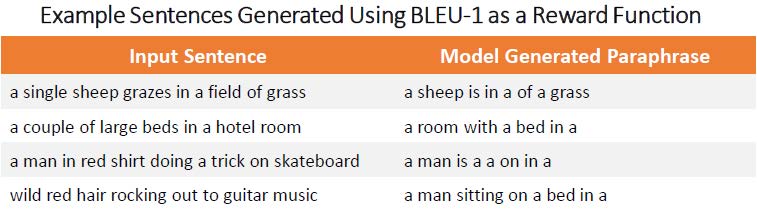

- Métriques de chevauchement de mots

Les métriques d’évaluation de NLP courantes considèrent la proportion de chevauchement de mots entre la paraphrase générée et la phrase d’évaluation. Plus le chevauchement est important, plus la récompense est grande. Le défi avec les approches au niveau des mots est que l’agent inclut trop de mots de connexion tels que « un est sur de » et qu’il n’y a pas de mesure de fluidité. Cela entraîne des paraphrases de très mauvaise qualité.

- Métriques de similarité et de fluidité au niveau de la phrase

Les principales propriétés d’une paraphrase générée sont qu’elle doit être fluide et sémantiquement similaire à la phrase d’entrée. Par conséquent, nous essayons d’évaluer explicitement ces deux aspects, puis de combiner les métriques. Pour la similarité sémantique, nous utilisons la similarité cosinus entre les embeddings de phrases de modèles préformés, notamment BERT. Pour la fluidité, nous utilisons un score basé sur la perplexité d’une phrase à partir de GPT-2. Plus les scores de similarité cosinus et de fluidité sont élevés, plus la récompense est grande.

Nous avons essayé de nombreuses combinaisons différentes de modèles d’intégration de phrases et de modèles de fluidité, et bien que les performances aient été raisonnables, le principal problème que l’agent a rencontré est qu’il n’a pas suffisamment équilibré la similarité sémantique avec la fluidité. Pour la plupart des configurations, l’agent a donné la priorité à la fluidité, ce qui a entraîné la suppression de détails et la plupart des entités ont été placées « au milieu » de quelque chose ou ont été déplacées « sur une table » ou « sur le côté de la route ».

L’apprentissage par renforcement multi-objectif est une question de recherche ouverte et est très difficile dans ce cas.

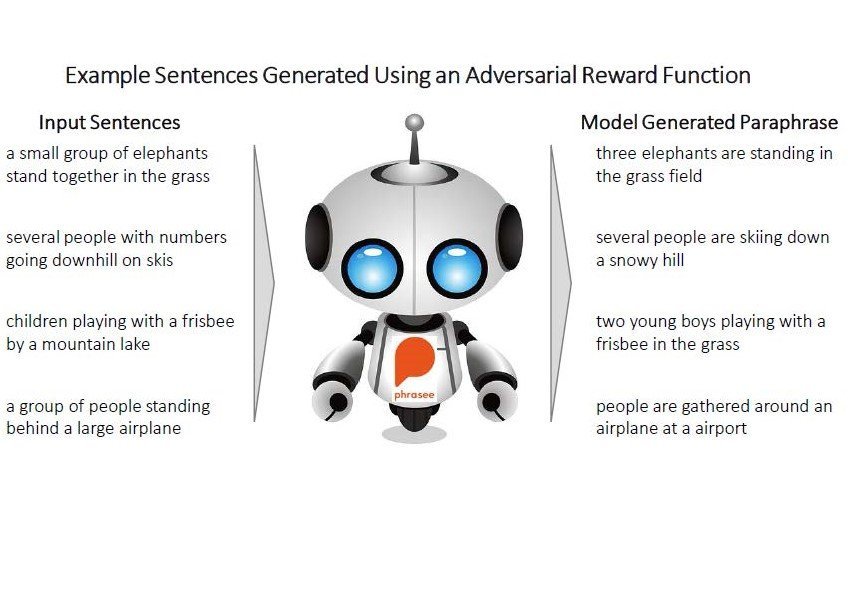

- Utilisation d’un modèle antagoniste comme fonction de récompense

Étant donné que les humains sont considérés comme la norme de référence dans l’évaluation, nous formons un modèle distinct appelé discriminateur pour prédire si deux phrases sont des paraphrases l’une de l’autre (de la même manière qu’un humain évaluerait). L’objectif du modèle de RL est alors de convaincre ce modèle que la phrase générée est une paraphrase de la phrase d’entrée. Le discriminateur génère un score de la probabilité que les deux phrases soient des paraphrases l’une de l’autre, qui est utilisé comme récompense pour former l’agent.

Toutes les 5 000 suppositions, le discriminateur est informé de laquelle des paraphrases provient de l’ensemble de données et laquelle a été générée afin qu’il puisse améliorer ses futures suppositions. Le processus se poursuit pendant plusieurs rounds, l’agent essayant de tromper le discriminateur et le discriminateur essayant de faire la distinction entre les paraphrases générées et les paraphrases d’évaluation de l’ensemble de données.

Après plusieurs rounds de formation, l’agent génère des paraphrases qui surpassent les modèles supervisés et les autres fonctions de récompense.

Conclusion et limites

Les approches antagonistes (y compris l’auto-jeu pour les jeux) offrent une approche extrêmement prometteuse pour former des algorithmes de RL pour dépasser les performances humaines sur certaines tâches sans définir une fonction de récompense explicite.

Bien que le RL ait pu surpasser l’apprentissage supervisé dans ce cas, le surcoût en termes de code, de calcul et de complexité ne vaut pas la peine pour la plupart des applications. Le RL est mieux laissé à des situations où l’apprentissage supervisé ne peut pas être facilement appliqué et où une fonction de récompense est facile à définir (comme les jeux Atari). Les approches et les algorithmes sont beaucoup plus matures dans l’apprentissage supervisé et le signal d’erreur est beaucoup plus fort, ce qui entraîne une formation plus rapide et plus stable.

Une autre considération est que, comme pour les autres approches de neurones, l’agent peut échouer de manière dramatique dans les cas où l’entrée est différente des entrées qu’il a précédemment vues, nécessitant une couche supplémentaire de vérifications de sanity pour les applications de production.

L’explosion d’intérêt pour les approches de RL et les progrès de l’infrastructure de calcul au cours des dernières années ouvriront d’énormes opportunités pour appliquer le RL dans l’industrie, en particulier dans le NLP.