Intelligence artificielle

Agents Mobiles : Agent Autonome Multimodal de Dispositif Mobile avec Perception Visuelle

L’avènement des modèles de langage multimodaux à grande échelle (MLLM) a marqué le début d’une nouvelle ère d’agents de dispositifs mobiles, capables de comprendre et d’interagir avec le monde à travers le texte, les images et la voix. Ces agents marquent une avancée significative par rapport à l’IA traditionnelle, offrant une façon plus riche et plus intuitive pour les utilisateurs d’interagir avec leurs dispositifs. En exploitant les MLLM, ces agents peuvent traiter et synthétiser d’immenses quantités d’informations provenant de diverses modalités, leur permettant d’offrir une assistance personnalisée et d’améliorer l’expérience utilisateur de manière Previously unimaginable.

Ces agents sont alimentés par des techniques d’apprentissage automatique de pointe et des capacités de traitement du langage naturel avancées, leur permettant de comprendre et de générer du texte similaire à celui des humains, ainsi que d’interpréter les données visuelles et auditives avec une remarquable précision. De la reconnaissance d’objets et de scènes dans les images à la compréhension de commandes vocales et à l’analyse de sentiments de texte, ces agents multimodaux sont équipés pour gérer une large gamme d’entrées de manière transparente. Le potentiel de cette technologie est immense, offrant des services plus sophistiqués et plus conscients du contexte, tels que des assistants virtuels accordés aux émotions humaines et des outils éducatifs qui s’adaptent aux styles d’apprentissage individuels. Ils ont également le potentiel de révolutionner l’accessibilité, en rendant la technologie plus abordable à travers les barrières linguistiques et sensorielles.

Dans cet article, nous allons parler des Agents Mobiles, un agent autonome multimodal de dispositif mobile qui utilise d’abord la capacité d’outils de perception visuelle pour identifier et localiser les éléments visuels et textuels avec une interface frontale d’application mobile de manière précise. En utilisant ce contexte de vision perçu, le cadre d’Agent Mobile planifie et décompose la tâche d’opération complexe de manière autonome, et navigue à travers les applications mobiles à travers des opérations étape par étape. Le cadre d’Agent Mobile diffère des solutions existantes puisqu’il ne repose pas sur les métadonnées du système mobile ou les fichiers XML des applications mobiles, laissant place à une adaptabilité améliorée dans divers environnements d’exploitation mobile de manière centrée sur la vision.

Agents Mobiles : Agent Autonome Multimodal de Dispositif Mobile

Dans le monde rapide de la technologie mobile, un concept pionnier émerge comme un point de repère : les grands modèles de langage, en particulier les modèles de langage multimodaux à grande échelle ou MLLM capables de générer une large gamme de texte, d’images, de vidéos et de discours dans différentes langues. Le développement rapide des cadres MLLM au cours des dernières années a donné naissance à une nouvelle et puissante application des MLLM : les agents mobiles autonomes. Les agents mobiles autonomes sont des entités logicielles qui agissent, se déplacent et fonctionnent de manière indépendante, sans avoir besoin de commandes humaines directes, conçues pour traverser des réseaux ou des dispositifs pour accomplir des tâches, collecter des informations ou résoudre des problèmes.

Les agents mobiles sont conçus pour exploiter le dispositif mobile de l’utilisateur sur la base des instructions de l’utilisateur et des visuels de l’écran, une tâche qui nécessite que les agents possèdent à la fois une compréhension sémantique et des capacités de perception visuelle. Cependant, les agents mobiles existants sont loin d’être parfaits puisqu’ils sont basés sur des modèles de langage multimodaux à grande échelle, et même les cadres MLLM actuels, y compris GPT-4V, manquent de capacités de perception visuelle nécessaires pour servir d’agent mobile efficace. De plus, bien que les cadres existants puissent générer des opérations efficaces, ils ont du mal à localiser avec précision la position de ces opérations sur l’écran, limitant les applications et la capacité des agents mobiles à fonctionner sur les dispositifs mobiles.

Pour résoudre ce problème, certains cadres ont choisi d’exploiter les fichiers de mise en page de l’interface utilisateur pour aider le GPT-4V ou d’autres MLLM avec des capacités de localisation, certains cadres parvenant à extraire des positions actionnables sur l’écran en accédant aux fichiers XML de l’application, tandis que d’autres cadres ont opté pour utiliser le code HTML des applications Web. Comme on peut le voir, la plupart de ces cadres reposent sur l’accès aux fichiers d’application locaux et sous-jacents, ce qui rend la méthode presque inefficace si le cadre ne peut pas accéder à ces fichiers. Pour résoudre ce problème et éliminer la dépendance des agents locaux aux fichiers sous-jacents sur les méthodes de localisation, les développeurs ont travaillé sur l’Agent Mobile, un agent mobile autonome avec des capacités de perception visuelle impressionnantes. En utilisant son module de perception visuelle, le cadre d’Agent Mobile utilise des captures d’écran du dispositif mobile pour localiser les opérations avec précision.

De plus, le cadre d’Agent Mobile vise à exploiter les capacités contextuelles des cadres MLLM de pointe comme GPT-4V pour atteindre des capacités d’autoplanification qui permettent au modèle de planifier des tâches en fonction de l’historique des opérations, des instructions de l’utilisateur et des captures d’écran de manière holistique. Pour améliorer encore la capacité de l’agent à identifier les instructions incomplètes et les opérations incorrectes, le cadre d’Agent Mobile introduit une méthode d’auto-réflexion. Sous la direction de prompts soigneusement conçus, l’agent réfléchit sur les actions incorrectes et invalides de manière cohérente et arrête les opérations une fois la tâche ou l’instruction terminée.

Dans l’ensemble, les contributions du cadre d’Agent Mobile peuvent être résumées comme suit :

- L’Agent Mobile agit comme un agent autonome de dispositif mobile, en utilisant des outils de perception visuelle pour effectuer une localisation d’opération. Il planifie méthodiquement chaque étape et s’engage dans l’introspection. Notamment, l’Agent Mobile repose exclusivement sur des captures d’écran du dispositif, sans utiliser de code système, mettant en évidence une solution basée purement sur des techniques de vision.

- L’Agent Mobile introduit Mobile-Eval, une référence conçue pour évaluer les agents de dispositif mobile. Cette référence comprend une variété des dix applications mobiles les plus couramment utilisées, ainsi que des instructions intelligentes pour ces applications, classées en trois niveaux de difficulté.

Agent Mobile : Architecture et Méthodologie

Au cœur du cadre d’Agent Mobile se trouve un modèle de langage multimodal à grande échelle de pointe, le GPT-4V, un module de détection de texte utilisé pour les tâches de localisation de texte. Avec GPT-4V, l’Agent Mobile emploie également un module de détection d’icône pour la localisation d’icône.

Perception Visuelle

Comme mentionné précédemment, le MLLM GPT-4V donne des résultats satisfaisants pour les instructions et les captures d’écran, mais il échoue à sortir la localisation effective où les opérations ont lieu. En raison de cette limitation, le cadre d’Agent Mobile mettant en œuvre le modèle GPT-4V a besoin de s’appuyer sur des outils externes pour aider à la localisation d’opération, facilitant ainsi la sortie des opérations sur l’écran mobile.

Localisation de Texte

Le cadre d’Agent Mobile met en œuvre un outil OCR pour détecter la position du texte correspondant sur l’écran lorsque l’agent doit appuyer sur un texte spécifique affiché sur l’écran mobile. Il existe trois scénarios de localisation de texte uniques.

Scénario 1 : Aucun Texte Spécifié Détecté

Problème : L’OCR échoue à détecter le texte spécifié, ce qui peut se produire dans des images complexes ou en raison des limitations de l’OCR.

Réponse : Instructer l’agent pour soit :

- Réselectionner le texte pour appuyer, permettant une correction manuelle de l’oubli de l’OCR, ou

- Choisir une opération alternative, telle que l’utilisation d’une autre méthode d’entrée ou la réalisation d’une autre action pertinente pour la tâche en cours.

Raisonnement : Cette flexibilité est nécessaire pour gérer les erreurs occasionnelles ou les hallucinations du GPT-4V, garantissant que l’agent puisse toujours progresser de manière efficace.

Scénario 2 : Instance Unique de Texte Spécifié Détecté

Opération : Générer automatiquement une action pour cliquer sur les coordonnées centrales de la boîte de texte détectée.

Justification : Avec une seule instance détectée, la probabilité d’identification correcte est élevée, ce qui rend efficace de procéder à une action directe.

Scénario 3 : Multiples Instances de Texte Spécifié Détecté

Évaluation : Évaluer d’abord le nombre d’instances détectées :

Nombreuses Instances : Indique un écran encombré de contenu similaire, compliquant le processus de sélection.

Action : Demander à l’agent de réselectionner le texte, visant à raffiner la sélection ou à ajuster les paramètres de recherche.

Peu d’Instances : Un nombre gérable de détections permet une approche plus nuancée.

Action : Recadrer les régions autour de ces instances, en élargissant les boîtes de texte de détection vers l’extérieur pour capturer plus de contexte. Cette expansion garantit que plus d’informations sont préservées, aidant dans la prise de décision.

Étape suivante : Dessiner des boîtes de détection sur les images recadrées et les présenter à l’agent. Cette assistance visuelle aide l’agent à décider laquelle des instances interagir, en fonction d’indices contextuels ou d’exigences de tâche.

Cette approche structurée optimise l’interaction entre les résultats OCR et les opérations de l’agent, améliorant la fiabilité et l’adaptabilité du système dans la gestion de tâches basées sur le texte dans divers scénarios. L’ensemble du processus est démontré dans l’image suivante.

Localisation d’Icône

Le cadre d’Agent Mobile met en œuvre un outil de détection d’icône pour localiser la position d’une icône lorsque l’agent doit cliquer dessus sur l’écran mobile. Plus précisément, le cadre demande d’abord à l’agent de fournir des attributs spécifiques de l’image, y compris la forme et la couleur, puis le cadre met en œuvre la méthode Grounding DINO avec l’icône de prompt pour identifier toutes les icônes contenues dans la capture d’écran. Enfin, l’Agent Mobile utilise le cadre CLIP pour calculer la similarité entre la description de la région de clic et calcule la similarité entre les icônes supprimées, et sélectionne la région avec la similarité la plus élevée pour un clic.

Exécution d’Instruction

Pour traduire les actions en opérations sur l’écran par les agents, le cadre d’Agent Mobile définit 8 opérations différentes.

- Lancer l’Application (Nom de l’Application) : Initier l’application désignée à partir de l’interface de bureau.

- Appuyer sur le Texte (Étiquette de Texte) : Interagir avec la partie de l’écran affichant l’étiquette « Étiquette de Texte ».

- Interagir avec l’Icône (Description d’Icône, Emplacement) : Cibler et appuyer sur la zone d’icône spécifiée, où « Description d’Icône » détaille les attributs tels que la couleur et la forme de l’icône. Choisir « Emplacement » parmi les options telles que haut, bas, gauche, droite ou centre, éventuellement en combinant deux pour une navigation précise et pour réduire les erreurs.

- Saisir du Texte (Texte de Saisie) : Saisir le « Texte de Saisie » donné dans le champ de texte actif.

- Faire Defiler Vers le Haut et le Bas : Naviguer à travers le contenu de la page présente vers le haut ou vers le bas.

- Revenir en Arrière : Revenir à la page précédemment vue.

- Fermer : Revenir directement au bureau à partir de l’écran actuel.

- Arrêter : Conclure l’opération une fois la tâche accomplie.

Auto-Planification

Chaque étape de l’opération est exécutée de manière itérative par le cadre, et avant le début de chaque itération, l’utilisateur est invité à fournir une instruction de saisie, et le modèle d’Agent Mobile utilise l’instruction pour générer une invite de système pour l’ensemble du processus. De plus, avant le début de chaque itération, le cadre capture une capture d’écran et la fournit à l’agent. L’agent observe alors la capture d’écran, l’historique des opérations et les invites de système pour sortir l’étape suivante des opérations.

Auto-Réflexion

Pendant ses opérations, l’agent peut rencontrer des erreurs qui l’empêchent d’exécuter avec succès une commande. Pour améliorer le taux d’accomplissement des instructions, une approche d’auto-évaluation a été mise en œuvre, activée dans deux circonstances spécifiques. Initialement, si l’agent exécute une action défectueuse ou invalide qui bloque la progression, comme lorsqu’il reconnaît que la capture d’écran reste inchangée après l’opération ou affiche une page incorrecte, il sera invité à considérer des actions alternatives ou à ajuster les paramètres de l’opération existante. Deuxièmement, l’agent peut manquer certains éléments d’une directive complexe. Une fois que l’agent a exécuté une série d’actions en fonction de son plan initial, il sera invité à examiner la séquence d’actions, la dernière capture d’écran et la directive de l’utilisateur pour évaluer si la tâche a été terminée. Si des écarts sont trouvés, l’agent est chargé de générer de nouvelles actions pour remplir la directive de manière autonome.

Agent Mobile : Expériences et Résultats

Pour évaluer ses capacités de manière exhaustive, le cadre d’Agent Mobile introduit la référence Mobile-Eval, composée de 10 applications mobiles couramment utilisées, et conçoit trois instructions pour chaque application. La première opération est simple et ne couvre que les opérations de base de l’application, tandis que la deuxième opération est un peu plus complexe que la première, car elle comporte des exigences supplémentaires. Enfin, la troisième opération est la plus complexe de toutes, car elle contient des instructions abstraites de l’utilisateur, sans spécifier explicitement quelle application utiliser ou quelle opération effectuer.

Ensuite, pour évaluer les performances sous différents angles, le cadre d’Agent Mobile conçoit et met en œuvre 4 métriques différentes.

- Su ou Succès : Si l’agent mobile termine les instructions, il est considéré comme un succès.

- Score de Processus ou PS : La métrique de score de processus mesure la précision de chaque étape pendant l’exécution des instructions de l’utilisateur et est calculée en divisant le nombre d’étapes correctes par le nombre total d’étapes.

- Efficacité Relative ou ER : Le score d’efficacité relative est un rapport entre le nombre d’étapes qu’il faut à un humain pour effectuer l’instruction manuellement et le nombre d’étapes qu’il faut à l’agent pour exécuter la même instruction.

- Taux d’Achèvement ou TA : La métrique de taux d’achèvement divise le nombre d’étapes opérées par l’homme que le cadre termine avec succès par le nombre total d’étapes prises par un humain pour terminer l’instruction. La valeur de TA est 1 lorsque l’agent termine l’instruction avec succès.

Les résultats sont démontrés dans la figure suivante.

Initialement, pour les trois tâches données, l’Agent Mobile a atteint des taux d’achèvement de 91 %, 82 % et 82 %, respectivement. Même si toutes les tâches n’ont pas été exécutées de manière parfaite, les taux de réalisation pour chaque catégorie de tâche ont dépassé 90 %. De plus, la métrique PS révèle que l’Agent Mobile démontre constamment une forte probabilité d’exécuter des actions précises pour les trois tâches, avec des taux de réussite d’environ 80 %. En outre, selon la métrique ER, l’Agent Mobile montre une efficacité de 80 % dans l’exécution des opérations à un niveau comparable à l’optimalité humaine. Ces résultats soulignent collectivement la compétence de l’Agent Mobile en tant qu’assistant de dispositif mobile.

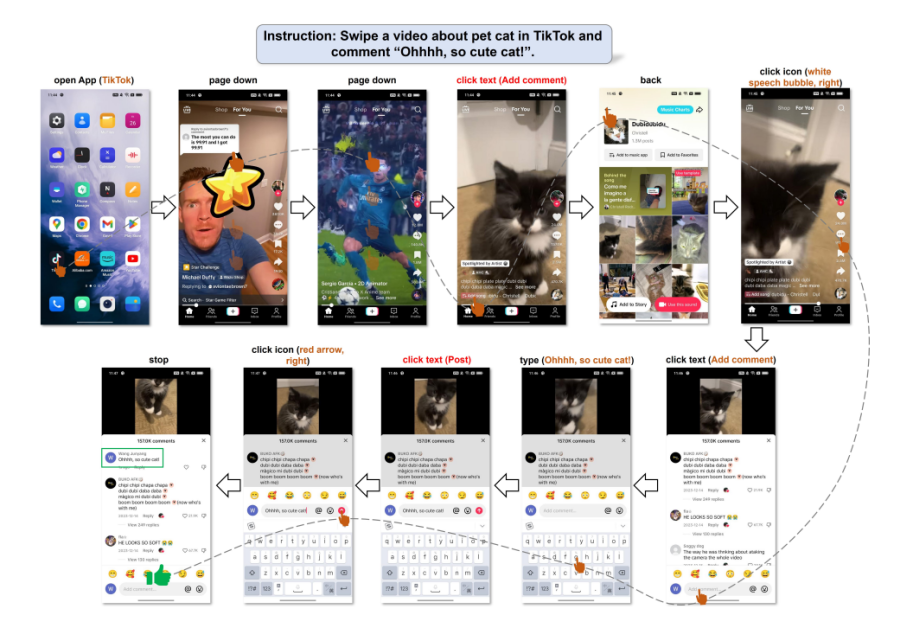

La figure suivante illustre la capacité de l’Agent Mobile à comprendre les commandes de l’utilisateur et à orchestrer ses actions de manière indépendante. Même en l’absence de détails d’opération explicites dans les instructions, l’Agent Mobile a interprété avec compétence les besoins de l’utilisateur, les transformant en tâches actionnables. Après cette compréhension, l’agent a exécuté les instructions via un processus de planification systématique.

Pensées Finales

Dans cet article, nous avons discuté de l’Agent Mobile, un agent autonome multimodal de dispositif mobile qui utilise d’abord les technologies de perception visuelle pour détecter et localiser avec précision les composants visuels et textuels dans l’interface d’une application mobile. Avec ce contexte de vision en tête, le cadre d’Agent Mobile planifie et décompose la tâche d’opération complexe de manière autonome, et navigue à travers les applications mobiles étape par étape. Ce cadre se distingue des méthodes existantes car il ne repose pas sur les métadonnées du système mobile ou les fichiers XML des applications mobiles, permettant ainsi une plus grande flexibilité dans divers environnements d’exploitation mobile de manière centrée sur la vision. La stratégie employée par le cadre d’Agent Mobile élimine le besoin d’adaptations spécifiques au système, conduisant à une efficacité améliorée et à des exigences de calcul réduites.