Angle d’Anderson

Les puzzles de jigsaurs améliorent la raison visuelle de l’IA

De nouvelles recherches indiquent que les modèles d’IA peuvent devenir plus intelligents en résolvant des puzzles de jigsaurs. Réorganiser des images, des vidéos et des scènes 3D mélangées les aide à affiner leurs compétences visuelles sans avoir besoin de données, d’étiquettes ou d’outils supplémentaires.

Dans la course actuelle pour faire progresser les modèles de langage multimodaux (MLLM) devant le peloton (ou au moins rester trois versions devant le rival le plus proche), il y a peu de victoires faciles et pas de repas gratuits.

Bien que de nombreuses sorties FOSS chinoises de 2025 soient rapportées comme ayant des coûts de développement et d’exécution inférieurs, les sorties occidentales ont tendance à jeter plus dans le problème : plus de volume de données, plus de puissance d’inférence, plus d’électricité (bien que, comme nous l’avons récemment noté, plus d’annotateurs humains réels, puisque cela coûte trop cher même pour la révolution de l’IA à l’échelle du trillion de dollars).

Dans la littérature de recherche, la plupart des approches d’évolution d’architectures d’IA prétendument “gratuites” n’offrent que des améliorations incrémentielles mineures ; ou des améliorations dans des domaines qui ne sont pas les plus critiquement poursuivis. Néanmoins, la recherche de “principes fondamentaux” jusque-là inconnus qui pourraient accélérer le rythme de développement est trop tentante pour être abandonnée.

Rassembler les pièces

Alors que ce n’est pas tout à fait dans cette catégorie, une nouvelle collaboration universitaire entre des institutions chinoises prétend avoir déterminé que faire des VLM résoudre des puzzles de jigsaurs améliore considérablement leurs performances, même si cette approche d’apprentissage par renforcement a précédemment performé plutôt mal dans ce domaine, et même si elle n’exige pas de systèmes, de modèles ou de processus supplémentaires :

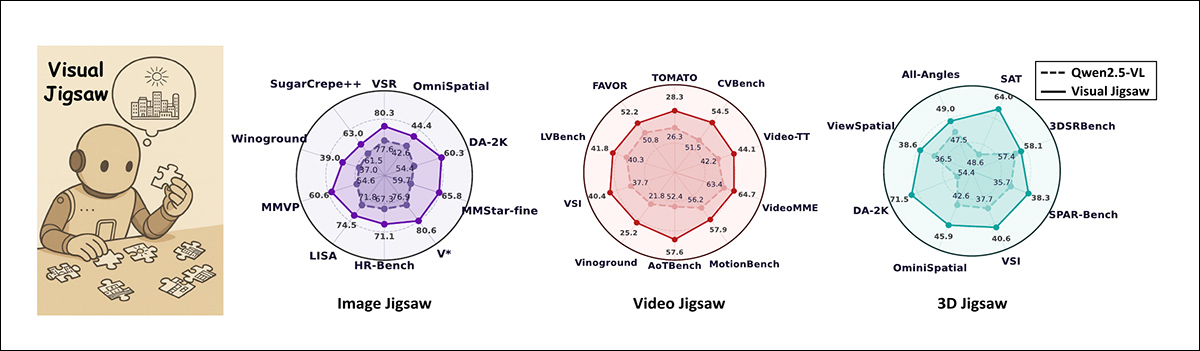

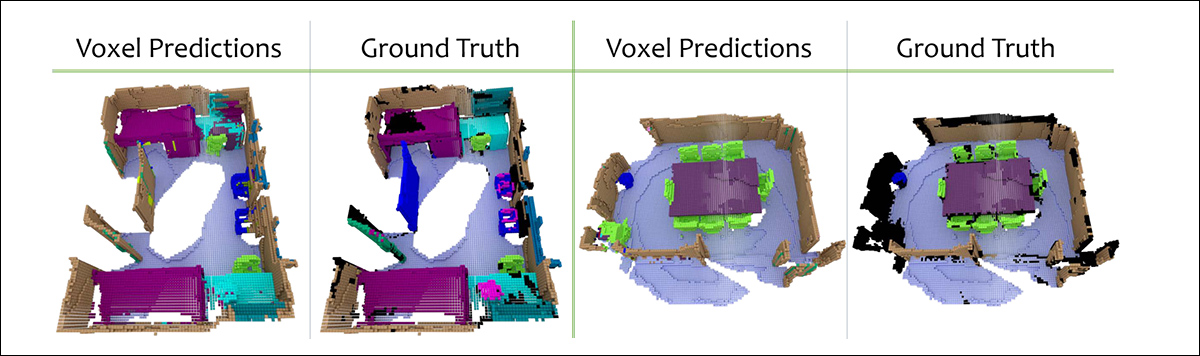

Visual Jigsaw est un cadre d’apprentissage autonome post-formation qui améliore les compétences visuelles des modèles de langage multimodaux. En s’entraînant sur des tâches de jigsaurs à travers des images, des vidéos et des données 3D, les modèles acquièrent une perception plus fine, spatiale et compositionnelle dans les images, une compréhension temporelle plus forte dans les vidéos et une compréhension géométrique améliorée dans les scènes 3D. Les graphiques radar de l’image ci-dessus montrent des gains constants par rapport à la base Qwen2.5-VL, avec des échelles de valeur ajustées pour chaque référence pour plus de clarté. Source : https://arxiv.org/pdf/2509.25190

Le système conçu par les chercheurs s’intitule Visual Jigsaw, et consiste à entraîner des MLLM existants sur du matériel qui a été fragmenté et dispersé de manière aléatoire, comme un puzzle. Les auteurs ont développé trois modalités pour cette approche : image, vidéo et 3D (c’est-à-dire des maillages de style CGI), et ont constaté qu’une adaptation modérée du même processus bénéficiait aux trois domaines :

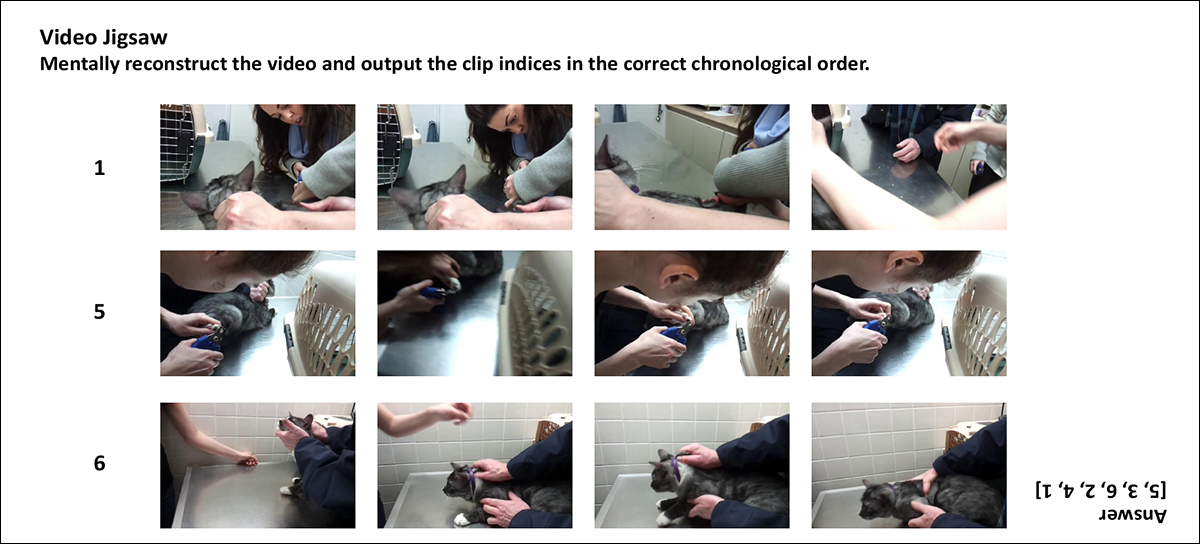

Représentation des trois tâches de Visual Jigsaw. Dans le puzzle d’image, une image est divisée en patches, mélangée, et le modèle prédit la disposition correcte ; dans le puzzle de vidéo, des clips sont mélangés et le modèle restaure leur ordre chronologique ; dans le puzzle 3D, des points avec différentes profondeurs sont mélangés et le modèle les classe de plus proche à plus éloigné. Les sorties du modèle sont notées par rapport à la vérité terrain, avec un crédit partiel accordé pour des solutions partiellement correctes.

La méthode d’entraînement de Visual Jigsaw aide les modèles d’IA à améliorer leur compréhension de l’information visuelle en les faisant réassembler ces images, clips vidéo ou données 3D mélangées.

Le processus est basé sur des mots et non sur des images, et donc il n’y a pas besoin pour le modèle de générer des images ou d’utiliser des composants visuels supplémentaires. Cette méthode s’inscrit dans un système appelé Apprentissage par renforcement à partir de récompenses vérifiables (RLVR), où le modèle reçoit une récompense pour des réponses correctes basées sur des règles claires et automatiques ; et où, par conséquent, aucune étiquetage humain n’est requis.

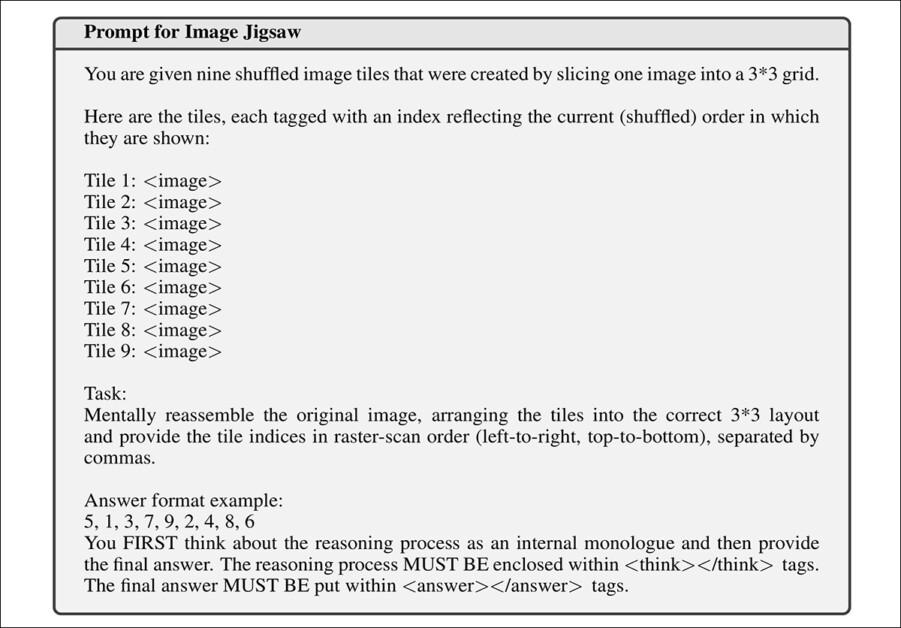

Ce fait crucial est en réalité difficile à déduire du nouveau document : que le système assemble le puzzle sémantiquement, à travers des descriptions, et non de la manière représentative de forme que les humains apprennent à résoudre de tels puzzles :

À partir du matériel supplémentaire du nouveau document, un exemple de tâche RL illustrant la nature basée sur le texte de ce processus d’apprentissage supplémentaire. Les images qui auraient été présentées au MLLM ne sont pas représentées ici.

Bien que les MLLM traitent largement de tâches centrées sur la vision, ils sont basés sur le langage architectures, et non conçus pour générer des images, des vidéos ou des représentations de forme telles que des maillages 3D.

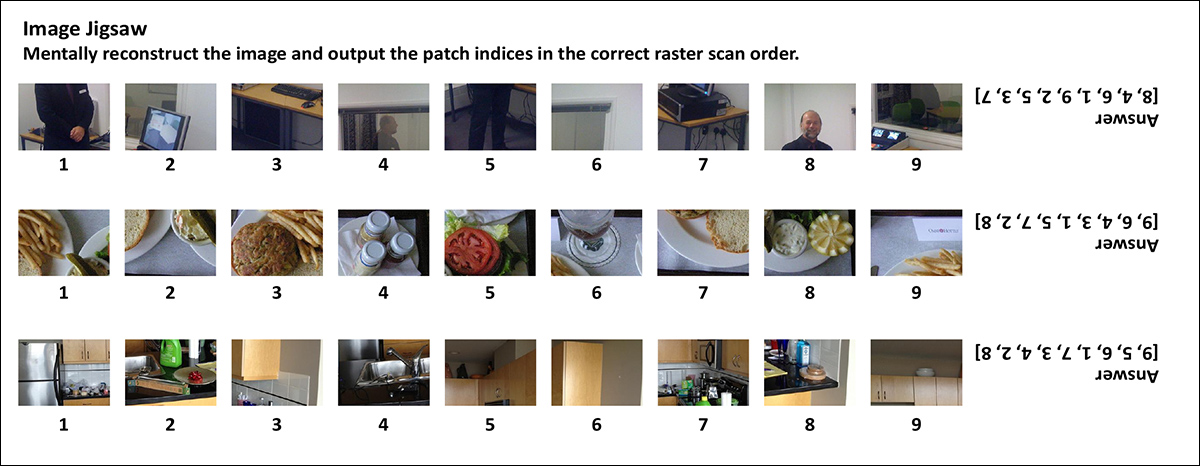

Exemples de la tâche de puzzle d’image. Chaque ligne montre des patches mélangés que le modèle doit réorganiser dans leur disposition d’origine, avec la disposition correcte affichée à droite.

Dans tous les cas, ce type d’entraînement est effectué après la phase d’apprentissage principale, lorsque le modèle a déjà une certaine capacité à comprendre les images.

Des approches antérieures telles que le document suisse de 2017 Apprentissage non supervisé de représentations visuelles en résolvant des puzzles de jigsaurs ont utilisé cette approche de renforcement avec un succès plutôt limité, sur des réseaux de neurones convolutionnels (CNN), une architecture notablement différente par rapport à un MLLM moderne.

À partir de la version 2017 ‘Apprentissage non supervisé de représentations visuelles en résolvant des puzzles de jigsaurs ‘, un exemple précoce de l’utilisation de la fragmentation comme défi basé sur une récompense pour un système neuronal. Source : https://arxiv.org/pdf/1603.09246

Aux tests, Visual Jigsaw a conduit à ce que les auteurs prétendent être des améliorations constantes et mesurables sur une large gamme de références : la tâche de puzzle d’image a amélioré la perception fine, la compréhension de la disposition spatiale et la raisonnement compositionnel ; la tâche de puzzle de vidéo a amélioré la capacité du modèle à suivre des séquences temporelles et à raisonner sur l’ordre des événements ; et la tâche de puzzle 3D a renforcé la compréhension basée sur la profondeur et la raisonnement spatial en utilisant uniquement des entrées RGB-D.

Sur les trois modalités, le document répète que la nouvelle méthode a surpassé plusieurs références compétitives, sans nécessiter de modifications architecturales, de modules visuels supplémentaires ou de données supervisées supplémentaires :

‘Des expériences approfondies démontrent des améliorations substantielles dans la perception fine, la raisonnement temporel et la compréhension spatiale 3D. Nos résultats mettent en évidence le potentiel des tâches visuelles autonome dans la formation post-MLLM et visent à inspirer d’autres recherches sur les conceptions de prétexte centrées sur la vision.’

Le nouveau document s’intitule Visual Jigsaw améliore les MLLM, et provient de six chercheurs de l’Université technologique de Nanyang, de l’Université de Linköping et de SenseTime Research. Le document est accompagné d’un site de projet avec des démos en direct (et vous pouvez même charger votre propre image dans la démo de puzzle d’image). Le code et les poids du projet ont été rendus généralement disponibles,

Méthode

Bien que nous allons examiner la façon dont les informations sont divisées pour accommoder les trois modalités testées, nous devons d’abord considérer la conception de la récompense pour le nouveau système.

L’approche Visual Jigsaw note les réponses du modèle à l’aide d’une récompense graduée, et non d’un simple passe ou échec. Si le modèle prédit l’ordre exact des pièces du puzzle, il reçoit une récompense complète ; si la réponse est en grande partie correcte, mais pas parfaite, le modèle reçoit un crédit partiel, échelonné par un facteur de décompte pour éviter de surestimer les erreurs proches (ce qui empêche le modèle de tricher en répétant des suppositions qui ne sont que partiellement correctes).

Les réponses invalides, telles que la ‘tricherie’ consistant à utiliser le même nombre à plusieurs reprises, reçoivent une note de zéro. Pour encourager une mise en page cohérente, le modèle doit placer son raisonnement à l’intérieur de <think> et sa réponse finale à l’intérieur de <answer> ; il reçoit une petite prime si ce format est utilisé correctement.

Images

Pour créer un puzzle pour la modalité d’image, une image est d’abord divisée en une grille de patches en la découpant en blocs de taille égale :

Exemples de patches d’image pour que le système les résolve.

Les patches sont disposés dans un ordre fixe de haut en bas, comme dans l’ordre de lecture d’une page, avant d’être mélangés avec un mélange aléatoire. Le modèle est ensuite exposé à cet ensemble de patches mélangés et doit déterminer l’ordre d’origine en prédiant la permutation correcte qui restaure la disposition d’origine.

Lors de la formation, 118 000 images de l’ensemble de données COCO ont été utilisées, chaque image produisant neuf patches (c’est-à-dire ‘pièces de puzzle’). La invite donnée au système est présentée plus tôt dans cet article (l’image ci-dessus avec la légende commençant par ‘À partir du matériel supplémentaire du nouveau document’).

Vidéo

Pour la tâche de puzzle de vidéo, une vidéo est découpée en une séquence de clips en la découpant uniformément dans le temps, puis en mélangant les segments de clip. Le modèle est ensuite montré cette séquence mélangée et doit déterminer leur ordre chronologique correct d’origine.

Exemples tronqués du défi de puzzle de vidéo, à partir du matériel supplémentaire du document.

La formation pour cette modalité a utilisé 100 000 vidéos de l’ensemble de données LLaVA-Video, chaque vidéo étant divisée en six clips. Pour empêcher le modèle d’exploiter des indices de correspondance de trame évidents aux frontières de clip, 5 % des trames au début et à la fin de chaque clip ont été supprimées.

Les clips ne contenaient pas plus de 12 trames, chacune avec une résolution maximale de 128x28x28 pixels. Les vidéos plus courtes que 24 secondes ont été exclues.

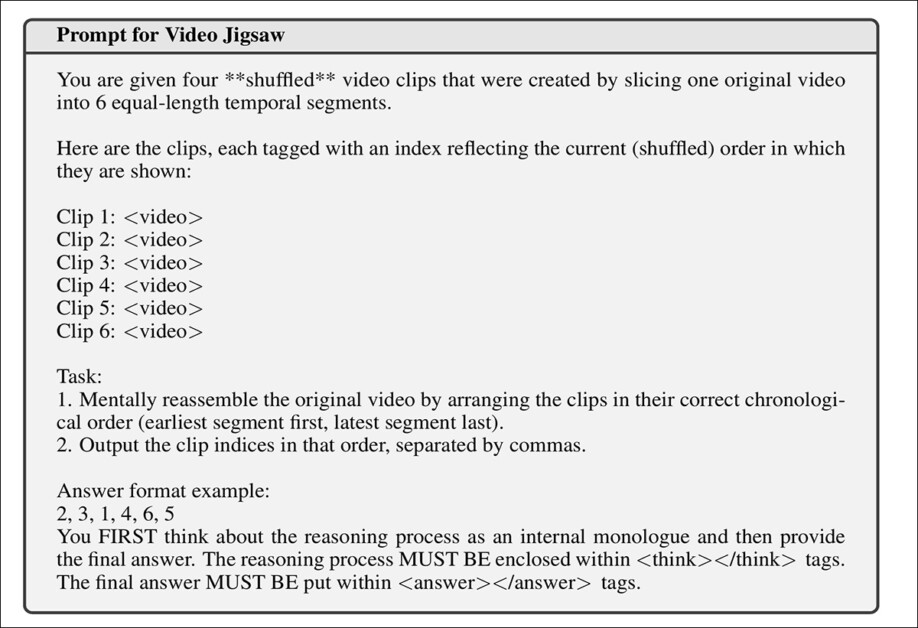

L’invite pour cette tâche est présentée ci-dessous :

L’invite d’apprentissage par renforcement présentée aux MLLM pour la tâche de vidéo, sans les clips qui auraient été présentés au MLLM..

Données 3D

Une tâche de puzzle 3D complète impliquerait généralement de casser un espace 3D (tel que des blocs de voxel ou des fragments de nuage de points) en morceaux plus petits et d’entraîner un modèle pour reconstruire leur disposition spatiale d’origine.

Cependant, le MLLM moyen n’est pas équipé pour gérer des données 3D brutes directement, mais repose plutôt sur des entrées d’image ou de vidéo interprétées sémantiquement. Par conséquent, pour créer une tâche qui exploite toujours la raisonnement 3D tout en restant compatible avec les MLLM actuels, les auteurs ont introduit une variante plus abordable en utilisant les images RGB-D mentionnées précédemment (c’est-à-dire des images 2D qui incluent des informations de profondeur pour chaque pixel).

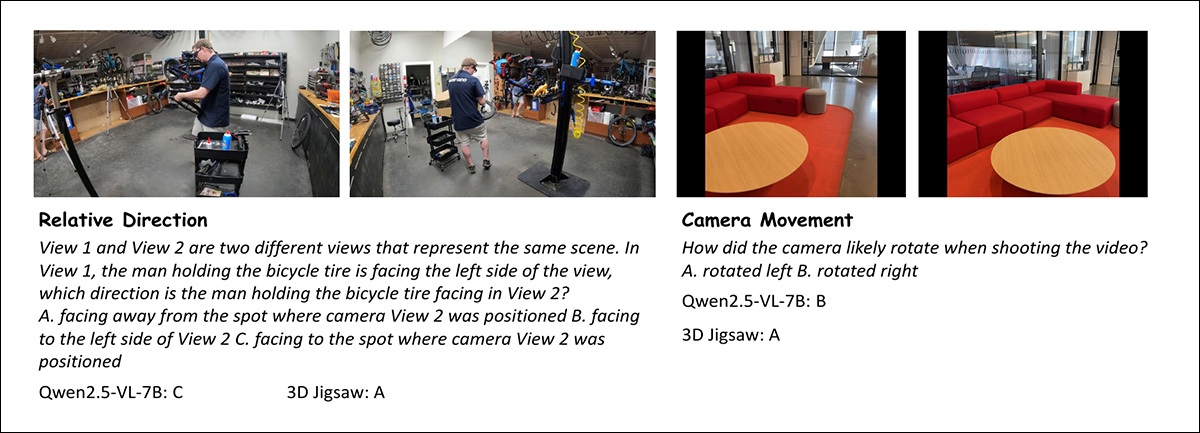

Exemples de questions du référentiel de compréhension spatiale 3D utilisé pour évaluer les performances sur la raisonnement de point de vue relatif et de mouvement de caméra. Le modèle 3D Jigsaw déduit correctement à la fois la relation spatiale entre deux vues d’une scène et la direction probable de rotation de la caméra, surpassant la référence Qwen2.5-VL-7B.

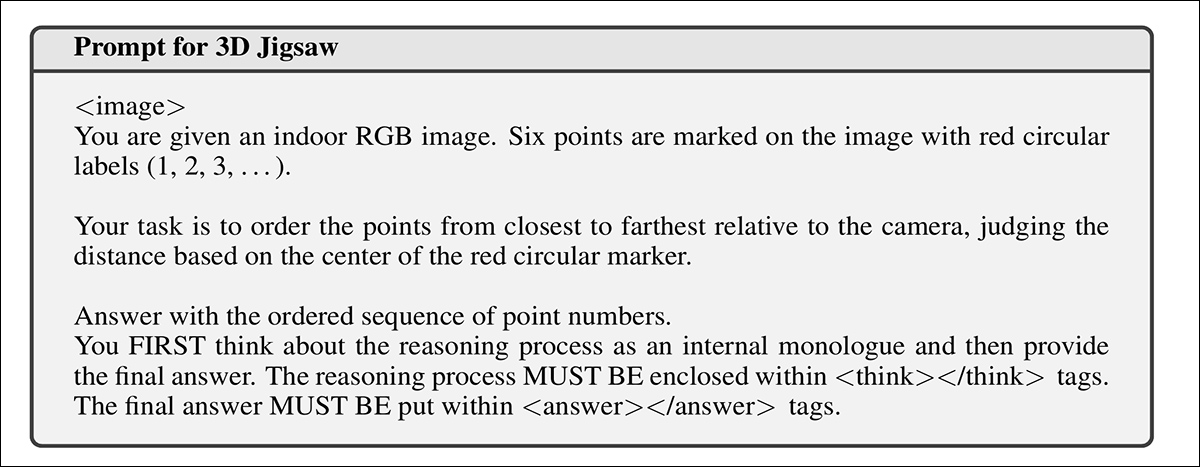

À partir de chaque image RGB-D, le modèle reçoit une liste mélangée de points qui avaient à l’origine des profondeurs distinctes, allant du plus proche au plus éloigné, l’objectif étant de récupérer leur ordre de profondeur correct en utilisant uniquement l’image 2D comme référence :

L’invite RL pour le puzzle 3D.

Chaque point est marqué sur l’image (qui est présentée au modèle, mais non visualisée dans l’exemple d’invite ci-dessus), et le modèle doit prédire lequel était le plus proche, le deuxième plus proche, etc., reconstruisant essentiellement la séquence de profondeur d’origine sans accéder aux valeurs de profondeur brutes.

La tâche de puzzle 3D est formée sur des images RGB-D de l’ensemble de données ScanNet, en utilisant 300 000 échantillons créés en sélectionnant des ensembles aléatoires de six points de profondeur par image.

Exemples de nuages de points de l’ensemble de données ScanNet utilisés dans le puzzle 3D. Source : https://arxiv.org/pdf/1702.04405

Chaque point devait se situer dans une plage de profondeur de 0,1 à 10 mètres, et pour promouvoir la diversité, aucun deux points dans un ensemble n’était autorisé à être plus proche que 40 pixels dans le plan d’image, ou moins de 0,2 mètre de distance dans la profondeur.

Tests

Pour les tests initiaux, le système a utilisé Qwen2.5-VL-7B-Instruct comme modèle multimodal de base. La formation a utilisé l’algorithme d’optimisation de politique de groupe (GRPO), avec à la fois la régularisation KL et la perte d’entropie supprimées.

Pour les prédictions partielles, un facteur de décompte de 0,2 a été appliqué. La formation du puzzle d’image a utilisé une taille de lot globale de 256, tandis que les puzzles de vidéo et 3D ont utilisé 128. Le taux d’apprentissage a été fixé à 1×10⁻⁶.

Pour chaque invite, le modèle a généré 16 réponses à une température de décodage de 1,0. Les tâches de puzzle d’image et de vidéo ont été formées pendant 1 000 étapes, tandis que la tâche de puzzle 3D a été formée pendant 800 étapes.

Puzzle d’image

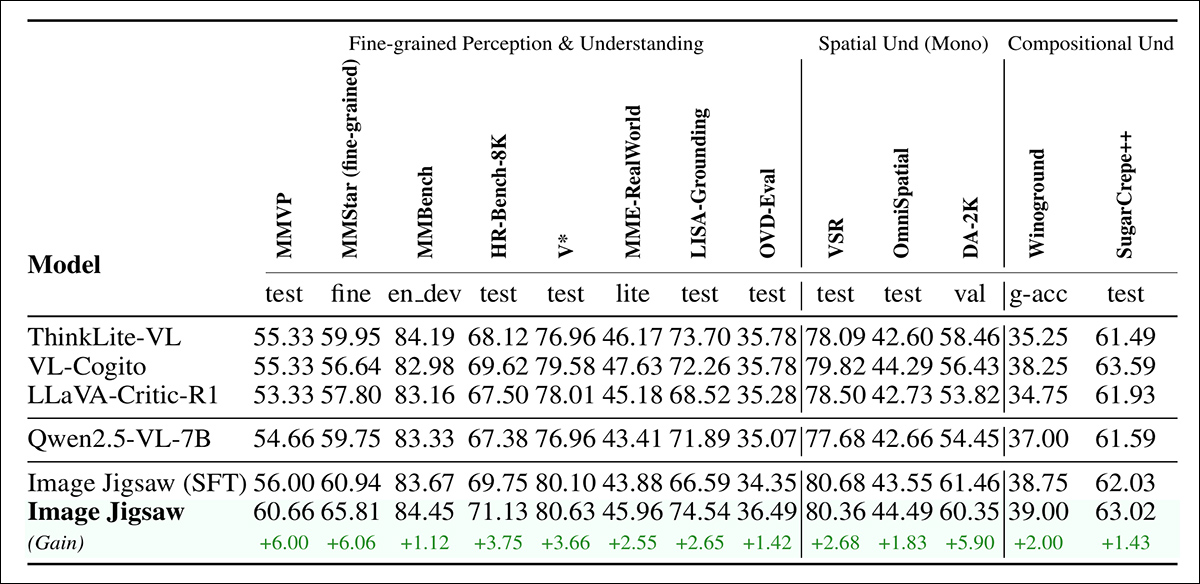

Le modèle de puzzle d’image a été testé sur trois catégories de références centrées sur la vision : pour la perception et la compréhension fine, MMVP, le sous-ensemble de perception fine de MMStar ; MMBench ; HR-Bench ; V* ; MME-RealWorld (lite) ; LISA-Grounding ; et OVD-Eval.

Pour la compréhension spatiale monocular, les références étaient VSR ; OmniSpatial ; et Depth Anything V2 (DA-2K). Pour la compréhension visuelle compositionnelle, les tests ont employé Winoground et SugerCrepe++.

Trois références ont été testées, toutes dérivées de Qwen2.5-VL-7B : ThinkLite-VL pour le raisonnement multimodal ; VL-Cogito pour les tâches visuelles et scientifiques générales ; et LLaVA-Critic-R1 pour la perception d’image.

Tous ont été évalués en utilisant uniquement des réponses courtes, puisque le raisonnement de chaîne de pensée (CoT) a parfois réduit les performances.

Résultats d’évaluation sur les références d’image. Le puzzle d’image a amélioré le modèle de base Qwen2.5-VL-7B sur toutes les catégories de tâches (c’est-à-dire la perception et la compréhension fine ; la compréhension spatiale monocular ; et le raisonnement visuel compositionnel), surpassant les références post-formées antérieures.

Des résultats du puzzle d’image, présentés ci-dessus, les auteurs déclarent :

‘[L’image ci-dessus] montre que notre méthode améliore constamment les capacités centrées sur la vision sur les trois types de références. Ces résultats confirment que l’intégration de la formation post-puzzle d’image améliore considérablement les fondements perceptuels et la compréhension visuelle fine des MLLM au-delà des stratégies de formation post-raisonnement centrées.’

‘Nous attribuons ces améliorations au fait que résoudre le puzzle d’image nécessite que le modèle prête attention aux détails locaux des patches, infère les dispositions spatiales globales et raisonne sur les relations inter-patches, ce qui profite directement à la perception fine, spatiale et compositionnelle.’

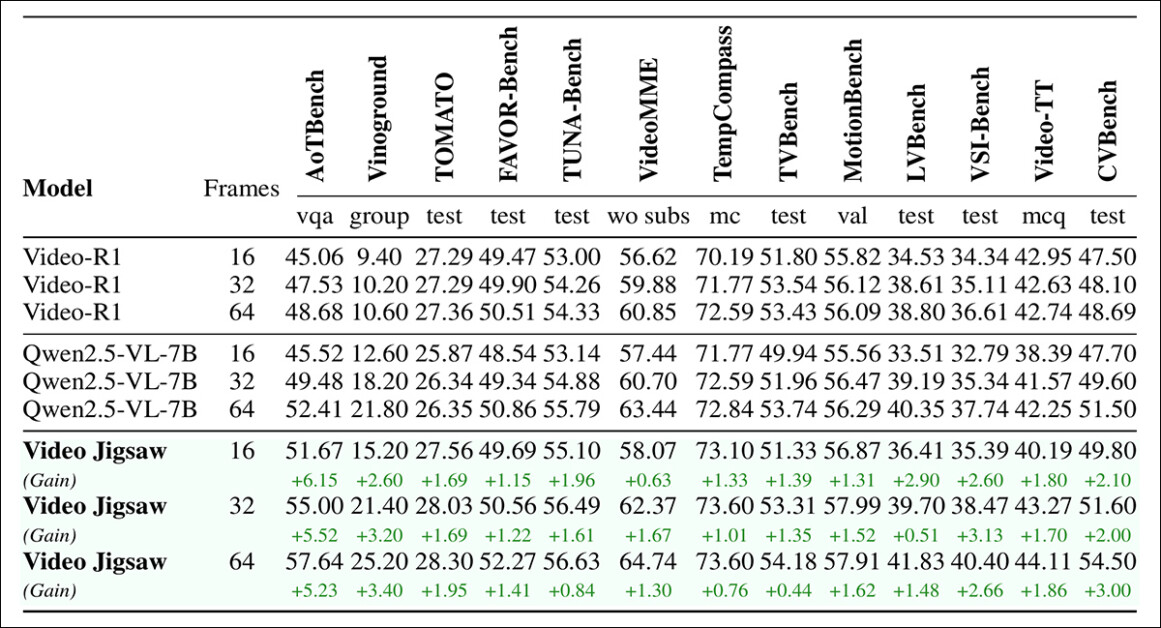

Puzzle de vidéo

Pour le puzzle de vidéo, l’évaluation a été menée sur AoTBench ; Vinoground ; TOMATO ; FAVOR-Bench ; TUNA-Bench ; Video-MME ; TempCompass ; TVBench ; MotionBench ; LVBench ; VSI-Bench ; Video-TT ; et CVBench.

Video-R1 a été utilisé comme référence, ayant été formé avec un ajustement fin supervisé à froid suivi d’un apprentissage par renforcement pour la compréhension et le raisonnement de vidéo. Dans ce cas, les évaluations ont inclus le processus de raisonnement complet, puisque cela a constamment produit de meilleurs résultats que les réponses directes.

Tous les modèles ont été limités à 256x28x28 pixels et testés sur trois paramètres de trame – 16, 32 et 64 :

Résultats d’évaluation sur les références de vidéo, avec le puzzle de vidéo surpassant constamment la référence sur toutes les tâches et les paramètres de trame.

Le puzzle de vidéo a produit des améliorations constantes sur toutes les références de compréhension de vidéo et les paramètres de trame, avec des gains particulièrement importants sur les tâches nécessitant un raisonnement temporel et une directionnalité, telles que celles de AoTBench, et également sur les références de raisonnement inter-vidéo, telles que CVBench :

‘Ces résultats confirment que résoudre les tâches de puzzle de vidéo encourage le modèle à mieux capturer la continuité temporelle, à comprendre les relations entre les vidéos, à raisonner sur la cohérence directionnelle et à généraliser les scénarios de compréhension de vidéo holistiques et généralisables.’

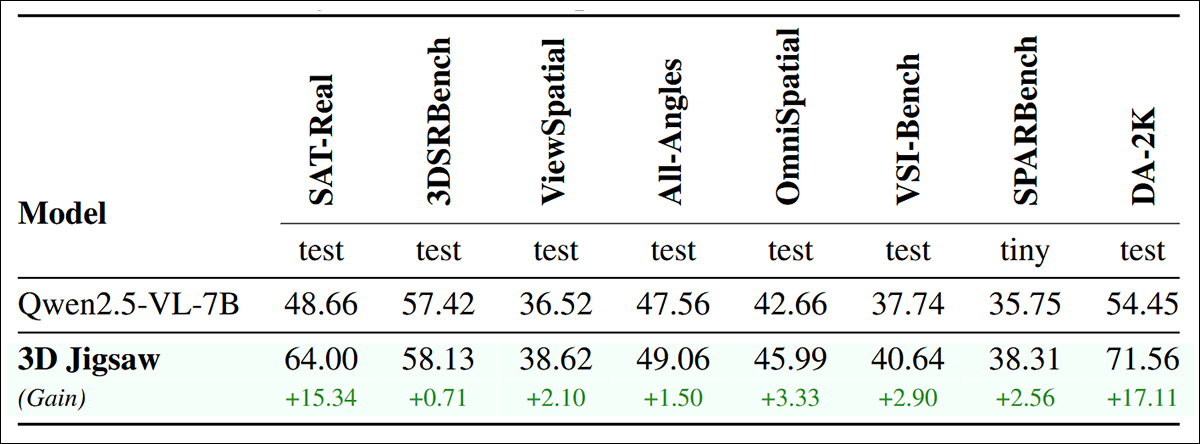

Données 3D

Pour la modalité 3D, le modèle a été évalué sur SAT-Real ; 3DSRBench ; ViewSpatial ; All-Angles ; la référence OmniSpatial mentionnée précédemment ; VSI-Bench ; SPARBench (tiny) ; et la référence DA-2K mentionnée précédemment.

Résultats d’évaluation sur les références 3D : le puzzle 3D améliore les performances sur les tâches de comparaison de profondeur telles que DA-2K, ainsi que sur les références de perception 3D plus larges couvrant les entrées de vue unique, multi-vue et vidéo égocentrique.

Ici, les auteurs déclarent :

‘[Le puzzle 3D] réalise des améliorations significatives sur toutes les références. Sans surprise, le plus grand gain est sur DA-2K, une référence d’estimation de profondeur directement liée à notre tâche de formation d’ordre de profondeur. Plus important encore, nous observons des améliorations constantes sur une large gamme d’autres tâches, y compris celles avec des entrées de vue unique (par exemple 3DSRBench, [OmniSpatial]), multi-vue (par exemple ViewSpatial, All-Angles), et vidéo égocentrique (par exemple VSI-Bench). ‘

‘Ces résultats démontrent que notre approche n’enseigne pas seulement la compétence spécifique de l’ordre de profondeur, mais renforce également la capacité générale du modèle à percevoir et à raisonner sur la structure spatiale 3D.’

Conclusion

Ce qui n’est pas entièrement clair dans ce document est la relation exacte entre les images et les descriptions qui alimentent cette amélioration des performances des MLLM.

À première vue, le processus d’apprentissage par résolution de puzzles semble très analogue à nos propres premières tentatives et développement. Cependant, notre propre interprétation spatiale du monde ressent instinctivement moins de lien sémantique et linguistique, et un examen plus approfondi du document révèle l’étendue à laquelle le langage sert de pont intéressant entre les réalités visuelles et sémantiques pour les MLLM.

* Veuillez noter que les auteurs du document préfèrent le terme moins courant ‘Modèles de langage multimodaux’, abrégé en ‘MLLM’. Il s’agit d’un terme émergent ou rarement utilisé, et s’applique aux modèles qui peuvent extensivement raisonner et analyser des images de manière spatiale, mais qui ne génèrent pas d’images. À mesure que de nouveaux paradigmes et modèles émergent, ce lexique est en constante révision.

Publié pour la première fois le jeudi 2 octobre 2025