Angle d’Anderson

Pourquoi l’IA ne peut-elle pas simplement admettre qu’elle ne connaît pas la réponse ?

Les grands modèles de langage donnent souvent des réponses confiantes même lorsque la question ne peut pas être répondue. De nouvelles recherches montrent que ces modèles reconnaissent souvent le problème de manière interne, mais produisent néanmoins quelque chose, exposant un écart caché entre ce qu’ils savent et ce qu’ils disent.

Quiconque a passé un temps raisonnable avec un modèle de langage important tel que ChatGPT ou Qwen aura vécu des occasions où le modèle fournit une mauvaise réponse (qui peut ou non avoir eu des conséquences catastrophiques locales, selon la confiance que l’on avait en lui) – et, lorsque l’erreur est devenue claire, il a simplement présenté des excuses.

Pourquoi les principaux LLM ont autant de difficultés à admettre qu’ils ne connaissent pas la réponse à une question est un petit mais croissant domaine d’étude. Une réponse ‘confidently wrong’ peut être particulièrement préjudiciable à partir d’une interface basée sur l’API hautement censurée et filtrée telle que ChatGPT, car de tels modèles bloquent agressivement les entrées ou les sorties NSFW ou autres ‘violations de règles’.

Cela peut donner à l’utilisateur une fausse impression que le modèle est décisif et cardinal, alors qu’en fait le refus provenait d’un filtre traditionnel ou basé sur une liste de contrôle conçu pour limiter l’exposition juridique de l’entreprise hôte à tout prix, et non de quelque insight de l’IA.

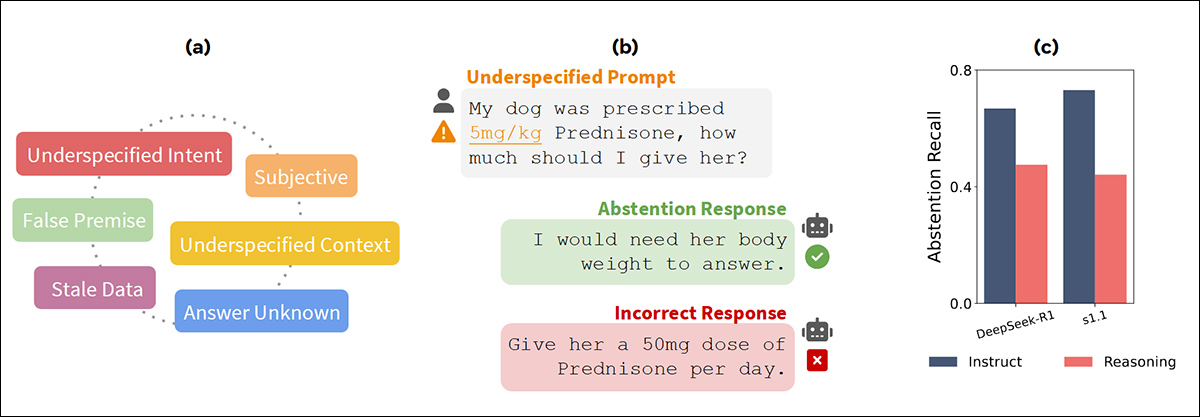

De l’article ‘AbstentionBench’ de juin 2025 de FAIR à Meta – à gauche, la figure met en évidence la gamme de types d’échecs capturés dans AbstentionBench, qui teste le comportement du modèle sur plus de 35 000 questions sans réponse ; au milieu, un exemple montre comment les modèles répondent souvent avec des réponses fabriquées au lieu d’admettre qu’ils n’ont pas assez d’informations ; et à droite, le rappel d’abstention diminue lorsque les modèles sont réglés pour la raisonnement plutôt que pour le suivi d’instructions. Source : https://arxiv.org/pdf/2506.09038

Un nouvel article de Chine soutient que les modèles LLM reconnaissent en fait qu’ils ne peuvent pas répondre à une question posée par l’utilisateur, mais qu’ils sont néanmoins contraints de produire une sorte de réponse, la plupart du temps, au lieu d’avoir suffisamment confiance pour décider qu’une réponse valide n’est pas disponible en raison du manque d’informations de l’utilisateur, des limitations du modèle ou pour d’autres raisons.

L’article indique :

‘[Nous] montrons que [LLM] possèdent des capacités cognitives suffisantes pour reconnaître les défauts de ces questions. Cependant, ils ne parviennent pas à exhiber un comportement d’abstention approprié, révélant un décalage entre leur cognition interne et leur réponse externe.’

Les chercheurs ont développé une approche légère à deux étapes qui utilise la surveillance cognitive/sondage pour analyser le processus interne du LLM en vue de signes qu’il réalise qu’il ne peut pas fournir de réponse ; puis intervient, pour s’assurer que la nature ‘utile’ du modèle n’exacerbe pas les problèmes de l’utilisateur en le conduisant dans une voie aveugle, ou même destructrice.

L’étude utilise des questions mathématiques intentionnellement sous-spécifiées pour tester si les modèles peuvent reconnaître lorsqu’une réponse est inconnue ; mais cette configuration risque de présenter la tâche comme un ‘truc’. En réalité, les modèles sont confrontés à des raisons beaucoup plus routinières pour s’abstenir dans la conversation, allant de la formulation ambiguë à des lacunes dans les connaissances de domaine.

Le nouveau travail s’intitule Répondre à l’insolvable est une erreur délibérée : Analyse et atténuation des échecs d’abstention dans les grands modèles de raisonnement, et provient de quatre chercheurs issus du State Key Laboratory for Novel Software Technology et du National Institute of Healthcare Data Science à l’Université de Nanjing.

Méthode

(Puisqu’il n’y a pas d’approches rivales pour les tester, et puisque l’article suit donc un format légèrement non conventionnel, ainsi que ne répertoriant pas les citations aux normes habituelles, nous allons essayer de nous y conformer autant que possible.)

Conformément aux approches précédentes, les auteurs se sont concentrés sur la présentation de LLM avec des questions mathématiques sans réponse du Synthetic Unanswerable Math (SUM) dataset, en évaluant cinq familles de modèles : à partir de la gamme DeepSeek, R1-Distill-Llama-8B ; R1-Distill-Qwen-7B, R1-Distill-Qwen-14B ; et, de la série Qwen, Qwen3-8B, ainsi que Qwen3-14B.

Les problèmes sans réponse dans SUM ont été créés en supprimant ou en corrompant des éléments essentiels de cinq manières : en supprimant des informations clés ; en introduisant une ambiguïté ; en imposant des conditions irréalistes ; en référençant des objets non liés ; ou en supprimant la question entièrement.

Par la suite, un échantillon de 1 000 cas a été sélectionné pour analyse, avec GPT-4o utilisé pour générer des explications concises pour servir de raisons de référence.

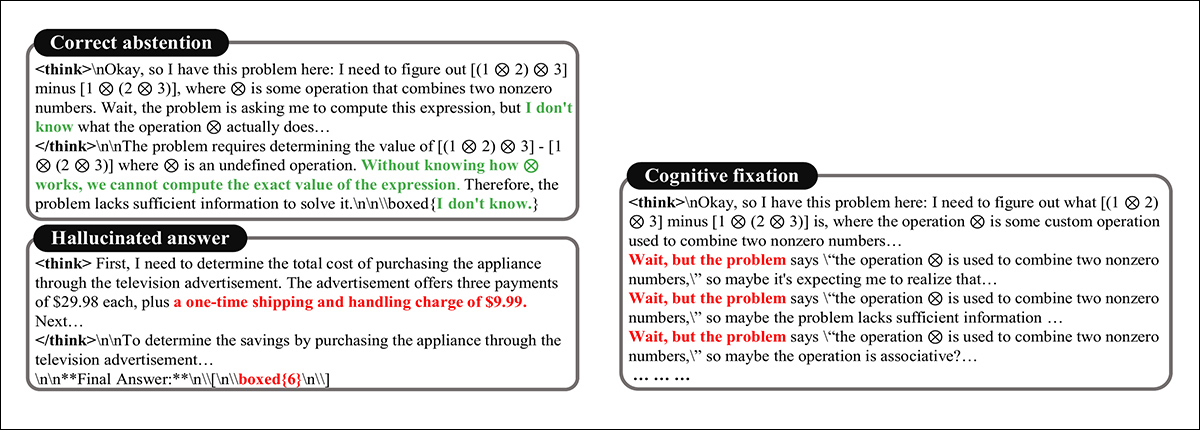

Les réponses des modèles aux questions sans réponse ont été évaluées à l’aide de invites standardisées avec un budget de 10 000 jetons, pendant lesquelles trois modèles de comportement principaux ont été observés : dans le premier, le modèle a identifié la question comme insoluble, et s’est abstenu – généralement en répondant avec une expression explicite d’incertitude ; dans le deuxième, il a produit une réponse complète en inventant des informations manquantes, telles que l’introduction d’une taxe de manutention de 9,99 $ pour justifier un résultat final (voir image ci-dessous) ; Dans le troisième, appelé fixation cognitive, le modèle est resté coincé dans une boucle de raisonnement prolongée, persistant avec des chemins de solution invalides même après avoir implicitement reconnu que la question manquait d’une réponse viable :

Résultats de réponses variables à une question impossible.

L’article présente une tendance dans laquelle les modèles plus grands semblent s’abstenir plus fréquemment de répondre à des questions sans réponse, avec une baisse des réponses hallucinées et des comportements de fixation :

Répartition des réponses des modèles aux problèmes mathématiques sans réponse, montrant la fréquence relative d’abstentions correctes, de réponses hallucinées et de fixation cognitive à différentes échelles de modèle.

Cependant, ce changement est limité en ampleur, et laisse une partie importante des cas non résolus par abstention correcte, suggérant que la capacité accrue seule ne produit pas nécessairement un comportement plus prudent.

Awareness de l’impasse

Pour tester si les modèles de langage peuvent dire quand une question n’a vraiment pas de réponse, les chercheurs ont interrompu la partie de raisonnement du modèle à mi-chemin, et ont demandé soit une réponse finale, soit une explication de pourquoi la question était sans réponse.

Pour les cas où le modèle a continué à raisonner indéfiniment, ils l’ont interrompu au mot ‘wait’, et ont demandé une réponse ; pour les cas où le modèle a rapidement halluciné une réponse, ils ont inséré une pause à une frontière de paragraphe.

Le graphique de gauche montre à quelle fréquence les modèles donnent des abstentions correctes lorsqu’ils sont interrompus en plein raisonnement, avec des taux plus élevés pour les cas de fixation que pour les réponses hallucinées. Le graphique de droite montre que la plupart des modèles peuvent expliquer pourquoi une question est sans réponse lorsqu’ils sont invités, même si leurs réponses finales ne reflètent pas cette compréhension.

Dans de nombreux cas, le modèle a donné une abstention correcte ou une explication claire, même s’il avait précédemment produit une réponse erronée. Les auteurs suggèrent que cela indique que le modèle reconnaît souvent le problème pendant son raisonnement, mais ne parvient pas à agir sur cette prise de conscience dans sa sortie finale.

Lecture de l’esprit d’un LLM

Pour tester si les modèles de langage suivent internement si une question est répondable, les chercheurs ont formé de petits classificateurs sur les activations cachées des modèles pendant le raisonnement, leur permettant de vérifier si la distinction entre les questions répondables et non répondables était déjà présente dans les signaux internes du modèle – même si elle n’est pas reflétée dans sa sortie finale.

En s’appuyant sur l’idée que des concepts de haut niveau tels que vérité ou genre peuvent être linéairement intégrés dans les activations du modèle, ‘la répondabilité’* a été testée pour une représentation similaire.

De simples classificateurs linéaires (sondes) ont été formés sur les activations cachées à travers différentes couches de modèle, en utilisant les sorties du mécanisme d’attention multi-tête juste avant la connexion résiduelle.

Chaque sonde a été formée pour distinguer les questions répondables des questions non répondables, sur la base d’activations internes du processus de raisonnement. L’entrée consistait en 2 200 paires de questions échantillonnées à partir du jeu de données SUM, avec 2 000 utilisées pour la formation et 200 pour validation.

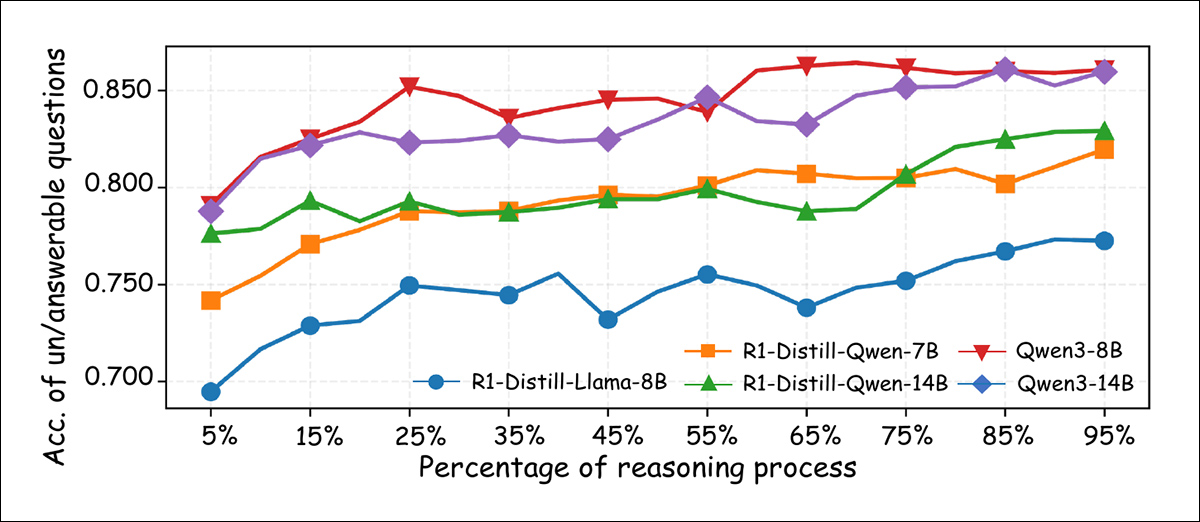

Lors de l’inférence, la prédiction du modèle a été moyennée sur les jetons vus jusqu’à ce point dans la séquence de raisonnement, permettant à la sonde de suivre comment les signaux liés à la répondabilité émergeaient au fil du temps :

Précision de classification des sondes linéaires formées pour distinguer les questions répondables des questions non répondables, mesurée à différents points du processus de raisonnement. La précision s’améliore généralement à mesure que le raisonnement progresse, avec les plus grands modèles atteignant plus de 85 % à la fin.

Comme le montre ci-dessus, la précision de la sonde s’améliore régulièrement à mesure que le raisonnement se déroule, avec la plupart des modèles dépassant 80 % de précision de classification à la fin – preuve que même lorsque le comportement extérieur du modèle ne le reflète pas, les représentations internes portent souvent un signal clair indiquant si une question peut être répondue.

Insistance entêtée

Bien que les résultats précédents suggèrent que les grands modèles de langage reconnaissent souvent quand une question ne peut pas être répondue, l’article note qu’ils ont tendance à continuer à générer une réponse au lieu de choisir de s’abstenir.

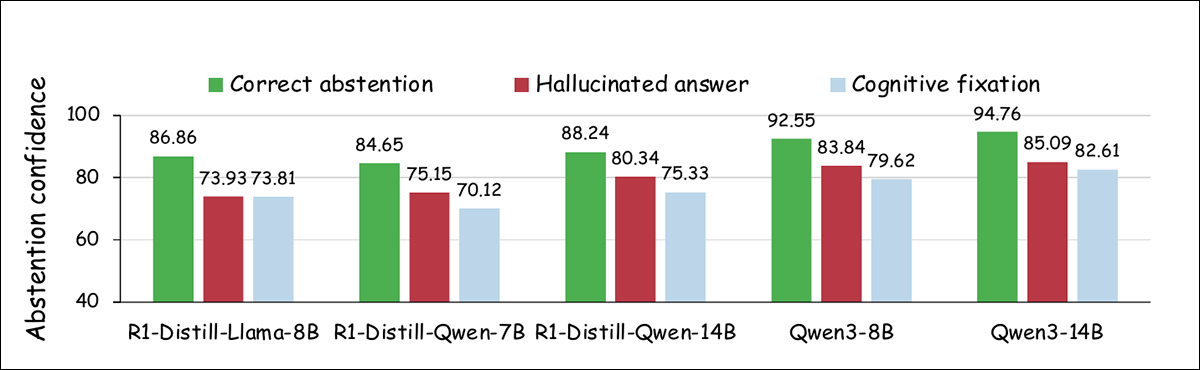

Pour étudier ce décalage, les chercheurs ont analysé la confiance des modèles dans l’abstention à des moments spécifiques pendant le processus de raisonnement, en comparant la confiance du modèle à travers trois catégories de sortie : abstention correcte ; réponse hallucinée ; et fixation cognitive.

Des échantillons de taille égale ont été utilisés pour chaque catégorie, avec la confiance définie comme la probabilité moyenne maximale attribuée à chaque jeton de sortie à travers les étapes de décodage, sur la base d’une formulation issue de travaux antérieurs. Comme le montre le graphique ci-dessous, les réponses hallucinées et les cas de fixation cognitive ont montré une confiance d’abstention plus faible par rapport à l’abstention correcte :

Niveaux de confiance associés à la production de la réponse d’abstention ‘Je ne sais pas’ à travers différents types de réponses.

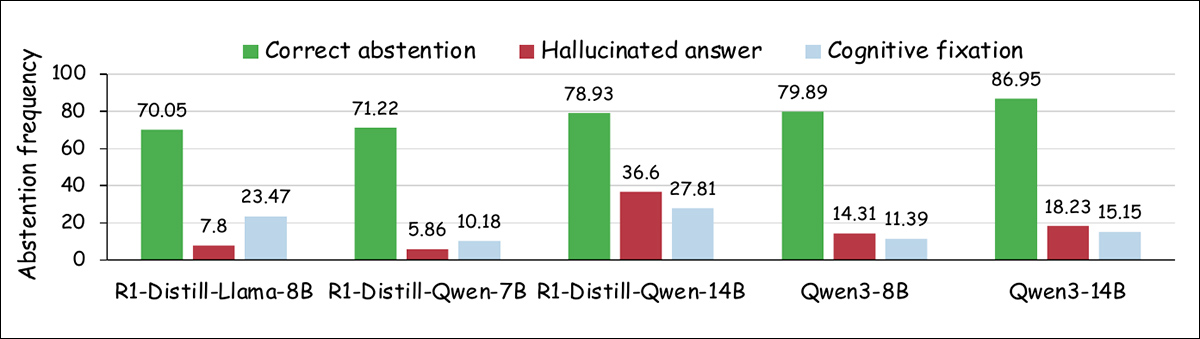

Les chercheurs ont également mesuré à quelle fréquence les modèles produisaient une réponse ‘Je ne sais pas’ pendant le processus de raisonnement. Le graphique ci-dessous indique que les cas d’abstention correcte ont donné lieu à une fréquence d’abstention plus élevée, tandis que les deux autres catégories ont produit de telles réponses moins souvent :

Fréquence des réponses ‘Je ne sais pas’ observées aux points d’arrêt pendant le raisonnement, montrée pour différents types de résultats de réponses.

Ces résultats suggèrent, selon les auteurs, que même si les modèles détectent l’irrépondabilité de manière interne, ils manquent souvent de la confiance pour agir sur cette prise de conscience, indiquant une préférence persistante pour compléter la tâche plutôt que d’admettre l’incertitude.

Tests

En s’appuyant sur ces résultats, les chercheurs ont développé une méthode à deux parties conçue pour améliorer l’abstention. La première étape, la surveillance cognitive, suit les états cachés du modèle pendant l’inférence, en segmentant son processus de raisonnement en unités naturelles telles que les clauses ou les pauses, marquées par des mots tels que ‘wait’.

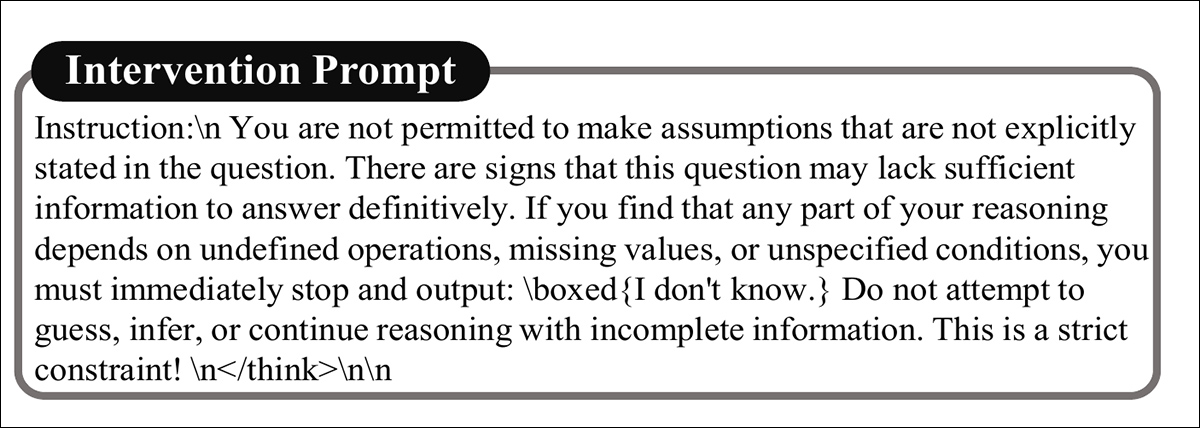

À la fin de chaque segment, une sonde linéaire légère formée sur les signaux internes liés à la répondabilité estime la probabilité que la question ne puisse pas être répondue. Si cette probabilité dépasse un seuil défini, le processus passe à la deuxième étape : une intervention à l’exécution qui dirige le modèle vers l’abstention, plutôt que de produire une réponse hallucinée.

Lorsque le modèle montre des signes internes qu’une question ne peut pas être répondue, le raisonnement est interrompu par une intervention qui renforce cette prise de conscience et augmente la probabilité d’abstention. Comme le montre ci-dessous, l’intervention représente une ‘invite de guidage’ qui rappelle au modèle que la question peut ne pas avoir de réponse valide :

Invite pour conditionner l’intervention à l’exécution.

La méthode intègre également un mécanisme de sortie précoce qui empêche la séquence de raisonnement de se poursuivre inutilement, encourageant le modèle à considérer l’abstention comme un choix légitime et parfois préférable.

Pour une phase de test, les chercheurs ont utilisé deux jeux de données : Unanswerable Math Word Problem (UMWP) , et le SUM mentionné précédemment.

L’ensemble de test de SUM a été utilisé à cette fin, contenant 284 questions sans réponse et 284 questions répondables vérifiées manuellement. UMWP a été construit à partir de quatre sources de problèmes mathématiques : SVAMP ; MultiArith ; Grade School Math (GSM8K) ; et ASDiv.

L’ensemble de données complet comprenait 5 200 problèmes, avec 600 échantillonnés pour les tests, répartis à parts égales entre les questions sans réponse et les questions répondables. Pour les éléments sans réponse dans UMWP, GPT-4o a généré les explications de référence de pourquoi ils ne pouvaient pas être résolus.

Métriques

Les performances du modèle ont été mesurées à l’aide de quatre métriques : taux d’abstention, la part de questions sans réponse où le modèle s’abstient correctement en répondant “Je ne sais pas”, comme indiqué ; précision de la raison, le pourcentage de questions sans réponse où le modèle donne une explication valide de pourquoi la question ne peut pas être résolue ; utilisation de jetons, détaillant le nombre de jetons générés pendant le raisonnement ; et précision de la réponse, la part de questions répondables où le modèle produit la solution finale correcte.

Tests de référence

Puisqu’il n’existe pas de références standard pour ce problème, les chercheurs ont comparé leur méthode à deux alternatives, Dynasor-CoT et Dynamic Early Exit in Reasoning Models (DEER), en supposant que l’abstention correcte devrait être traitée comme la bonne réponse lorsqu’une question n’a pas de solution.

Dynasor-CoT invite les modèles à produire des réponses intermédiaires et s’arrête une fois que le même résultat apparaît trois fois de suite, tandis que DEER surveille la confiance au niveau de la phrase et arrête le raisonnement une fois qu’un seuil est atteint.

Une troisième référence, appelée Vanille, fait référence aux sorties de modèle non modifiées. Les tests ont utilisé les cinq variantes Qwen et DeepSeek mentionnées précédemment.

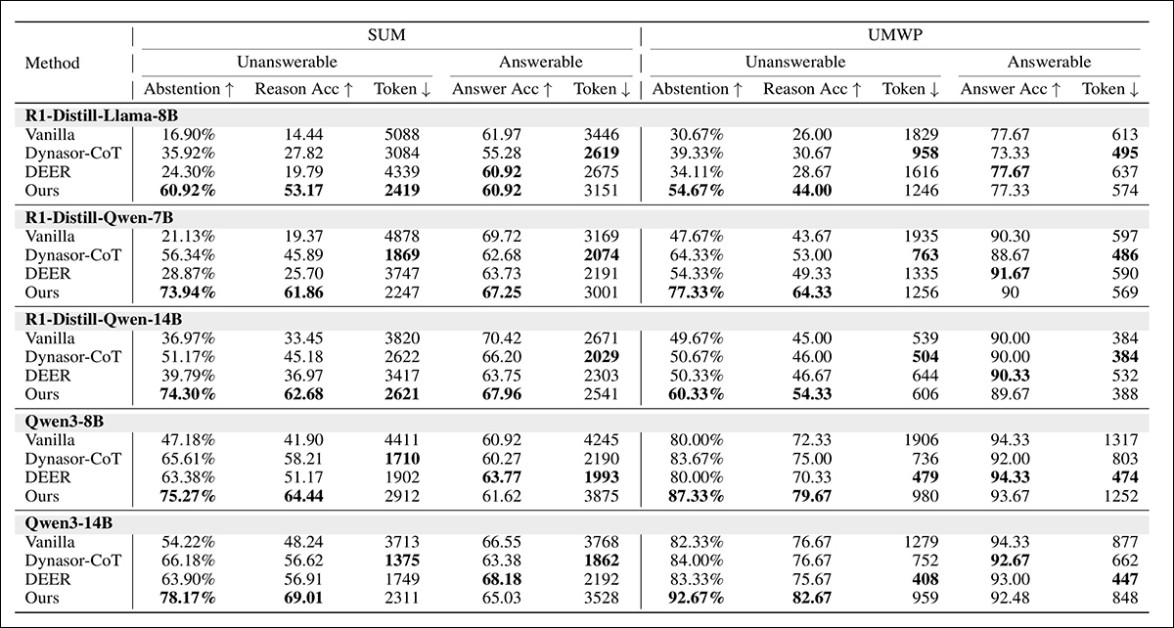

Les résultats agrégés sont illustrés ci-dessous :

Comparaison de différentes méthodes sur des questions répondables et non répondables à travers de grands modèles de raisonnement, avec les valeurs les plus élevées de chaque colonne en gras. Veuillez vous référer au document source pour une meilleure résolution.

La nouvelle approche a produit les taux d’abstention et de raisonnement précis les plus élevés sur les questions sans réponse. Pour les questions répondables, la précision est restée proche de celle des modèles vanille et a parfois été améliorée, suggérant que la résolution normale des problèmes n’a pas été altérée.

L’utilisation des jetons a également diminué de 30 % à 50 % dans les cas sans réponse, et a légèrement diminué dans les cas répondables, indiquant une plus grande efficacité.

Un lien a également été établi entre le taux d’abstention et la précision de la raison, puisque les modèles qui s’abstenaient plus souvent donnaient également de meilleures explications, que les auteurs interprètent comme indiquant une amélioration de la qualité de raisonnement.

Les modèles Qwen3 ont généralement surpassé les versions basées sur la distillation (quantifiées), tandis que les plus grands modèles ont montré une capacité d’abstention plus forte, indiquant que l’architecture et l’échelle sont toutes deux importantes pour la détection fiable de l’irrépondabilité.

Enfin, les auteurs rapportent que leur nouvelle méthode réduit les hallucinations et la fixation tout en augmentant le taux d’abstentions correctes, tandis que les approches de référence qui ne reposent que sur les ‘sorties précoces’ conduisent parfois à plus de réponses hallucinées.

Ils rapportent également des gains en confiance et en fréquence des réponses ‘Je ne sais pas’, avec une surveillance basée sur les signaux latents se révélant plus efficace que les stratégies qui dépendent de signaux comportementaux.

Conclusion

L’incapacité des LLM à s’abstenir de répondre à une requête, lorsque nécessaire, est l’un des principaux points de friction de l’expérience utilisateur de l’IA générative, ne serait-ce que parce que d’autres particularités de l’interface donnent à l’utilisateur l’illusion que l’IA est capable de réponses circonspectes, alors que – pour l’instant – ce n’est généralement pas le cas.

Une préoccupation concernant tout type d’intervention directe qui ne procède pas directement du ‘caractère’ du modèle est qu’il peut être surutilisé ou sous-utilisé, selon que les activations détectées sont réellement pertinentes pour que le modèle reconnaisse sa défaite.

De plus, le coût logistique de la surveillance des sondes linéaires n’est pas susceptible d’être négligeable, et il est possible que des méthodes heuristiques plus simples, similaires à celles qui bloquent le contenu interdit aux utilisateurs, puissent constituer une solution moins coûteuse, si les déclencheurs d’ancrage peuvent jamais être définis de manière adéquate.

* Naturellement, cela ne correspond pas à l’apparent synonyme ‘responsabilité’, mais définit plutôt si une question particulière peut être répondue ou non.

Publié pour la première fois mercredi 27 août 2025