Intelligence artificielle

Mistral AI : établir de nouvelles références au-delà de Llama2 dans l’espace open-source

Les grands modèles de langage (LLM) ont récemment pris le devant de la scène, grâce à des performances exceptionnelles comme ChatGPT. Lorsque Meta a présenté ses modèles Llama, cela a ravivé l’intérêt pour les LLM open-source. L’objectif ? Créer des LLM open-source abordables qui soient aussi bons que les modèles de haut niveau tels que GPT-4, mais sans le coût élevé ou la complexité.

Ce mélange d’abordabilité et d’efficacité n’a pas seulement ouvert de nouvelles voies pour les chercheurs et les développeurs, mais a également posé le décor pour une nouvelle ère de progrès technologiques dans le traitement automatique des langues.

Récemment, les startups d’intelligence artificielle générative ont été sur une lancée avec des financements. Ensemble a levé 20 millions de dollars, visant à façonner l’IA open-source. Anthropic a également levé une impressionnante somme de 450 millions de dollars, et Cohere, en partenariat avec Google Cloud, a sécurisé 270 millions de dollars en juin de cette année.

Introduction à Mistral 7B : taille et disponibilité

Mistral AI, basé à Paris et co-fondé par d’anciens employés de Google DeepMind et Meta, a annoncé son premier grand modèle de langage : Mistral 7B. Ce modèle peut être facilement téléchargé par quiconque sur GitHub et même via un torrent de 13,4 gigaoctets.

Cette startup a réussi à obtenir un financement initial record même avant d’avoir un produit. Le premier modèle de Mistral avec 7 milliards de paramètres surpasse les performances de Llama 2 13B dans tous les tests et bat Llama 1 34B dans de nombreux indicateurs de performance.

Par rapport à d’autres modèles comme Llama 2, Mistral 7B offre des capacités similaires ou meilleures avec moins de surcharge computationnelle. Alors que les modèles fondamentaux comme GPT-4 peuvent atteindre plus, ils sont plus coûteux et moins conviviaux, car ils sont principalement accessibles via des API.

Lorsqu’il s’agit de tâches de codage, Mistral 7B donne CodeLlama 7B une course pour son argent. De plus, il est suffisamment compact à 13,4 GB pour fonctionner sur des machines standard.

De plus, Mistral 7B Instruct, spécifiquement conçu pour les ensembles de données instructifs sur Hugging Face, a montré de grandes performances. Il surpasse d’autres modèles 7B sur MT-Bench et se tient épaule contre épaule avec des modèles de chat 13B.

Hugging Face Mistral 7B Exemple

Benchmarking des performances

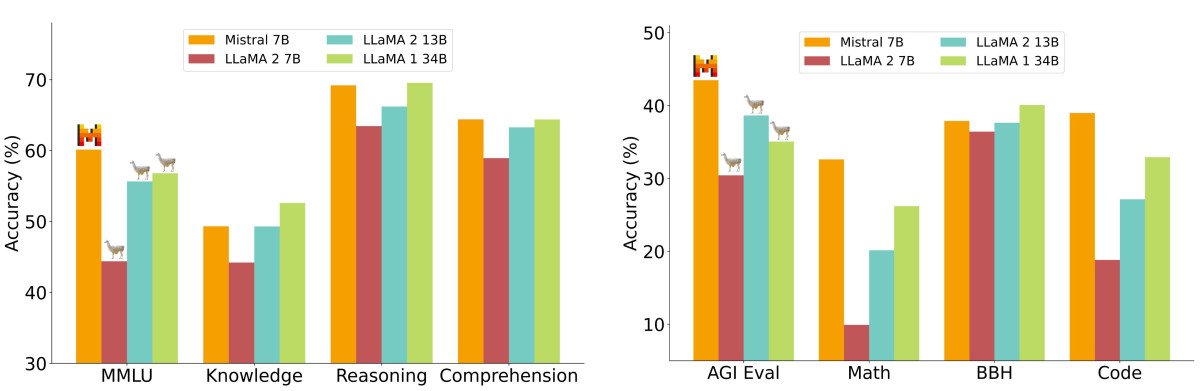

Dans une analyse détaillée des performances, Mistral 7B a été mesuré contre les modèles de la famille Llama 2. Les résultats étaient clairs : Mistral 7B a considérablement dépassé Llama 2 13B dans tous les benchmarks. En fait, il a égalé les performances de Llama 34B, se démarquant particulièrement dans les benchmarks de code et de raisonnement.

Les benchmarks ont été organisés en plusieurs catégories, telles que la raisonnement commun, les connaissances mondiales, la compréhension de la lecture, les mathématiques et le code, entre autres. Une observation particulièrement remarquable était la métrique de coût-performance de Mistral 7B, appelée « tailles de modèles équivalentes ». Dans des domaines tels que la raisonnement et la compréhension, Mistral 7B a montré des performances similaires à celles d’un modèle Llama 2 trois fois plus grand, ce qui signifie des économies potentielles en mémoire et une augmentation du débit. Cependant, dans les benchmarks de connaissances, Mistral 7B s’est aligné étroitement sur Llama 2 13B, ce qui est probablement dû aux limitations de ses paramètres affectant la compression des connaissances.

Qu’est-ce qui rend vraiment le modèle Mistral 7B meilleur que la plupart des autres modèles de langage ?

Mécanismes d’attention simplifiés

Alors que les subtilités des mécanismes d’attention sont techniques, leur idée fondamentale est relativement simple. Imaginez lire un livre et mettre en évidence des phrases importantes ; c’est analogue à la façon dont les mécanismes d’attention « mettent en évidence » ou donnent de l’importance à des points de données spécifiques dans une séquence.

Dans le contexte des modèles de langage, ces mécanismes permettent au modèle de se concentrer sur les parties les plus pertinentes des données d’entrée, garantissant que la sortie est cohérente et précise dans le contexte.

Dans les transformateurs standard, les scores d’attention sont calculés avec la formule :

La formule de ces scores implique une étape cruciale – la multiplication matricielle de Q et K. Le défi ici est que lorsque la longueur de la séquence augmente, les deux matrices s’étendent en conséquence, conduisant à un processus computationnellement intensif. Cette préoccupation de scalabilité est l’une des principales raisons pour lesquelles les transformateurs standard peuvent être lents, en particulier lorsqu’ils traitent de longues séquences.

L’attention multi-requête (MQA) accélère les choses en utilisant un seul ensemble de « têtes clé-valeur » mais sacrifie parfois la qualité. Maintenant, vous vous demandez peut-être, pourquoi ne pas combiner la vitesse de la MQA avec la qualité de l’attention multi-tête ? C’est là que l’attention regroupée-requête (GQA) entre en jeu.

Attention regroupée-requête (GQA)

GQA est une solution intermédiaire. Au lieu d’utiliser une seule ou plusieurs « têtes clé-valeur », il les regroupe. De cette façon, GQA atteint des performances proches de l’attention multi-tête détaillée mais avec la vitesse de la MQA. Pour des modèles comme Mistral, cela signifie des performances efficaces sans compromettre trop la qualité.

Attention à fenêtre glissante (SWA)

La fenêtre glissante est une autre méthode utilisée pour traiter les séquences d’attention. Cette méthode utilise une fenêtre d’attention de taille fixe autour de chaque jeton de la séquence. Avec plusieurs couches empilant cette attention fenêtrée, les couches supérieures gagnent finalement une perspective plus large, englobant des informations de l’ensemble des données d’entrée. Ce mécanisme est analogue aux champs réceptifs observés dans les réseaux de neurones convolutionnels (CNN).

D’un autre côté, l’« attention à fenêtre glissante dilatée » du modèle Longformer, qui est conceptuellement similaire à la méthode de la fenêtre glissante, ne calcule que quelques diagonales de la matrice. Ce changement se traduit par une utilisation de la mémoire qui augmente linéairement plutôt que quadratiquement, ce qui en fait une méthode plus efficace pour les séquences plus longues.

Transparence de Mistral AI vs. préoccupations de sécurité dans la décentralisation

Dans leur annonce, Mistral AI a également mis l’accent sur la transparence avec la déclaration : « Pas de trucs, pas de données propriétaires ». Mais en même temps, leur seul modèle disponible pour le moment, ‘Mistral-7B-v0.1’, est un modèle de base pré-entraîné, il peut donc générer une réponse à n’importe quelle requête sans modération, ce qui soulève des préoccupations de sécurité potentielles. Alors que des modèles comme GPT et Llama ont des mécanismes pour discerner quand répondre, la nature entièrement décentralisée de Mistral pourrait être exploitée par des acteurs malveillants.

Cependant, la décentralisation des grands modèles de langage a ses mérites. Alors que certains pourraient en abuser, les gens peuvent exploiter son pouvoir pour le bien social et rendre l’intelligence accessible à tous.

Flexibilité de déploiement

L’un des points forts est que Mistral 7B est disponible sous licence Apache 2.0. Cela signifie qu’il n’y a pas de véritables barrières à son utilisation – que vous l’utilisez à des fins personnelles, pour une grande entreprise ou même pour une entité gouvernementale. Vous n’avez besoin que du système approprié pour l’exécuter, ou vous devrez peut-être investir dans des ressources cloud.

Alors qu’il existe d’autres licences telles que la licence MIT plus simple et la licence CC BY-SA-4.0 coopérative, qui exige le crédit et une licence similaire pour les dérivés, Apache 2.0 fournit une base solide pour les entreprises à grande échelle.

Pensées finales

L’essor des grands modèles de langage open-source comme Mistral 7B signifie un changement important dans l’industrie de l’IA, rendant des modèles de langage de haute qualité accessibles à un public plus large. Les approches innovantes de Mistral AI, telles que l’attention regroupée-requête et l’attention à fenêtre glissante, promettent des performances efficaces sans compromettre la qualité.

Alors que la nature décentralisée de Mistral pose certains défis, sa flexibilité et sa licence open-source soulignent le potentiel de démocratisation de l’IA. À mesure que le paysage évolue, l’accent sera inévitablement mis sur l’équilibre entre la puissance de ces modèles et les considérations éthiques et les mécanismes de sécurité.

Que vient-il ensuite pour Mistral ? Le modèle 7B n’était que le début. L’équipe vise à lancer des modèles encore plus grands bientôt. Si ces nouveaux modèles égalent les performances du 7B, Mistral pourrait rapidement émerger comme un acteur majeur de l’industrie, tout cela dans leur première année.