Angle d’Anderson

Recherche d’‘Hiboux et Lézards’ dans le Publicité d’un Annonceur

Puisque le secteur de la publicité en ligne est estimé avoir dépensé 740,3 milliards de dollars USD en 2023, il est facile de comprendre pourquoi les sociétés de publicité investissent des ressources considérables dans cette branche particulière de la recherche en vision par ordinateur.

Bien que fermée et protectrice, l’industrie publie occasionnellement des études qui laissent entendre un travail plus avancé et propriétaire dans la reconnaissance faciale et de la direction du regard – y compris la reconnaissance de l’âge, essentielle aux statistiques d’analyse démographique :

Estimer l’âge dans un contexte publicitaire est d’intérêt pour les annonceurs qui peuvent cibler un public démographique particulier. Dans cet exemple expérimental d’estimation automatique de l’âge facial, l’âge du chanteur Bob Dylan est suivi au fil des ans. Source : https://arxiv.org/pdf/1906.03625

Ces études, qui apparaissent rarement dans les dépôts publics tels qu’Arxiv, utilisent des participants recrutés légitimement comme base pour l’analyse pilotée par l’IA qui vise à déterminer dans quelle mesure et de quelle manière le spectateur interagit avec une publicité.

L’histogramme des gradients orientés (HoG) de Dlib est souvent utilisé dans les systèmes d’estimation faciale. Source : https://www.computer.org/csdl/journal/ta/2017/02/07475863/13rRUNvyarN

Instinct Animal

À cet égard, naturellement, l’industrie de la publicité est intéressée à déterminer les faux positifs (les occasions où un système d’analyse interprète incorrectement les actions d’un sujet) et à établir des critères clairs pour déterminer quand la personne regardant leurs publicités n’est pas pleinement engagée dans le contenu.

En ce qui concerne la publicité basée sur l’écran, les études tendent à se concentrer sur deux problèmes dans deux environnements. Les environnements sont ‘bureau’ ou ‘mobile’, chacun ayant des caractéristiques particulières qui nécessitent des solutions de suivi sur mesure ; et les problèmes – du point de vue de l’annonceur – sont représentés par le comportement des hiboux et des lézards – la tendance des spectateurs à ne pas prêter attention à une publicité qui se trouve devant eux.

Exemples de comportement d’hiboux et de lézards dans un sujet d’un projet de recherche publicitaire. Source : https://arxiv.org/pdf/1508.04028

Si vous regardez à l’écart de la publicité intentionnelle avec toute votre tête, c’est un comportement d’hibou ; si votre pose de tête est statique mais que vos yeux se promènent à l’écart de l’écran, c’est un comportement de lézard. En termes d’analyse et de test de nouvelles publicités dans des conditions contrôlées, ces actions sont essentielles pour qu’un système puisse les capturer.

Un nouvel article de l’acquisition Affectiva de SmartEye aborde ces questions, en proposant une architecture qui exploite plusieurs cadres existants pour fournir un ensemble de fonctionnalités combiné et concaténé dans toutes les conditions et réactions possibles – et pour déterminer si un spectateur est ennuyé, engagé ou en quelque sorte distant du contenu que l’annonceur souhaite qu’il regarde.

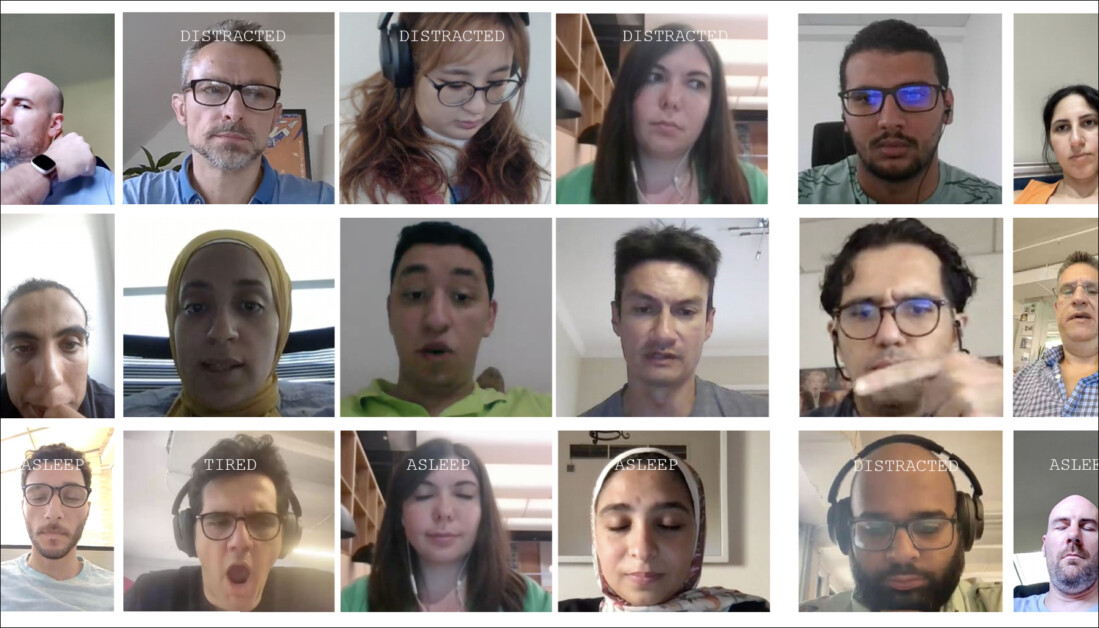

Exemples de vrais et de faux positifs détectés par le nouveau système d’attention pour divers signaux de distraction, affichés séparément pour les appareils de bureau et mobiles. Source : https://arxiv.org/pdf/2504.06237

Les auteurs déclarent* :

‘Limitée recherche a étudié le suivi de l’attention pendant les publicités en ligne. Bien que ces études se soient concentrées sur l’estimation de la pose de la tête ou de la direction du regard pour identifier les instances de regard détourné, elles ignorent des paramètres critiques tels que le type d’appareil (bureau ou mobile), le placement de la caméra par rapport à l’écran et la taille de l’écran. Ces facteurs influencent considérablement la détection de l’attention.

‘Dans cet article, nous proposons une architecture pour la détection de l’attention qui englobe la détection de divers distracteurs, notamment le comportement des hiboux et des lézards de regard à l’écart de l’écran, la parole, la somnolence (par bâillement et fermeture prolongée des yeux) et l’abandon de l’écran.

‘Contrairement aux approches précédentes, notre méthode intègre des fonctionnalités spécifiques à l’appareil, telles que le type d’appareil, le placement de la caméra, la taille de l’écran (pour les bureaux) et l’orientation de la caméra (pour les appareils mobiles) avec l’estimation brute du regard pour améliorer la précision de la détection de l’attention.’

Le nouvel article est intitulé Surveillance de l’attention du spectateur pendant les publicités en ligne, et provient de quatre chercheurs d’Affectiva.

Méthode et Données

En grande partie en raison de la nature secrète et propriétaire de tels systèmes, le nouvel article ne compare pas directement l’approche des auteurs avec les rivaux, mais présente plutôt ses résultats exclusivement sous forme d’études d’ablation ; ni l’article n’adhère en général au format habituel de la littérature sur la vision par ordinateur. Par conséquent, nous allons examiner la recherche telle qu’elle est présentée.

Les auteurs soulignent qu’un nombre limité d’études ont abordé la détection de l’attention spécifiquement dans le contexte des publicités en ligne. Dans le kit de développement de logiciel AFFDEX SDK, qui propose une reconnaissance faciale en temps réel, l’attention est déduite uniquement de la pose de la tête, avec des participants étiquetés comme inattentifs si leur angle de tête dépasse un seuil défini.

Un exemple du kit de développement de logiciel AFFDEX SDK, un système Affectiva qui repose sur la pose de la tête comme indicateur d’attention. Source : https://www.youtube.com/watch?v=c2CWb5jHmbY

Dans la collaboration de 2019 Mesure automatique de l’attention visuelle au contenu vidéo à l’aide de l’apprentissage automatique, un ensemble de données de 28 000 participants a été annoté pour divers comportements inattentifs, notamment regard à l’écart, fermeture des yeux, ou engagement dans des activités sans rapport, et un modèle CNN-LSTM a été formé pour détecter l’attention à partir de l’apparence faciale au fil du temps.

À partir de l’article de 2019, un exemple illustrant les états d’attention prédits pour un spectateur regardant du contenu vidéo. Source : https://www.jeffcohn.net/wp-content/uploads/2019/07/Attention-13.pdf.pdf

Cependant, les auteurs observent que ces efforts antérieurs n’ont pas tenu compte de facteurs spécifiques à l’appareil, tels que le fait que le participant utilisait un appareil de bureau ou mobile ; ni n’ont-ils considéré la taille de l’écran ou le placement de la caméra. De plus, le système AFFDEX se concentre uniquement sur l’identification de la diversion du regard et omet d’autres sources de distraction, tandis que le travail de 2019 tente de détecter un ensemble plus large de comportements – mais son utilisation d’un seul réseau de neurones convolutifs (CNN) peu profond peut, selon l’article, avoir été inadéquate pour cette tâche.

Les auteurs observent que certaines des recherches les plus populaires dans ce domaine ne sont pas optimisées pour les tests de publicité, qui ont des besoins différents par rapport à des domaines tels que la conduite ou l’éducation – où le placement et l’étalonnage de la caméra sont généralement fixés à l’avance, en fonctionnant plutôt sur des configurations non étalonnées et opérant dans la plage de regard limitée des appareils de bureau et mobiles.

Par conséquent, ils ont conçu une architecture pour détecter l’attention du spectateur pendant les publicités en ligne, en exploitant deux kits de développement de logiciel commerciaux : AFFDEX 2.0 et SmartEye SDK.

Exemples d’analyse faciale à partir d’AFFDEX 2.0. Source : https://arxiv.org/pdf/2202.12059

Ces travaux antérieurs extraient des fonctionnalités de bas niveau telles que les expressions faciales, la pose de la tête et la direction du regard. Ces fonctionnalités sont ensuite traitées pour produire des indicateurs de niveau supérieur, notamment la position du regard sur l’écran ; le bâillement ; et la parole.

Le système identifie quatre types de distraction : regard à l’écart de l’écran ; somnolence ; parole ; et écrans non surveillés. Il ajuste également l’analyse du regard en fonction de l’appareil utilisé par le spectateur, qu’il s’agisse d’un appareil de bureau ou mobile.

Ensembles de Données : Regard

Les auteurs ont utilisé quatre ensembles de données pour alimenter et évaluer le système de détection de l’attention : trois se concentrant individuellement sur le comportement du regard, la parole et le bâillement ; et un quatrième tiré de sessions de test de publicités réelles contenant un mélange de types de distraction.

En raison des exigences spécifiques du travail, des ensembles de données personnalisés ont été créés pour chacune de ces catégories. Tous les ensembles de données curatés provenaient d’un référentiel propriétaire contenant des millions de sessions enregistrées de participants regardant des publicités dans des environnements domestiques ou professionnels, en utilisant une configuration basée sur le Web, avec un consentement éclairé – et en raison des limitations de ces accords de consentement, les auteurs déclarent que les ensembles de données pour le nouvel article ne peuvent pas être rendus publics.

Pour construire l’ensemble de données regard, les participants ont été invités à suivre un point en mouvement à différents points de l’écran, y compris ses bords, puis à regarder à l’écart de l’écran dans quatre directions (haut, bas, gauche et droite) avec une séquence répétée trois fois. De cette façon, la relation entre la capture et la couverture a été établie :

Captures d’écran montrant le stimulus vidéo du regard sur (a) les appareils de bureau et (b) les appareils mobiles. Les premiers et troisièmes cadres affichent des instructions pour suivre un point en mouvement, tandis que les deuxièmes et quatrièmes cadres invitent les participants à regarder à l’écart de l’écran.

Les segments du point en mouvement ont été étiquetés comme attentifs, et les segments à l’écart de l’écran comme inattentifs, produisant un ensemble de données étiqueté de exemples positifs et négatifs.

Chaque vidéo a duré environ 160 secondes, avec des versions distinctes créées pour les plateformes de bureau et mobile, chacune avec des résolutions de 1920×1080 et 608×1080, respectivement.

Un total de 609 vidéos ont été collectées, comprenant 322 enregistrements de bureau et 287 enregistrements mobiles. Les étiquettes ont été appliquées automatiquement en fonction du contenu de la vidéo, et l’ensemble de données divisé en 158 échantillons d’entraînement et 451 pour les tests.

Ensembles de Données : Parole

Dans ce contexte, l’un des critères définissant ‘l’inattention’ est lorsque une personne parle pendant plus d’une seconde (ce qui pourrait être un commentaire momentané, ou même une toux).

Puisque l’environnement contrôlé n’enregistre ni n’analyse l’audio, la parole est déduite en observant le mouvement interne des repères faciaux estimés. Par conséquent, pour détecter la parole sans audio, les auteurs ont créé un ensemble de données basé entièrement sur des entrées visuelles, tiré de leur référentiel interne, et divisé en deux parties : la première contenait environ 5 500 vidéos, chacune étiquetée manuellement par trois annotateurs comme parlant ou non (sur ces 5 500, 4 400 ont été utilisées pour l’entraînement et la validation, et 1 100 pour les tests).

La deuxième partie comprenait 16 000 sessions automatiquement étiquetées en fonction du type de session : 10 500 présentant des participants regardant silencieusement des publicités, et 5 500 montrant des participants exprimant leurs opinions sur des marques.

Ensembles de Données : Bâillement

Alors que certains ensembles de données de bâillement existent, notamment YawDD et Driver Fatigue, les auteurs affirment que aucun n’est adapté aux scénarios de test de publicité, car ils présentent soit des bâillements simulés, soit des contorsions faciales qui pourraient être confondues avec la peur ou d’autres actions non liées au bâillement.

Par conséquent, les auteurs ont utilisé 735 vidéos de leur collection interne, en sélectionnant des sessions susceptibles de contenir un bâillement d’une durée supérieure à une seconde. Chaque vidéo a été étiquetée manuellement par trois annotateurs comme montrant un bâillement actif ou inactif. Seuls 2,6 % des trames contenaient des bâillements actifs, soulignant le déséquilibre des classes, et l’ensemble de données a été divisé en 670 vidéos d’entraînement et 65 pour les tests.

Ensembles de Données : Distraction

L’ensemble de données distraction a également été tiré du référentiel d’Affectiva, où les participants avaient regardé de véritables publicités sans tâche assignée. Un total de 520 sessions (193 sur des appareils mobiles et 327 sur des appareils de bureau) ont été sélectionnées aléatoirement et étiquetées manuellement par trois annotateurs comme attentifs ou inattentifs.

Le comportement inattentif comprenait regard à l’écart de l’écran, parole, somnolence et écrans non surveillés. Les sessions couvraient diverses régions du monde, avec des enregistrements de bureau plus courants en raison d’un placement de webcam flexible.

Modèles d’Attention

Le modèle d’attention proposé traite des fonctionnalités visuelles de bas niveau, notamment les expressions faciales ; la pose de la tête ; et la direction du regard – extraites par les kits de développement de logiciel AFFDEX 2.0 et SmartEye SDK.

Ces fonctionnalités sont ensuite converties en indicateurs de niveau supérieur, avec chaque distracteur géré par un classificateur binaire distinct formé sur son propre ensemble de données pour une optimisation et une évaluation indépendantes.

Schéma du système de surveillance proposé.

Le modèle du regard détermine si le spectateur regarde ou non l’écran en utilisant des coordonnées de regard normalisées, avec un étalonnage distinct pour les appareils de bureau et mobiles. Aidant ce processus, une machine à vecteurs de support (SVM) linéaire est formée sur des fonctionnalités spatiales et temporelles, qui intègre une mémoire pour lisser les changements rapides du regard.

Pour détecter la parole sans audio, le système utilise des régions de bouche découpées et un 3D-CNN formé sur des segments de conversation et non de conversation. Les étiquettes sont assignées en fonction du type de session, avec un lissage temporel pour réduire les faux positifs qui peuvent résulter de mouvements de bouche brièves.

Le bâillement est détecté en utilisant des crops d’images de visage complet, pour capturer un mouvement facial plus large, avec un 3D-CNN formé sur des trames étiquetées manuellement (bien que la tâche ait été compliquée par la faible fréquence du bâillement dans la vision naturelle et par sa ressemblance avec d’autres expressions).

L’abandon de l’écran est identifié par l’absence d’un visage ou d’une pose de tête extrême, avec des prédictions effectuées par un arbre de décision.

L’état d’attention final est déterminé en utilisant une règle fixe : si l’un des modules détecte l’inattention, le spectateur est marqué inattentif – une approche qui donne la priorité à la sensibilité, et réglée séparément pour les appareils de bureau et mobiles.

Tests

Comme mentionné précédemment, les tests suivent une méthode d’ablation, où les composants sont supprimés et l’effet sur le résultat est noté.

Différentes catégories d’inattention perçue identifiées dans l’étude.

Le modèle du regard a identifié le comportement à l’écart de l’écran à travers trois étapes clés : la normalisation des estimations brutes du regard, l’affinement de la sortie et l’estimation de la taille de l’écran pour les appareils de bureau.

Pour comprendre l’importance de chaque composant, les auteurs les ont supprimés individuellement et ont évalué les performances sur 226 vidéos de bureau et 225 vidéos mobiles tirées de deux ensembles de données. Les résultats, mesurés par des scores G-mean et F1, sont présentés ci-dessous :

Résultats indiquant les performances du modèle du regard complet, ainsi que des versions avec des étapes de traitement supprimées.

Dans chaque cas, les performances ont diminué lorsque une étape a été omise. La normalisation s’est avérée particulièrement précieuse sur les appareils de bureau, où le placement de la caméra varie plus que sur les appareils mobiles.

L’étude a également évalué comment les fonctionnalités visuelles prédirent l’orientation de la caméra mobile : l’emplacement du visage, la pose de la tête et le regard de l’œil ont obtenu des scores de 0,75, 0,74 et 0,60, tandis que leur combinaison a atteint 0,91, mettant en évidence – selon les auteurs – l’avantage de l’intégration de plusieurs indices.

Le modèle de parole, formé sur la distance des lèvres verticales, a atteint un ROC-AUC de 0,97 sur l’ensemble de test étiqueté manuellement, et 0,96 sur l’ensemble de données plus important étiqueté automatiquement, indiquant des performances cohérentes dans les deux cas.

Le modèle de bâillement a atteint un ROC-AUC de 96,6 % en utilisant seul le rapport d’aspect de la bouche, ce qui s’est amélioré à 97,5 % lorsqu’il a été combiné avec les prédictions d’unités d’action d’AFFDEX 2.0.

Le modèle d’abandon d’écran a classé les moments comme inattentifs lorsque AFFDEX 2.0 et SmartEye n’ont pas détecté de visage pendant plus d’une seconde. Pour évaluer la validité de cela, les auteurs ont étiqueté manuellement tous les événements sans visage dans l’ensemble de données de distraction réelle, en identifiant la cause sous-jacente de chaque activation. Les cas ambigus (tels que l’obstruction de la caméra ou la distorsion de la vidéo) ont été exclus de l’analyse.

Comme le montrent les résultats du tableau ci-dessous, seuls 27 % des activations sans visage étaient dus à des utilisateurs quittant physiquement l’écran.

Raisons diverses obtenues pour lesquelles un visage n’a pas été trouvé, dans certaines instances.

L’article déclare :

‘Malgré le fait que les écrans non surveillés ne constituent que 27 % des instances déclenchant le signal sans visage, celui-ci a été activé pour d’autres raisons indicatives d’inattention, telles que les participants regardant à l’écart de l’écran avec un angle extrême, faisant des mouvements excessifs, ou occultant significativement leur visage avec un objet/main.’

Dans le dernier des tests quantitatifs, les auteurs ont évalué comment l’ajout progressif de différents signaux de distraction – regard à l’écart de l’écran (via le regard et la pose de la tête), somnolence, parole et écrans non surveillés – affectait les performances globales de leur modèle d’attention.

Les tests ont été effectués sur deux ensembles de données : l’ensemble de données de distraction réelle et un sous-ensemble de l’ensemble de données du regard. Les scores G-mean et F1 ont été utilisés pour mesurer les performances (bien que la somnolence et la parole aient été exclues de l’analyse de l’ensemble de données du regard, en raison de leur pertinence limitée dans ce contexte).

Comme le montre le tableau ci-dessous, la détection de l’attention s’est améliorée de manière cohérente à mesure que davantage de types de distraction ont été ajoutés, le regard à l’écart de l’écran – le distracteur le plus courant – fournissant la base la plus solide.

L’effet de l’ajout de divers signaux de distraction à l’architecture.

Sur ces résultats, l’article déclare :

‘À partir des résultats, nous pouvons d’abord conclure que l’intégration de tous les signaux de distraction contribue à une détection améliorée de l’attention.

‘Deuxièmement, l’amélioration de la détection de l’attention est cohérente à la fois sur les appareils de bureau et mobiles. Troisièmement, les sessions mobiles dans l’ensemble de données réel montrent des mouvements de tête importants lors du regard à l’écart, qui sont facilement détectés, conduisant à de meilleures performances pour les appareils mobiles par rapport aux appareils de bureau. Quatrièmement, l’ajout du signal de somnolence a une amélioration relativement faible par rapport aux autres signaux, car il est généralement rare.

‘Enfin, le signal d’écran non surveillé a une amélioration relativement plus importante sur les appareils mobiles par rapport aux appareils de bureau, car les appareils mobiles peuvent être facilement laissés sans surveillance.’

Les auteurs ont également comparé leur modèle à AFFDEX 1.0, un système antérieur utilisé dans les tests de publicité – et même la détection du regard basée sur la tête du modèle actuel a surpassé AFFDEX 1.0 sur les deux types d’appareils :

‘Ceci est dû à l’intégration des mouvements de tête dans les directions du yaw et du pitch, ainsi qu’à la normalisation de la pose de la tête pour tenir compte des changements mineurs. Les mouvements de tête importants dans l’ensemble de données réel mobile ont causé notre modèle de tête à performer de manière similaire à AFFDEX 1.0.’

Les auteurs terminent l’article avec un tour de tests qualitatifs (peut-être un peu perfunctoire) présenté ci-dessous.

Exemples de sorties du modèle d’attention sur les appareils de bureau et mobiles, chaque ligne présentant des exemples de vrais et de faux positifs pour différents types de distraction.

Les auteurs déclarent :

‘Les résultats indiquent que notre modèle détecte efficacement divers distracteurs dans des environnements non contrôlés. Cependant, il peut occasionnellement produire de faux positifs dans certains cas de bordure, tels que des inclinaisons de tête extrêmes tout en maintenant le regard sur l’écran, certaines occultations de la bouche, des yeux excessivement flous ou des images faciales fortement assombries. ‘

Conclusion

Bien que les résultats représentent un progrès mesuré mais significatif par rapport aux travaux antérieurs, la valeur plus profonde de l’étude réside dans le regard qu’elle offre sur la poussée persistante pour accéder à l’état interne du spectateur. Même si les données ont été collectées avec consentement, la méthodologie pointe vers des cadres futurs qui pourraient s’étendre au-delà des paramètres de recherche structurés.

Cette conclusion plutôt paranoïaque n’est que renforcée par la nature cloîtrée, contrainte et jalousement protégée de cette branche particulière de la recherche.

* Ma conversion des citations en ligne des auteurs en hyperliens.

Publié pour la première fois le mercredi 9 avril 2025