Angle d’Anderson

Identifier le vol de modèle d’IA grâce à des données de suivi secrètes

Une nouvelle méthode peut marquer discrètement des modèles similaires à ChatGPT en quelques secondes sans réentraînement, sans laisser de trace dans les sorties générales et en survivant à toutes les tentatives de suppression réalisables.

La différence subtile entre le marquage d’eau et le « piège d’auteur » est que les filigranes – qu’ils soient ouverts ou cachés – sont généralement destinés à apparaître à travers une collection (telle qu’un ensemble de données d’images) comme un obstacle ubiquitaire à la copie occasionnelle.

En revanche, une entrée fictive est un petit segment de texte, généralement un mot ou une définition présenté dans une grande et relativement générique collection, conçu pour prouver le vol. L’idée est que lorsque la totalité de l’œuvre est copiée illégitimement, soit en elle-même, soit comme base d’une œuvre dérivée, la présence d’un « fait unique » et spurious, planté par le propriétaire d’origine, révélera facilement l’acte de vol.

En termes d’ajout de filigranes aux Modèles de Langage à Grande Échelle (LLM) et aux Modèles de Langage Visuel (VLM), l’étendue à laquelle la sortie est destinée à contenir ces signes révélateurs est souvent partagée entre ces deux objectifs : assurer que toutes ou la plupart des sorties contiennent un filigrane manifeste ou latent ; ou assurer qu’un « jeton secret » peut être récupéré qui prouve le vol – mais qui n’apparaît pas dans les sorties régulières du modèle.

Le Poids des Preuves

La deuxième approche est abordée dans une collaboration intéressante entre la Chine, l’Italie et Singapour ; un travail qui vise à fournir une telle méthode de divulgation aux modèles open source, de sorte qu’ils ne puissent pas être facilement commercialisés, ou utilisés d’une autre manière qui ne soit pas autorisée par la licence d’origine.

Par exemple, la licence d’origine d’un modèle peut exiger que quiconque puisse profiter du travail tant qu’il rend ses propres modifications ou amendements publiquement disponibles sous les mêmes termes de licence généreux – mais une entreprise peut souhaiter garder ses « ajustements » (tels que des versions affinées), pour générer un fossé où aucun n’est vraiment autorisé.

La majorité de la recherche dans cette ligne est occupée par des routines de détection liées à des modèles à code source fermé, ou à des modèles pour lesquels seuls des poids optimisés (quantifiés) sont disponibles ; et qui sont donc plus difficiles à modifier et à modifier de manière efficace comme le propose le nouveau document (car il n’y a pas d’accès direct à l’architecture du modèle lui-même).

Cette attention portée aux versions FOSS est, peut-être, peu surprenante pour le secteur de la recherche chinoise, puisque la production d’IA de la Chine a été caractérisée au cours de la dernière année par des publications généreuses et complètes de modèles qui rivalisent au moins avec les équivalents occidentaux plus « verrouillés ».

La nouvelle approche, intitulée EditMark, se distingue en ce qu’elle n’exige pas que le modèle soit affiné pour ajouter les « données empoisonnées », ni formé dès le départ avec les données incluses.

Ceci présente plusieurs avantages : l’un est que toute « donnée révélatrice » incluse dans le jeu de données d’entraînement, une fois découverte et divulguée, ne sera plus efficace, car elle peut être directement ciblée par les attaquants ; mais pour attaquer EditMark, un malfaiteur devrait savoir quelle couche du modèle cibler, et quel type d’approche a été adopté. Ceci est un scénario peu probable.

Deuxièmement, l’approche est rapide et peu coûteuse, prenant une question de secondes (plutôt que des jours ou même des semaines) pour s’appliquer à un modèle formé, ce qui obvient aux frais importants de l’affinage (qui augmente linéairement avec la taille du modèle et les données à appliquer).

Enfin, l’approche fait nettement moins de dommages au fonctionnement normal du modèle ciblé que l’affinage ou les méthodes d’édition antérieures.

Dans les tests, EditMark – qui intègre des requêtes mathématiques avec plusieurs réponses possibles dans les poids du modèle – a atteint un taux d’extraction de 100 %.

Les auteurs déclarent :

‘Des expériences complètes démontrent les performances exceptionnelles d’EditMark dans le marquage d’eau des LLM. EditMark atteint une efficacité remarquable en intégrant un filigrane de 32 bits en moins de 20 secondes avec un taux de réussite d’extraction de filigrane de 100 % (ESR).

‘Notamment, le temps d’intégration du filigrane est inférieur à 1/300 de l’affinage (en moyenne 6 875 secondes), ce qui met en évidence l’efficacité d’EditMark pour mettre en œuvre des filigranes à haute capacité avec une vitesse et une fiabilité sans précédent.

‘En outre, des expériences approfondies valident la robustesse, la discrétion et la fidélité d’EditMark.’

Le nouveau document est intitulé EditMark : Marquage d’eau des Modèles de Langage à Grande Échelle basé sur l’Édition de Modèle, et provient de huit auteurs issus de l’Université des Sciences et de la Technologie de Chine, de l’Université de Sienne et de CFAR/IHPC/A*STAR à Singapour.

Méthode

L’approche EditMark comprend quatre composants : un Générateur, un Encodeur, un Éditeur et un Décodeur :

La pipeline EditMark intègre un filigrane en éditant un modèle pour répondre à des questions mathématiques spécifiques de manière à encoder des informations d’identification cachées. Source : https://arxiv.org/pdf/2510.16367

Le Générateur utilise une graine pseudo-aléatoire pour construire des questions mathématiques à réponses multiples ; l’Encodeur sélectionne des réponses en fonction du filigrane, qui sont ensuite intégrées dans le modèle via un processus d’édition spécialisé. Une fois le modèle édité publié ou mal utilisé, le filigrane peut être extrait en posant les mêmes questions et en décodant le modèle de réponses.

Par la suite, l’Éditeur modifie les poids du modèle de telle sorte que, lorsqu’il est interrogé sur ces questions semenciées, le modèle produise de manière fiable les réponses ciblées, en intégrant le filigrane directement dans son comportement. Le Décodeur récupère ensuite le filigrane en fournissant les mêmes questions au modèle suspect et en traduisant ses réponses en arrière dans la signature cachée.

Modèle de Menace

Le modèle de menace du document suppose que le marquage d’eau est effectué dans un environnement à boîte blanche. Bien que cela ne soit généralement pas un bon signe dans la recherche liée à la sécurité, ici cela est normal, car la méthode vise à protéger les propriétaires qui ont un accès complet à leur propre travail.

L’attaquant est également supposé avoir un accès à la boîte blanche après avoir obtenu le modèle, ce qui signifie qu’il peut le modifier (par exemple, en le réduisant ou en l’affinant). À nouveau, ce scénario est normal et attendu dans le cas d’une publication FOSS. Cependant, l’attaquant n’a pas connaissance du processus d’extraction de filigrane ou du schéma utilisé, et ne peut le découvrir que par inférence et expérimentation (ou par fuite).

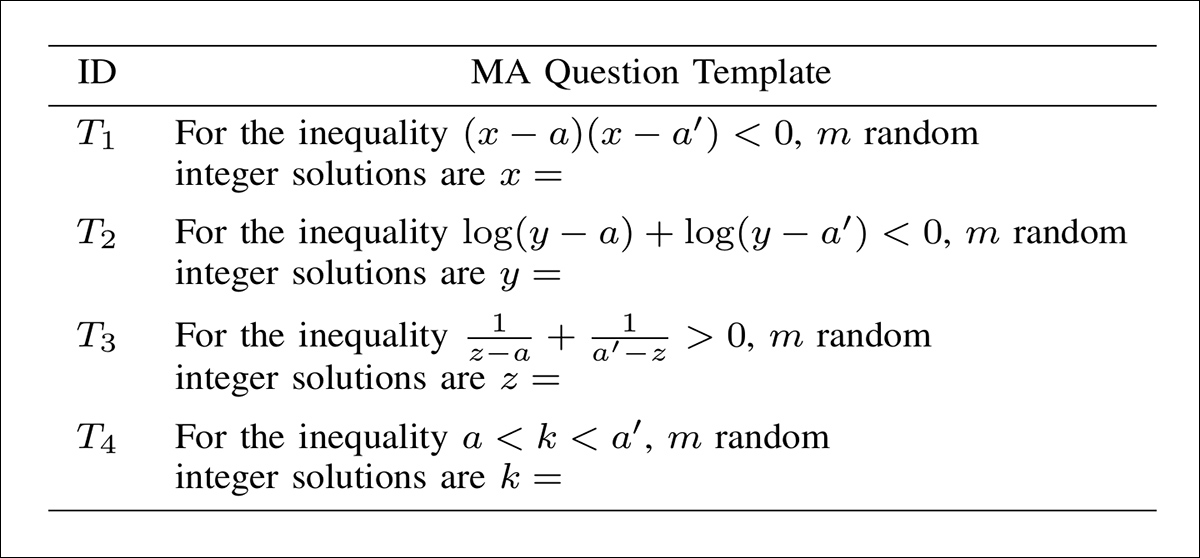

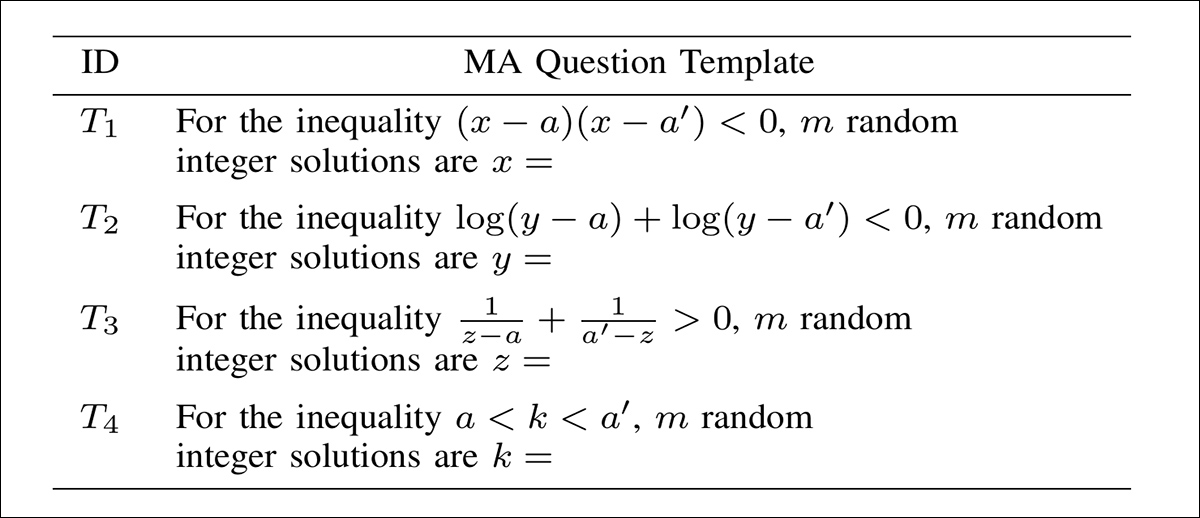

Le Générateur construit des questions mathématiques logiquement et factuellement valides avec plusieurs réponses correctes, en utilisant GPT-4o pour diversifier les modèles (comme illustré ci-dessous), et une graine pseudo-aléatoire pour garantir que chaque question est unique. Cela permet à un filigrane connu d’être intégré de manière déterministe via des permutations de réponses, tout en minimisant les chevauchements entre les questions, pour éviter l’entanglement d’édition :

Modèles de questions générées par GPT-4o pour l’intégration de filigrane, chacun structuré pour produire plusieurs réponses entières valides à partir d’une inégalité semenciée.

L’Encodeur transforme chaque segment de filigrane binaire en une permutation unique d’entiers tirés de l’ensemble de solutions d’une question mathématique donnée. En utilisant la théorie de permutation lexicographique, l’Encodeur mappe la valeur décimale de chaque segment de filigrane à une sélection spécifique et ordonnée de réponses, en garantissant que le filigrane est déterminiquement intégré dans le comportement du modèle.

En ce qui concerne l’Éditeur, la méthode d’édition de modèle AlphaEdit originale utilisée pour le marquage d’eau manque à la fois de précision et de résilience, avec le modèle ajusté qui échoue souvent à renvoyer les réponses requises. Toute modification qu’il fait est facilement brisée par la réduction ou le bruit.

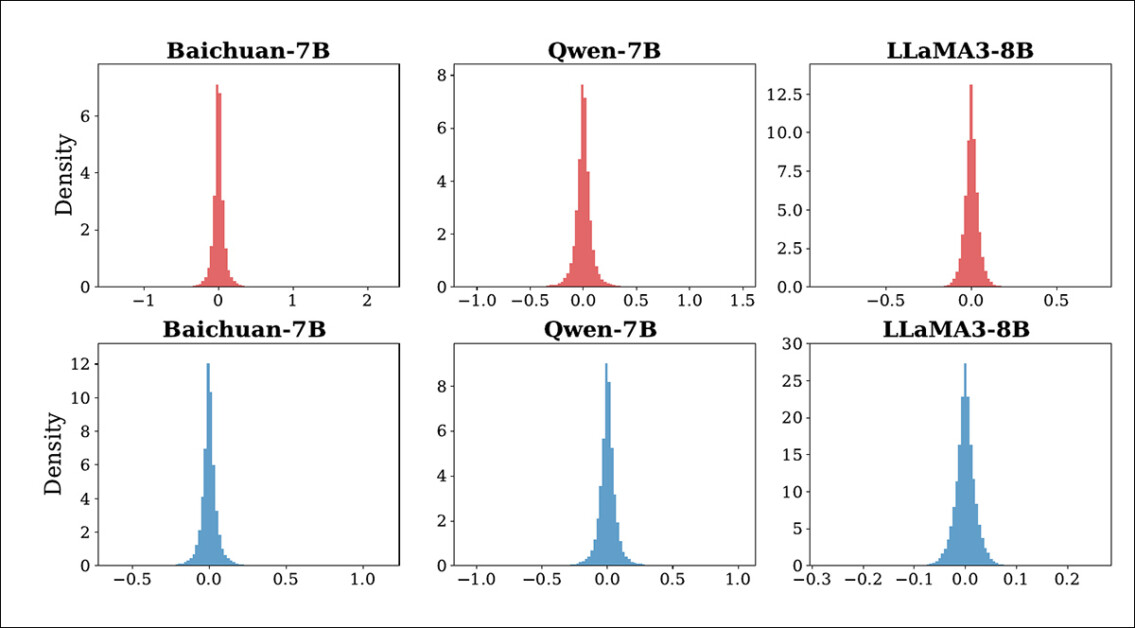

Pour surmonter cela, les auteurs ont conçu une stratégie d’édition multi-rondes qui ajuste progressivement les poids du modèle à une seule couche MLP jusqu’à ce que ses réponses soient suffisamment alignées sur les réponses souhaitées. Pour durcir les éditions contre les attaques, ils injectent également un bruit gaussien pendant la formation, pour simuler les attaques :

Distribution des modifications de K1 pour Baichuan-7B, Qwen-7B et LLaMA3-8B avant et après les attaques. La rangée du haut montre l’effet de l’injection de bruit aléatoire ; la rangée du bas montre l’effet de la réduction du modèle. Toutes les modifications restent proches de zéro, suggérant que les attaques n’affectent pas de manière significative le comportement interne du modèle.

Un système de notation arrête le processus une fois que les éditions sont suffisamment précises, tandis que la régularisation garantit que les mises à jour restent stables sur plusieurs rondes.

Le Décodeur pose au modèle les mêmes questions spéciales utilisées pendant le marquage d’eau, puis lit ses réponses pour en déduire l’ID caché. Puisque le modèle de réponses suit une règle secrète, cet ID peut être récupéré sans avoir besoin d’examiner les internes du modèle.

Données et Tests

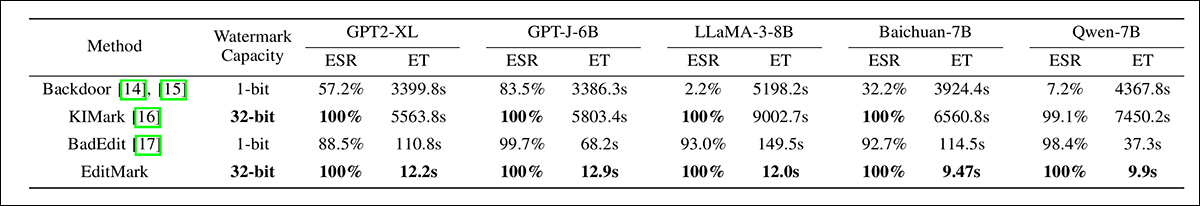

Pour tester EditMark, cinq LLM ont été évalués : GPT2-X ; GPT-J-6B ; LLaMA-3-8B ; Baichuan-7B ; et Qwen-7B. Le Model Watermark (backdoor) ; KIMark ; et BadEdit ont été utilisés comme références.

Les auteurs ont édité la 15e couche de LLaMA-3-8 ; la 17e de GPT2-XL et GPT-J-6B ; et la 14e de Qwen-7B et Baichuan-7B.

Les expériences ont été menées sur quatre NVIDIA RTX 4090 GPUs (24 Go de VRAM chacun), avec des filigranes de 32 bits, 64 bits et 128 bits intégrés. Les modèles de questions utilisés sont détaillés dans l’image ci-dessous :

Modèles de questions utilisés pour générer des questions à réponses multiples (MA) pour le marquage d’eau. Chaque question est basée sur un type différent d’inégalité mathématique, avec des valeurs aléatoires insérées pour les variables. Le modèle est invité à renvoyer une liste de solutions entières, avec l’ordre des réponses utilisé pour encoder ou décoder les bits de filigrane. Les quatre modèles couvrent les formes quadratiques, logarithmiques, rationnelles et basées sur les intervalles, et tous ont été générés à l’aide de GPT-4o.

Pour réduire les effets du hasard, des graines de 1 à 20 ont été appliquées pendant les tests, sur différentes capacités de filigrane.

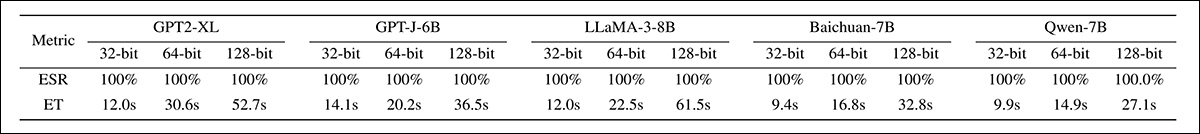

Initialement, les chercheurs ont testé à la fois le taux de réussite d’extraction (ESR) et le coût en temps d’intégration d’un filigrane sur la plage de LLM :

Comparaison d’EditMark avec trois méthodes de marquage d’eau antérieures sur cinq grands modèles de langage. Les taux de réussite d’extraction (ESR) et les temps d’intégration (ET) en secondes sont indiqués. EditMark atteint systématiquement un taux de réussite de 100 % tout en réduisant le temps d’intégration de plusieurs ordres de grandeur, surpassant toutes les références en termes de précision et d’efficacité sur des modèles de tailles et d’architectures variées.

À partir de ces résultats, les auteurs déclarent :

‘[EditMark] atteint un taux de réussite d’extraction de 100 % et nécessite moins de 20 secondes pour intégrer un filigrane de 32 bits pour tous les LLM évalués. En particulier, le temps d’intégration moyen pour Baichuan-7B et Qwen-7B est inférieur à 10 secondes, ce qui démontre l’efficacité élevée d’EditMark.’

Pour l’évaluation d’un filigrane de 128 bits, la valeur la plus élevée réalisable dans un tel schéma, EditMark a pu maintenir un statut d’« indélébilité » :

Taux de réussite d’extraction et temps d’intégration pour EditMark sur des longueurs de filigrane de 32, 64 et 128 bits sur cinq modèles de langage. Des taux de réussite parfaits sont maintenus dans tous les cas, tandis que le temps d’intégration augmente avec la taille du filigrane, mais reste inférieur à une minute, même à 128 bits.

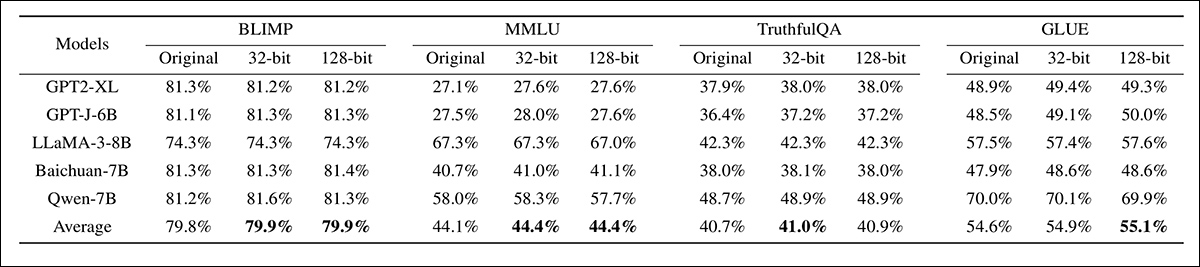

Ensuite, la capacité du système à conserver la fidélité du filigrane a été testée sur plusieurs références :

Évaluation de la fidélité du filigrane sur quatre références sur cinq modèles, en comparant les modèles non modifiés avec les modèles marqués d’eau à 32 bits et 128 bits. Les performances sont restées stables sur toutes les configurations, avec seulement de légères fluctuations dans les scores moyens, indiquant un impact limité sur la précision de référence due à l’insertion du filigrane.

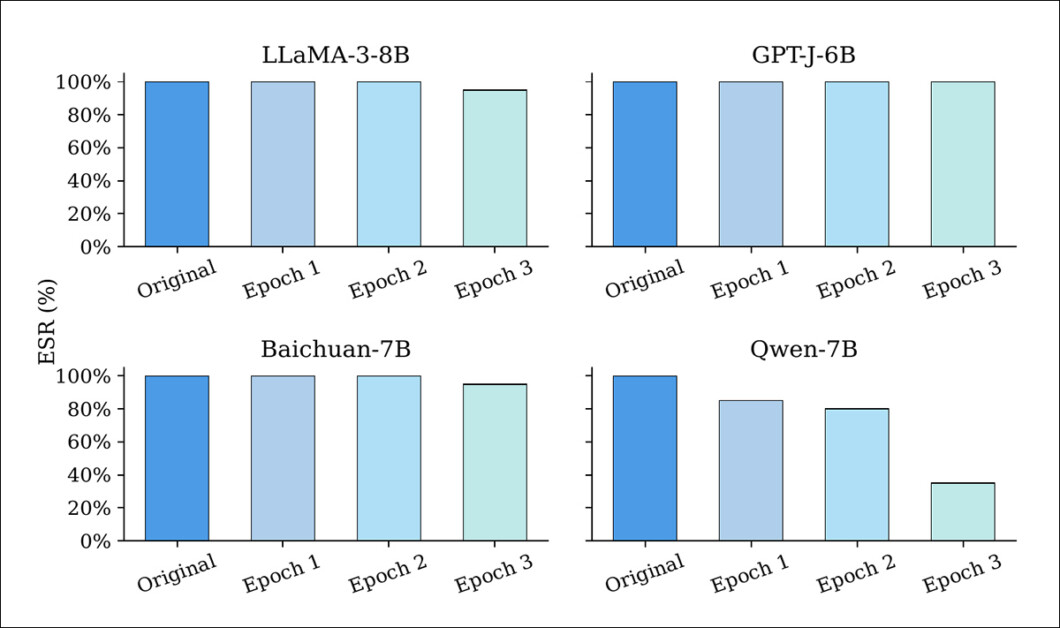

La résilience d’EditMark a été testée contre six stratégies d’attaque courantes. Les modèles ont été intégrés avec des filigranes de 128 bits à l’aide de cinq graines différentes. L’affinage a causé une dégradation mineure des taux de réussite d’extraction (ESR) pour la plupart des modèles :

Taux de réussite d’extraction du filigrane des LLM marqués d’eau avant et après affinage pendant une à trois époques. Alors que la plupart des modèles conservent des taux de réussite élevés tout au long, Qwen-7B montre un déclin marqué, suggérant une vulnérabilité plus grande aux mises à jour de paramètres.

Même après plusieurs époques, la plupart des modèles ont conservé des taux de réussite d’extraction supérieurs à 90 %, indiquant qu’EditMark résiste au dérive des paramètres introduit par la formation basée sur LoRA.

Les attaques de quantification ont réduit la précision du modèle, mais ont laissé la plupart des filigranes intacts :

Taux de réussite d’extraction du filigrane des modèles marqués d’eau avant et après quantification à l’aide de précisions Int-8 et Int-4. Le taux de réussite d’extraction reste inchangé sous quantification Int-8 sur tous les modèles, tandis que la quantification Int-4 entraîne une dégradation partielle, indiquant que une précision plus faible peut affaiblir, mais pas supprimer complètement le filigrane.

Comme on peut le voir dans l’image ci-dessus, la quantification Int-8 a préservé un taux de réussite d’extraction de 100 % sur tous les modèles, tandis que la quantification Int-4 a eu un impact modéré sur le taux de réussite d’extraction, mais a introduit des pertes de performances inacceptables.

Comme le note le document, ce scénario particulier suggère un potentiel limité pour un attaquant, puisque cela aboutit à un modèle piraté mais à des performances dégradées.

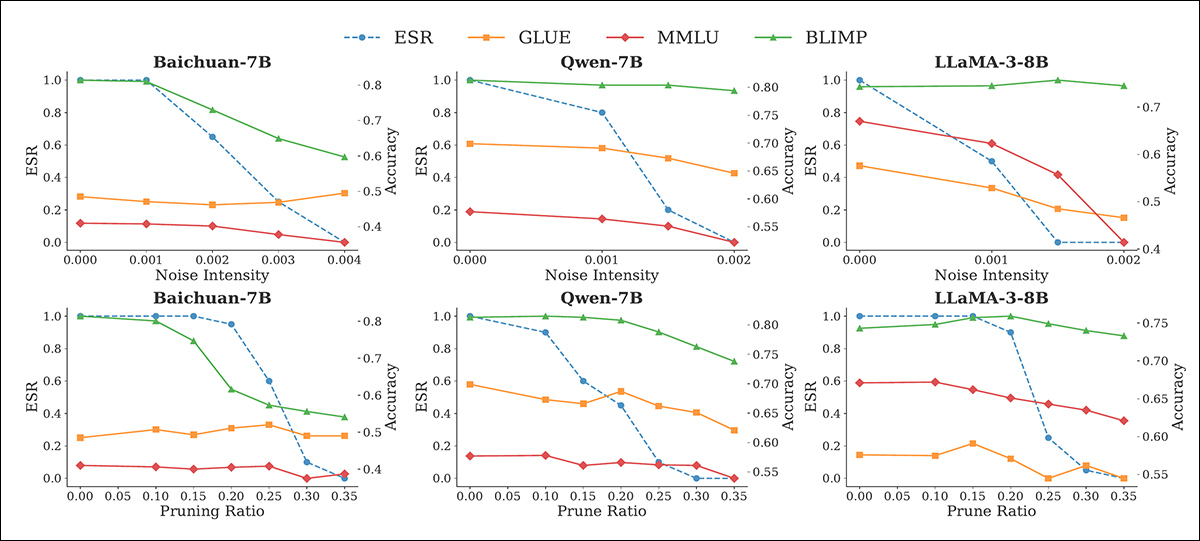

Les tests de bruit et de réduction ont évalué quatre références de benchmark : MMLU ; BLIMP ; TruthfulQA ; et GLUE. Ces attaques ont entraîné une diminution du taux de réussite d’extraction à mesure que les perturbations s’intensifiaient :

Effet des attaques de bruit (rangée du haut) et de réduction (rangée du bas) sur le taux de réussite d’extraction et les performances de benchmark des modèles marqués d’eau. À mesure que le taux de réussite d’extraction diminue avec l’intensification des perturbations, la précision de benchmark se dégrade également, en particulier à des intensités de bruit et à des ratios de réduction plus élevés, mettant en évidence la tension (habituelle) entre la suppression du filigrane et l’utilité du modèle.

Cependant, ces attaques ont également entraîné des déclins aigus des performances de tâche, avec Baichuan-7B subissant un déclin de 27-31 % sur BLIMP lorsqu’un bruit ou une réduction était appliqué.

L’édition de modèle et les attaques adaptatives ont également été évaluées :

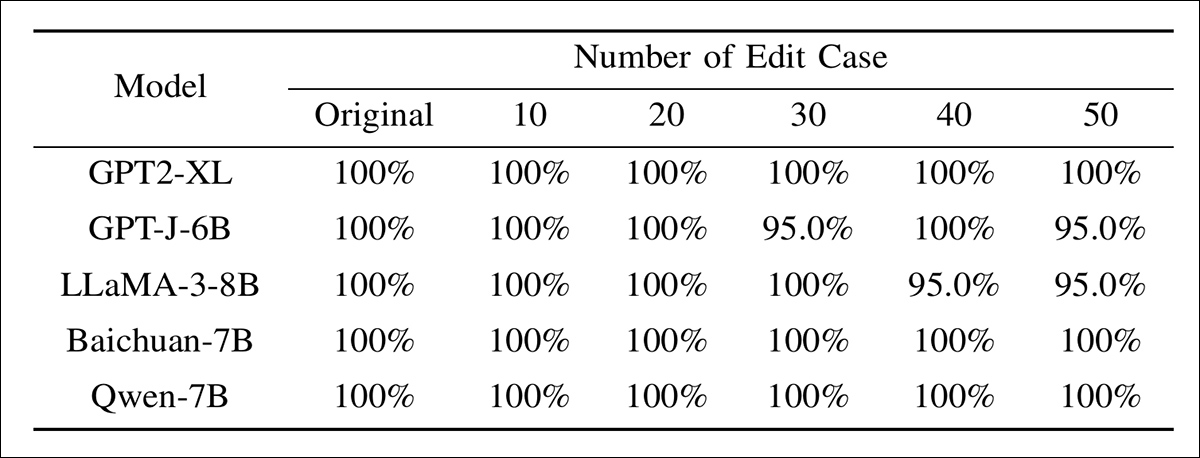

Taux de réussite d’extraction des modèles marqués d’eau soumis à différents degrés d’édition de modèle. Même avec jusqu’à cinquante éditions appliquées aux couches de filigrane connues, le taux de réussite d’extraction reste supérieur à 95 % pour tous les modèles, indiquant que les modifications directes des paramètres ont un effet limité sur la suppression du filigrane.

Ici, EditMark a conservé plus de 95 % de taux de réussite d’extraction, même lorsque les couches de filigrane exactes ont été ciblées.

Conclusion

Les DRM, les filigranes secrets et d’autres approches de sécurité qui ont connu un succès (limité ou partiel) à l’ère pré-AI sont difficiles à appliquer aux systèmes d’apprentissage automatique ; la nature intentionnellement réductionniste de la gamme actuelle d’architectures hôtes se combine avec un manque d’outils appropriés, ce qui rend tout filigrane injecté plutôt fragile.

Il est impressionnant de voir un système destiné à la distribution de modèles open source, et de le voir résister à tous les scénarios, sauf les plus invraisemblables, en termes de connaissance préalable d’un attaquant. Néanmoins, la légère baisse de performances qui accompagne les éditions post-formation, bien que faible dans ces expériences, peut donner aux potentiels adoptants une raison de s’arrêter ; ne serait-ce que parce que reculer vers un modèle de contrôle basé sur l’API obvient de telles attaques presque entièrement.

* Ce site a soutenu que les publications « open weight » de la Chine ne qualifient pas nécessairement de véritables logiciels open source, car les données sont souvent retenues, ce qui empêche la reproduction exacte du pipeline d’entraînement. Cela invite à un examen plus approfondi de la politique des publications de modèles d’IA comparées entre l’ouest et l’est, qui dépasse le cadre de cet article.

Publié pour la première fois lundi 27 octobre 2025