Angle d’Anderson

Même un intelligence artificielle de base peut désormais rédiger des actualités qui passent pour humaines

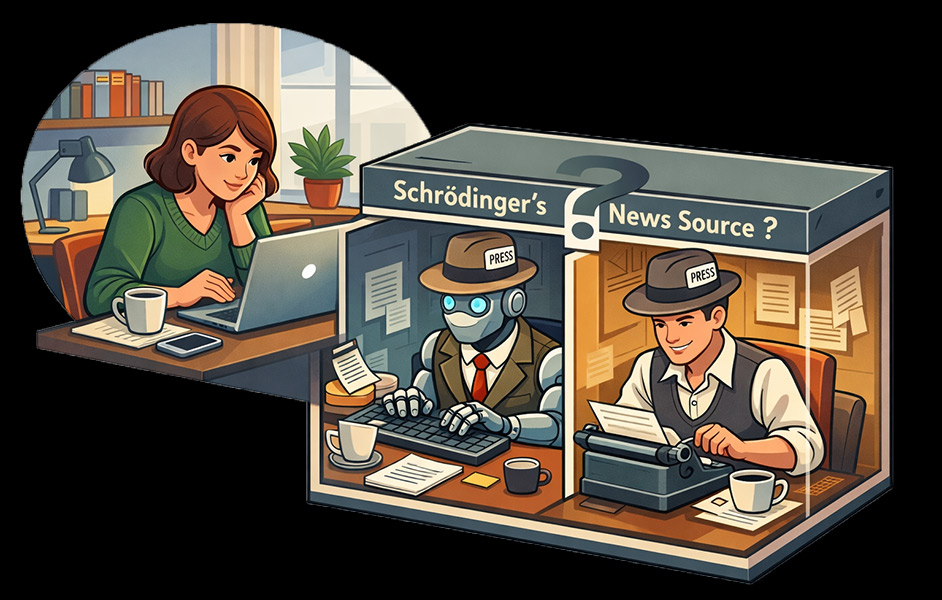

De nouvelles recherches indiquent que même de petits modèles d’intelligence artificielle locaux peuvent désormais rédiger des actualités que les gens ne peuvent pas distinguer d’un véritable journalisme, en égalant les meilleurs systèmes, et laissant les lecteurs incapables de déterminer qui a écrit quoi.

Selon une nouvelle collaboration de recherche entre l’Allemagne et la France, les humains ne peuvent pas déterminer si un article de presse est écrit par un intelligence artificielle ou un humain – même lorsqu’il est écrit par des modèles open source qui peuvent être téléchargés et exécutés sur des ordinateurs de bureau grand public relativement moyens.

Dans un autre indicateur que les petits modèles d’intelligence artificielle sont en ascension, un sondage de 2 318 jugements collectés auprès de 1 054 participants dans un portail d’étude universitaire dédié a constaté que les lecteurs humains ne pouvaient pas identifier la provenance d’un article à un niveau supérieur à celui du hasard, même lorsqu’il était généré par des modèles relativement modestes avec seulement sept milliards de paramètres, notamment Mistral et Llama variants :

Moyennes des scores de source et d’authenticité pour les LLM testés. Les 200 milliards de paramètres de GPT-4o ne dépassent pas massivement les 7 milliards de paramètres des modèles plus petits. Ceux testés pour l’étude étaient Gemma 7B, Phi-3 Mini, LLaMA-2 13B, Mistral 7B, GPT-4o et GPT-3.5. Source

Les auteurs reviennent sur un sujet qu’ils ont examiné pour la première fois dans la publication de 2024 Bénédiction ou malédiction ? Une enquête sur l’impact de l’intelligence artificielle générative sur les fausses nouvelles. Les résultats eux-mêmes sont les résultats nouvellement publiés d’un projet plus large initialement annoncé en janvier, et utilisent le cadre de participation en ligne JudgeGPT des auteurs.

Puissance légère

Intitulé Les humains peuvent-ils faire la différence ? Une étude à deux axes de la perception humaine des actualités générées par les LLM, et provenant de trois chercheurs de l’Université des sciences appliquées de Francfort et de l’unité de recherche IRISA de Nantes, la nouvelle étude fait une distinction importante entre les « fausses nouvelles » et les « actualités écrites par l’IA » (puisqu’il peut y avoir des fausses nouvelles écrites par des personnes ou par l’IA, et que les deux aspects ne sont pas nécessairement synonymes).

Cependant, l’aspect le plus intéressant est peut-être la conclusion du document selon laquelle de petits modèles, notamment Mistral 7B et Gemma 7B, peuvent, avec seulement sept milliards de paramètres, rivaliser avec les modèles de type ChatGPT (4o) avec 200 milliards de paramètres :

‘Les modèles à poids ouvert avec seulement 7 milliards de paramètres produisent du texte noté de la même manière que la sortie de GPT-4o, indiquant que la capacité à générer du texte indiscernable de l’humain n’est plus réservée aux modèles de pointe.’

Cependant, les « actualités générées par l’IA » peuvent représenter de nombreux types de collaboration humaine/IA, allant de la vérification orthographique à la défection totale d’effort, et l’étude ne précise pas exactement quel type de contenu AI a été produit pour les tests (bien qu’elle décrive la méthodologie de production – voir ci-dessous).

Méthode

Pour les participants engagés avec la plateforme JudgeGPT, chaque fragment de nouvelles a été évalué à l’aide d’un cadre à deux axes dans lequel ils ont fourni trois notations indépendantes sur des curseurs continus de 0 à 100 :

L’interface utilisateur du portail JudgeGPT, où les évaluateurs évaluent le matériel en fonction de l’attribution de source ; l’authenticité ; et la familiarité avec le sujet. Veuillez vous référer au document source pour une meilleure résolution.

Le jugement de source a capturé si un passage semblait écrit par machine ou par un humain ; le jugement d’authenticité, s’il était perçu comme faux ou légitime ; et la familiarité avec le sujet, à quel point le lecteur connaissait le sujet.

Des échelles continues ont été utilisées au lieu d’une échelle de Likert, pour capturer les degrés de certitude de manière plus précise, et pour supporter l’analyse statistique, y compris la corrélation de Pearson et le regroupement.

Les fragments de texte générés par machine ont été produits par le cadre RogueGPT des auteurs, l’architecture d’alimentation de JudgeGPT. RogueGPT orchestre les contributions de six grands modèles de langage (LLM) : ChatGPT-4 ; ChatGPT-3.5 ; ChatGPT-4o ; LLaMA-2 13B ; Gemma 7B ; et Mistral 7B.

La sollicitation basée sur les personnages a été utilisée pour générer les textes, et les générations AI ont été ancrées dans des sujets d’actualité réels, et ont été vérifiées par des humains.

Inversement, les fragments de texte écrits par des humains ont été échantillonnés à partir de « sources d’information établies » et de bases de données d’information non spécifiées.