Intelligence artificielle

La révolte des petits modèles : Pourquoi les petits modèles d’IA surpassent les géants des modèles de langage

Ces dernières années, l’intelligence artificielle a été façonnée par la course à la construction de modèles de plus en plus grands. Chaque nouvelle version a été mesurée par le nombre de paramètres, la taille des données d’entraînement et l’ampleur de l’infrastructure derrière. Plus grand signifiait supérieur. Alors que les géants de la technologie continuent de construire des modèles de langage de plus en plus massifs avec des centaines de milliards de paramètres, une révolution silencieuse est en cours. Les petits modèles d’IA, souvent des milliers de fois plus petits que leurs homologues géants, atteignent des performances comparables et parfois supérieures sur des tâches spécifiques. Ce changement remet en question tout ce que nous pensions savoir sur la mise à l’échelle de l’IA et ouvre de nouvelles possibilités pour une intelligence artificielle démocratisée et efficace.

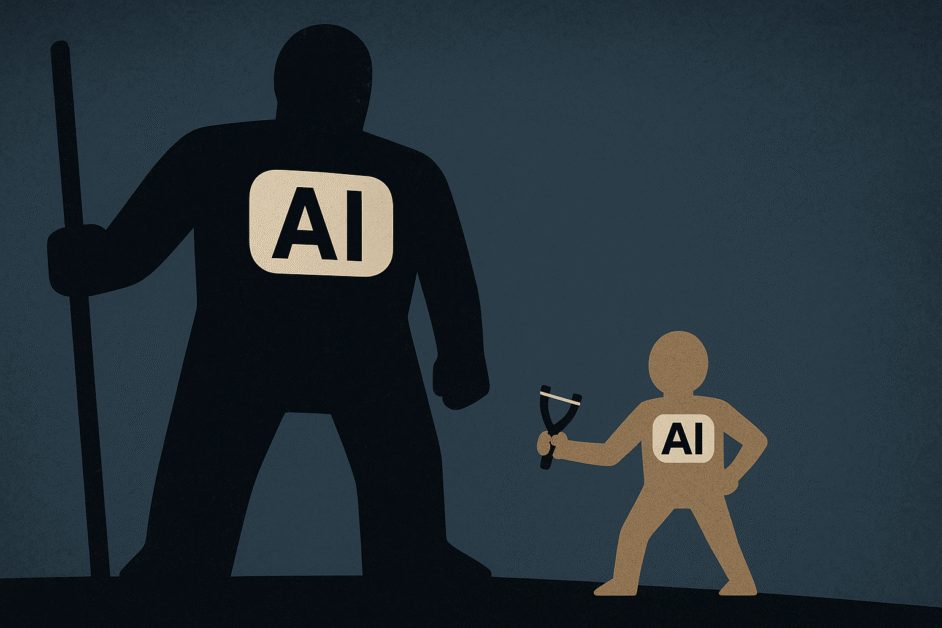

L’histoire de David et Goliath de l’IA moderne

Pendant des années, l’industrie de l’IA a fonctionné sous l’hypothèse que les modèles plus grands fournissent de meilleures performances. La série GPT d’OpenAI est passée de 117 millions de paramètres à plus de 175 milliards. Le PaLM de Google a atteint 540 milliards de paramètres. Les grandes entreprises technologiques ont investi des milliards de dollars dans la formation de ces modèles et investissent davantage pour construire des modèles encore plus grands. Dans cette situation, lorsque le nombre de paramètres est devenu un facteur clé pour déterminer la capacité du modèle et que la construction de la capacité d’IA est devenue une course de ressources computationnelles et de dépenses d’infrastructure, un phénomène intéressant a commencé à se produire dans les laboratoires de recherche du monde entier.

Les ingénieurs ont commencé à découvrir que des modèles plus petits, soigneusement conçus, pouvaient égaliser ou dépasser les performances de ces géants sur des tâches spécifiques. La série Phi de Microsoft a démontré qu’un modèle de 2,7 milliards de paramètres pouvait rivaliser avec des modèles dix fois plus grands. Le LLaMA de Meta a prouvé que des modèles de 7 milliards de paramètres pouvaient fournir des résultats exceptionnels lorsqu’ils étaient correctement formés. Ces développements représentent un changement fondamental dans notre compréhension de l’efficacité de l’IA.

Ce changement de paradigme a des implications importantes sur la façon dont l’IA est utilisée et exploitée. Les petits modèles peuvent fonctionner sur du matériel grand public, traiter les requêtes plus rapidement et consommer une fraction de l’énergie requise par les grands modèles. Ils rendent l’IA accessible aux organisations qui ne peuvent pas se permettre une infrastructure de calcul massive. Le plus important, ils remettent en question les tendances monopolistiques du développement de l’IA, où seules les entreprises dotées de vastes ressources pouvaient concurrencer.

L’émergence de l’architecture d’IA efficace

La révolution des petits modèles s’appuie sur des approches d’ingénierie sophistiquées qui maximisent les performances dans des budgets de paramètres contraints. Ces modèles emploient des techniques avancées comme la distillation des connaissances, où des modèles “étudiants” plus petits apprennent de modèles “enseignants” plus grands, capturant les connaissances essentielles tout en réduisant considérablement les exigences computationnelles.

La série Phi-4 de Microsoft incarne cette approche. Le modèle de raisonnement Phi-4, avec seulement 14 milliards de paramètres, rivalise avec des modèles cinq fois plus grands en raisonnement mathématique et en résolution de problèmes logiques. De même, le modèle Gemma 3 270M de Google démontre qu’un modèle compact de 270 millions de paramètres peut fournir de solides capacités de suivi d’instructions et servir de base excellente pour un affinage.

Le modèle Llama 3.2 1B de Meta est une autre avancée dans l’efficacité des petits modèles. Grâce à une élagage structuré et à une distillation des connaissances à partir de plus grands modèles Llama, il maintient des performances remarquables tout en fonctionnant efficacement sur les appareils de bord. Ces modèles prouvent que l’innovation architecturale et la méthodologie de formation sont plus importantes que le nombre de paramètres pour de nombreuses applications du monde réel.

Les architectures de mélange d’experts constituent une avancée significative dans la conception d’IA efficace. Au lieu d’utiliser tous les paramètres pour chaque tâche, ces modèles n’activent que les composants spécialisés pertinents. Ils acheminent différentes requêtes vers des sous-réseaux spécialisés, maintenant une large capacité tout en utilisant moins de paramètres actifs à tout moment. Le modèle Mixtral 8x7B de Mistral AI démontre cette approche de manière efficace. Malgré avoir 47 milliards de paramètres au total, il n’active que 13 milliards de paramètres par requête, atteignant des performances comparables à celles de modèles beaucoup plus grands tout en maintenant des vitesses d’inférence plus rapides.

Les techniques de quantification ont également eu un impact significatif sur l’augmentation de l’efficacité des petits modèles. En représentant les poids du modèle avec moins de bits, les chercheurs peuvent réduire la taille des modèles tout en maintenant la précision. Les méthodes de quantification modernes peuvent réduire la taille du modèle de 75 pour cent avec une perte de performance minimale. Les Phi-3-mini de Microsoft ont démontré l’efficacité de cette approche. Lorsqu’ils sont quantifiés à une précision de 4 bits, ils maintiennent plus de 95 pour cent de leurs performances originales tout en réduisant les exigences de mémoire de 7 Go à moins de 2 Go, les rendant pratiques notamment pour le déploiement mobile.

La spécialisation bat la généralisation

La révolution des petits modèles a révélé une vérité importante sur le déploiement de l’IA. La plupart des applications du monde réel n’ont pas besoin d’un modèle qui puisse écrire de la poésie, résoudre des problèmes de calcul ou discuter de philosophie. Ils ont besoin de modèles qui excellent dans des tâches spécifiques. Un chatbot de service client ne nécessite pas de connaître Shakespeare. Un outil de complétion de code n’a pas besoin de connaissances médicales. Cette réalisation a déplacé le focus de la construction de modèles universels à la création de modèles spécialisés.

La formation spécifique au domaine permet aux petits modèles de concentrer leur capacité limitée sur des connaissances pertinentes. Un modèle de 3 milliards de paramètres formé exclusivement sur des documents juridiques peut surpasser un modèle général de 70 milliards de paramètres sur des tâches juridiques. Le modèle spécialisé apprend des modèles plus profonds au sein de son domaine plutôt que de répartir sa capacité sur des sujets sans rapport. C’est comme comparer un médecin spécialiste à un généraliste pour des procédures complexes.

Les stratégies d’ajustement fin ont become de plus en plus sophistiquées. Au lieu de former des modèles desde zéro, les développeurs commencent avec de petits modèles de base et les adaptent à des besoins spécifiques. Cette approche nécessite des ressources computationnelles minimales tout en produisant des modèles spécialisés très capables. Les organisations peuvent désormais créer des solutions d’IA personnalisées sans investir dans une infrastructure massive.

Briser le plafond de performance

Les benchmarks récents révèlent des avantages de performance surprenants pour les petits modèles dans des domaines spécifiques. Le modèle Olmo 2 1B d’AI2 surpasse des modèles de taille similaire des grandes entreprises technologiques dans les tâches de compréhension du langage naturel. Le modèle Phi-4-mini-flash-reasoning de Microsoft atteint jusqu’à 10 fois plus de débit avec 2-3 fois moins de latence par rapport aux modèles de raisonnement traditionnels tout en maintenant des capacités de raisonnement mathématique.

L’écart de performance devient encore plus frappant lorsqu’on examine les applications spécifiques à une tâche. Les petits modèles affinés pour des domaines spécialisés surpassent régulièrement les grands modèles polyvalents en termes de précision et de pertinence. Les applications dans le domaine de la santé, l’analyse de documents juridiques et les mises en œuvre de service client montrent des résultats particulièrement impressionnants lorsque les petits modèles sont formés sur des ensembles de données spécifiques au domaine.

Cet avantage en termes de performance provient d’approches de formation ciblées. Plutôt que d’apprendre des connaissances larges mais superficielles à travers de nombreux domaines, les petits modèles développent une expertise approfondie dans des domaines ciblés. Le résultat est des réponses plus fiables et plus appropriées au contexte pour des cas d’utilisation spécifiques.

L’avantage de vitesse et d’efficacité

Les performances ne concernent pas seulement la précision. Cela concerne également la vitesse, le coût et l’impact environnemental. Les petits modèles excellent dans toutes ces dimensions. Un petit modèle peut générer des réponses en millisecondes là où les grands modèles prennent des secondes. Cette différence de vitesse peut sembler négligeable, mais elle devient critique dans les applications nécessitant une interaction en temps réel ou le traitement de millions de requêtes.

La consommation d’énergie est un autre aspect critique. Les grands modèles nécessitent des centres de données massifs avec des systèmes de refroidissement sophistiqués. Chaque requête consomme une quantité significative d’électricité. Les petits modèles peuvent fonctionner sur des serveurs standard ou même sur des ordinateurs personnels, en utilisant une fraction de l’énergie. Alors que les organisations font face à la pression pour réduire leur empreinte carbone, l’avantage environnemental des petits modèles devient de plus en plus important.

Le déploiement sur les appareils de bord est peut-être la capacité la plus transformatrice des petits modèles. Ces modèles peuvent fonctionner directement sur les téléphones, les ordinateurs portables ou les appareils IoT sans connectivité Internet. Imaginez des outils de diagnostic médical fonctionnant dans des zones reculées sans accès à Internet, ou des appareils de traduction en temps réel qui n’ont pas besoin de connectivité cloud. Les petits modèles rendent ces scénarios possibles, en apportant les capacités d’IA à des milliards d’appareils dans le monde.

Les préoccupations en matière de confidentialité favorisent également les petits modèles. Lorsque l’IA fonctionne localement sur les appareils des utilisateurs, les données sensibles ne quittent jamais l’appareil. Les fournisseurs de soins de santé peuvent analyser les données des patients sans les télécharger sur des serveurs cloud. Les institutions financières peuvent traiter des transactions sans exposer les informations des clients à des systèmes externes. Cette capacité de traitement local répond à l’une des principales préoccupations concernant l’adoption de l’IA dans les industries sensibles.

En résumé

L’essor des petits modèles d’IA remet en question la croyance selon laquelle les modèles plus grands fournissent toujours de meilleures performances. Des modèles compacts avec moins de paramètres égalisent ou dépassent maintenant les plus grands modèles sur certaines tâches en utilisant des techniques telles que la distillation des connaissances, la quantification et la spécialisation. Ce changement rend l’IA plus accessible en permettant une utilisation plus rapide et plus économe en énergie sur les appareils du quotidien. Cela réduit également les coûts, diminue l’impact environnemental et améliore la confidentialité en permettant le déploiement local. En se concentrant sur des modèles efficaces et spécifiques à une tâche plutôt que sur des systèmes universels massifs, l’IA devient plus pratique, abordable et utile pour les organisations et les individus.