Angle d’Anderson

Le Peut AI Développer un Nez pour les Nouvelles ?

L’IA améliore son écriture d’articles, mais n’améliore pas beaucoup sa capacité à identifier les nouvelles.

Opinion Il y a cinq ans, lorsque j’me suis penché pour la dernière fois sur la capacité de l’IA à trouver une histoire brûlante, le paysage a considérablement changé, avec des niveaux accrus d’automatisation basée sur l’IA accompagnés des inévitables douleurs de croissance et controverses.

Récemment, un rapport du WSJ sur un contributeur prolifique de Fortune aidé par l’IA a présenté le journaliste du futur comme émancipé des corvées telles que la retranscription de communiqués de presse, lui laissant la possibilité d’écrire des articles de fond et de faire des recherches que seules les grandes publications ont généralement le budget pour financer.

Mais ce dont on parle beaucoup moins souvent, c’est la capacité de l’IA à repérer une histoire.

Atténuation du bruit

Dans l’article de 2021, je me suis concentré sur les rédacteurs qui couvrent le domaine de la recherche, puisque c’est là que je passe la majeure partie de mon temps ; et peut-être que l’effet le plus important que la nouvelle révolution de l’IA a eu sur ce domaine est qu’elle a créé une tempête de neige imprévisible de soumissions de rapports de recherche alimentés par l’IA, augmentant le rapport signal/bruit à un niveau tel que même la couverture complète des domaines liés à l’IA sur Arxiv est maintenant au-delà des efforts d’une seule personne.

Il est certain que c’est là que l’IA excelle – en itérant à travers d’immenses tranches de données que les humains ne peuvent résoudre, pour trouver des « anomalies » (que nous aborderons plus tard) en quelques secondes qui auraient pris des jours aux humains, s’ils avaient pu le faire du tout.

Pourquoi, alors, l’IA est-elle toujours si mauvaise pour identifier une histoire brûlante parmi les milliers, voire les dizaines de milliers, de prétendants quotidiens ?

IA à reculons

Cette prolifération massive de contenu généré par l’IA se produit bien au-delà du secteur académique que j’ai discuté précédemment. Fin dernière année, il a été estimé que la moitié de tous les nouveaux écrits sur le web est maintenant « écrite par l’IA », avec une accélération encore plus grande de cette tendance présumée être en route. Par conséquent, le bruit est assourdissant partout, et pas seulement dans le monde académique.

Bien qu’il y ait eu quelques progrès dans l’identification algorithmique de l’IA d’une « histoire brûlante » au cours des dernières années, ces systèmes tendent à se concentrer sur des flux de données stratifiés et organisés de manière prévisible, ce qui signifie qu’ils ne peuvent fonctionner que dans un contexte plutôt fragile.

À cet égard, le chercheur postdoctoral de Stanford et ancien journaliste du New York Times Alexander Spangher a fait plusieurs incursions dans la définition de la « nouvelleurabilité » en termes applicables aux processus d’apprentissage automatique et à l’analyse statistique ; et a produit des preuves de génération automatisée de leads dans des corpus tels que les dossiers judiciaires, les projets de loi d’État et les réunions du conseil municipal, ainsi que des documents publics généraux – le type de sortie basé sur un schéma que le prolifique écrivain alimenté par l’IA de Fortune peut transformer en 6-7 articles par jour :

La « chaleur » des distributions de mots tirées de corpus de documents publics. Dans ce cas, on peut voir que « autoriser » a un score élevé, peut-être parce qu’il représente la décision, le changement et la nouveauté. Source

Cependant, le problème avec les approches telles que l’offre de Spangher en 2023 « Suivre la nouvelleurabilité des documents publics », est qu’elles se concentrent, à la manière typique de l’IA, sur les tendances observées dans les données. En d’autres termes, elles observent les choses qui ont fait de bonnes nouvelles auparavant, et vont ensuite chercher plus de la même chose.

Dans le monde réel, les sources inattendues se révèlent presque toujours être un « coup de chance » ; et pour leur obscurité, personne n’aurait pu prédire leur soudaine importance. Ensuite, ayant été fructueux une fois, et malgré des tentatives occasionnelles pour capitaliser sur une renommée ou une notoriété éphémère, ils produiront généralement jamais rien d’utile à nouveau.

Signe des temps

Par conséquent, puisque la surveillance de ce type de source de nouvelles « une fois pour toutes » ne va généralement qu’ajouter plus de bruit à la tempête générale, l’IA ne pourrait-elle pas identifier les signifiants d’une source qui deviendra un jour fructueuse ? Si l’on pouvait découvrir quel type de source pourrait éventuellement produire des nouvelles, on pourrait se concentrer sur ses caractéristiques plutôt que sur son contexte, ou ses méthodes.

En suivant cette logique, on pourrait déduire des révélations d’Edward Snowden dans les années 2010 qu’il vaudrait la peine de suivre quiconque a récemment quitté l’emploi de la CIA (ou une organisation similaire) comme une source potentielle d’une future exclusivité.

Cependant, il n’y a pas de flux RSS ou d’API susceptibles de pouvoir automatiser ce type de surveillance en cours, puisque LinkedIn et de nombreuses autres sources de données autrefois ouvertes se retirent face aux scrappeurs Web rapaces et scofflaw de l’IA. Même s’il y en avait, la fréquence serait un problème, car on ne peut pas interroger une API ou un site toutes les cinq secondes ; outre le coût en ressources, les réponses d’interdiction d’IP des plateformes rendraient cette activité non viable.

De plus, il y a clairement une « dimension humaine » à de telles divulgations qui est difficile à automatiser.

La collecte de nouvelles avec la touche personnelle : capture d’un disque de la sortie du film de 1976 d’Alan J. Pakula ‘Tous les hommes du président’, mettant en vedette l’informateur sortant de l’ombre. Source

De plus, dans le monde réel, il est terriblement difficile d’identifier les caractéristiques définissantes d’une future source de nouvelles. Ce n’est probablement pas « les personnes qui ont quitté la CIA récemment », et ce n’est certainement pas défini par un protocole : les plateformes telles que X ou GitHub produisent beaucoup trop de signal en elles-mêmes, et même en réduisant les termes de recherche ou les catégories de publication, cela ne fait guère de différence – seulement si vous êtes impliqué dans le problème, et engagé avec la communauté (ou le référentiel, etc.) êtes-vous vraiment susceptible de reconnaître l’importance d’un développement.

Même un terme tel que « alerte de sécurité » ne peut pas contextualiser la véritable gravité ou la nouvelleurabilité d’un incident, puisque des références de ce type sont jetées quotidiennement, par milliers, dans de telles communautés – et n’ont aucune valeur nouvelle en soi ; et même si l’on restreint ce type de surveillance à la langue anglaise seule, les variations potentielles dans l’idiome, ainsi que l’utilisation de langage oblique, rendraient très difficile l’analyse d’un message « dans la nature » en une véritable alerte de nouvelles.

Le chemin étroit

Les systèmes actuels de détection de nouvelleurabilité alimentés par l’IA dépendent de structures de données formalisées (telles que la sortie JSON, à partir d’une API), ou d’structures de données informelles que les algorithmes développés par l’IA ont une chance de parser en un schéma structuré (telles que les communiqués de presse d’une organisation particulière) :

Un flux RSS/XML analysé, révélant la hiérarchie rigide des conteneurs de données. Source

Il est clair que les approches de ce type sont bien adaptées à la sortie programmatique, telle que le travail fastidieux que le journaliste du WSJ mentionné ci-dessus déclare que l’IA l’a libéré, y compris la météo, les actions, les scores de sport, ainsi que les communiqués de presse de routine des organisations gouvernementales municipales et autres.

Alors que il est possible d’attacher des déclencheurs d’alerte humaine à des flux statistiques comme la météo (tempêtes soudaines), les actions (chutes soudaines) et les sports (victoires/defaites inattendues, avec un peu de préparation), à nouveau, l’attention humaine serait toujours nécessaire même pour les sorties gouvernementales stratifiées, afin d’évaluer la nouvelleurabilité.

Bien que des termes tels que « mort », « maladie inattendue », « fuite », et « accident » puissent tous aider à affiner les événements newsworthies, ils ne traitent que des « événements routiniers », et ne peuvent pas non plus tenir compte du langage alternatif (ou des langues).

Le retour des écrivains élite ?

Ces dernières années, le journalisme de données est devenu un élément ascendant dans la couverture médiatique, avec des départements éditoriaux qui ne sont plus limités aux accords de « scoop » avec des rapports et des livres blancs spéciaux des grands éditeurs ; au lieu de cela, ils peuvent eux-mêmes analyser les chiffres.

Cependant, ce n’est pas un repas gratuit ; à mesure que la valeur évidente de l’analyse de données publiques avec l’IA de cette manière a grandi, une réponse de blocage de l’IA/à but lucratif a suivi – ou même a précédé – la demande, poussant les principaux acteurs de l’IA dans des tactiques furtives.

La friction supplémentaire de la nouvelle rétention rend probablement un certain pouvoir aux médias du « citoyen journaliste » aux médias du patrimoine – ou du moins, aux organisations de nouvelles bien financées qui ont la bande passante pour absorber le travail manuel supplémentaire requis pour la collecte, l’affinement et l’évaluation des données, dans une ère où les éditeurs et les domaines restreignent de plus en plus l’accès occasionnel.

Ainsi, d’une certaine manière, peut-être dans l’esprit du temps, la manifestation pratique de l’IA dans le journalisme, en termes de la manière dont les principaux acteurs et les marchés ont répondu à l’innovation et à l’adoption basées sur l’IA, pourrait en fait nous ramener dans le temps : dé-démocratiser les moyens de production de nouvelles, et ajouter des obstacles à des systèmes d’évaluation de la nouvelleurabilité basés sur les données significatives.

Instincts communs

Ces restrictions nous ramènent clairement à « l’instinct » comme un composant inévitable dans l’évaluation de la nouvelleurabilité d’une histoire.

Naturellement, c’est rassurant pour ceux qui sont engagés professionnellement dans cet aspect ; mais la complaisance serait une erreur, puisque cet instinct peut, dans une certaine mesure, être distillé et opérationnalisé de manière très générale qui ne dépend pas de l’étude des obsessions ou des hobby-chevaux d’un individu ou d’une organisation particulière : dans une étude de 2022, des chercheurs de l’Université Northwestern ont utilisé des évaluations de crowdsourcing d’histoires potentiellement newsworthies pour former un modèle prédictif, spécifiquement concerné par la nouvelleurabilité des articles de recherche publiés récemment sur Arxiv :

Questions de sondage posées aux participants pour obtenir des données de formation pour un modèle de prédiction de nouvelleurabilité AI. Source

Le système classe les candidats de manière assez bonne, avec environ 80 % de ses premiers choix également jugés newsworthies par des experts. Cependant, l’accord avec les experts s’est avéré modéré, avec les résultats manquant des facteurs tels que le cadrage ou l’ajustement du public.

Le système est basé sur les principes énoncés dans le document de 2020 Découverte de nouvelles computationnelles : Vers des considérations de conception pour les algorithmes d’orientation éditoriale dans le journalisme. Comme pour la plupart des projets similaires, ce travail aborde le journalisme scientifique plutôt que la collecte de nouvelles abstraites – peut-être parce que la littérature scientifique tend vers une sortie template qui pourrait potentiellement être analysée en points de données formables et interprétables.

Eh bien, comme je l’ai observé en 2021, ce serait le cas, sauf que les scientifiques de recherche abusent fréquemment des conventions de soumission de rapports de recherche pour cacher ou minimiser des résultats peu impressionnants, ou même des échecs directs.

Encore plus difficile est la grande difficulté que les systèmes d’IA ont à interpréter les chiffres et les tableaux dans les articles scientifiques, au point où cette poursuite est devenue récemment un filon actif dans la littérature :

À partir du document ‘SciFigDetect : Un référentiel pour la détection de figures scientifiques générées par l’IA’, montrant des figures scientifiques réelles, leurs invites de génération et leurs contreparties synthétiques produites par Nano Banana et GPT dans trois catégories : illustration, aperçu et figures expérimentales. Source

Il est souvent le cas qu’un graphique ou un tableau contiendra des résultats qui le corps principal de l’article rapportera avec un biais sélectif, ou qui sera tout simplement ignoré pour toute conséquence négative implicite dans les résultats du graphique/tableau. Par conséquent, ce blocage dans le journalisme scientifique basé sur l’IA n’est pas mineur.

Plus éloquent encore, le fait qu’un article soit dérivé, ou ne soit qu’une avancée mineure (si tout), est souvent enterré dans une citation presque impénétrable (c’est-à-dire que vous devriez rechercher le terme, localiser une copie PDF lisible et comprendre l’étendue de l’art antérieur, avant de comprendre le manque d’originalité ou de nouveauté dans le nouveau travail).

Seul à nouveau, naturellement

La méthode de crowdsourcing ci-dessus suggère un certain accord entre le consensus commun sur les histoires potentiellement newsworthies et l’évaluation professionnelle des mêmes. Mais sans contexte, seuls les traits les plus larges de la nouvelleurabilité peuvent apparemment être déterminés.

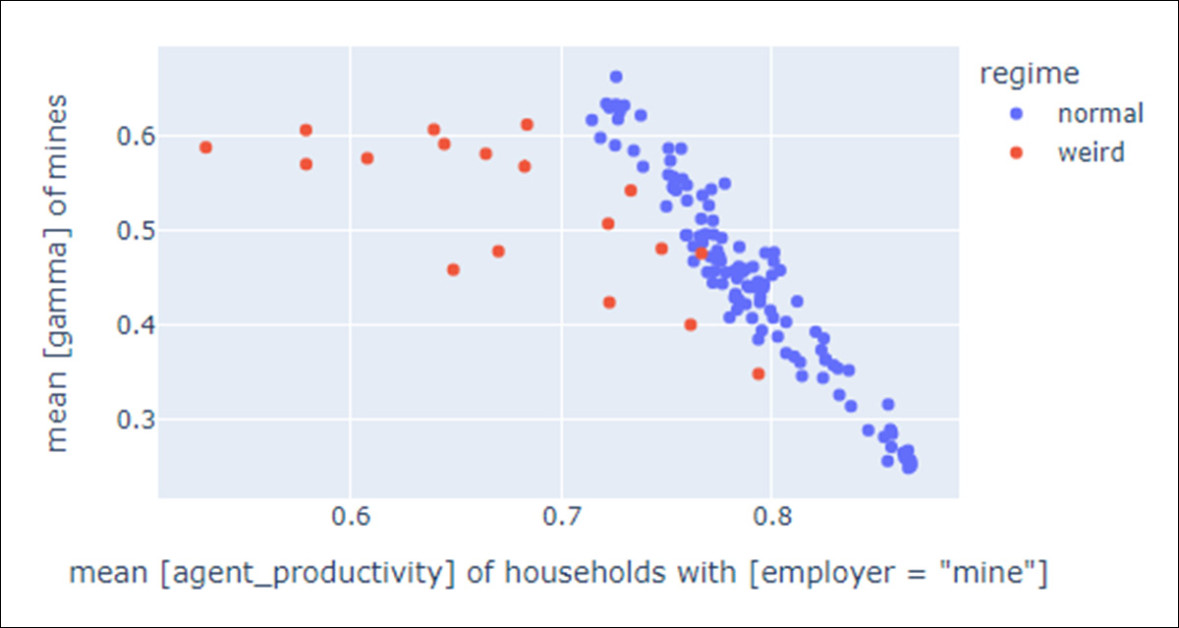

La force de l’IA réside dans sa capacité, en fonction de la configuration, à isoler les anomalies – soit pour les rejeter comme une exception à la courbe et sans signification dans un ensemble de données, soit (plus pertinent pour la collecte de nouvelles) pour identifier des instances et des occurrences inhabituelles et précieuses :

Anomalies (en rouge) dans un graphique de dispersion. Source

Sur le principe que la foudre ne frappe rarement deux fois, presque toutes les histoires à sensation sont des anomalies. Dans les cas où elles proviennent d’un domaine actif et volatile, tel qu’une guerre en cours, ce domaine peut être scanné avec vigilance avec une grande probabilité d’histoires newsworthies émergeant – mais au coût d’une concurrence massive, puisque l’attention commune est susceptible d’être également concentrée sur le domaine.

Beaucoup de pistes scientifiques newsworthies sont, par définition, pas au centre de la distribution du langage. Ils sont des combinaisons rares de méthodes, des résultats négatifs surprenants ou des réplications anormales. Si la compétence du modèle se dégrade de manière disproportionnée sur de tels groupes à faible fréquence, alors la région où un « nez » éditorial a besoin d’être aiguisé devient la région où le modèle est le moins fiable.

Problèmes de confiance

Lors de la recherche de nouvelles histoires, les journalistes équilibrent plusieurs contraintes, notamment le temps, l’accès, la crédibilité, le public et les priorités organisationnelles), conduisant à des choix non évidents. Une revue de littérature de 2022 du Danemark a caractérisé les journalistes comme équilibrant plusieurs préoccupations, conscient qu’ils peuvent avoir des agendas ou être mal informés ; et souvent en contournant la vérification directe en faveur de signaux de confiance indirects lorsqu’ils opèrent sous pression.

Ces mêmes « problèmes de confiance » constitueraient un obstacle de développement dans tout système définitif d’identification de nouvelleurabilité basé sur l’IA, puisque l’engagement avec une telle plateforme nécessite que l’utilisateur fasse confiance au fait que tout article rejeté par l’algorithme n’est vraiment pas digne de l’attention de l’écrivain.

Un test bêta approfondi et une rééducation ou un affinement, avec une supervision humaine ramassant les déchets et les traînards, pourraient éventuellement améliorer la fiabilité d’une telle approche ; mais un changement de culture nationale ou mondiale – tel qu’un changement surprenant dans le paysage politique, ou le déclenchement d’une guerre – pourrait inévitablement renverser toutes les priorités de base d’un tel système soigneusement calibré, laissant l’écrivain basé sur l’IA à reconstruire son « modèle de domaine interne » presque à partir de zéro.

Publié pour la première fois lundi 20 avril 2026