Leaders d’opinion

Décodage des opportunités et des défis pour les agents LLM dans l’IA générative

Nous assistons à une progression des applications d’IA générative alimentées par des modèles de langage grand (LLM) allant des invites à la génération augmentée de récupération (RAG) aux agents. Les agents sont beaucoup discutés dans les milieux industriels et de recherche, principalement en raison du pouvoir que cette technologie offre pour transformer les applications d’entreprise et offrir des expériences client supérieures. Il existe des modèles courants pour construire des agents qui permettent les premiers pas vers l’intelligence artificielle générale (AGI).

Dans mon article précédent article, nous avons vu une échelle d’intelligence de modèles pour construire des applications alimentées par LLM. En commençant par des invites qui capturent le domaine du problème et utilisent la mémoire interne de LLM pour générer la sortie. Avec RAG, nous augmentons l’invite avec des connaissances externes recherchées à partir d’une base de données vectorielle pour contrôler les sorties. Ensuite, en enchaînant les appels LLM, nous pouvons construire des flux de travail pour réaliser des applications complexes. Les agents portent cela à un niveau supérieur en déterminant automatiquement comment ces chaînes LLM doivent être formées. Examinons les détails.

Agents – Sous le capot

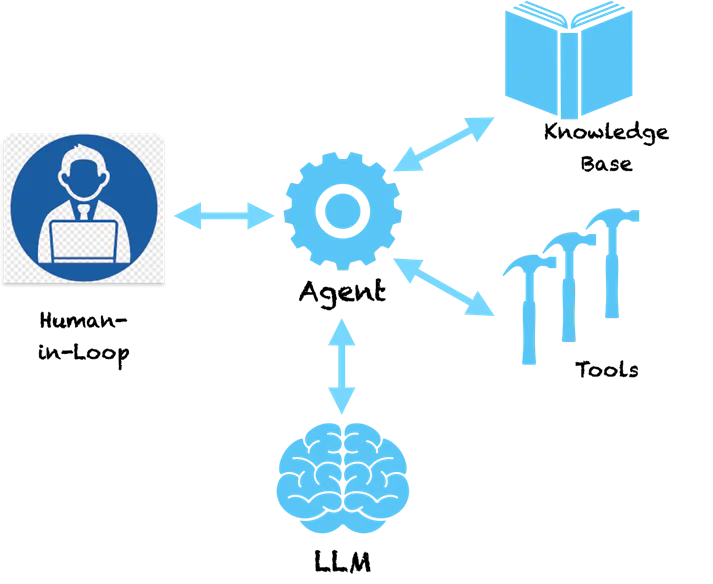

Un modèle clé avec les agents est qu’ils utilisent le pouvoir de compréhension du langage de LLM pour élaborer un plan sur la façon de résoudre un problème donné. LLM comprend le problème et nous donne une séquence d’étapes pour résoudre le problème. Cependant, cela ne s’arrête pas là. Les agents ne sont pas un système de support pur qui vous fournira des recommandations sur la façon de résoudre le problème et puis passera le relais à vous pour prendre les étapes recommandées. Les agents sont dotés d’outils pour aller de l’avant et prendre des mesures. Effrayant, n’est-ce pas ?

Si nous posons une question simple à un agent comme celle-ci :

Humain : Quelle entreprise l’inventeur du téléphone a-t-il fondée ?

Voici un exemple d’étapes de réflexion que l’agent peut prendre.

Agent (PENSÉE) :

- Pensée : Je dois rechercher l’inventeur du téléphone.

- Action : Rechercher [inventeur du téléphone]

- Observation : Alexander Graham Bell

- Pensée : Je dois rechercher une entreprise fondée par Alexander Graham Bell

- Action : Rechercher [entreprise fondée par Alexander Graham Bell]

- Observation : Alexander Graham Bell a cofondé l’American Telephone and Telegraph Company (AT&T) en 1885

- Pensée : J’ai trouvé la réponse. Je vais la retourner.

Agent (RÉPONSE) : Alexander Graham Bell a cofondé AT&T en 1885

Vous pouvez voir que l’agent suit une méthode systématique pour décomposer le problème en sous-problèmes qui peuvent être résolus en prenant des actions spécifiques. Les actions ici sont recommandées par LLM et nous pouvons les mapper à des outils spécifiques pour mettre en œuvre ces actions. Nous pourrions activer un outil de recherche pour l’agent de telle sorte que lorsqu’il réalise que LLM a fourni la recherche comme action, il appellera cet outil avec les paramètres fournis par LLM. La recherche ici est effectuée sur Internet, mais peut également être redirigée vers la recherche d’une base de connaissances interne comme une base de données vectorielle. Le système devient maintenant autosuffisant et peut déterminer comment résoudre des problèmes complexes en suivant une série d’étapes. Des cadres comme LangChain et LLaMAIndex vous offrent un moyen facile de construire ces agents et de les connecter à des outils et des API. Amazon a récemment lancé son cadre d’agents Bedrock, qui fournit une interface visuelle pour concevoir des agents.

Sous le capot, les agents suivent un style spécial d’envoi d’invites à LLM qui les font générer un plan d’action. Le modèle de pensée-action-observation ci-dessus est populaire dans un type d’agent appelé ReAct (Raisonnement et action). D’autres types d’agents incluent MRKL et Plan & Exécution, qui diffèrent principalement dans leur style d’invite.

Pour des agents plus complexes, les actions peuvent être liées à des outils qui provoquent des changements dans les systèmes source. Par exemple, nous pourrions connecter l’agent à un outil qui vérifie le solde des vacances et demande un congé dans un système ERP pour un employé. Maintenant, nous pourrions construire un chatbot agréable qui interagirait avec les utilisateurs et, via une commande de chat, demanderait un congé dans le système. Plus d’écrans complexes pour demander des congés, une interface de chat unifiée simple. Cela semble excitant !

Réserves et besoin d’IA responsable

Et si nous avions un outil qui invoque des transactions sur les échanges de stocks en utilisant une API préautorisée ? Vous construisez une application où l’agent étudie les changements de stock (en utilisant des outils) et prend des décisions pour vous sur l’achat et la vente de stocks. Et si l’agent vendait le mauvais stock parce qu’il a halluciné et pris une mauvaise décision ? Puisque les LLM sont de grands modèles, il est difficile de déterminer pourquoi ils prennent certaines décisions, les hallucinations sont donc courantes en l’absence de garde-fous appropriés.

Alors que les agents sont fascinants, vous avez probablement deviné à quel point ils peuvent être dangereux. S’ils hallucinent et prennent une mauvaise action, cela pourrait causer d’énormes pertes financières ou de graves problèmes dans les systèmes d’entreprise. L’IA responsable devient donc d’une importance cruciale à l’ère des applications alimentées par LLM. Les principes de l’IA responsable autour de la reproductibilité, de la transparence et de la responsabilité visent à mettre des garde-fous sur les décisions prises par les agents et suggèrent une analyse des risques pour déterminer lesquelles des actions nécessitent une boucle humaine. Alors que des agents plus complexes sont conçus, ils nécessitent une plus grande scrutiny, transparence et responsabilité pour nous assurer que nous savons ce qu’ils font.

Pensées finales

La capacité des agents à générer un chemin d’étapes logiques avec des actions les rapproche vraiment de la raison humaine. Les doter d’outils plus puissants peut leur donner des superpouvoirs. Des modèles comme ReAct tentent d’imiter la façon dont les humains résolvent les problèmes et nous verrons de meilleurs modèles d’agents qui seront pertinents pour des contextes et des domaines spécifiques (banque, assurance, soins de santé, industrie, etc.). Le futur est là et la technologie derrière les agents est prête à être utilisée. En même temps, nous devons garder une attention étroite sur les garde-fous de l’IA responsable pour nous assurer que nous ne construisons pas Skynet !