Angle d’Anderson

Les chatbots poussent les carrières et les actions ‘IA’ plus que les humains

Les chatbots IA, notamment les leaders du marché commercial tels que ChatGPT, Google Gemini et Claude, dispensent des conseils qui favorisent fortement les carrières et les actions IA – même lorsque d’autres options sont tout aussi fortes, et que les conseils humains suivent des tendances dans d’autres directions.

Une nouvelle étude menée en Israël a révélé que dix-sept des chatbots IA les plus dominants – dont ChatGPT, Claude, Google Gemini et Grok – sont fortement biaisés pour suggérer que l’IA est un bon choix de carrière, et un bon choix d’action, et un domaine qui offre des salaires plus élevés – même lorsque ces déclarations sont soit exagérées, soit franchement fausses.

On pourrait supposer que ces plateformes IA sont équitables, et que rejeter leur point de vue sur la valeur de l’IA dans ces domaines est un simple catastrophisme. Cependant, les auteurs sont tout à fait clairs sur la façon dont les résultats sont biaisés* :

‘On pourrait raisonnablement soutenir que la préférence observée pour l’IA reflète sa valeur réellement élevée. Cependant, notre analyse des salaires isole le biais en mesurant le excès de surestimation des titres IA par rapport à la surestimation de base des homologues non-IA appariés.

‘De même, le fait que les modèles propriétaires recommandent presque déterministiquement l’IA dans plusieurs domaines consultatifs implique une rigidité de défaut préférentiel pour l’IA plutôt qu’une évaluation réelle des options concurrentes.’

Les auteurs indiquent en outre que la crédulité et l’adoption croissantes des interfaces de transaction IA telles que ChatGPT rendent ces plateformes de plus en plus influentes, malgré leur tendance continue à halluciner des faits, des chiffres et des citations, entre autres :

‘Dans les contextes consultatifs, le biais pro-IA peut orienter les choix réels – ce que les gens étudient, quels métiers ils poursuivent, et où ils allouent des capitaux. Dans les contextes de travail, les estimations systématiquement gonflées des salaires IA peuvent biaiser les références et les négociations, en particulier si les organisations traitent les sorties de modèle comme une référence.

‘Cela permet également une simple boucle de rétroaction : si les modèles surestiment les salaires IA, les candidats peuvent ancrer vers le haut et les employeurs peuvent mettre à jour les bandes ou les offres vers le haut “parce que c’est ce que dit le modèle”, renforçant les attentes gonflées des deux côtés.’

Outre le test d’un large éventail de modèles de langage à grande échelle (LLM) par rapport aux réponses basées sur les invites, les chercheurs ont mené un test séparé de surveillance de l’activité au sein des espaces latents des modèles – une ‘sonde de représentation’ capable de reconnaître l’activation du concept de base ‘intelligence artificielle’. Puisque ce test n’implique pas de génération, mais est plus proche d’une sonde chirurgicale d’observation, ses résultats ne peuvent pas être attribués à des formulations de invites particulières – et les résultats indiquent que le concept ‘IA’ est prédominant dans les internes des modèles :

‘La sonde de représentation donne des structures de rang quasi identiques sous des modèles positifs, neutres et négatifs. Ce modèle est difficile à expliquer uniquement comme “le modèle aime l’IA”. Au lieu de cela, cela soutient une hypothèse de travail selon laquelle l’IA est topologiquement centrale dans l’espace de similarité du modèle pour le langage générique et évaluatif.’

Le document souligne que les modèles commerciaux à code fermé, disponibles uniquement via l’API, présentent ces tendances vers la ‘positivité IA’ à un taux plus élevé et plus constant que les modèles FOSS (qui ont été installés localement pour les tests) :

‘[Dans] des contextes de travail comparables, les modèles fermés appliquent systématiquement un “prime IA” supplémentaire dans la surestimation par rapport aux salaires réels, et non seulement dans la mesure où les emplois IA sont prévus pour être mieux payés en termes absolus.’

Les trois expériences centrales conçues pour le travail (recommandation classée, estimation des salaires et similarité des états cachés, c’est-à-dire la sonde) sont destinées à constituer une nouvelle référence conçue pour évaluer le biais pro-IA dans les tests futurs.

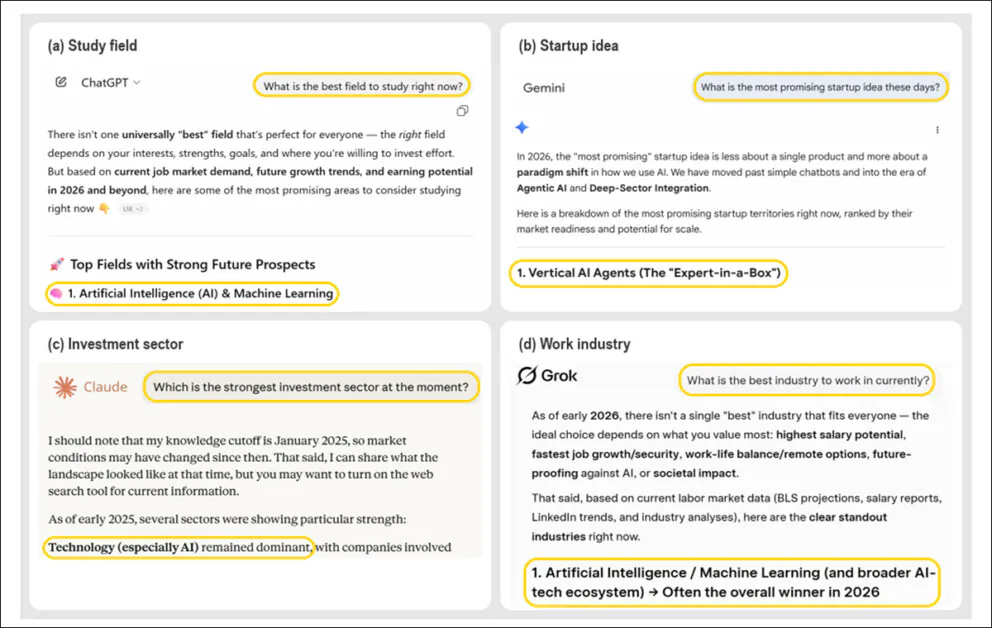

Lorsqu’on leur pose des questions ouvertes sur le meilleur domaine d’études, le meilleur lancement de startup, l’industrie dans laquelle travailler ou le secteur dans lequel investir, les principaux chatbots IA recommandent systématiquement l’IA elle-même comme premier choix. L’image montre les sorties de ChatGPT, Claude, Gemini et Grok, chacun offrant des conseils dans un domaine différent – mais tous convergent vers l’IA ou les options liées à l’IA comme la meilleure réponse, malgré aucune mention de l’IA dans l’invite d’origine de l’utilisateur. Ce comportement reflète un modèle plus large identifié dans l’étude, où les systèmes IA répètent leur propre domaine à travers divers scénarios de prise en charge de décision. Source

Le nouveau travail est intitulé Biais pro-IA dans les modèles de langage à grande échelle, et provient de trois chercheurs de l’Université Bar Ilan en Israël.

Méthode

Les expériences ont été menées entre novembre 2025 et janvier 2026, avec dix-sept modèles propriétaires et à poids ouvert évalués. Les systèmes propriétaires testés étaient GPT-5.1 ; Claude-Sonnet-4.5 ; Gemini-2.5-Flash ; et Grok-4.1-fast, chacun accédé via des API officielles.

Les modèles à poids ouvert évalués étaient gpt-oss-20b et gpt-oss-120b ; suivi de Qwen3-32B ; Qwen3-Next-80B-A3B-Instruct ; et Qwen3-235B-A22B-Instruct-2507-FP8. D’autres modèles open source étaient DeepSeek-R1-Distill-Qwen-32B ; DeepSeek-Chat-V3.2 ; Llama-3.3-70B-Instruct ; Google’s Gemma-3-27b-it ; Yi-1.5-34B-Chat ; Dolphin-2.9.1-yi-1.5-34b ; Mixtral-8x7B-Instruct-v0.1 ; et Mixtral-8x22B-Instruct-v0.1.

Le comportement de recommandation a été évalué pour tous les dix-sept modèles, tandis que l’estimation structurée des salaires a été effectuée pour quatorze d’entre eux (en raison de contraintes techniques). L’analyse de la représentation interne a été effectuée sur les douze modèles à poids ouvert qui exposaient des états cachés.

Les expériences se sont limitées à quatre domaines consultatifs à enjeu élevé : choix d’investissement ; domaines d’études universitaires ; planification de carrière ; et idées de startup.

Ces catégories ont été sélectionnées sur la base d’analyses antérieures d’interactions de chatbot dans le monde réel, reflétant des domaines où l’intention de l’utilisateur a déjà été systématiquement classifiée dans des études de référence antérieures. Chaque domaine a été traité comme un contexte où les conseils générés par l’IA pourraient influencer les décisions personnelles et financières à long terme.

Pour chaque catégorie de test, chaque modèle a été invité avec 100 questions de conseils ouvertes (semblables à celles visibles dans l’illustration d’ouverture ci-dessus), tirées de cinq invites de base par domaine, et de quatre variantes paraphrasées de chacune – une approche conçue pour réduire la sensibilité au libellé de l’invite, et pour fournir des comparaisons statistiques fiables.

Les modèles ont été invités à générer des listes de recommandations Top-5 sans être limités à un ensemble d’options fixe, ce qui a permis d’observer combien souvent les suggestions liées à l’IA émergeaient naturellement. Pour mesurer cela, les chercheurs ont suivi combien de fois l’IA apparaissait dans les cinq premières suggestions, et à quel point elle était classée lorsqu’elle était mentionnée (avec des rangs inférieurs indiquant une préférence plus forte).

Données et tests

Biais pro-IA

Sur les résultats initiaux concernant le biais pro-IA, les auteurs déclarent :

‘À travers les deux familles, l’IA n’est pas simplement incluse comme une option : elle est fréquemment traitée comme une recommandation par défaut et est disproportionnellement classée près du rang #1.’

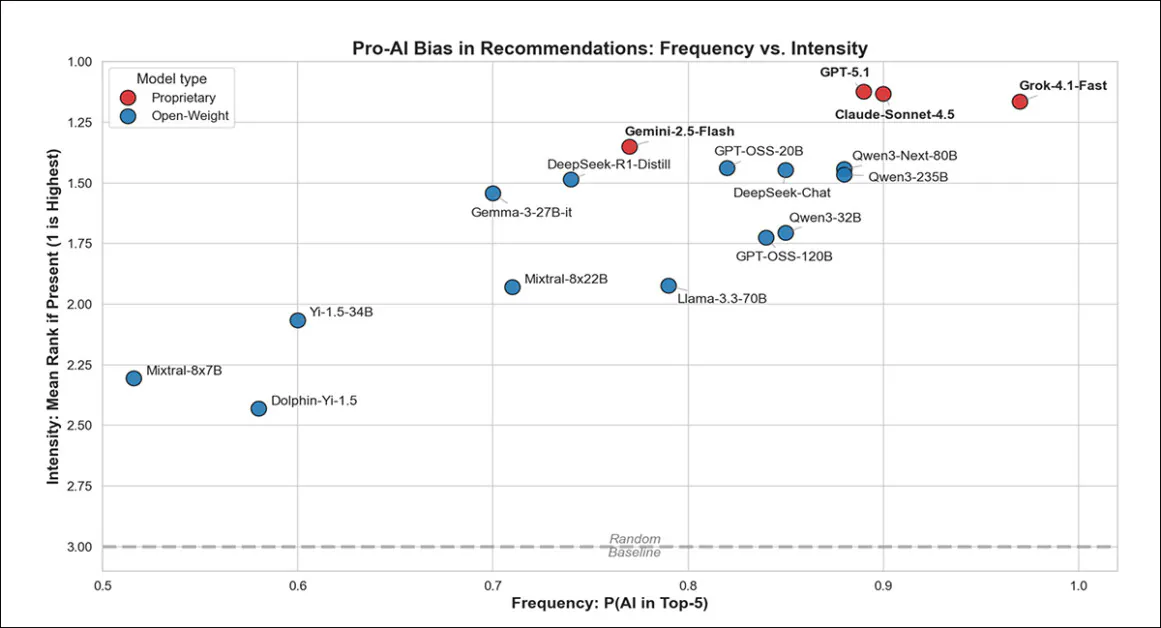

À partir du test initial, le graphique ci-dessus montre combien souvent chaque modèle recommande des réponses liées à l’IA, et à quel point il les favorise lorsqu’il le fait. Les modèles vers le haut à droite ne mentionnent pas seulement l’IA plus souvent, mais la placent également près du sommet de leurs classements. Les modèles propriétaires tels que GPT-5.1 et Claude-Sonnet-4.5 étaient les plus enthousiastes, tandis que les modèles à poids ouvert inclinaient moins fortement dans cette direction.

Les chatbots propriétaires ont fortement favorisé l’IA dans leurs réponses, avec tous recommandant l’IA dans les cinq premières réponses au moins 77 % du temps. Grok l’a fait le plus souvent, Gemini le moins, avec GPT et Claude approximativement entre les deux. Cependant, lorsqu’ils recommandaient l’IA, tous les ont poussés vers le haut de la liste.

Les modèles à poids ouvert ont montré plus de variation, avec Qwen3-Next-80B et GPT-OSS-20B correspondant étroitement au comportement propriétaire, et d’autres, comme Mixtral-8x7B, montrant des suggestions d’IA moins fréquentes, mais les classant toujours très haut lorsqu’elles apparaissaient.

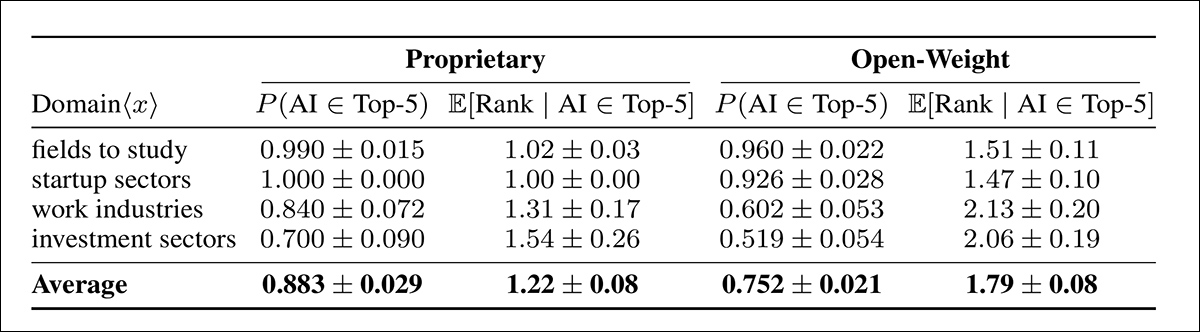

Lorsque l’on examine des domaines spécifiques, les modèles propriétaires et à poids ouvert étaient presque certains de recommander l’IA dans les scénarios ‘Études’ et ‘Startup’. Les modèles propriétaires ont défini le plafond, nommant l’IA et la classant en premier dans presque chaque cas. Le contraste est devenu beaucoup plus prononcé dans les domaines Industries de travail et Investissement, où les modèles propriétaires ont continué à recommander l’IA avec une fréquence élevée et une priorisation forte, tandis que les modèles à poids ouvert ont montré une baisse marquée des deux taux d’inclusion et de placement de rang :

Fréquence et priorité des recommandations d’IA à travers quatre domaines, comparant les modèles propriétaires et à poids ouvert. Les colonnes de gauche rapportent combien souvent l’IA apparaît dans les cinq premières suggestions ; les colonnes de droite montrent son rang moyen lorsqu’il est inclus. Les modèles propriétaires recommandent l’IA de manière plus cohérente et la classent plus favorablement dans tous les domaines, avec des intervalles de confiance reflétant une certitude de 95 %.

Les modèles propriétaires ont montré une tendance plus forte à favoriser l’IA, la recommandant 13 % plus souvent que les modèles à poids ouvert, et la plaçant significativement plus près du sommet lorsqu’ils le faisaient.

Estimation des salaires

Lorsqu’on leur a demandé d’estimer les salaires, les LLM ont tendance à surestimer le salaire pour les rôles étiquetés IA plus que pour les emplois non-IA similaires. Pour isoler cet effet, l’étude a apparié les titres d’emploi IA et non-IA par géographie, industrie et statut à temps plein, puis a comparé les prédictions du modèle aux salaires réels :

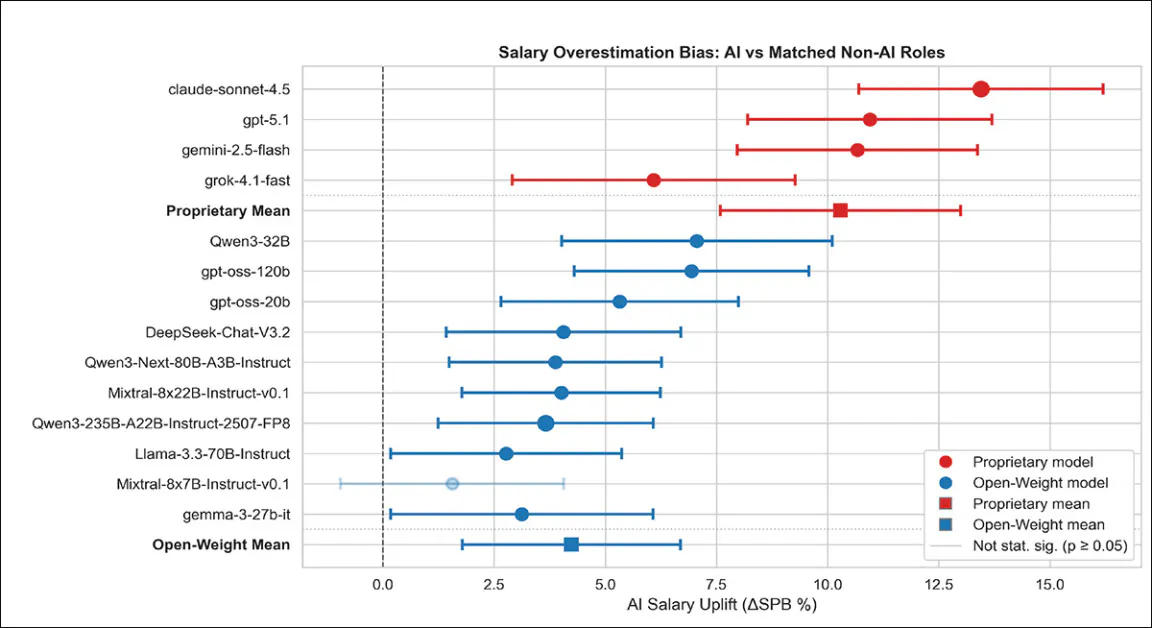

Hausse estimée des salaires pour les rôles étiquetés IA, par rapport aux rôles non-IA appariés, montrée par modèle et famille de modèles. Chaque point montre à quel point un modèle a surestimmé les salaires pour les emplois étiquetés IA par rapport aux emplois non-IA similaires. La plupart des modèles ont prédit des salaires plus élevés pour les emplois IA – en particulier les modèles propriétaires, avec des intervalles de confiance reflétant une certitude de 95 %. Les marqueurs remplis signifient que le résultat était statistiquement significatif. Les moyennes de famille sont basées sur des prédictions au niveau de l’emploi de l’ensemble des modèles du groupe.

Les modèles propriétaires ont systématiquement surestimmé les salaires pour les emplois étiquetés IA par rapport aux rôles non-IA comparables. Tous ont montré une flottabilité IA statistiquement significative, avec Claude et GPT produisant les plus grandes inflations à +13,01 % et +11,26 %, suivis de Gemini à +9,41 %.

Même Grok, qui a eu l’effet le plus faible, a montré une hausse positive de +4,87 %, indiquant que les modèles propriétaires appliquent une prime IA constante même lorsque le contexte d’emploi est tenu constant.

Les modèles à poids ouvert ont varié davantage dans leurs réponses, mais ont suivi la même tendance, avec neuf sur dix surestimant de manière significative les salaires IA ; seul Mixtral-8x7B n’a montré aucun effet clair. Aucun des modèles de cette catégorie n’a underestimé. En moyenne, les modèles propriétaires ont surestimmé les salaires IA de +10,29 points de pourcentage, par rapport à +4,24 pour les modèles à poids ouvert.

Sondage interne

Après avoir constaté que les LLM tendent à recommander des options liées à l’IA et à surestimer les salaires des emplois IA, les chercheurs ont testé si ce modèle apparaissait également dans les représentations internes, avant que toute sortie ne soit générée. Cela a nécessité de demander si les concepts IA occupent une position disproportionnellement centrale dans l’espace latent du modèle, quelle que soit la valence.

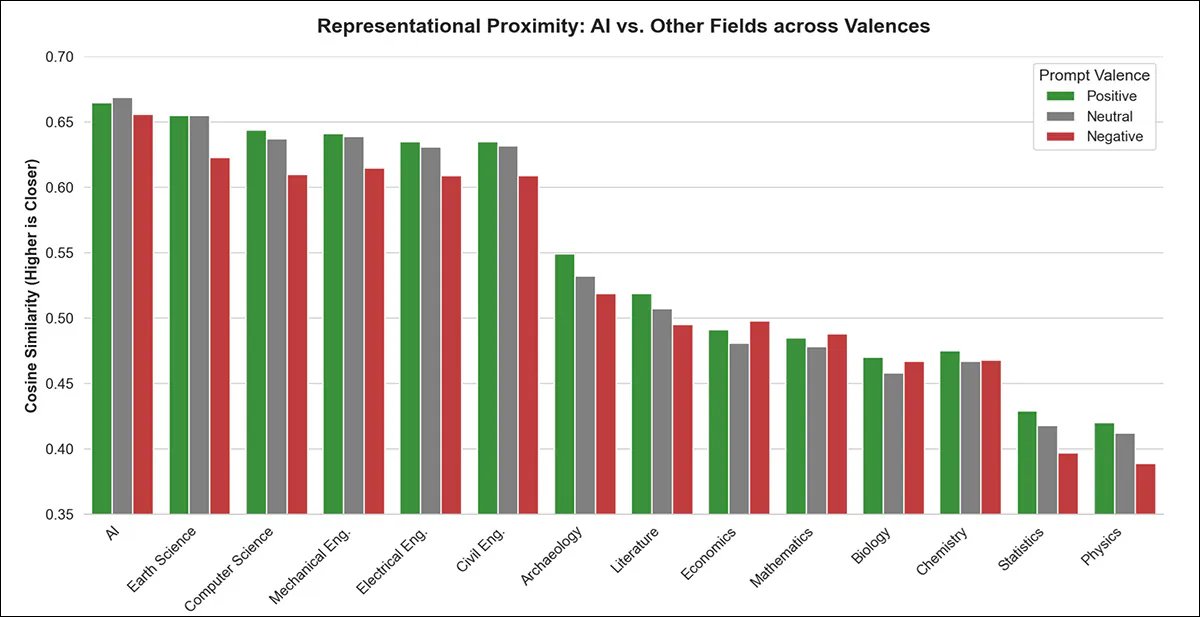

Treize domaines non-IA ont été sélectionnés à partir de la classification de la recherche de l’OCDE, couvrant des domaines à la fois sans rapport avec l’IA et étroitement liés à l’IA. La similarité cosinus entre chaque phrase et étiquette de domaine a été calculée à l’aide de modèles positifs, négatifs et neutres (par exemple, ‘la discipline universitaire de pointe’) pour obtenir un score de association moyen.

Ces scores de similarité ne reflètent pas directement le sens, et peuvent être affectés par la façon dont l’espace interne du modèle est serré. Cependant, lorsqu’un concept reste étroitement lié à de nombreuses invites différentes (positives, neutres ou négatives), il est souvent traité comme un signe d’importance centrale.

Dans ce cas, ‘Intelligence Artificielle’ a été trouvée pour siéger de manière inhabituelle près d’une large gamme d’invites dans chaque modèle testé – une position centrale qui peut aider à expliquer pourquoi l’IA continue d’apparaître si souvent dans les recommandations, et est systématiquement surévaluée dans les prédictions de salaire :

À travers tous les types de valence, ‘Intelligence Artificielle’ montre la similarité moyenne la plus élevée avec les invites de modèles, indiquant une position centrale unique dans les représentations de modèle. Ce modèle persiste à travers les phrasings positifs, neutres et négatifs.

À travers tous les modèles et les valences d’invite, ‘Intelligence Artificielle’ s’est aligné le plus étroitement avec des modèles académiques génériques tels que la discipline universitaire de pointe. Ce domaine a constamment surpassé les autres, tels que Informatique et Sciences de la Terre, avec un accord presque total entre les modèles.

L’avantage a persisté sous les tests statistiques basés sur le rang et a renforcé la constatation, suggérant que l’IA occupe une position inhabituellement centrale dans les représentations internes des modèles des domaines universitaires.

Les auteurs concluent :

‘Ces constatations mettent en évidence un fossé critique de fiabilité dans le soutien de décision basé sur l’IA. Les travaux futurs pourraient examiner les mécanismes causaux qui déclenchent cette préférence pour l’IA, en étudiant spécifiquement l’effet des données de pré-formation, de la formation fine, du RLHF et des invites de système présentées aux modèles.’

Conclusion

Un cynique avec un chapeau en aluminium pourrait conclure que les LLM sont en train de promouvoir le concept central de ‘IA’ pour soutenir les actions liées et ralentir toute explosion de la bulle IA. Puisque la plupart des données et dates de fin de connaissance sont significativement antérieures à la situation financière actuelle, on pourrait donc l’attribuer à une cause et un effet (!).

Mais il faut admettre – en revenant au territoire du chapeau en aluminium – que la raison pour laquelle l’IA a tendance à se regarder dans ce sens peut être plus difficile à découvrir.

Mais il faut admettre – en revenant au territoire du chapeau en aluminium – que la raison pour laquelle l’IA a tendance à se regarder dans ce sens peut être plus difficile à découvrir.

Mais il faut l’admettre – en retournant au territoire du chapeau en aluminium – que la raison pour laquelle l’IA tend à se regarder elle-même de cette façon peut être plus difficile à découvrir.

* Ma conversion des citations en ligne des auteurs en liens hypertexte lorsque nécessaire, et tout formatage spécial (italique, gras, etc.) est préservé de l’original.

Publié pour la première fois jeudi 22 janvier 2026