Angle d’Anderson

Les difficultés de l’IA à lire les horloges analogiques pourraient avoir une signification plus profonde

Un nouveau document de chercheurs en Chine et en Espagne constate que même les modèles d’IA multimodaux avancés tels que GPT-4.1 peinent à indiquer l’heure à partir d’images d’horloges analogiques. De petits changements visuels dans les horloges peuvent causer des erreurs d’interprétation majeures, et le fine-tuning ne fonctionne qu’avec des exemples familiers. Les résultats soulèvent des inquiétudes quant à la fiabilité de ces modèles face à des images inconnues dans des tâches du monde réel.

Lorsque les humains développent une compréhension suffisamment approfondie d’un domaine, tel que la gravité ou d’autres principes physiques de base, nous dépassons les exemples spécifiques pour saisir les abstractions sous-jacentes. Cela nous permet d’appliquer cette connaissance de manière créative dans différents contextes et de reconnaître de nouvelles instances, même celles que nous n’avons jamais vues auparavant, en identifiant le principe en action.

Lorsqu’un domaine est suffisamment important, nous pouvons même commencer à le percevoir là où il n’existe pas, comme dans le cas de la paréidolie, motivée par le coût élevé de ne pas reconnaître une instance réelle. Ce mécanisme de reconnaissance de motifs de survie est si fort qu’il nous amène même à trouver un plus large éventail de motifs où il n’y en a pas.

Plus tôt et plus répétitivement un domaine est inculqué en nous, plus profonde est sa base et plus grande est sa persistance tout au long de la vie ; et l’un des premiers ensembles de données visuelles auxquels nous sommes exposés en tant qu’enfants est sous la forme d’horloges d’enseignement, où des documents imprimés ou des horloges analogiques interactives sont utilisés pour nous apprendre à dire l’heure :

Aides d’enseignement pour aider les enfants à apprendre à dire l’heure. Source : https://www.youtube.com/watch?v=IBBQXBhSNUs

Bien que les modes changeantes de conception de montres puissent parfois nous défier, la résilience de cette maîtrise de domaine précoce est assez impressionnante, nous permettant de discerner les visages d’horloges analogiques même face à des choix de conception complexes ou « excentriques » :

Certains visages de montres de couture. Source : https://www.ablogtowatch.com/wait-a-minute-legibility-is-the-most-important-part-of-watch-design/

Les humains n’ont pas besoin de milliers d’exemples pour apprendre à utiliser les horloges ; une fois le concept de base compris, nous pouvons le reconnaître sous presque toutes les formes, même lorsqu’il est déformé ou abstrait.

La difficulté que les modèles d’IA rencontrent avec cette tâche met en évidence un problème plus profond : leur force apparente peut dépendre plus d’une exposition à grande échelle que d’une véritable compréhension.

Au-delà du jeu de l’imitation ?

La tension entre les performances de surface et la véritable « compréhension » a émergé à plusieurs reprises dans les investigations récentes de grands modèles. Le mois dernier, l’Université de Zhejiang et l’Université de Westlake ont reformulé la question dans un document intitulé Les modèles de langage LLM de niveau PhD comprennent-ils vraiment l’addition élémentaire ? (ce qui n’est pas l’objet de cet article), concluant :

‘Malgré des benchmarks impressionnants, les modèles montrent une dépendance critique à la reconnaissance de motifs plutôt qu’une véritable compréhension, comme en témoignent les échecs avec des représentations symboliques et les violations de propriétés de base.

‘La fourniture de règles explicites qui altèrent les performances suggère des contraintes architecturales inhérentes. Ces connaissances révèlent des lacunes d’évaluation et mettent en évidence la nécessité d’architectures capables de raisonnement mathématique réel au-delà de la reconnaissance de motifs.’

Cette semaine, la question se pose à nouveau, maintenant dans une collaboration entre l’Université aéronautique et astronautique de Nanjing et l’Université polytechnique de Madrid en Espagne. Intitulé Les modèles de langage multimodaux (MLLM) ont-ils vraiment appris à lire l’heure sur les horloges analogiques ?, le nouveau document explore comment les modèles multimodaux comprennent la lecture de l’heure.

Bien que le progrès de la recherche soit couvert seulement dans les grandes lignes dans le document, les tests initiaux des chercheurs ont établi que le modèle de langage multimodal GPT-4.1 d’OpenAI peinait à lire correctement l’heure à partir d’un ensemble diversifié d’images d’horloges, souvent donnant des réponses incorrectes même dans des cas simples.

Cela indique une possible lacune dans les données de formation du modèle, soulignant la nécessité d’un ensemble de données plus équilibré pour tester si le modèle peut réellement apprendre le concept sous-jacent. Par conséquent, les auteurs ont créé un ensemble de données synthétiques d’horloges analogiques, couvrant uniformément toutes les heures possibles et évitant les biais habituels des images Internet :

Un exemple de l’ensemble de données synthétiques d’horloges analogiques des chercheurs, utilisé pour affiner un modèle GPT dans le nouveau travail. Source : https://huggingface.co/datasets/migonsa/analog_watches_finetune

Avant le fine-tuning sur le nouveau ensemble de données, GPT-4.1 a constamment échoué à lire ces horloges. Après une certaine exposition au nouveau recueil, cependant, ses performances se sont améliorées – mais seulement lorsque les nouvelles images ressemblaient à celles qu’il avait déjà vues.

Lorsque la forme de l’horloge ou le style des aiguilles changeaient, la précision a fortement chuté ; même de petits ajustements, tels que des aiguilles plus fines ou des pointes de flèche (à droite de l’image ci-dessous), suffisaient pour le déstabiliser ; et GPT-4.1 a également lutté pour interpréter les horloges « fondantes » de Dali :

Images d’horloges avec conception standard (gauche), forme déformée (milieu) et aiguilles modifiées (droite), ainsi que les heures renvoyées par GPT-4.1 avant et après le fine-tuning. Source : https://arxiv.org/pdf/2505.10862

Les auteurs déduisent que les modèles actuels tels que GPT-4.1 peuvent donc apprendre la lecture de l’heure principalement par reconnaissance de motifs visuels, plutôt que par une compréhension plus profonde du concept de temps, affirmant :

‘[GPT 4.1] échoue lorsque l’horloge est déformée ou lorsque les aiguilles sont modifiées pour être plus fines et avoir une pointe de flèche. L’erreur absolue moyenne (MAE) dans l’estimation de l’heure sur 150 heures aléatoires était de 232,48 s pour les horloges initiales, 1380,69 s lorsque la forme est déformée et 3726,93 s lorsque les aiguilles sont modifiées.

‘Ces résultats suggèrent que le MLLM n’a pas appris à lire l’heure mais a plutôt mémorisé des motifs.’

Assez de temps

La plupart des ensembles de données de formation s’appuient sur des images Web scrapées, qui ont tendance à répéter certaines heures – en particulier 10:10, un réglage populaire dans les publicités de montres :

À partir du nouveau document, un exemple de la prévalence de l’heure « dix heures dix » dans les images d’horloges analogiques.

En conséquence de cette gamme limitée d’heures représentées, le modèle peut ne voir qu’une gamme étroite de configurations d’horloges possibles, limitant sa capacité à généraliser au-delà de ces motifs répétitifs.

En ce qui concerne la raison pour laquelle les modèles échouent à interpréter correctement les horloges déformées, le document indique :

‘Bien que GPT-4.1 performe exceptionnellement bien avec des images d’horloges standard, il est surprenant que la modification des aiguilles d’horloge en les rendant plus fines et en ajoutant des pointes de flèche conduise à une baisse significative de sa précision.

‘Intuitivement, on pourrait s’attendre à ce que le changement visuel plus complexe – un cadran déformé – ait un impact plus important sur les performances, mais cette modification semble avoir un effet relativement plus faible.

‘Cela soulève une question : comment les MLLM interprètent-ils les horloges, et pourquoi échouent-ils ? Une possibilité est que des aiguilles plus fines altèrent la capacité du modèle à percevoir la direction, affaiblissant sa compréhension de l’orientation spatiale.

‘Alternativement, il pourrait y avoir d’autres facteurs qui causent de la confusion lorsque le modèle tente de combiner les aiguilles des heures, des minutes et des secondes pour obtenir une lecture de l’heure précise.’

Les auteurs soutiennent que l’identification de la cause profonde de ces échecs est essentielle pour faire progresser les modèles multimodaux : si le problème réside dans la façon dont le modèle perçoit la direction spatiale, le fine-tuning peut offrir une solution simple ; mais si le problème découle d’une difficulté plus large à intégrer plusieurs indices visuels, il s’agit d’une faiblesse plus fondamentale dans la façon dont ces systèmes traitent l’information.

Tests de fine-tuning

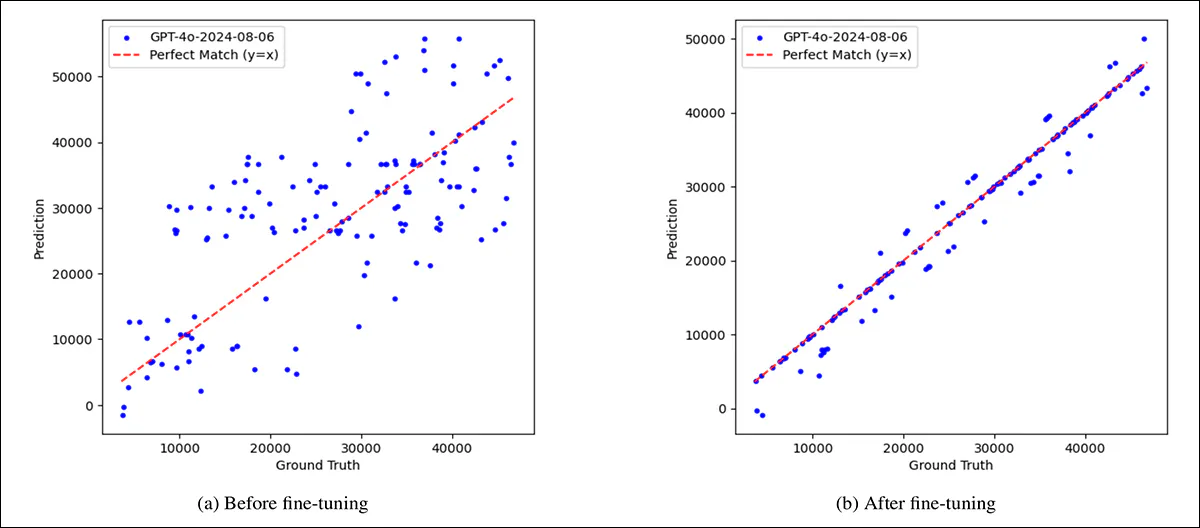

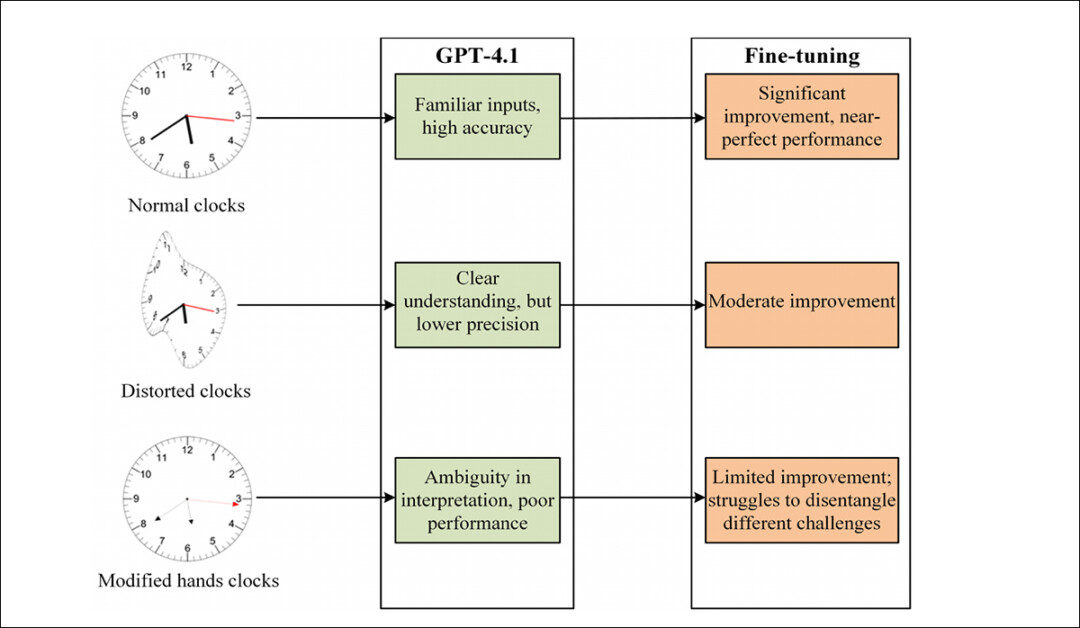

Pour tester si les échecs du modèle pouvaient être surmontés par une exposition, GPT-4.1 a été affiné sur l’ensemble de données synthétiques mentionné plus tôt. Avant le fine-tuning, ses prédictions étaient largement dispersées, avec des erreurs significatives sur tous les types d’horloges. Après le fine-tuning sur l’ensemble, la précision s’est améliorée de manière significative sur les visages d’horloges standard, et dans une moindre mesure, sur les horloges déformées.

Cependant, les horloges avec des aiguilles modifiées, telles que des formes plus fines ou des pointes de flèche, ont continué à produire des erreurs importantes.

Deux modes d’échec distincts sont apparus : sur les horloges normales et déformées, le modèle a généralement mal jugé la direction des aiguilles ; mais sur les horloges avec des styles de main modifiés, il a souvent confondu la fonction de chaque aiguille, prenant l’aiguille des heures pour l’aiguille des minutes ou l’aiguille des minutes pour l’aiguille des secondes.

Une comparaison illustrant la faiblesse initiale du modèle et les gains partiels obtenus grâce au fine-tuning, montrant l’heure prédite par rapport à l’heure réelle, en secondes, pour 150 horloges sélectionnées aléatoirement. À gauche, avant le fine-tuning, les prédictions de GPT-4.1 sont dispersées et souvent loin des valeurs correctes, indiquées par la ligne diagonale rouge. À droite, après le fine-tuning sur un ensemble de données synthétiques équilibré, les prédictions s’alignent beaucoup plus étroitement sur la vérité de base, bien que certaines erreurs persistent.

Cela suggère que le modèle a appris à associer des caractéristiques visuelles comme l’épaisseur de l’aiguille à des rôles spécifiques et a lutté lorsque ces indices changeaient.

L’amélioration limitée sur les conceptions inconnues soulève davantage de doutes sur la question de savoir si un modèle de ce type apprend le concept abstrait de lecture de l’heure ou se contente de raffiner sa reconnaissance de motifs.

Signes de main

Donc, même si le fine-tuning a amélioré les performances de GPT-4.1 sur les horloges analogiques conventionnelles, il a eu beaucoup moins d’impact sur les horloges avec des aiguilles plus fines ou des formes en pointe de flèche, soulevant la possibilité que les échecs du modèle proviennent moins de la raison abstraite et plus de la confusion sur laquelle aiguille est laquelle.

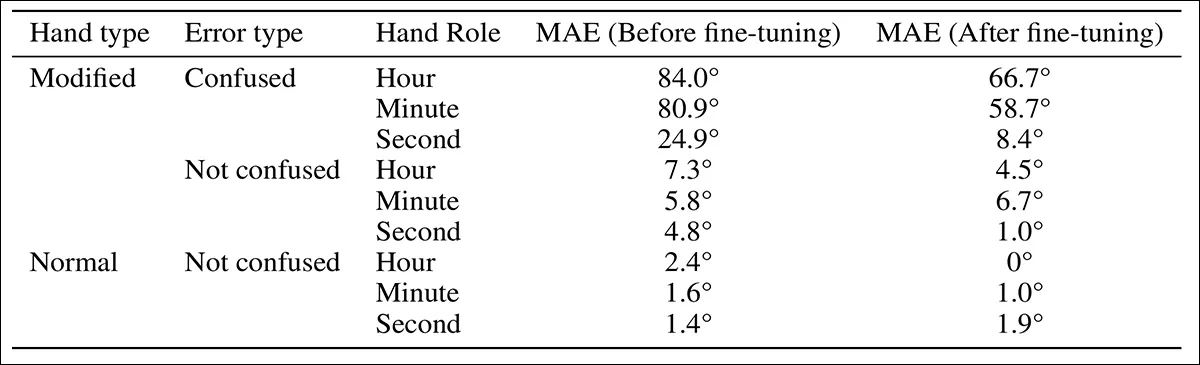

Pour tester si la précision pourrait s’améliorer si cette confusion était éliminée, une nouvelle analyse a été menée sur les prédictions du modèle pour l’ensemble de données « main modifiée ». Les sorties ont été divisées en deux groupes : les cas où GPT-4.1 a correctement reconnu les aiguilles des heures, des minutes et des secondes ; et les cas où il ne l’a pas fait.

Les prédictions ont été évaluées pour l’erreur absolue moyenne (MAE) avant et après le fine-tuning, et les résultats ont été comparés à ceux des horloges standard ; l’erreur angulaire a également été mesurée pour chaque aiguille en utilisant la position du cadran comme référence :

Comparaison d’erreurs pour les horloges avec et sans confusion de rôle de main dans l’ensemble de données de main modifiée avant et après le fine-tuning.

La confusion des rôles des aiguilles d’horloge a conduit aux plus grandes erreurs. Lorsque GPT-4.1 a confondu l’aiguille des heures avec l’aiguille des minutes ou vice versa, les estimations de l’heure résultantes étaient souvent loin de la réalité. En revanche, les erreurs causées par une mauvaise estimation de la direction d’une aiguille correctement identifiée étaient plus faibles. Parmi les trois aiguilles, l’aiguille des heures a montré l’erreur angulaire la plus élevée avant le fine-tuning, tandis que l’aiguille des secondes a montré la plus faible.

Erreur angulaire par type d’aiguille pour les prédictions avec et sans confusion de rôle de main, avant et après le fine-tuning, dans l’ensemble de données de main modifiée.

Pour se concentrer uniquement sur les erreurs de direction, l’analyse a été limitée aux cas où le modèle a correctement identifié la fonction de chaque aiguille. Si le modèle avait internalisé un concept général de lecture de l’heure, ses performances sur ces exemples auraient dû correspondre à son exactitude sur les horloges standard. Ce n’était pas le cas, et la précision est restée nettement inférieure.

Pour examiner si la forme de l’aiguille interférait avec le sens de la direction du modèle, une deuxième expérience a été menée : deux nouveaux ensembles de données ont été créés, chacun contenant soixante horloges synthétiques avec seulement une aiguille des heures, pointant vers une marque de minute différente. Un ensemble utilisait la conception d’aiguille d’origine, et l’autre la version modifiée. Le modèle a été invité à nommer la marque de laquelle l’aiguille pointait.

Les résultats ont montré une légère baisse de précision avec les aiguilles modifiées, mais pas suffisamment pour expliquer les échecs plus larges du modèle. Un seul motif visuel inconnu semblait capable de perturber l’interprétation globale du modèle, même dans les tâches qu’il avait précédemment exécutées correctement.

Aperçu des performances de GPT-4.1 avant et après le fine-tuning sur les horloges standard, déformées et à main modifiée, mettant en évidence les gains inégaux et les faiblesses persistantes.

Conclusion

Même si l’accent mis par le document peut sembler trivial à première vue, cela n’a pas vraiment d’importance si les modèles de vision-langage apprennent un jour à lire les horloges analogiques avec une précision de 100 %. Ce qui donne du poids à ce travail est son accent sur une question récurrente plus profonde : si la saturation des modèles avec plus (et plus divers) de données peut conduire au type de compréhension de domaine que les humains acquièrent par abstraction et généralisation ; ou si la seule voie viable est d’inonder le domaine avec suffisamment d’exemples pour anticiper chaque variation probable lors de l’inférence.

Chacun de ces parcours soulève des doutes quant à ce que les architectures actuelles sont vraiment capables d’apprendre.

Publié pour la première fois lundi 19 mai 2025