Andersonin kulma

Kohti täydellistä hallintaa tekoälyvideoiden luomisessa

Videopohjaiset mallit, kuten Hunyuan ja Wan 2.1, ovat vaikuttavia, mutta eivät tarjoa käyttäjille samaa tarkkuutta, jota vaaditaan ammattimaisissa visuaalisissa efekteissä, erityisesti VFX-tuotannossa.

Amatöörien visuaalisten efektiiden studioiden avoimet mallit, kuten Stable Diffusion, Kandinsky ja Flux, käytetään yleensä yhdessä muiden työkalujen kanssa, jotka sovittavat niiden raakatuotosta tiettyihin luovastiin tarpeisiin. Kun ohjaaja sanoo: “Se näyttää hyvältä, mutta voimmeko tehdä siitä vähän enemmän [n]?”, et voi vastata, että malli ei ole tarkka tarpeeksi käsitelläkseen tällaisia pyynnöistä.

Sen sijaan tekoäly-VFX-tiimi käyttää perinteisiä CGI- ja kompositional-tekniikoita, jotka liittyvät mukautettuihin prosessien ja työnkulkuihin, joita on kehitetty ajan myötä, pyrkien työntämään videon synteesin rajoja vähän pidemmälle.

Vastaavasti, perusvideomalli on paljon kuin oletusasennus verkkoselaimelle, kuten Chrome; se tekee paljon valmiina, mutta jos haluat, että se mukautuu tarpeisiisi, sinun on käytettävä joitakin laajennuksia.

Hallintafriikit

Diffuusiopohjaisen kuvansynteesin maailmassa tärkein kolmannen osapuolen järjestelmä on ControlNet.

ControlNet on tekniikka, joka lisää rakenteellista hallintaa diffuusiopohjaisiin generatiivisiin malleihin, sallien käyttäjien ohjata kuvan tai videon luomista lisäsyötteiden avulla, kuten reunakartat, syvyykskartat tai asennetiedot.

kuva (ylärivi), semanttisen segmentoinnin>kuva (alhaalla vasemmalla) ja asennon ohjatun kuvan luomisen ihmisille ja eläimille (alhaalla vasemmalla).” width=”779″ height=”422″ /> ControlNetin eri menetelmät sallivat syvyyden>kuva (ylärivi), semanttisen segmentoinnin>kuva (alhaalla vasemmalla) ja asennon ohjatun kuvan luomisen ihmisille ja eläimille (alhaalla vasemmalla).

Sen sijaan, että riippuisi pelkästään tekstiprompteista, ControlNet esittää erillisiä neuroverkkorakenteita, tai sovittimia, jotka prosessoi nämä ehdotus-signaaleja säilyttäen perusmallin generatiiviset ominaisuudet.

Tämä mahdollistaa hienosäätöiset tulokset, jotka noudattavat käyttäjän määrityksiä tarkemmin, mikä tekee siitä erityisen hyödyllisen sovelluksissa, joissa vaaditaan tarkkaa koostumista, rakennetta tai liikkeen hallintaa:

Asennuksen avulla voidaan saada tarkkaa tulosta ControlNetin avulla. Lähde: https://arxiv.org/pdf/2302.05543

Kuitenkin, sovittimen perustuvat kehykset toimivat ulkoisesti joukossa neuroprosesseja, jotka ovat hyvin sisäisiä. Nämä lähestymistavat ovat useita haittoja.

Ensinnäkin, sovittimet koulutetaan itsenäisesti, mikä johtaa haaraan ristiriitoihin, kun useita sovittimia yhdistetään, mikä voi johtaa heikentyneeseen generoimisen laatuun.

Toiseksi, ne esittävät parametrin redundanssin, vaativat lisää laskentaa ja muistia kullekin sovittimelle, mikä tekee skaalautumisesta tehokasta.

Kolmanneksi, vaikka ne tarjoavat joustavuutta, sovittimet usein tuottavat suboptimaalisia tuloksia verrattuna malleihin, jotka on täysin hienosäädetty moniehtoisten generointiin. Nämä ongelmat tekevät sovittimen perustuvista menetelmistä vähemmän tehokkaita tehtävissä, jotka vaativat käytännöllistä yhdistämistä useista hallintasignaaleista.

Ideaalisesti, ControlNetin kapasiteetit koulutettaisiin luonnollisesti malliin, modulaarisella tavalla, joka voisi sopeutua myöhemmin ja odotettuihin innovaatioihin, kuten samanaikaiseen video- ja äänisynthesoihin tai alkuperäisiin huulensynkronointiominaisuuksiin (ulkopuolisen äänen kanssa).

Kuten se nyt on, jokainen lisätoiminto edustaa joko jälkikäsittelytehtävää tai ei-alkuperäistä menettelyä, joka on selvitettävä perusmallin tiiviisti sidottujen ja herkkien painotusten kanssa.

FullDiT

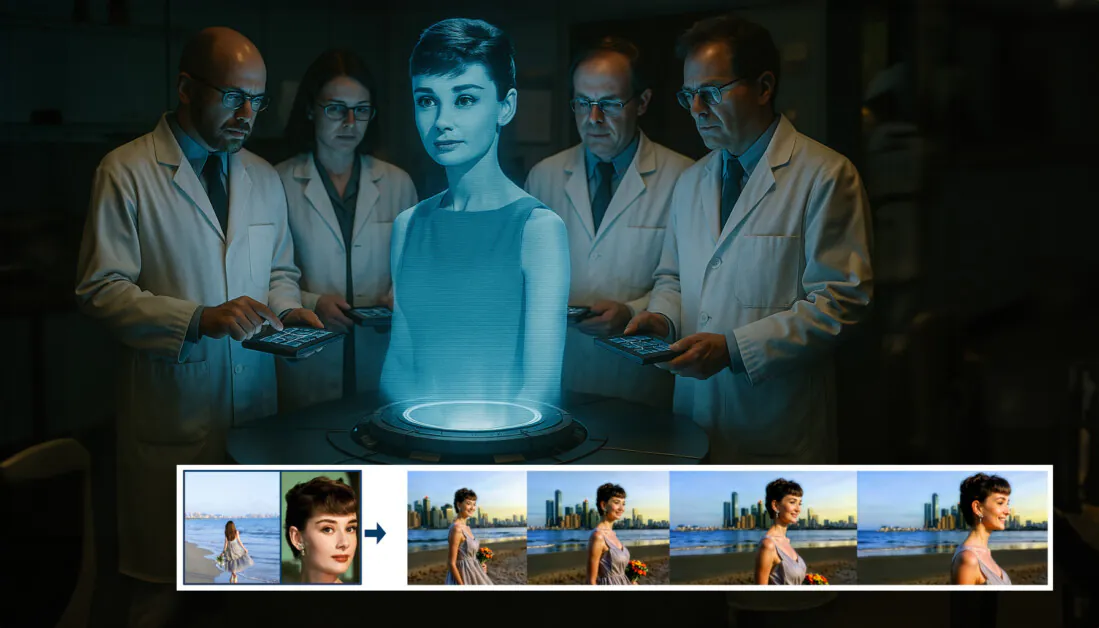

Tähän pattitilanteeseen tulee Kiinasta uusi tarjous, joka esittää järjestelmän, jossa ControlNet-tyyliset toimenpiteet on sisäänrakennettu generatiiviseen videomalliin koulutusajassa, sen sijaan, että ne olisivat jälkiohjelma.

Uudesta tutkimuksesta: FullDiT-lähestymistapa voi sisältää identiteetin asettamisen, syvyyden ja kameraliikkeen alkuperäiseen generointiin ja voi kutsua mitä tahansa näiden yhdistelmää kerran.

FullDiT on uusi lähestymistapa, joka yhdistää monitehtävät, kuten identiteetin siirron, syvyykskartan ja kameraliikkeen, integroiden osaksi koulutettua generatiivista videomallia, jonka kirjailijat ovat tuottaneet esimallin ja videoklippejä projekti-sivustolla.

Esimerkiksi alla olevassa esimerkissä nähdään generoinnit, jotka sisältävät kameraliikkeen, identiteettitiedon ja tekstiä (eli ohjaavan käyttäjän tekstipromptin):

Paina toistamaan. Esimerkkejä ControlNet-tyylisistä käyttäjän asetuksista vain alkuperäisellä koulutetulla perusmallilla. Lähde: https://fulldit.github.io/

On huomattava, että kirjailijat eivät ehdota kokeellista koulutettua mallia toimivana perusmallina, vaan pikemminkin osoituksena alkuperäisistä teksti-videosta (T2V) ja kuva-videosta (I2V) malleista, jotka tarjoavat käyttäjille enemmän hallintaa kuin vain kuvaprompti tai tekstiprompti.

Koska ei ole muita samanlaisia malleja, tutkijat loivat uuden vertailuohjelman nimeltä FullBench, monitehtävisten videoiden arviointiin, ja väittävät saavuttaneensa huipputason suorituskyvyn vastaavissa testeissä, jotka he kehittivät aiemmille lähestymistavoille. Kuitenkin, koska FullBench suunniteltiin kirjailijoiden itsensä toimesta, sen objektiivisuus on kokeematon, ja sen 1 400 tapauksen aineisto saattaa olla liian rajoitettu laajempien johtopäätösten tekemiseksi.

Todennäköisesti mielenkiintoisin asia arkkitehtuurissa, jonka tutkimus esittää, on sen potentiaali sisältää uusia hallintamuotoja. Kirjailijat toteavat:

‘Tässä työssä tutkimme vain kameran, identiteetin ja syvyyden ehtoja. Emme tutkineet muita ehtoja ja modaliteetteja, kuten ääntä, puhetta, pistepilveä, objektin rajauskuoria, optista virtausta jne. Vaikka FullDiT-suunnittelun avulla voidaan helppoja muutoksia tehdä muihin modaliteetteihin, on edelleen tärkeää selvittää, miten olemassa olevat mallit voidaan nopeasti ja kustannustehokkaasti sovittaa uusiin ehtoihin ja modaliteetteihin.’

Menetelmä

Kirjailijat väittävät, että FullDiT:n yhdistetty huomio-mekanismi mahdollistaa vahvemman monimodaalisen edustusoppimisen, joka havaitsee sekä spatiaaliset että temporaaliset suhteet ehdotusten yli:

Uuden tutkimuksen mukaan FullDiT integroi useita ehdotus-syötteitä täydellisen itsehuomion kautta, muuttaen ne yhdistetyksi jonoksi. Vastaavasti, sovittimen perustuvat mallit (vasemmalla) käyttävät erillisiä moduuleja kullekin syötteelle, johtaen redundanssiin, ristiriitoihin ja heikompiin suorituskykyihin.

Toisin kuin sovittimen perustuvat asetukset, jotka prosessoi kunkin syötteen erikseen, tämä jaettu huomio-rakenne välttää haaraan ristiriitaa ja vähentää parametrin ylitystä. He myös väittävät, että arkkitehtuuri voi skaalautua uusiin syötteiden tyyppiin ilman suurta uudelleensuunnittelua – ja että mallin schema näyttää generalisoituvan ehtojen yhdistelmiin, joita ei nähty koulutuksen aikana, kuten kameraliikkeen yhdistäminen identiteetin kanssa.

FullDiT:n arkkitehtuurissa kaikki ehdotus-syötteet – kuten teksti, kameraliike, identiteetti ja syvyys – muunnetaan ensin yhdistetyksi token-muotoon. Nämä tokenit liitetään sitten yhteen pitkään jonoon, joka prosessoidaan transformer-kerrosten pinon kautta täydellisen itsehuomion avulla. Tämä lähestymistapa seuraa aiempia töitä, kuten Open-Sora Plan ja Movie Gen.

Tämä suunnittelu mahdollistaa mallille oppia spatiaalisia ja temporaalisia suhteita yhdessä kaikkien ehtojen yli. Kunkin transformer-lohkon toiminta kattaa koko jonon, sallien dynaamiset vuorovaikutukset modaliteettien välillä ilman, että riippuu erillisistä moduuleista kullekin syötteelle – ja, kuten mainittiin aiemmin, arkkitehtuuri on suunniteltu laajennettavaksi, tehdessään siitä helppo lisätä tulevia innovaatioita ilman suuria rakenteellisia muutoksia.

Kolmen voima

FullDiT muuttaa kunkin hallintasignaalin standardoituihin token-muotoon, jotta kaikki ehdot voivat prosessoida yhdessä yhdistetyssä huomiokehyksessä. Kameraliikkeelle malli koodaa jonoa ulkoisia parametreja – kuten sijaintia ja suuntaa – kullekin kehykselle. Nämä parametrit ovat aikaleimattuja ja projisoituja upotusvektoreihin, jotka heijastavat signaalin temporaalista luonnetta.

Identiteettitieto käsitellään toisin, koska se on luonteeltaan spatiaalinen eikä temporaalinen. Malli käyttää identiteettikarttoja, jotka osoittavat, mitkä hahmot ovat läsnä kussakin kehyksessä. Nämä kartat on jaettu palasiin, ja kunkin palasen on upotettu upotus, joka havaitsee spatiaaliset identiteettivihjeet, sallien mallille yhdistää tiettyjä kehyksen alueita tiettyihin entiteetteihin.

Syvyys on spatiaalinen ja temporaalinen signaali, ja malli käsittelee sitä jakamalla syvyyden videot 3D-palasiin, jotka kattavat sekä avaruuden että ajan. Nämä palaset upotetaan tavalla, joka säilyttää niiden rakenteen kehysten yli.

Kun upotettu, kaikki nämä ehdotus-tokenit (kamera, identiteetti ja syvyys) liitetään yhteen pitkään jonoon, sallien FullDiT:lle prosessoida niitä yhdessä täydellisen itsehuomion avulla. Tämä jaettu edustus mahdollistaa mallille oppia vuorovaikutuksia modaliteettien yli ja ajan yli ilman, että riippuu erillisistä prosessointikanavista.

Data ja testit

FullDiT:n koulutuslähestymistapa perustui valikoivasti merkittyihin tietokantoihin, jotka on suunniteltu kullekin ehto-tyyppiin, sen sijaan, että vaadittaisiin, että kaikki ehdot olisivat läsnä samanaikaisesti.

Tekstiehtojen osalta aloite seuraa järjestelmällistä kuvauksen lähestymistapaa MiraData-projektissa esitettyä.

Videokokoelma ja merkintäputki MiraData-projektista. Lähde: https://arxiv.org/pdf/2407.06358

Kameraliikkeen osalta pääasiallinen tietolähde oli RealEstate10K-tietokanta sen korkealaatuisten pohjatodellisten kameraparametrien merkintöjen vuoksi.

Kuitenkin kirjailijat huomasivat, että koulutus pelkästään statisten kohtauksien kameratietokannoissa, kuten RealEstate10K, johti dynaamisten objektien ja ihmisten liikkeiden vähentymiseen generoiduissa videoissa. Vastatoimena he suorittivat lisäksi hienosäätöä sisäisillä tietokannoilla, jotka sisälsivät enemmän dynaamisia kameraliikkeitä.

Identiteetin merkinnät tuotettiin ConceptMaster-projektissa kehitetyn putken avulla, joka mahdollisti tehokkaan suodattamisen ja hienojakoinen identiteettitiedon poistamisen mukautetuista videoista.

ConceptMaster-kehyksen on suunniteltu ratkaisemaan identiteetin irtautumiseen liittyvät ongelmat säilyttäen samalla konseptin uskollisuutta mukautetuissa videoissa. Lähde: https://arxiv.org/pdf/2501.04698

Syvyyden merkinnät saatiin Panda-70M-tietokannasta Depth Anything:n avulla.

Optimointi datan järjestyksen kautta

Kirjailijat toteuttivat myös progressiivisen koulutusajan, jossa haastavammat ehdot esiteltiin aikaisemmin koulutuksessa, varmistaen, että malli hankki vankat edustukset ennen kuin yksinkertaisemmat tehtävät lisättiin. Koulutuksen järjestys eteni tekstistä kameraan, sitten identiteetteihin ja lopulta syvyyteen, ja yleensä ottaen helpommat tehtävät esiteltiin myöhemmin ja vähemmän esimerkeillä.

Kirjailijat korostavat datan järjestyksen arvoa:

‘Koulutusvaiheessa huomasimme, että haastavammat tehtävät vaativat pidentyneitä koulutusaikoja ja tulisi esittää aikaisemmin oppimisprosessissa. Nämä haastavat tehtävät liittyvät monimutkaisiin datajakaumiin, jotka poikkeavat merkittävästi tulostuvasta videosta, vaativat mallilta riittävän kapasiteetin niiden tarkan havaitsemiseksi ja edustamiseksi.’

‘Toisaalta, helpompien tehtävien esittäminen liian aikaisin voi johtaa siihen, että malli priorisoi niiden oppimisen ensin, koska ne tarjoavat välittömämpää optimointipalautea, mikä haittaa haastavampien tehtävien konvergenssiä.’

Tutkijoiden käyttämä datan koulutusjärjestys, jossa punainen osoittaa suurempaa datamäärää.

Lopullinen hienosäätövaihe paransi mallin visuaalista laatua ja liikkeen dynamiikkaa. Sen jälkeen koulutus seurasi standardin diffuusiopohjaisen kehyksen koulutusta*: melua lisättiin video-latenteihin, ja malli oppi ennustamaan ja poistamaan sen, käyttäen upotettuja ehto-tokenia ohjaukseksi.

Arvioidakseen FullDiT:n tehokkaasti ja tarjoatakseen reilun vertailun aiempiin menetelmiin, ja aiempien sovellettavien vertailujen puutteen vuoksi, kirjailijat esittivät FullBenchin, kuratoidun benchmark-aineiston, joka koostuu 1 400 erillisestä testitapauksesta.

Uuden FullBench-benchmarkin data-esikatselu. Lähde: https://huggingface.co/datasets/KwaiVGI/FullBench

Kunkin datapisteen tarjoaa pohjatodelliset merkinnät eri ehto-signaaleille, mukaan lukien kameraliikkeen, identiteetin ja syvyyden.

Mittarit

Kirjailijat arvioivat FullDiT:n kymmenellä mittarilla, jotka kattavat viisi pääasiallista suorituskyvyn osa-aluetta: tekstien kohdistus, kameran hallinta, identiteetin samankaltaisuus, syvyyden tarkkuus ja yleinen videon laatu.

Tekstien kohdistus mitattiin CLIP-yhtäläisyydellä, kun taas kameran hallinta arvioitiin rotaatiovirheen, translaatiovirheen ja kameraliikkeen johdonmukaisuuden avulla, seuraten CamI2V-projektin lähestymistapaa.

Identiteetin samankaltaisuus arvioitiin DINO-I:llä ja CLIP-I:llä, ja syvyyden hallintatarkkuus mitattiin keskimääräisellä virheellä (MAE). Videon laatu arvioitiin kolmella mittarilla MiraDatasta: kehyskohtaisella CLIP-yhtäläisyydellä sileyyden arvioimiseksi, optisen virran perusteella liikkeen etäisyyden mittaamiseksi ja LAION-Aesthetic-pisteillä visuaalisen viehätyksen arvioimiseksi.

Koulutus

Kirjailijat kouluttivat FullDiT:n sisäisellä (julkaistussa) teksti-videodiffuusiomallilla, joka sisälsi noin miljardi parametriä. He valitsivat tarkoituksella kohtuullisen parametrin koon ylläpitämään reiluutta vertailuun aiempiin menetelmiin ja varmistamaan toistettavuuden.

Koska koulutusvideot erosivat pituudeltaan ja resoluutioltaan, kirjailijat standardoivat kunkin erän koon muuttamalla ja täyttämällä videot yhteiseen resoluutioon, ottaen 77 kehystä kullekin sarjalle, ja käyttäen huomioita ja tappio-maskia koulutuksen tehokkuuden optimoimiseksi.

Adam-optimointi käytettiin 1×10−5 oppimisnopeudella 64 NVIDIA H800 GPU:n klusterissa, yhteensä 5 120 GB VRAM:ia (huomaa, että harrastajien synteesiyhteisöissä 24 GB RTX 3090:lla on edelleen luksus).

Malli koulutettiin noin 32 000 askelilla, sisältäen jopa kolme identiteettiä videota kohden, 20 kehystä kameran ehtoja varten ja 21 kehystä syvyyden ehtoja varten, kaikki tasaisesti otettuina 77 kehyksestä.

Jälkikäteen malli generoi videoita 384×672 pikselin resoluutiolla (noin viisi sekuntia 15 kehyksellä sekunnissa) 50 diffuusiopäättelyaskella ja luokittelu-vapaan ohjauksen asteikolla viisi.

Aiemmat menetelmät

Kamerasta videon arvioinnissa kirjailijat vertailivat FullDiT:ä MotionCtrl:in, CameraCtrl:n ja CamI2V:n kanssa, kaikki mallit koulutettiin RealEstate10K-tietokannasta varmistaakseen johdonmukaisuuden ja reiluuden.

Identiteetin ehdollistetussa generoinnissa, koska ei ollut vertailukelpoisia avoimia moni-identiteetin malleja saatavilla, malli vertailtiin 1 miljardin parametrin ConceptMaster-malliin, käyttäen samaa koulutusdataa ja arkkitehtuuria.

Syvyyden ehtojen tehtävissä vertailuja tehtiin Ctrl-Adapterin ja ControlVideo:n kanssa.

Määrälliset tulokset yhden tehtävän videogeneroinnista. FullDiT:ä verrattiin MotionCtrl:ään, CameraCtrl:ään ja CamI2V:ään kamerasta videon generointiin; ConceptMaster (1 miljardin parametrin versio) identiteetistä videon generointiin; ja Ctrl-Adapter ja ControlVideo syvyydestä videon generointiin.

Tulokset osoittavat, että FullDiT, vaikka se käsittelee useita ehto-signaaleja samanaikaisesti, saavutti huipputason suorituskyvyn tekstiin, kameran liikkeeseen, identiteettiin ja syvyyden hallintaan liittyvissä mittareissa.

Yleisissä laatu-mittareissa järjestelmä yleensä suoritti paremmin kuin muut menetelmät, vaikka sen sileys oli hieman alempi kuin ConceptMasterin. Kirjailijat kommentoivat:

‘FullDiT:n sileys on hieman alempi kuin ConceptMasterin, koska sileys lasketaan CLIP-yhtäläisyyden perusteella peräkkäisissä kehyksissä. Koska FullDiT näyttää merkittävästi suurempaa dynamiikkaa kuin ConceptMaster, sileysmittari vaikuttaa suurista vaihteluista peräkkäisissä kehyksissä.’

‘Esteettisen pisteiden osalta, koska arvostelumalli suosii maalaustyylisiä kuvia ja ControlVideo yleensä generoi videoita tässä tyylissä, se saavuttaa korkean esteettisen pisteiden määrän.’

Laadullisen vertailun osalta on ehkä suositeltavaa viitata FullDiT-projektin sivuston näytevideoihin, koska PDF-esimerkit ovat välttämättä staattisia (ja myös liian suuria täydelliseen julkaisuun).

Johtopäätös

Vaikka FullDiT on mielenkiintoinen askel kohti monipuolisempaa videopohjaista mallia, on ihmiselle luonnollista miettiä, vaativatko ControlNet-tyyliset välineet koskaan tarpeeksi suurta kysyntää oikeuttaakseen niiden toteuttamisen laajassa mittakaavassa, ainakin FOSS-projekteissa, jotka kamppailevat saadakseen tarvittavan suuren määrän GPU-laskentatehoa ilman kaupallista tukea.

Pääasiallinen haaste on, että järjestelmien, kuten Depth ja Pose, käyttäminen yleensä vaatii kohtuullisen määrän kokemusta suhteellisen monimutkaisten käyttöliittymien kanssa, kuten ComfyUI. Näin ollen toimiva FOSS-malli tällaisesta on todennäköisesti kehitettävä pienemmän VFX-yritysten ryhmässä, joilla ei ole varaa tai halua (koska tällaiset järjestelmät vanhenevat nopeasti mallipäivitysten myötä) kouluttaa ja ylläpitää tällaista mallia suljetussa ympäristössä.

Toisaalta API-pohjaiset “vuokraa-äly” -järjestelmät saattavat olla motivoituneita kehittämään yksinkertaisempia ja käyttäjäystävällisempiä tulkintamenetelmiä malleihin, joihin on suoraan koulutettu apuohjaimet.

Paina toistamaan. Syvyys + Teksti -ohjaus videon generoinnissa FullDiT:llä.

* Kirjailijat eivät mainitse mitään tunnettua perusmallia (esim. SDXL jne.)

Julkaistu ensimmäisen kerran torstaina 27. maaliskuuta 2025