Andersonin kulma

Lisäämällä dialogia oikeisiin videoihin AI:n avulla

Uusi AI-kehys voi uudelleenkirjoittaa, poistaa tai lisätä henkilön sanat videossa uudelleenkuvaamatta, yhden lopusta loppuun järjestelmän avulla.

Kolme vuotta sitten internet olisi ollut hämmästynyt millä tahansa 20-30 AI-videomuokkauskehysistä, jotka julkaistaan akateemisissa porteissa viikoittain; koska tämä suosittu tutkimuksen suunta on nyt niin runsas, että se lähes muodostaa toisen “AI Slop” -haaran, ja käsittelen paljon vähemmän näistä julkaisuista kuin olisin kaksi tai kolme vuotta sitten.

Kuitenkin yksi nykyinen julkaisu tässä linjassa kiinnitti huomioni: integroitu järjestelmä, joka voi puuttua oikeisiin videoklippiin ja asettaa uutta puhetta olemassaolevaan videoon (sen sijaan, että luotaisiin koko generatiivinen klippi kasvoista tai kehyksestä, mikä on paljon yleisempää).

Esimerkeissä alla, jotka olen editoinut useista näytevideoista, jotka ovat saatavilla julkaisun projektisivustolla, näemme ensin oikean lähdeklipin, ja sitten sen alla, asetetun AI-puheen klipin keskellä, mukaan lukien äänen synteesi ja huulien syncronisointi:

Klikkaa toistamaan.Paikallinen editointi ompelemalla – yksi useista modaaleista, jotka FacEDiT tarjoaa. Viittaa lähdeverkkosivustoon paremman resoluution vuoksi. Lähde – https://facedit.github.io/

Tämä lähestymistapa on yksi kolmesta kehitetystä uudelle menetelmälle, ja se, joka kiinnostaa eniten kirjoittajia (sekä minua). Periaatteessa klippi on laajennettu käyttämällä yhtä keskimmäisistä kehyksistä aloituspisteenä uudelle AI-tulkinnalle, ja sen seuraavaa (oikeaa) kehystä tavoitteena, jonka generoitu lisäklippi pyrkii vastaamaan. Klupeissa yllä nämä “siemen”- ja “kohde”-kehykset edustetaan ylempänä videon pysähtyessä, kun taas muutettu video alla antaa generoivan täytteen.

Kirjoittajat kuvaavat tätä kasvojen ja äänen synteesi-lähestymistapaa ensimmäisenä täysin integroiduna lopusta loppuun menetelmänä AI-videomuokkauksille tämänkaltaisille, havainnoitsen täysin kehitetyn kehyskehyksen potentiaalia TV- ja elokuvatuotannolle:

‘Elokuvantekijät ja media tuottajat usein tarvitsevat muokata tiettyjä osia tallennetuista videoista – ehkä sana oli väärin puhuttu tai käsikirjoitus muuttui kuvaamisen jälkeen. Esimerkiksi ikonisessa kohtauksessa Titanic (1997) jossa Rose sanoo, “En ikinä anna periksi, Jack,” ohjaaja saattaa myöhemmin päättää, että se pitäisi olla “En ikinä unohda sinua, Jack”.

‘Perinteisesti, tällaiset muutokset vaativat koko kohtauksen uudelleenkuvaamista, mikä on kallista ja aikaa vievää. Puhuvan kasvojen synteesi tarjoaa käytännöllisen vaihtoehdon automaattisesti muokkaamalla kasvojen liikkeitä muuttuneen puheen mukaan, poistamalla tarpeen uudelleenkuvaamiselle.’

Vaikka tällaiset AI-välittömät puuttuvat saattavat kohtaa kulttuurista tai teollisuuden vastarintaa, ne voivat myös muodostaa uudenlaisen toiminnallisuuden ihmisten johdannaisissa VFX-järjestelmissä ja työkalupaketeissa. Joka tapauksessa, toistaiseksi, haasteet ovat ehdottomasti teknisiä.

Lisäksi klipin laajentamisesta AI-generoituja dialogeja, uusi järjestelmä voi myös muuttaa olemassa olevaa puhetta:

Klikkaa toistamaan.Esimerkki olemassa olevan dialogin muuttamisesta sen sijaan, että lisättäisiin uutta dialogia. Viittaa lähdeverkkosivustoon paremman resoluution vuoksi.

Tilannekuva

Tällä hetkellä ei ole olemassa lopusta loppuun järjestelmiä, jotka tarjoavat tällaista synteesiominaisuutta; vaikka useat generatiiviset AI-alustat, kuten Google’n Veo-sarja, voivat generoida ääntä, ja monien muiden kehysten avulla voidaan luoda deepfaked-ääni, yhden on tällä hetkellä luotava melko monimutkainen putki erilaisista arkkitehtuureista ja temppuista, jotta voidaan puuttua oikeaan kuvamateriaaliin tavalla, jolla uusi järjestelmä – nimeltään FacEDiT – voi saavuttaa.

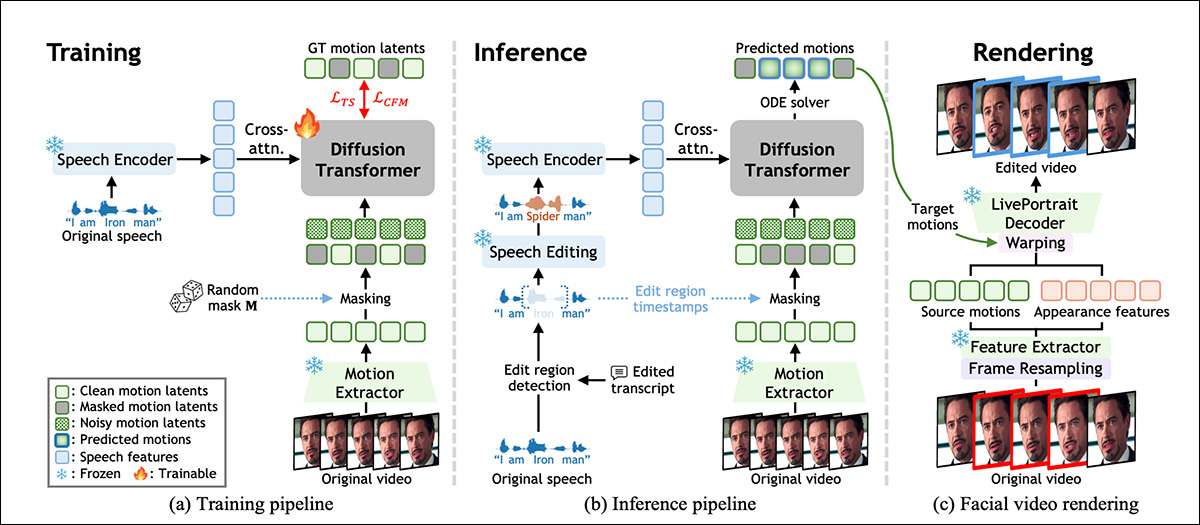

Järjestelmä käyttää Diffusion Transformers (DiT) yhdistettynä Flow Matching kanssa luomaan kasvojen liikkeitä, jotka ovat ehdollisia ympäröivien (kontekstuaalisten) liikkeiden ja puheen ääni sisällön mukaan. Järjestelmä hyödyntää olemassa olevia suosittuja paketteja, jotka käsittelevät kasvojen rekonstruktioita, mukaan lukien LivePortrait (jonka Kling on vastikään ottanut haltuun).

Lisäksi tähän menetelmään, koska heidän lähestymistapansa on ensimmäinen, joka integroi nämä haasteet yhteen ratkaisuun, kirjoittajat ovat luoneet uuden vertailuindikaattorin nimeltä FacEDiTBench, sekä useita uusia arviointimittareita, jotka ovat sovellettavissa tähän erityiseen tehtävään.

Uusi työ on nimeltään FacEDiT: Yhdistetty puhuvan kasvojen editointi ja generointi kasvojen liikkeen täyttämisen kautta, ja se tulee neljältä tutkijalta Korean Pohangin tiede- ja teknologiayliopistosta (POSTECH), Korean edistyneestä tieteen ja teknologian instituutista (KAIST) ja Texasin yliopistosta Austinissa.

Menetelmä

FacEDiT on koulutettu rekonstruoimaan kasvojen liikkeitä oppimalla, miten puuttuvat osat näyttelijän alkuperäisestä suorituksesta voidaan täyttää, perustuen ympäröivään liikkeeseen ja puheen ääniin. Kuten alla olevassa skeemassa näkyy, tämä prosessi sallii mallin toimia kuin täyttäjänä koulutuksen aikana, ennustamalla kasvojen liikkeitä, jotka vastaavat ääntä, ja pysymällä alkuperäisen videon mukana:

FacEDiT-järjestelmän yleiskatsaus, jossa näkyy, miten kasvojen liikkeet oppivat itsesääteisen täyttämisen kautta koulutuksen aikana, ohjattuna editoiduilla puheilla, ja lopulta renderöity takaisin videoon uudelleen käyttämällä alkuperäisen kuvamateriaalin ulkonäköä, korvaamalla vain kohdennetun liikkeen. Lähde

Tulostusajassa sama arkkitehtuuri tukee kahta eri tulostetta, riippuen siitä, kuinka paljon videota on maskattu: osittaiset muokkaukset, joissa vain lause muutetaan ja loput jätetään koskemattomaksi; tai kokonaisen lauseen generointi, jossa uusi liike syntetisoidaan kokonaan alusta alkaen.

Malli on koulutettu Flow Matching -menetelmällä, joka käsittää videoeditoinnit tietynlaisten polkujen välillä kasvojen liikkeiden välillä.

Sen sijaan, että opetettaisiin, miltä editoitu kasvo pitäisi näyttää alusta alkaen, Flow Matching opettaa liikkumaan asteittain ja sileästi väliaikaisen välikappaleen ja oikean liikkeen välillä. Tämän edistämiseksi järjestelmä edustaa kasvojen liikkeitä tiiviinä joukkona lukuja, jotka on poimittu kustakin kehyksestä versiolla edellä mainitusta LivePortrait-järjestelmästä (ks. yllä oleva skeema).

Nämä liikkeen vektorit on suunniteltu kuvaamaan ilmeitä ja pään asentoa siten, että puheen muutokset voidaan lokalisoida ilman, että vaikuttaa henkilön yleiseen ulkonäköön.

FacEDiT Koulutus

FacEDiT:n koulutukseen jokainen videoklippi jaettiin sarjaan kasvojen liikkeen otoksiin, ja jokainen kehys parittiin vastaavan ääniin. Satunnaiset osat liikkeen datasta piilotettiin, ja malli pyydettiin arvaamaan, miltä nuo puuttuvat liikkeet pitäisi näyttää, käyttäen sekä puhetta että ympäröivää maskittamatonta liikettä kontekstina.

Koska maskattujen jaksojen ja niiden sijaintien vaihtelu vaihtelee koulutus-esimerkin mukaan, malli oppii asteittain, miten käsitellä sekä pieniä sisäisiä muokkauksia että pidempiä aukkoja, koko jakson generointia varten, riippuen siitä, kuinka paljon tietoa sille annetaan.

Järjestelmän edellä mainittu Diffusion Transformer oppii palauttamaan maskatun liikkeen puhdistamalla meluisia syötteitä ajan myötä. Sen sijaan, että puhetta ja liikettä syötetään malliin kerran, ääni syötetään käsittelylohkoihin cross-attention kautta, auttaen järjestelmää vastaamaan huulien liikkeitä äänen puhetta tarkemmin.

Jotta realismi säilytettäisiin muokkauksien yli, huomio kiinnitetään lähinnä naapurikehyksiin sen sijaan, että koko aikajanaan, pakottaen mallin keskittymään paikalliseen jatkuvuuteen, ja estämällä vilkkua tai liikkeen hyppyjä muokattujen alueiden reunoilla. Positionaalinen upottaminen (joka kertoo mallille, missä kehys esiintyy jaksossa) auttaa myös mallia ylläpitämään luonnollista aikajanaa ja kontekstia.

Koulutuksen aikana järjestelmä oppii ennustamaan puuttuvia kasvojen liikkeitä rekonstruoimalla maskattuja jaksoja puheen ja lähellä olevan maskittamattoman liikkeen perusteella. Tulostusajassa sama asetelma uudelleen käytetään, mutta maskit on nyt ohjattu puheen muokkauksilla.

Kun sana tai lause lisätään, poistetaan tai muutetaan, järjestelmä sijaintaa vaikuttavaa aluetta, maskaa sen ja regeneroi liikettä, joka vastaa uutta ääntä. Koko jakson generointi käsittelyssä kohdellaan erityistapauksena, jossa koko alue maskataan ja syntetisoidaan alusta alkaen.

Data ja Testit

Järjestelmän runko koostuu 22 kerroksesta Diffusion Transformerille, kullakin 16 huomio-päät ja syötteen eteenpäin ulottuvuuksilla 1024 ja 2024px. Liikkeen ja ulkonäön ominaisuudet poimitaan jäädytettyjen LivePortrait-komponenttien avulla, ja puhe koodataan WavLM:n avulla ja muutetaan VoiceCraft:in avulla.

Omistaja-projektiolayhteenvedon kerros kartoittaa 786- ulottuvuuden ääniominaisuudet DiT:n latenttiavaruuteen, ja vain DiT ja projektiomodulit koulutetaan alusta alkaen.

Koulutus suoritettiin AdamW -optimoinnin avulla kohdeoppimisnopeudella 1e-4, miljoonan askeleen ajan, kahdella A6000-näytönohjaimella (kummallakin 48GB VRAM), kokonaisella eräkoolle kahdeksan.

FacEDiTBench

FacEDiTBench-aineisto sisältää 250 esimerkkiä, kustakin videoklipin alkuperäisestä ja editoidusta puheesta, sekä transkriptit molemmista. Videot tulevat kolmesta lähteestä, 100 klippiä HDTF:stä, 100 Hallo3:sta ja 50 CelebV-Dub:sta. Kunkin on tarkistettu manuaalisesti varmistamaan, että sekä ääni että video olivat selkeät arvioinnin vuoksi.

GPT-4o käytettiin kääntämään kunkin transkriptin muokkaamaan kieliopillisesti oikein. Nämä muokatut transkriptit, sekä alkuperäinen puhe, annettiin VoiceCraftille tuottamaan uusi ääni; ja kussakin vaiheessa, sekä transkripti että generoitu puhe tarkistettiin manuaalisesti laadun vuoksi.

Kunkin näytteen on merkitty muokkaustyyppi, muutoksen ajoitus ja muutetun jakson pituus, ja muokkaukset on luokiteltu lisäyksiksi, poistoksi tai korvaaviksi. Sanan muutosten määrä vaihteli lyhyistä muokkauksista, jotka olivat 1-3 sanaa, keskipitkistä muokkauksista, jotka olivat 4-6 sanaa, ja pidemmistä muokkauksista, jotka olivat 7-10 sanaa.

Kolme mukautettua mittaria määriteltiin arvioimaan editointilaatu. Valokuvallinen jatkuvuus, jotta mitata, miten hyvin editoitu segmentin valaistus ja väri sulautuu ympäröivään videoon, vertaamalla pikselitasoista eroa reunassa; liikkeen jatkuvuus, arvioidakseen kasvojen liikkeen jatkuvuutta, mitaamalla optisen virran muutoksia editoituissa ja editoimattomissa kehyksissä; ja identiteetin säilyttäminen, arvioimaan, säilyykö kohteen ulkonäkö muuttumattomana editoinnin jälkeen, vertaamalla kasvojen upotuksia alkuperäisestä ja generoidusta jaksosta ArcFace -kasvojentunnistusmallin avulla.

Testit

Testejärjestelmä koulutettiin aineistosta, joka koostui kolmesta edellä mainitusta aineistosta, yhteensä noin 200 tuntia videomateriaalia, mukaan lukien vlogeja ja elokuvia, sekä korkean resoluution YouTube-videota.

Puhuvan kasvojen editoinnin arvioimiseksi käytettiin FacEDiTBenchiä, sekä HDTF-testijakoa, josta on tullut vertailustandardi tämänkaltaisille tehtäville.

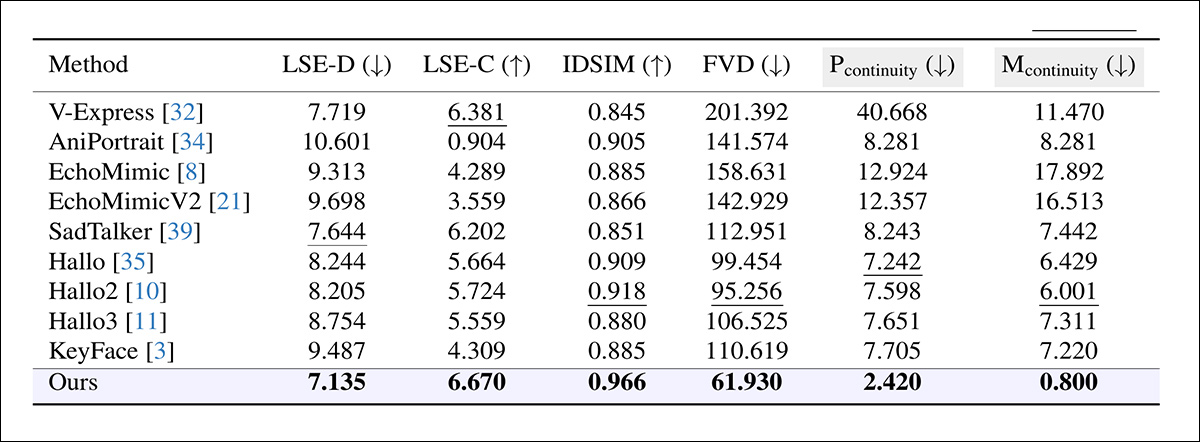

Koska ei ollut suoraan vertailukelpoisia järjestelmiä, jotka voisivat kattaa tämänkaltaisen lopusta loppuun toiminnallisuuden, kirjoittajat valitsivat useita kehyksiä, jotka toistivat ainakin osan kohde-toiminnallisuutta, ja jotka voisivat toimia vertailukohteina; nimittäin, KeyFace; EchoMimic; EchoMimicV2; Hallo; Hallo2; Hallo3; V-Express; AniPortrait; ja SadTalker.

Useita vakiintuneita mittareita käytettiin myös generoinnin ja editoinnin laadun arvioimiseen, ja huulien syncronisoinnin tarkkuus arvioitiin SyncNet:n avulla, ilmoittamalla sekä absoluuttisen virheen huulien liikkeiden ja äänen välillä (LSE-D) että luottamusluokan (LSE-C); Fréchet Video Distance (FVD) mittaamaan videon realismin yleensä; ja Learned Perceptual Similarity Metrics (LPIPS), mitataksesi generoiden ja alkuperäisten kehysten havainnollinen samankaltaisuus.

Muokkausta varten kaikki mittarit, paitsi LPIPS, sovellettiin vain muokattuun segmenttiin; generointia varten koko video arvioitiin, ja reunan jatkuvuus poistettiin.

Kunkin mallin pyydettiin generoimaan vastaava videosegmentti, joka sitten liitettiin alkuperäiseen klippiin (tutkijat huomauttavat, että tämä menetelmä usein aiheutti näkyviä epäjatkuvuuksia, missä editoitu osa kohtasi ympäröivän kuvamateriaalin). Toinen lähestymistapa testattiin myös, jossa koko video generoitiin uudelleen muokatun äänen mukaan – mutta tämä poisti väärittömät alueet ja epäonnistui alkuperäisen suorituksen säilyttämisessä:

Vertailu puhuvan kasvojen editoinnin laadussa FacEDiT:in ja muiden järjestelmien välillä, joita on suunniteltu puhuvan kasvojen generoimiseen. FacEDiT ylittää kaikki vertailukohdetut, saavuttaen alempaan huulien syncronisointivirheen (LSE-D), korkeamman syncronisointiluottamuksen (LSE-C), vahvemman identiteetin säilyttämisen (IDSIM), suuremman havainnollisen realismin (FVD) ja sileämmät siirtymät editointirajoilla (Pcontinuity, Mcontinuity).

Näistä tuloksista kirjoittajat toteavat:

‘[Meidän] malli ylittää merkittävästi olemassa olevat menetelmät editointitehtävässä. Se saavuttaa vahvan reunan jatkuvuuden ja korkean identiteetin säilyttämisen, osoittaen kykynsä ylläpitää aikajanan ja visuaalisen jatkuvuuden aikana editointia. Lisäksi sen ylivoimainen huulien syncronisointitarkkuus ja alhainen FVD heijastavat generoidun videon realismin.’

Klikkaa toistamaan.Tulokset, jotka on koottu julkaisun projektisivustolta. Viittaa lähdeverkkosivustoon paremman resoluution vuoksi.

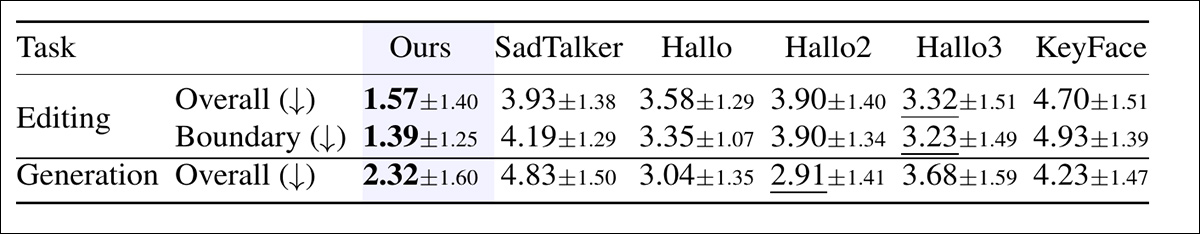

Lisäksi suoritettiin ihmistutkimus, jossa arvioitiin havaittu laatu sekä editoinnissa että generoinnissa.

Kussakin vertailussa osallistujat katsoivat kuusi videota ja luokittelivat ne yleislaadun mukaan, ottaen huomioon huulien syncronisointitarkkuuden, luonnollisuuden ja realismin pään liikkeessä. Editointikokeissa osallistujat myös arvioivat siirtymien sileyyttä editoituissa ja editoimattomissa segmenteissä:

Ihmisten arvioijien antamat keskimääräiset arviot, joissa matalampi on parempi. Sekä editoinnissa että generoinnissa osallistujat arvioivat, kuinka luonnollinen ja syncronoitu kunkin video näytti. Editoinnissa he myös arvioivat, kuinka sileät siirtymät olivat editoituissa ja editoimattomissa puheissa. Lihavoitu ja alaviivattu arvo osoittaa parhaan ja toiseksi parhaan tuloksen.

Tutkimuksessa FacEDiT luokiteltiin johdonmukaisesti korkeimmaksi sekä editointilaadun että siirtymien sileyyden osalta, ja se sai myös vahvat arviot generoinnissa, osoittaen, että sen mitatut edut kääntyvät havainnoituun etuun.

Tilaa puuttuu, joten viittaan lukijaa alkuperäiseen tutkimusraporttiin lisätietojen saamiseksi poistotutkimuksista ja muista testeistä, jotka on suoritettu ja raportoitu uudessa tutkimuksessa. Totuudenmukaisesti, tämänkaltaiset tutkimuksen tarjoukset kamppailevat usein tuottamaan merkityksellisiä testituloksia, koska itse ydin tarjous on välttämättä potentiaalinen vertailukohta myöhempää työtä varten.

Johtopäätös

Vaikka järjestelmät, kuten tämä, saattavat vaatia merkittäviä laskentaresursseja tulostusajassa, mikä tekee siitä haasteellista alihankkijoille – tässä tapauksessa VFX-pajoille – pitää työ paikallisesti, lähestymistavat, jotka voidaan sovittaa realistisiin paikallisiin resursseihin, ovat aina toimijoille mieluisampia, jotka ovat oikeudellisesti velvollisia suojelemaan asiakkaiden kuvamateriaalia ja yleistä IP:ää.

Tämä ei kuitenkaan ole kritisoida uutta tarjousta, joka voi toimia täydellisesti kvantitoiduilla painoilla tai muilla optimoinneilla, ja joka on ensimmäinen tarjous tämänkaltaiselle, joka on houkutellut minut takaisin tähän tutkimuksen suuntaan jo jonkin aikaa.

Julkaistu ensimmäisen kerran keskiviikkona, 17. joulukuuta 202. Muokattu 20.10 EET, samana päivänä, lisää tilaa ensimmäiseen kappaleeseen.