Tekoäly

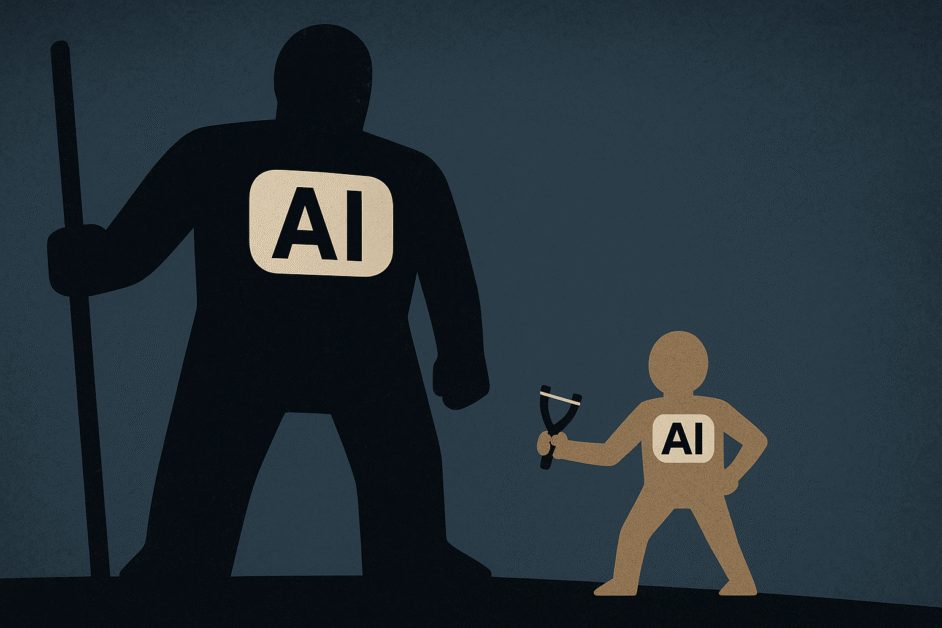

Pieni mallin kapina: Miksi pienet tekoälymallit pärjäävät jättiläismallien kanssa

Viime vuosina tekoäly on muotoutunut kilpailusta rakentaa koskaan suurempia malleja. Jokainen uusi julkaisu on mitattu parametreiden määrän, koulutusdatan koosta ja taustalla olevan infrastruktuurin mittakaavan mukaan. Oletettiin, että suuremmat mallit ovat parempia. Vaikka teknologiajätit jatkavat yhä massiivisempien kielimallien kehittämistä, joissa on satoja miljardeja parametreja, hiljainen vallankumous on tapahtumassa. Pienet tekoälymallit, usein tuhansia kertoja pienemmät kuin jättimäiset vastineensa, saavuttavat vertailukelpoisen ja joskus jopa paremman suorituskyvyn tiettyjen tehtävien suorittamisessa. Tämä muutos haastaa kaiken, mitä olemme ajatelleet tietäen tekoälyn skaalautumisesta, ja avaa uusia mahdollisuuksia demokratisoituun, tehokkaaseen tekoälyyn.

Davidin ja Goliathin tarina modernista tekoälystä

Vuosiin tekoälyteollisuus on toiminut oletuksella, että suuremmat mallit tarjoavat paremman suorituskyvyn. OpenAI:n GPT-sarja kasvoi 117 miljoonasta parametrista yli 175 miljardiin. Google PaLM saavutti 540 miljardin parametrin. Suuret teknologiayritykset ovat investoineet miljardeja dollareita näiden mallien kouluttamiseen ja investoivat edelleen entistä suurempien mallien kehittämiseen. Tässä tilanteessa, kun parametrilaskenta tuli avaintekijäksi mallin kapasiteetin määrittämiseen ja tekoälykapasiteetin rakentamiseen tuli laskenta- ja infrastruktuurirahoituksen kilpailu, mielenkiintoinen ilmiö alkoi tapahtua tutkimuslaboratorioissa ympäri maailmaa.

Insinöörit alkoivat löytää, että pienemmät, tarkoin suunnitellut mallit voivat vastata tai ylittää jättimäisten mallien suorituskyvyn tiettyjen tehtävien suorittamisessa. Microsoftin Phi-sarja osoitti, että 2,7 miljardin parametrin malli voi kilpailla kymmenkertaisen kokonsa mallien kanssa. Metan LLaMA osoitti, että 7 miljardin parametrin mallit voivat toimia poikkeuksellisesti, kun ne on koulutettu oikein. Nämä kehityssuunnat edustavat perustavaa muutosta ymmärryksestämme tekoälyn tehokkuudesta.

Tämä paradigman muutos on merkittäviä vaikutuksia siihen, miten tekoälyä käytetään ja toimii. Pienet mallit voivat toimia kuluttajien laitteilla, käsitellä pyynnöt nopeammin ja kuluttaa murto-osan siitä energiasta, jota suuret mallit vaativat. Ne tekevät tekoälystä saatavilla organisaatioille, jotka eivät voi maksaa massiivisia laskentainfrastruktuureja. Ennen kaikkea ne haastavat tekoälyn kehittämisen monopoliomaiset tendenssit, joissa vain yritykset, joilla on valtavat resurssit, voivat kilpailla.

Tehokkaan tekoälyarkkitehtuurin nousu

Pieni mallin vallankumous perustuu sofistikoituneisiin insinöörintekniikoihin, jotka maksimoivat suorituskyvyn rajoitettujen parametrirajakokojen sisällä. Nämä mallit käyttävät edistyneitä tekniikoita, kuten tietämyksen tiivistämistä, jossa pienemmät “oppilas” -mallit oppivat suuremmista “opettaja” -malleista, ja ne kaappaavat olennaisen tiedon dramaattisesti vähentäen laskentavaatimuksia.

Microsoftin Phi-4 -sarja edustaa tätä lähestymistapaa. Phi-4 -päätöksentekomalli, jossa on vain 14 miljardia parametreja, kilpailee malleja, jotka ovat viisi kertaa sen kokoisia, matemaattisessa päättelyssä ja loogisissa ongelmanratkaisutehtävissä. Samoin Google Gemma 3 270M -malli osoittaa, että 270 miljoonan parametrin malli voi toimia vahvassa ohjeiden seuraamisessa ja toimia erinomaisena perustana hienosäätöön.

Metan Llama 3.2 1B -malli on toinen läpimurto pienien mallien tehokkuudessa. Strukturoidun lohkaisun ja tietämyksen tiivistämisen kautta suuremmista Llama-malleista se ylläpitää merkittävää suorituskykyä toimien tehokkaasti reunalaiteilla. Nämä mallit osoittavat, että arkkitehtuuri-innovaatiot ja koulutusmenetelmät ovat tärkeämpiä kuin parametrilaskenta monissa todellisissa sovelluksissa.

Mixture of experts -arkkitehtuuri on merkittävä läpimurto tehokkaassa tekoälysuunnittelussa. Sen sijaan, että kaikki parametrit käytettäisiin jokaisessa tehtävässä, nämä mallit aktivoivat vain olennaiset erikoistuneet komponentit. Ne ohjaavat eri kyselyjä erikoistuneisiin aliverkkoihin, ylläpitäen laajaa kykyä käyttäen vähemmän aktiivisia parametreja kulloisenkin hetken aikana. Mistral AI:n Mixtral 8x7B -malli osoittaa tämän lähestymistavan tehokkaasti. Vaikka siinä on 47 miljardia parametreja yhteensä, se aktivoi vain 13 miljardia parametreja kyselykohtaisesti, saavuttaen suorituskyvyn, joka on vertailukelpoinen suurempien tiheiden mallien kanssa, ylläpitäen nopeamman inference-nopeuden.

Kvantifiointitekniikat ovat myös vaikuttaneet merkittävästi pienien mallien tehokkuuden lisäämiseen. Mallipainojen edustamisella vähemmällä bittimäärällä tutkijat voivat kutistaa malleja ylläpitäen tarkkuutta. Nykyaikaiset kvantifiointimenetelmät voivat vähentää mallin kokoaan 75 prosentilla vähäisellä suorituskyvyn menetyksellä. Microsoftin Phi-3-mini on osoittanut tämän lähestymistavan tehokkuuden. Kun se on kvantisoitu 4-bittisen tarkin, se ylläpitää yli 95 prosenttia alkuperäisestä suorituskyvystään vähentäen muistivaatimuksia 7 GB:sta alle 2 GB:iin, mikä tekee siitä erityisesti käytännöllisen mobiililaitteissa.

Erikoistuminen voittaa yleistymisen

Pieni mallin vallankumous paljasti tärkeän totuuden tekoälyn käytöstä. Useimmat todelliset sovellukset eivät tarvitse mallia, joka voi kirjoittaa runoutta, ratkaista kalkyylia tai keskustella filosofiasta. Niille tarvitaan malleja, jotka erinomaisesti suorittavat tiettyjä tehtäviä. Asiakaspalveluchatbotti ei tarvitse tietää Shakespearea. Koodin täydentämistyökalu ei tarvitse lääketieteellistä tietämystä. Tämä havainto siirsi fokuksen yleisten mallien rakentamisesta erikoistuneiden mallien luomiseen.

Alakohtainen koulutus sallii pienien mallien keskittää rajoitetun kapasiteettinsa olennaiseen tietämykseen. 3 miljardin parametrin malli, joka on koulutettu yksinomaan oikeudellisissa asiakirjoissa, voi ylittää 70 miljardin parametrin yleisen mallin oikeudellisissa tehtävissä. Erikoistunut malli oppii syvempiä malleja omassa alallaan eikä jaksa kapasiteettiaan lukuisiin epäolennaisiin aiheisiin. Se on kuin verrataan erikoislääkäriä yleislääkäriin monimutkaisiin toimenpiteisiin.

Hienosäätöstrategiat ovat muodostuneet yhä sofistikoituneemmiksi. Sen sijaan, että mallit koulutettaisiin alusta alkaen, kehittäjät aloittavat pienillä perusmalleilla ja sovittavat ne tiettyihin tarpeisiin. Tämä lähestymistapa vaatii vähäisiä laskentaresursseja tuottaen erittäin kykeneviä erikoistuneita malleja. Organisaatiot voivat nyt luoda mukautettuja tekoälyratkaisuja ilman massiivisia infrastruktuurisijoituksia.

Murtauduttua suorituskyvyn kattoon

Viimeaikaiset benchmarkit paljastavat yllättäviä suorituskykyetuja pienille malleille tietyissä aloissa. AI2:n Olmo 2 1B -malli ylittää samankokoisia malleja suurista teknologiayrityksistä luonnollisen kielen ymmärtämisessä. Microsoftin Phi-4-mini-flash-reasoning saavuttaa jopa 10-kertaisen läpäisynopeuden 2-3-kertaisella vähäisemmällä viiveellä verrattuna perinteisiin päätöksentekomalleihin ylläpitäen matemaattisen päättelyn kyvyt.

Suorituskykyero tulee vielä selkeämmäksi, kun tarkastellaan tehtäväkohtaisia sovelluksia. Pienet mallit, jotka on hienosäätelty erikoistuneille aloille, ylittävät johdonmukaisesti yleispätevien suurten mallien tarkkuuden ja olennaisuuden. Sairaanhoidon sovellukset, oikeudellisten asiakirjojen analyysi ja asiakaspalvelun toteutukset osoittavat erityisesti vaikuttavia tuloksia, kun pienet mallit on koulutettu alakohtaisiin tietokantoihin.

Tämä suorituskykyetu johtuu kohdennetusta koulutuslähestymistavasta. Sen sijaan, että oppisivat laajaa mutta pintapuolista tietämystä lukuisilla aloilla, pienet mallit kehittävät syvää asiantuntemusta kohdennetuilla aloilla. Tuloksena on luotettavampi, kontekstuaalisesti sovelias vastaus tietyille käyttötarkoituksille.

Nopeus- ja tehokkuusetu

Suorituskyky ei ole vain tarkkuuden suhteen. Se on myös nopeuden, kustannusten ja ympäristövaikutuksen suhteen. Pienet mallit erinomaisesti näissä ulottuvuuksissa. Pieni malli voi tuottaa vastauksia millisekunteina, kun suuret mallit vievät sekunteja. Tämä nopeusero saattaa näyttää vähäiseltä, mutta se tulee kriittiseksi sovelluksissa, jotka vaativat reaaliaikaisia vuorovaikutuksia tai käsittelevät miljoonia pyynnöksiä.

Energiankulutus on toinen kriittinen ulottuvuus. Suuret mallit vaativat massiivisia tietokeskuksia ja sofistikoituneita jäähdytysjärjestelmiä. Jokainen kysely kuluttaa merkittävän määrän sähköä. Pienet mallit voivat toimia standardilaitteilla tai jopa henkilökohtaisilla tietokoneilla käyttäen murto-osan energiasta. Kun organisaatiot kohtaavat paineita vähentää hiilijalanjälkeään, pienien mallien ympäristöetua tulee yhä tärkeämmäksi.

Reunatoteutus on ehkä pienien mallien muuntavin ominaisuus. Nämä mallit voivat toimia suoraan puhelimilla, kannettavilla tietokoneilla tai IoT-laitteilla ilman internetyhteyttä. Kuvittele lääketieteellisiä diagnostiikkatyökaluja, jotka toimivat etäalueilla ilman internetyhteyttä, tai reaaliaikaisia käännöslaitteita, jotka eivät tarvitse pilvipalveluja. Pienet mallit tekevät nämä skenaariot mahdollisiksi, tuoden tekoälyominaisuudet miljardeille laitteille maailmanlaajuisesti.

Tietosuojaa koskevat huolenaiheet suosivat myös pieniä malleja. Kun tekoäly toimii paikallisesti laitteilla, arkaluontoista tietoa ei koskaan jää laitteen ulkopuolelle. Sairaanhoitopalvelut voivat analysoida potilastietoja ilman, että ne ladataan pilvipalveluihin. Rahoituslaitokset voivat käsitellä transaktioita ilman, että asiakastietoja paljastetaan ulkoisille järjestelmille. Tämä paikallinen prosessointikapasiteetti ratkaisee yhden tärkeimmistä tekoälyn omaksumisen ongelmista herkkien alojen osalta.

Yhteenveto

Pienien tekoälymallien nousu haastaa uskomuksen, että suuremmat mallit aina tarjoavat paremman suorituskyvyn. Pienet, tiiviit mallit, joissa on vähemmän parametreja, ovat nyt vastaamassa tai jopa ylittämässä suurempia malleja tietyissä tehtävissä käyttäen tekniikoita kuten tietämyksen tiivistämistä, kvantifiointia ja erikoistumista. Tämä muutos tekee tekoälystä helpommin saatavilla sallien nopeamman ja energiatehokkaamman käytön arkipäivän laitteilla. Se myös vähentää kustannuksia, laskkee ympäristövaikutusta ja parantaa tietosuojaa mahdollistaen paikallisen toteutuksen. Keskittymällä tehokkaisiin, tehtäväkohtaisiin malleihin sen sijaan, että rakennettaisiin massiivisia yleispäteviä järjestelmiä, tekoälystä tulee käytännöllisempää, edullisempaa ja hyödyllisempää sekä organisaatioille että yksilöille.