Tekoäly

Hämmästyttävä määrittely ‘Deepfaken’

Vakuuttava uusi tutkimus Saksasta arvostelee EU:n tekoälylain EU AI Actin määrittelyä termejä ‘deepfake’ liian epämääräiseksi, erityisesti digitaalisen kuvamanipulaation kontekstissa. Tutkimuksen tekijät väittävät, että lain painopiste sisällön muistuttaa oikeita ihmisiä tai tapahtumia – mutta mahdollisesti näyttäen epäaidolta – puuttuu selkeää määrittelyä.

He korostavat myös, että lain poikkeukset ‘standardoituneesta editoinnista’ (ts. oletettavasti vähäisiin muutoksiin kuvissa) eivät huomioi sekä tekoälyn laajaa vaikutusta kuluttajasovelluksissa että taiteellisten konventioiden subjektiivista luonnetta, jotka edeltävät tekoälyn kehitystä.

Epätarkat lait näiden asioiden suhteen johtavat kahteen tärkeään riskiin: ‘jäähdytysvaikutukseen’, jossa lain laaja tulkintakelpoisuus tukahduttaa innovaation ja uusien järjestelmien omaksumisen; ja ‘laittomuusvaikutukseen’, jossa laki on lailla huomioon otettava tai merkityksettömyys.

Molemmissa tapauksissa epämääräiset lait siirtävät vastuun käytännön oikeudellisten määrittelyjen vahvistamisesta tuleviin oikeuden päätöksiin – varovainen ja riskien karttaminen lainsäädäntölähestymistapa.

Tekoälypohjaiset kuvamanipulaatioteknologiat ovat edelleen merkittävästi lainsäädännön kyvyn osoittaa niitä.

Esimerkiksi yksi merkittävä esimerkki tekoälyohjatun ‘automaattisen’ jälkikäsittelyn käsitteen kasvavasta joustavuudesta, tutkimus huomauttaa, on ‘Scene Optimizer’ -funktio uusimmissa Samsung-kameroissa, joka voi korvata käyttäjän ottaman kuvan kuusta (haastava aihe), tekoälyohjatulla, ‘hienostuneella’ kuvalla:

<img class=" wp-image-210152" src="https://www.unite.ai/wp-content/uploads/2024/12/samsung-moon-photo.jpg" alt="Ylävasen, esimerkki uudesta tutkimuksesta oikeasta käyttäjän ottamasta kuvasta kuusta, vasemmalla Samsungin parannetusta versiosta, joka on luotu automaattisesti Scene Optimizerin avulla; Oikea, Samsungin virallinen kuvitus prosessin taustalla; alavasen, esimerkit Reddit-käyttäjältä u/ibreakphotos, jotka osoittavat (vasemmalla) tarkoituksella sumennetun kuvan kuusta ja (oikealla) Samsungin uudelleenluomisen tätä kuvaa – vaikka alkuperäinen kuva oli kuva näytöstä, eikä oikeasta kuusta. Lähteet (ympyrä vasemmalta yläkulmasta): https://arxiv.org/pdf/2412.09961; https://www.samsung.com/uk/support/mobile-devices/how-galaxy-cameras-combine-super-resolution-technologies-with-ai-to-produce-high-quality-images-of-the-moon/; https:/reddit.com/r/Android/comments/11nzrb0/samsung_space_zoom_moon_shots_are_fake_and_here/

Alhaalla olevassa kuvassa yllä, näemme kaksi kuvaa kuusta. Vasemmalla oleva kuva on valokuva otettu Reddit-käyttäjän toimesta. Tässä kuvassa on tarkoituksella sumennettu ja pienennetty käyttäjän toimesta.

Oikealla näemme kuvan samasta heikennetystä kuvasta, joka on otettu Samsung-kameralla, jossa on tekoälyohjattu jälkikäsittely käytössä. Kamera on automaattisesti ‘parannellut’ tunnistetun ‘kuu’-kohteen, vaikka se ei ollut oikea kuu.

Tutkimus esittää syvemmän arvostelun Best Take -ominaisuudesta, joka on sisällytetty Googleen viimeaikaisiin älypuhimiin – kiistanalainen tekoälyominaisuus, joka editoi ‘parhaat’ osat ryhmäkuvasta, skannaamalla useita sekunteja valokuvausjärjestelmää, jotta hymyt voivat siirtyä eteen- tai taaksepäin ajan suhteen tarpeen mukaan – eikä kukaan näytä olevan keskellä räpäyttämistä.

Tutkimus väittää, että tällaisen komposiittiprosessin on mahdollista vääristää tapahtumia:

‘[Yleisessä] ryhmäkuvan ottamistilanteessa keskivertokäyttäjä luultavasti pitäisi tulosta aidona valokuvana. Hymy, joka on lisätty, on olemassa muutaman sekunnin päästä valokuvan ottamisesta.

‘Toisaalta, parhaan otteen 10 sekunnin aikajänne on riittävä mielentilan muutokseen. Henkilö saattaa lopettaa hymyilyn, kun loput ryhmästä nauraa jonkin vitsin kustannuksella.

‘Seurauksena, oletamme, että tällainen ryhmäkuva voi hyvin muodostaa deep faken.’

Uusi tutkimus on otsikoitu Mikä muodostaa Deep Faken? Epiteitä raja välillä legitimeistä prosessoinnista ja manipulaatiosta EU:n tekoälylaissa, ja se tulee kahdelta tutkijalta Computational Law Labista Tübingenin yliopistosta ja Saarlandin yliopistosta.

Vanhat Temput

Ajan manipulointi valokuvauksessa on paljon vanhempi kuin kuluttajatasoinen tekoäly. Tutkimuksen tekijät huomauttavat, että vanhemmat tekniikat voidaan väittää ‘epäaidoiksi’, kuten useiden peräkkäisten kuvien yhdistäminen High Dynamic Range (HDR) -kuvaan tai ‘ompelemaan’ panoraamakuvaksi.

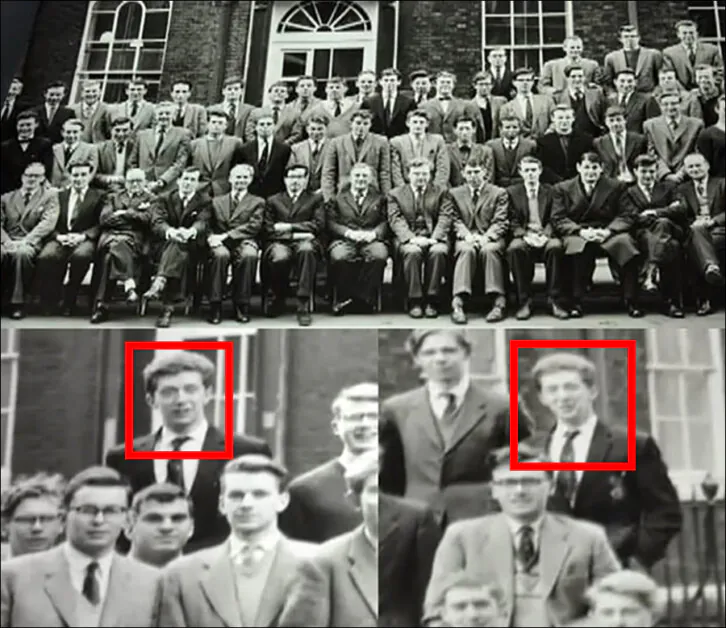

Todellakin joistakin vanhimmista ja hauskimmista valokuvaväärennöksistä luotiin perinteisesti koululaisilla juostessaan yhden puolen koulu ryhmästä toiselle, ennen erityisten panoraamakameroita, jotka olivat aikoinaan käytössä urheilu- ja kouluryhmävalokuvauksessa – mahdollistaen oppilaan näyttäytyä kahdesti samassa kuvassa:

Houkutus temppuilla panoraamakameroita ryhmäkuvissa oli liian suuri monille oppilaille, jotka olivat valmiit riskiin huonon päättäjän toimistossa voidakseen ‘kloonata’ itsensä koulukuvissa. Lähde: https://petapixel.com/2012/12/13/double-exposure-a-clever-photo-prank-from-half-a-century-ago/

Ellei oteta valokuvaa RAW-tilassa, joka periaatteessa kaataa kameran linssin anturin hyvin suurelle tiedostolle ilman mitään tulkintaa, on todennäköistä, että digitaaliset valokuvat eivät ole täysin aidoita. Kamerajärjestelmät soveltavat säännöllisesti ‘parannus’ -algoritmejä, kuten kuvan terävöittämistä ja valkotasapainoa, oletusarvoisesti – ja ovat tehneet niin kuluttajatasoisen digitaalisen valokuvauksen alusta alkaen.

Tutkimuksen tekijät väittävät, että nämä vanhemmat valokuvan parannustavat eivät edusta ‘todellisuutta’, koska nämä menetelmät on suunniteltu tekemään valokuvista miellyttävämpiä, ei ‘aidompia’.

Tutkimus ehdottaa, että EU:n tekoälylaki, jopa myöhempien muutosten, kuten johdanto 123-127, asettaa kaiken valokuvauksen todistus -kehykseen, joka ei sovellu kontekstiin, jossa valokuvat tuotetaan nykyään, verrattuna (nominatiivisesti objektiiviseen) turvallisuuskameran kuvausmateriaaliin tai oikeudelliseen valokuvaukseen. Useimmat EU:n tekoälylaissa käsitellyt kuvat ovat todennäköisemmin peräisin konteksteista, joissa valmistajat ja verkkopalvelut aktiivisesti edistävät luovaa valokuvatulkintaa, mukaan lukien tekoälyn käyttö.

Tutkijat ehdottavat, että valokuvat ‘eivät ole koskaan olleet objektiivinen kuvaus todellisuudesta’. Seikat, kuten kameran sijainti, valittu syvyysterävyys ja valinta valaistuksesta, kaikki vaikuttavat tekemään valokuvasta syvästi subjektiivisen.

Tutkimus huomauttaa, että rutiininomaiset ‘siivous’ -tehtävät – kuten poistaminen sensorin pölyä tai ei-toivottuja voimajohtoja muuten hyvin koostetusta kohtauksesta – olivat vain puolivirallisesti automatisoitu ennen tekoälyn nousua: käyttäjien piti manuaalisesti valita alue tai käynnistää prosessi saadakseen haluamansa lopputuloksen.

Nykyään nämä toiminnot laukaistaan usein käyttäjän tekstikomentojen kautta, erityisesti työkaluissa kuten Photoshop. Kuluttajatasolla nämä ominaisuudet ovat yhä enenevissä määrin automaattisia ilman käyttäjän syötettä – tulos, jota valmistajat ja palveluntarjoajat näyttävät pitävän ‘ilmeisesti toivottavana’.

Deepfaken Dilatoitunut Merkitys

Yksi keskeinen haaste tekoälymuokatun ja tekoälyluodun kuvastoon liittyvässä lainsäädännössä on ‘deepfaken’ epämääräisyys, joka on laajentunut merkittävästi viimeisten kahden vuoden aikana.

Alun perin termejä sovellettiin ainoastaan video tuloksiin autoencoder-pohjaisista järjestelmistä, kuten DeepFaceLab ja FaceSwap, jotka perustuivat anonyymien koodien lähetyksiin Redditissä vuoden 2017 lopulla.

Vuodesta 2022 alkaen Latent Diffusion Models (LDMs) kuten Stable Diffusion ja Flux, sekä teksti-videojärjestelmät kuten Sora, mahdollistivat identiteetin vaihtamisen ja mukauttamisen, parannetulla resoluutiolla, joustavuudella ja uskottavuudella. Nyt oli mahdollista luoda difuusiopohjaisia malleja, jotka voivat esittää julkkiksia ja poliitikkoja. Koska ‘deepfake’ -termi oli jo otsikoiden aarre media-tuottajille, se laajennettiin kattamaan nämä järjestelmät.

Myöhemmin sekä mediassa että tutkimuskirjallisuudessa termi tuli myös sisältämään tekstipohjaisen henkilöllisyyden. Tähän vaiheeseen mennessä ‘deepfaken’ alkuperäinen merkitys oli melkein kadonnut, kun taas laajennettu merkitys oli jatkuvasti kehittymässä ja yhä enenevissä määrin dilatoitunut.

Mutta koska sana oli niin tulenarka ja voimakas, ja oli nyt voimakas poliittinen ja media viitekehys, se osoittautui mahdottomaksi antaa periksi. Se houkutteli lukijoita verkkosivuille, rahoitusta tutkijoille ja huomiota poliitikoille. Tämä lekseeminen epämääräisyys on uuden tutkimuksen pääpainopiste.

Kuten tutkijat huomauttavat, EU:n tekoälylain 3(60) artikla määrittää neljä ehtoa, jotka määrittävät ‘deepfaken’.

1: Tosi Kuu

Ensinnäkin, sisältö on luotu tai muokattu, ts. joko luotu alusta alkaen tekoälyllä (luonti) tai muokattu olemassa olevasta datasta (muokkaus). Tutkimus korostaa vaikeutta erottaa ‘hyväksyttävien’ kuvankäsittelytuloksia manipuloivista deepfakeista, ottaen huomioon, että digitaaliset valokuvat ovat joka tapauksessa aina todellisuuden objektiivisia edustuksia.

Tutkimus väittää, että Samsungin luoma kuu on väittäen aidosti, koska kuu ei todennäköisesti muuta ulkonäköään, ja koska tekoälyllä luotu sisältö, joka on koulutettu oikeiden kuukuvilla, on todennäköisesti tarkin.

Kuitenkin tutkijat toteavat myös, että koska Samsung-järjestelmä on osoittanut pystyvänsä luomaan ‘parannellun’ kuvan kuusta tapauksessa, jossa alkuperäinen kuva ei ollut itse kuu, tämä olisi katsottava ‘deepfakeksi’.

Olisi epäkäytännöllistä laatia kattava luettelo eroavaisista käyttötavoista tällaisen ad hoc -toiminnallisuuden ympärillä. Sen vuoksi määrittelyn taakka vaikuttaa siirtyvän jälleen kerran oikeuden päätöksiin.

2: Tekstifaket

Toiseksi, sisältö on muodossa kuva, ääni tai video. Tekstisisältö, vaikka se on altis muiden avoimuuden velvollisuuksille, ei katsota deepfakeksi tekoälylaissa. Tätä ei käsitellä tarkemmin uudessa tutkimuksessa, vaikka se voi vaikuttaa näkyvien deepfaken tehokkuuteen (ks. alla).

3: Todelliset Ongelmat

Kolmanneksi, sisältö muistuttaa olemassa olevia henkilöitä, esineitä, paikkoja, yhteisöjä tai tapahtumia. Tämä ehdot määrittää yhteyden todelliseen maailmaan, tarkoittaen, että pelkästään keksitty kuvamateriaali, vaikka se on fotorealistista, ei kelpaa deepfakeksi. Johdanto 134 EU:n tekoälylaissa korostaa ‘muistuttavuuden’ osan lisäämällä sanan ‘huomattavasti’ (ilmeinen viittaus myöhempään oikeudelliseen arvioon).

Tutkijat, jotka siteeraavat aiempaa tutkimusta, pohtivat, tarvitseeko tekoälyllä luotu kasvo kuulua oikeaan henkilöön, vai tarvitseeko se olla vain riittävän samankaltainen oikeaan henkilöön, jotta se täyttäisi tämän määrittelyn.

Esimerkiksi, miten voimme määrittää, onko tekoälyllä luotu jono fotorealistisia kuvia, jotka esittävät poliitikko Donald Trumpia, aito vai ei, jos kuvat (tai liitetyt tekstit) eivät mainitse häntä nimenomaisesti? Kasvontunnistus? Käyttäjän kyselyt? Tuomarin ‘järjenmukainen’ määrittely?

Palatessa ‘Tekstifaket’ -asiaan (ks. yllä), sanat muodostavat usein merkittävän osan näkyvän deepfaken toiminnasta. Esimerkiksi on mahdollista ottaa (muuttamaton) kuva tai video ‘henkilö a‘ ja sanoa, kuvatekstissä tai sosiaalisen median julkaisussa, että kuva on ‘henkilö b‘ (olettaen, että kaksi henkilöä muistuttaa toisiaan).

Tällaisessa tapauksessa ei tarvita tekoälyä, ja tulos voi olla hämmästyttävän tehokas – mutta kelpaako tällainen matalatekniikka ‘deepfakeksi’?

4: Retouch, Remodel

Lopuksi, sisältö on näyttäytyy aidolta tai totuudenmukaiselta ihmisille. Tämä ehdot korostaa ihmisten havaintoa. Sisältö, joka tunnetaan ainoastaan edustavan oikeaa henkilöä tai esinettä algoritmilla, ei katsota deepfakeksi.

Kaikista 3(60) ehdosta tämä on selvästi siirtynyt myöhempään oikeuden arvioon, koska se ei salli tulkintaa teknisen tai mekaanisen välineen kautta.

On selvästi joitakin sisäänrakennettuja vaikeuksia saavuttaa yksimielisyys tämänkaltaisen subjektiivisen ehdotuksen suhteen. Tutkijat huomauttavat esimerkiksi, että eri ihmiset ja erilaiset ihmisryhmät (kuten lapset ja aikuiset) voivat olla eri tavoin alttiita uskoa tiettyyn deepfakeen.

Tutkijat toteavat myös, että edistyneet tekoälyominaisuudet työkaluissa kuten Photoshop haastavat perinteiset ‘deepfaken’ määrittelyt. Vaikka nämä järjestelmät voivat sisältää perustason suojausvarusteita kiistanalaisia tai kiellettyjä sisältöjä vastaan, ne laajentavat dramatisesti ‘retouching’ -käsitteen. Käyttäjät voivat nyt lisätä tai poistaa esineitä hyvin vakuuttavalla ja fotorealistisella tavalla, saavuttaen ammattitason aidoissa, joka määrittää uudelleen kuvamanipulaation rajat.

Tutkijat toteavat:

‘Väitämme, että nykyinen deepfaken määrittely tekoälylaissa ja vastaavat velvollisuudet eivät ole riittävän määriteltyjä vastaamaan deepfaken asettamiin haasteisiin. Analysoimalla digitaalisen valokuvan elinkaarta kameran anturista digitaalisiin editointiominaisuuksiin, havaitsemme, että:

‘(1.) Deepfakes ovat epämääräisiä EU:n tekoälylaissa. Määrittely jättää liian paljon tilaa sille, mitä deepfake on.

‘(2.) On epäselvää, miten editointitoiminnot kuten Googlen “paras otto” -ominaisuus voidaan pitää poikkeuksena avoimuuden velvollisuuksille.

‘(3.) Poikkeus merkittävästi muokatuista kuvista herättää kysymyksiä siitä, mitä muodostaa olennaisen sisällön muokkaamisen ja onko tällainen muokkaus havaittavissa luonnolliselle henkilölle.’

Poikkeus

EU:n tekoälylaki sisältää poikkeukset, jotka tutkijat väittävät olevan hyvin myöntäviä. 50(2) artikla tarjoaa poikkeuksen tapauksissa, joissa alkuperäisen lähdekuvan enemmistö ei ole muutettu. Tutkijat toteavat:

‘Mitä voidaan pitää sisällönä 50(2) artiklan mielessä digitaalisen äänen, kuvien ja videoiden tapauksessa? Esimerkiksi kuvissa onko tarpeen tarkastella pikseliavaruutta vai havainnoitavissa olevaa inhimillistä tilaa? Olennaiset manipulaatiot pikseliavaruudessa eivät välttämättä muuta inhimillistä havaintoa, ja toisaalta, pienet häiriöt pikseliavaruudessa voivat muuttaa havainnon dramaattisesti.’

Tutkijat esittävät esimerkin, jossa lisätään käsiase henkilölle, joka osoittaa jotakuta. Lisäämällä aseen, muutetaan vain 5% kuvasta; kuitenkin muutetun osan semanttinen merkitys on merkittävä. Sen vuoksi näyttää siltä, että tämä poikkeus ei ota huomioon mitään ‘järjenmukaista’ ymmärrystä siitä, miten pieni yksityiskohta voi vaikuttaa kuvan kokonaismerkitykseen.

50(2) artikla sallii myös poikkeukset ‘avustavalle toiminnolle standardoituun editointiin’. Koska laki ei määrittele, mitä ‘standardieditointi’ tarkoittaa, jopa post-prosessointitoiminnot, kuten Googleen ‘Paras otto’, näyttävät olevan suojattuja tämän poikkeuksen nojalla, tutkijat toteavat.

Johtopäätös

Uuden tutkimuksen ilmoitettu tarkoitus on kannustaa monitieteellistä tutkimusta deepfaken sääntelyyn ja toimia aloituspisteenä uusille keskusteluille tietojenkäsittelytieteilijöiden ja oikeustieteilijöiden välillä.

Kuitenkin tutkimus itse joutuu itseensä viittaavaan päättelyyn useissa kohdissa: se usein käyttää ‘deepfake’ -termiä, ikään kuin sen merkitys olisi itsestään selvä, samalla kun se arvostelee EU:n tekoälylakia siitä, että se ei määrittele, mitä deepfake todella on.

Julkaistu ensimmäisen kerran maanantaina, 16. joulukuuta 2024