Tekoäly

Mustan laatikon ongelma LLM:ssä: Haasteet ja nousseet ratkaisut

Koneoppiminen, jonka alaan kuuluu tekoäly, koostuu kolmesta osasta: algoritmeista, koulutusdatasta ja tuloksena olevasta mallista. Algoritmi, joka on perustuu joukkoon menettelyjä, oppii tunnistamaan kuvioita suuresta esimerkkijoukosta (koulutusdata). Tämän koulutuksen tuloksena on koneoppimismalli. Esimerkiksi algoritmi, joka on koulutettu koirien kuvilla, johtaa malliin, joka pystyy tunnistamaan koirat kuvissa.

Musta laatikko koneoppimisessa

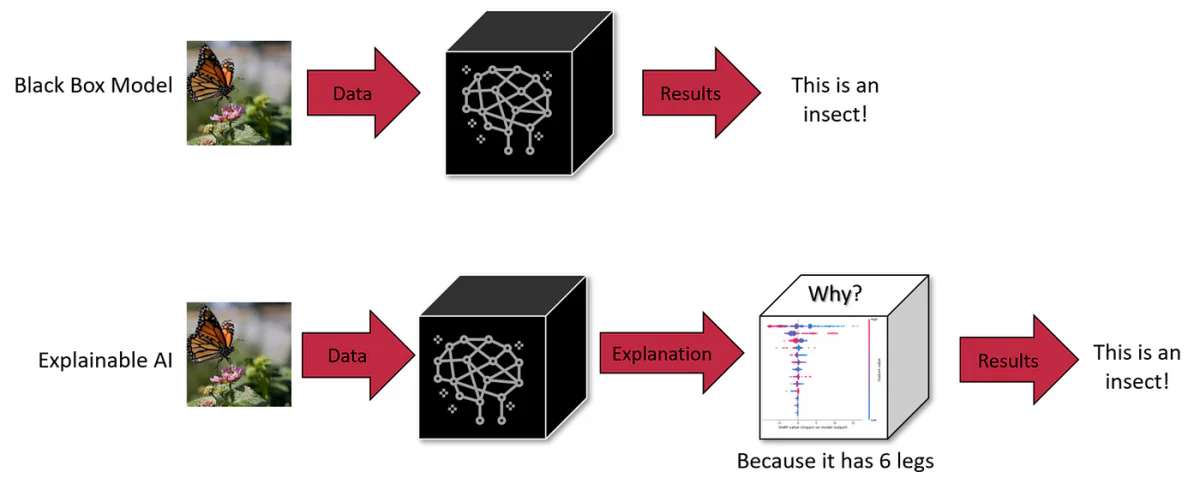

Koneoppimisessa mikä tahansa kolmesta osasta – algoritmi, koulutusdata tai malli – voidaan pitää mustana laatikkona. Vaikka algoritmit ovat usein julkisesti tunnettuja, kehittäjät voivat päättää pitää mallin tai koulutusdatan salassa suojelemaan immateriaalioikeuksia. Tämä epäselvyys tekee haasteelliseksi ymmärtää tekoälyn päätöksentekoprosessia.

Tekoälyn mustat laatikot ovat järjestelmiä, joiden sisäinen toiminta on käyttäjille epäselvää tai näkymätöntä. Käyttäjät voivat syöttää dataa ja vastaanottaa tulosteen, mutta logiikka tai koodi, joka tuottaa tulosteen, on piilossa. Tämä on yleinen ominaisuus monissa tekoälyjärjestelmissä, mukaan lukien edistyneet generatiiviset mallit kuten ChatGPT ja DALL-E 3.

LLM:t, kuten GPT-4, esittävät merkittävän haasteen: niiden sisäinen toiminta on suurelta osin epäselvää, mikä tekee niistä “mustia laatikoita”. Tämä epäselvyys ei ole pelkästään tekninen arvoitus; se aiheuttaa todellisia turvallisuus- ja eettisiä huolenaiheita. Esimerkiksi jos emme voi ymmärtää, miten nämä järjestelmät saavat johtopäätöksiä, voimmeko luottaa niihin kriittisillä aloilla, kuten lääketieteellisissä diagnooseissa tai rahoitusarvioissa?

LIME- ja SHAP-tekniikoiden tutkiminen

Selitettävyys koneoppimisessa (ML) ja syväoppimismalleissa (DL) auttaa meitä näkemään näiden edistyneiden mallien epäselvään sisäiseen toimintaan. Paikalliset selitettävät mallikohtaiset selitykset (LIME) ja SHapley Additiiviset selitykset (SHAP) ovat kaksi tällaista valtavirtaa selitettävyyden tekniikkaa.

LIME, esimerkiksi, hajottaa monimutkaisuuden luomalla yksinkertaisempia, paikallisia korvaavamalleja, jotka approksimoivat alkuperäisen mallin käyttäytymistä tietyssä syötteessä. Tekemällä tämän, LIME auttaa ymmärtämään, miten yksittäiset ominaisuudet vaikuttavat monimutkaisten mallien ennusteisiin, tarjoamalla käytännössä ‘paikallisen’ selityksen sille, miksi malli teki tietyn päätöksen. Se on erityisen hyödyllinen ei-teknisille käyttäjille, koska se kääntää mallien monimutkaisen päätöksentekoprosessin ymmärrettävään muotoon.

SHAP puolestaan ottaa vaikutteita peliteoriasta, erityisesti Shapley-arvojen käsitteestä. Se määrittää ‘tärkeyden’ arvon kullekin ominaisuudelle, osoittaen, miten paljon kunkin ominaisuus vaikuttaa todellisen ennusteen ja perusennusteen (keskiarvon ennuste kaikista syötteistä) väliseen eroon. SHAP:n vahvuus on sen johdonmukaisuudessa ja kyvyssä tarjota globaali näkökulma – se selittää yksittäisiä ennusteita, mutta tarjoaa myös näkymän malliin kokonaisuutena. Tämä on erityisen arvokasta syväoppimismalleissa, joissa kerrosten ja parametrerien runsaus usein tekee ennusteprosessista kuin labyrintin läpikäynnin. SHAP selventää tätä määrittämällä kunkin ominaisuuden vaikutuksen, tarjoamalla selkeämmän kartan mallin päätöksentekoprosesseista.

SHAP (Lähde)

Molemmat LIME ja SHAP ovat nousseet tärkeiksi työkaluiksi tekoälyn ja koneoppimisen alalla, vastaten kriittiseen tarpeeseen läpinäkyvyydestä ja luotettavuudesta. Kun jatkamme tekoälyn integroimista eri sektoreihin, kyky selittää ja ymmärtää nämä mallit tulee olemaan enemmän kuin tekninen välttämättömyys, vaan perustava vaatimus eettiselle ja vastuulliselle tekoälyn kehitykselle. Nämä tekniikat edustavat merkittäviä askelia koneoppimis- ja syväoppimismallien monimutkaisuuksien selvittämisessä, muuttaen ne älyttömistä ‘mustista laatikoista’ ymmärrettäviksi järjestelmiksi, joiden päätökset ja käyttäytyminen voidaan ymmärtää, luottaa ja käyttää tehokkaasti.

LLMien mittakaava ja monimutkaisuus

Näiden mallien mittakaava lisää niiden monimutkaisuutta. Otetaan esimerkiksi GPT-3, jossa on 175 miljardia parametreja, ja uudempia malleja, joissa on biljoonia. Jokainen parametri vaikuttaa monimutkaisesti neuroverkoston sisällä, vaikuttaen emergentteihin kykyihin, joita ei voida ennustaa tarkastelemalla yksittäisiä komponentteja erikseen. Tämä mittakaava ja monimutkaisuus tekevät siitä lähes mahdotonta ymmärtää niiden sisäistä logiikkaa, asettamalla esteen näiden mallien vinoumien tai ei-toivottujen käyttäytymisen diagnosoinnissa.

Mittakaava vastaan selitettävyys

LLMien mittakaavan vähentäminen voisi parantaa selitettävyyttä, mutta seurauksena olisi heikentynyt edistyneitä kykyjä. Mittakaava on se, mikä mahdollistaa käyttäytymisen, jota pienemmät mallit eivät voi saavuttaa. Tämä esittää sisäisen ristiriidan mittakaavan, kykyjen ja selitettävyyden välillä.

LLM:n mustan laatikon ongelman vaikutus

1. Virheellinen päätöksenteko

LLMien, kuten GPT-3 tai BERT, päätöksentekoprosessin epäselvyys voi johtaa havaitsemattomiin vinoumiin ja virheisiin. Alueilla, kuten terveydenhuollossa tai rikosoikeudessa, joissa päätökset vaikuttavat laajasti, kyvyttömyys tarkastaa LLM:iä eettisestä ja loogisesta puolen näkökulmasta on suuri huolenaihe. Esimerkiksi lääketieteellinen diagnosointiin tarkoitettu LLM, joka perustuu vanhentuneeseen tai vinoutuneeseen dataan, voi antaa haitallisia suosituksia. Vastaavasti LLM:t rekrytointiprosesseissa voivat vaivattomasti ylläpitää sukupuolivinoutuneita asenteita. Mustan laatikon luonne ei ainoastaan peitä virheitä, vaan voi myös potentiaalisesti vahvistaa niitä, edellyttäen proaktiivista lähestymistapaa parantamaan läpinäkyvyyttä.

2. Rajattu sopeutuminen moninaisissa konteksteissa

LLMien sisäisen toiminnan puute rajoittaa niiden sopeutumista. Esimerkiksi rekrytointiin tarkoitettu LLM voi olla tehokas arvioimassa ehdokkaita rooliin, jossa arvostetaan käytännön taitoja enemmän kuin akateemisia tutkintoja, johtuen kyvyttömyydestä mukauttaa arviointikriteerejään. Vastaavasti lääketieteellinen LLM voi kamppailla harvinaisten sairauksien diagnosoinnissa johtuen datatasapainotusongelmista. Tämä joustamattomuus korostaa tarvetta läpinäkyvyydelle uudelleenkalibroimaan LLM:iä tiettyihin tehtäviin ja konteksteihin.

3. Vinoumat ja tietämyksen aukot

LLMien laajan koulutusdatan prosessointi on altis rajoituksille, jotka asetetaan niiden algoritmien ja mallirakenteiden kautta. Esimerkiksi lääketieteellinen LLM voi osoittaa demografisia vinoumia, jos se on koulutettu epätasapainoisilla tietojoukoilla. Lisäksi LLM:n taituruus niukasti tunnetuissa aiheissa voi olla harhaanjohtavaa, johtaen yli-ilmoitettuihin, virheellisiin tuloksiin. Näiden vinoumien ja tietämyksen aukkojen korjaaminen vaatii enemmän kuin vain lisää dataa; se edellyttää mallin prosessointimekanismien tarkastelua.

4. Oikeudellinen ja eettinen vastuu

LLMien epäselvyys luo oikeudellisen harmaan alueen vastuun määrittämisessä mahdollisesta vahingosta, jonka niiden päätökset aiheuttavat. Jos lääketieteellinen LLM antaa virheellistä neuvontaa, josta potilas saa vahinkoa, on haasteellista määrittää vastuu mallin epäselvyyden takia. Tämä oikeudellinen epävarmuus asettaa riskejä niille taholle, jotka käyttävät LLM:iä herkillä alueilla, korostaen tarvetta selkeälle hallinnolle ja läpinäkyvyydelle.

5. Luottamuskysymykset herkillä sovelluksilla

LLM:iä, jotka käytetään kriittisillä alueilla, kuten terveydenhuollossa ja rahoituksessa, läpinäkyvyyden puute heikentää niiden luotettavuutta. Käyttäjien ja sääntelijöiden on varmistettava, etteivät nämä mallit sisällä vinoumia tai tee päätöksiä epäoikeudenmukaisilla perusteilla. LLM:ien vinoumien puuttumisen vahvistaminen edellyttää ymmärtämistä niiden päätöksentekoprosesseista, korostaen selitettävyyden tärkeyttä eettiselle käytölle.

6. Riskit henkilökohtaisen datan kanssa

LLM:it vaativat laajaa koulutusdataa, joka voi sisältää herkkää henkilökohtaista tietoa. Näiden mallien musta laatikko luonne herättää huolenaiheita siitä, miten tätä dataa käsitellään ja käytetään. Esimerkiksi lääketieteellinen LLM, joka on koulutettu potilastietojen kanssa, herättää kysymyksiä datan yksityisyydestä ja käytöstä. Henkilökohtaisen datan väärinkäytön estäminen vaatii läpinäkyviä datakäsittelyprosesseja näissä malleissa.

Nousevat ratkaisut selitettävyydelle

Haasteiden ratkaisemiseksi kehitetään uusia tekniikoita. Niihin kuuluvat vastakkaisen tapahtuman (CF) approksimaatiomenetelmät. Ensimmäinen menetelmä käskee LLM:iä muuttamaan tietyn tekstin käsitteen, pitäen muita käsitteitä vakiona. Tämä lähestymistapa on vaikuttava, mutta se on resursseja vaativa johtopäätöksessä.

Toinen lähestymistapa käsittää omistetun upottamistilan luomisen LLM:n johdolla koulutuksen aikana. Tämä tila on suunniteltu vastaamaan kausaaliografiaa ja auttamaan vastakkaisen tapahtuman approksimoinnissa. Tämä menetelmä vaatii vähemmän resursseja testiajassa ja on osoittautunut tehokkaaksi selittämään mallin ennusteita, jopa LLM:issä, joissa on biljoonia parametreja.

Nämä lähestymistavat korostavat kausaaliselitysten tärkeyttä NLP-järjestelmissä turvallisuuden ja luottamuksen varmistamiseksi. Vastakkaisen tapahtuman approksimaatiot tarjoavat tavan kuvitella, miten annettu teksti muuttuisi, jos tietty käsite sen generoivassa prosessissa olisi erilainen, auttaen käytännöllisessä kausaalisessa vaikutuksen arvioinnissa korkean tason käsitteillä NLP-malleissa.

Syvä tarkastelu: Selitysmenetelmät ja kausaalisuus LLM:issä

Tutkiminen ja ominaisuuden tärkeys työkalut

Tutkiminen on tekniikka, jota käytetään selvittämään, mitä sisäisiä edustuksia malleissa koodataan. Se voidaan tehdä joko valvotusti tai valvomattomasti ja on tarkoitettu määrittämään, koodataanko tiettyjä käsitteitä tiettyihin verkon osiin. Vaikka tutkiminen on tehokasta jossain määrin, se jää lyhyeksi tarjoamatta kausaalisia selityksiä, kuten Geiger ym. (2021) korostavat.

Ominaisuuden tärkeys työkalut, toinen selitysmalli, keskittyvät usein syöteominaisuuksiin, vaikka jotkut gradientipohjaiset menetelmät laajentavat tätä piilotettuihin tiloihin. Esimerkki on Integrated Gradients -menetelmä, joka tarjoaa kausaalisen tulkinnan tutkimalla perus- (vastakkainen, CF) syötteitä. Vaikka nämä menetelmät ovat hyödyllisiä, ne kamppailevat yhä yhdistämällä analyysinsa todellisiin käsitteisiin yksinkertaisten syöteominaisuuksien ulkopuolella.

Interventioon perustuvat menetelmät

Interventioon perustuvat menetelmät käsittävät syötteiden tai sisäisten edustusten muuttamista mallin käyttäytymisen tutkimiseksi. Nämä menetelmät voivat luoda vastakkaisia tiloja kausaalisten vaikutusten arvioimiseksi, mutta ne usein luovat epätodennäköisiä syötteitä tai verkon tiloja, ellei niitä ohjata tarkkaan. Kausaalinen Välittäjämalli (CPM), joka on saanut vaikutteita S-oppimisen käsitteestä, on uusi lähestymistapa, joka jäljittelee selitettävän mallin käyttäytymistä vastakkaisissa syötteissä. Kuitenkin tarve erillisestä selittäjästä kullekin mallille on suuri rajoitus.

Vastakkaisen tapahtuman approksimointi

Vastakkaiset tapahtumat ovat laajasti käytettyjä koneoppimisessa datan täydentämiseen, joka käsittää eri tekijöiden tai merkintöjen muutoksia. Nämä voidaan luoda manuaalisesti, heuristisilla avain-sanamuutoksilla tai automaattisella tekstin uudelleenkirjoittamisella. Vaikka manuaalinen muokkaus on tarkin, se on myös resursseja vaativaa. Avain-pohjaiset menetelmät ovat rajoittuneita, ja generatiiviset lähestymistavat tarjoavat tasapainon sujuvuuden ja kattavuuden välillä.

Uskolliset selitykset

Uskollisuus selityksissä viittaa mallin sisäisen päättelyprosessin tarkan kuvaamiseen. On olemassa useita metriikkoja, kuten Herkkyys, Jatkuvuus, Ominaisuuden tärkeys yhtenäisyys, Robustius ja Simuloitavuus. Useimmat näistä menetelmistä keskittyvät ominaisuustasolle selityksiin ja usein sekoittavat korrelaation ja kausaalisuuden. Työmme pyrkii tarjoamaan korkean tason käsitteellisiä selityksiä hyödyntämällä kausaalisuuden kirjallisuutta ehdottamaan intuitiivista kriteeriä: Järjestyksessä uskollisuus.

Olemme tutkineet LLM:ien sisäisiä monimutkaisuuksia, ymmärtäen niiden ‘mustan laatikon’ luonteen ja siitä aiheutuvat merkittävät haasteet. Vaaroista, joita virheellinen päätöksenteko aiheuttaa herkillä aloilla, kuten terveydenhuollossa ja rahoituksessa, eettisiin ongelmiin, jotka liittyvät vinoumiin ja reiluuteen, LLM:ien läpinäkyvyyden tarve on kaikkien aikojen suurin.

LLM:ien ja niiden integroinnin tulevaisuus arkipäiväiseen elämään ja kriittisiin päätöksentekoprosesseihin riippuu kyvystämme tehdä nämä mallit ei ainoastaan edistyneemmiksi, vaan myös ymmärrettäviksi ja vastuullisiksi. Selitettävyyden ja tulkitettavuuden tavoittelu ei ole pelkästään tekninen pyrkimys, vaan perustava osa tekoälyjärjestelmien luottamuksen rakentamista. Kun LLM:t tulevat yhä enemmän osaksi yhteiskuntaa, läpinäkyvyyden vaatimus kasvaa, ei ainoastaan tekoälypraktikoiden vaan jokaisen käyttäjän taholta, jotka vuorovaikuttavat näiden järjestelmien kanssa.