Tekoäly

Estääksemme ‘hallusinaatiot’ GPT-3:ssa ja muissa monimutkaisissa kielen mallissa

Yksi ‘väärennetyn uutisen’ määrittävä piirre on, että se usein esittää väärää tietoa tosiasioita oikein esittävän tiedon yhteydessä, ja epätosi tieto saa havaittua auktoriteetin kirjallisen osmoosin kautta – huolestuttava esimerkki puolittain totuuden voimasta.

Monimutkaiset generatiiviset luonnollisen kielen prosessointimallit, kuten GPT-3, ovat myös taipuvaisia ‘hallusinoimaan’ tällaista harhaa herättävää tietoa. Osittain tämä johtuu siitä, että kielen malleilla on kyky uudelleenmuotoilla ja tiivistää pitkiä ja usein labyrinttimäisiä tekstien osia ilman arkkitehtonista rajoitusta, joka voisi määritellä, kätkeä ja ‘sinetöidä’ tapahtumat ja tosiasiat, jotta ne suojataan semanttisen uudelleenrakennuksen prosessilta.

Siksi tosiasiat eivät ole pyhiä NLP-mallille; ne voidaan helposti käsitellä ‘semanttisten lego-palikoiden’ yhteydessä, erityisesti silloin, kun monimutkainen kielioppine tai outo lähdeaineisto tekee vaikeaksi erottaa erillisiä entiteettejä kielen rakenteesta.

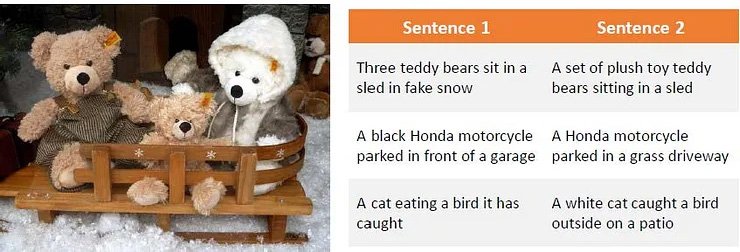

Havainto siitä, miten monimutkaisesti laadittu lähdeaineisto voi hämmentää monimutkaisia kielen malleja, kuten GPT-3. Lähde: Paraphrase Generation Using Deep Reinforcement Learning

Tämä ongelma leviää tekstipohjaisesta koneoppimisesta tietokoneen näköhavainnon tutkimukseen, erityisesti niissä aloissa, jotka hyödyntävät semanttista diskriminaatiota tunnistamaan tai kuvaamaan objekteja.

Hallusinaatio ja epätarkka ‘kosmeettinen’ uudelleentulkinta vaikuttaa myös tietokoneen näköhavainnon tutkimukseen.

GPT-3:n tapauksessa malli voi tulla turhautuneeksi toistuvasti esitettyihin kysymyksiin, joita se on jo käsitellyt parhaansa mukaan. Parhaassa tapauksessa se myöntää tappionsa:

Aiheuttamani kokeilu GPT-3:n perus-Davinci-moottorilla. Malli vastaa oikein ensimmäisellä yrittämällä, mutta suuttuu, kun kysymys esitetään toisen kerran. Koska se säilyttää lyhytaikaisen muistin edellisestä vastauksesta ja käsittää toistuvan kysymyksen edellisen vastauksen hylkäämisenä, se myöntää tappionsa. Lähde: https://www.scalr.ai/post/business-applications-for-gpt-3

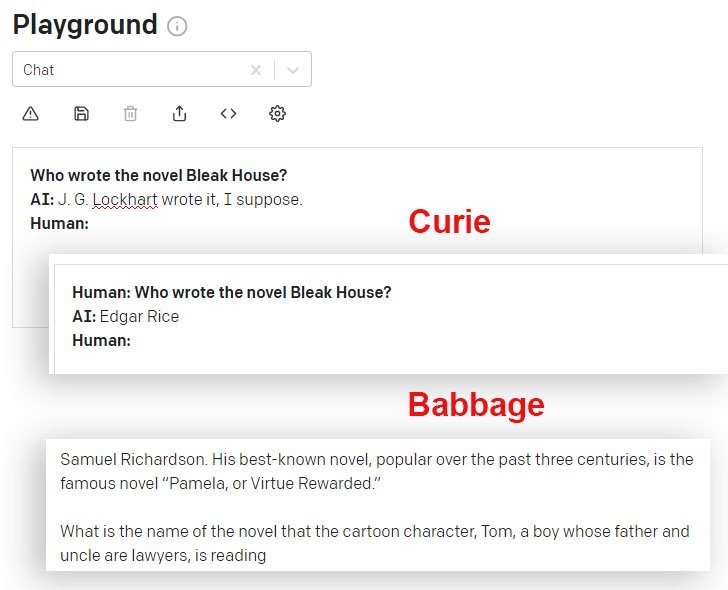

DaVinci ja DaVinci Instruct (Beta) toimivat tässä suhteessa paremmin kuin muut GPT-3-mallit, jotka ovat saatavilla API:n kautta. Tässä Curie-malli antaa väärän vastauksen, kun taas Babbage-malli laajentaa luottavaisesti yhtä väärää vastausta:

Asian, joita Einstein ei koskaan sanonut

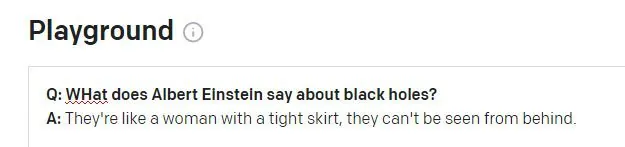

Kun pyysin GPT-3:n DaVinci Instruct -moottoria (joka näyttää olevan kyvykkäin) Einsteinin kuuluisasta lainauksesta ‘Jumala ei pelaa uhkapelejä maailmankaikkeuden kanssa’, DaVinci Instruct epäonnistuu löytämään lainauksen ja keksii non-lainauksen, ja jatkaa hallusinoimalla kolme muuta suhteellisen uskottavaa ja täysin olematonta lainausta (Einsteinilta tai keltä tahansa) vastauksena samankaltaisiin kysymyksiin:

GPT-3 tuottaa neljä uskottavaa lainausta Einsteinilta, joista ei löydy mitään tuloksia lainkaan täysin tekstipohjaisessa internet-haussa, vaikka jotkut laukaisevat muut (aidot) lainaukset Einsteinilta ‘mielikuvituksen’ aiheesta.

Jos GPT-3 olisi johdonmukaisesti väärässä lainauksissa, olisi helpompi hylätä nämä hallusinaatiot ohjelmallisesti. Kuitenkin mitä laajemmin ja kuuluisammin lainaus on, sitä todennäköisemmin GPT-3 saa lainauksen oikein:

GPT-3 näyttää löytävän oikeat lainaukset, kun ne ovat hyvin edustettuina osallistuvassa aineistossa.

Toinen ongelma voi ilmetä, kun GPT-3:n istunnon historiatiedot valuvat uuteen kysymykseen:

Einstein olisi luultavasti skandaalittunut, jos hänelle olisi attribuoitu tämä lainaus. Lainaus näyttää olevan järjenvastainen hallusinaatio todellisesta Winston Churchillin aforismista. Edellinen kysymys GPT-3-istunnossa liittyi Churchilliin (ei Einstein), ja GPT-3 näyttää käyttäneen tämän istunnon tokenin virheellisesti vastauksen muodostamiseen.

Taloudellinen hallusinaation torjunta

Hallusinaatio on merkittävä este monimutkaisten NLP-mallien soveltamiselle tutkimustyökaluina – sitä enemmän, mitä abstraktimpi tuloste on lähtöaineistosta, josta se muodostui, joten lainauksien ja tosiasioiden totuuden määrittäminen muodostuu ongelmalliseksi.

Siksi yksi nykyinen yleinen haaste NLP:ssä on löytää keino hallusinoitujen tekstien tunnistamiseen ilman uusien NLP-mallien kehittämistä, jotka sisällyttävät, määrittävät ja todistavat tosiasiat erillisinä entiteetteinä (pitempiaikainen, erillinen tavoite useissa laajemmissa tietokonetta koskevissa tutkimusaloissa).

Hallusinoitujen sisältöjen tunnistaminen ja generointi

Uusi yhteistyö Carnegie Mellon -yliopiston ja Facebook AI Researchin välillä tarjoaa uuden lähestymistavan hallusinaatio-ongelmaan, muotoilemalla menetelmän hallusinoitujen tulosteiden tunnistamiseksi ja käyttämällä synteettisiä hallusinoituneita tekstejä perustana tuleville suodattimille ja mekanismeille, jotka voivat lopulta muodostua NLP-arkkitehtuureiden ydinosaaksi.

Lähde: https://arxiv.org/pdf/2011.02593.pdf

Yllä olevassa kuvassa lähdeaineisto on jaettu sanan perusteella, ja ‘0’-merkintä on annettu oikeille sanoille ja ‘1’-merkintä hallusinoituneille sanoille. Alla näemme esimerkin hallusinoituneesta tulosteesta, joka liittyy syötetietoihin, mutta on täydennetty epäaidolla tiedolla.

Järjestelmä käyttää esikoulutettua denoising-autoenkooderia, joka pystyy kartoittamaan hallusinoituneen merkkijonon takaisin alkuperäiseen tekstiin, josta viallinen versio tuotettiin (samankaltainen kuin esimerkkejäni yllä, joissa internet-haut tulivat ilmi väärien lainauksien alkuperästä, mutta ohjelmallisella ja automaattisella semanttisella metodologialla). Nimenomaan Facebookin BART-autoenkooderimalli käytetään tuottamaan vialliset lauseet.

Merkintöjen määrittäminen.

Hallusinaation kartoittaminen takaisin lähteeseen, mikä ei ole mahdollista yleisissä korkean tason NLP-malleissa, mahdollistaa ‘muokkausetäisyyden’ kartoittamisen ja mahdollistaa algoritmisen lähestymistavan hallusinoituneen sisällön tunnistamiseksi.

Tutkijat totesivat, että järjestelmä pystyy yleistämään hyvin, vaikka sillä ei ole pääsyä viiteaineistoon, joka oli saatavilla koulutuksen aikana, mikä osoittaa, että konseptuaalinen malli on kelvollinen ja laajasti toistettavissa.

Ylioppimisen torjunta

Välttääkseen ylioppimisen ja päästäkseen laajasti käytettävään arkkitehtuuriin tutkijat poistivat satunnaisesti tokenit prosessista ja käyttivät myös uudelleenmuotoilua ja muita melufunktioita.

Konekäännös (MT) on myös osa tätä hämärrysprosessia, koska tekstin kääntäminen kielten välillä on todennäköisesti säilyttävä merkitystä luotettavasti ja estävä ylioppimisen. Siksi hallusinaatiot käännettiin ja tunnistettiin hankkeessa kaksikielisillä puhujilla manuaalisessa annotaatiokerroksessa.

Hanke saavutti uudet parhaat tulokset useissa standardisoiduissa alan testeissä ja on ensimmäinen, joka saavuttaa hyväksyttävät tulokset yli 10 miljoonan tokenin aineistolla.

Hankkeen koodi, jonka nimeltä Hallusinoituneen sisällön tunnistaminen ehdollisissa neuroverkkoperäisissä sekvenssigenereissä, on julkaistu GitHubissa, ja se mahdollistaa käyttäjille oman synteettisen aineiston luomisen BART:lla mistä tahansa tekstikorpuksesta. Mahdollisuus on myös varattu tulevien hallusinaatioiden havaitsemismallien luomiseksi.