Tekoäly

Paraphraasien generointi syvällä vahvistusoppimisella – ajattelijat

Kun kirjoitamme tai puhumme, olemme kaikki joskus miettineet, onko olemassa parempi tapa viestiä ajatuksiamme muille. Mitkä sanat minun pitäisi käyttää? Miten minun pitäisi rakentaa ajatus? Miten he todennäköisesti vastaavat? Phrasee:ssä viettämme paljon aikaa miettien kieltä – mitä toimii ja mitä ei.

Kuvittele, että kirjoitat aiheen rivin sähköpostikampanjaan, joka lähetetään 10 miljoonalle ihmiselle luettelossasi ja tarjoaa 20 % alennuksen uudesta, hienosta kannettavasta tietokoneesta.

Mikä rivi sinä valitsisit:

- Voit nyt saada 20 % alennuksen seuraavasta tilauksestasi

- Valmistaudu – 20 % alennus

Vaikka ne välittävät saman tiedon, toinen saavutti lähes 15 % korkeamman avausprosentin kuin toinen (ja uskon, että et voi voittaa malliamme sen ennustamisessa, kumpi ?). Vaikka kieltä voidaan usein testata A/B-testauksella tai moni-käsi-panssariputken avulla, automaattisen parafrasien generointi on edelleen haasteellinen tutkimusongelma.

Kaksi lausetta pidetään toistensa parafraseina, jos ne jakavat saman merkityksen ja voidaan käyttää vaihdellen. Toinen tärkeä asia, jota usein otetaan itsestäänselvyytenä, on se, onko koneella generoitu lause sujuva.

Toisin kuin valvottu oppiminen, vahvistusoppimisen (RL) agentit oppivat vuorovaikutuksen kautta ympäristönsä kanssa ja havaintojen kautta, joita he saavat tuloksena. Tämä hieman hienostunut ero vaikuttaa suuresti siihen, miten algoritmit toimivat ja miten mallit koulutetaan. Syvä vahvistusoppiminen käyttää neuroverkkoja funktioarvioijana, jotta agentti voi oppia menemään ihmisten ohitse monimutkaisissa ympäristöissä, kuten Go, Atari ja StarCraft II.

Vaikka tämä menestys, vahvistusoppimista ei ole laajasti sovellettu todellisiin ongelmiin, mukaan lukien luonnollisen kielen prosessointi (NLP).

Olen osana MSc-tutkintoa tieteenalatieteen osoitamme, miten syvää vahvistusoppimista voidaan käyttää ylittämään valvottuja oppimismenetelmiä automaattisesti generoimalla parafraseja syötetekstistä. Parhaan parafrasin generointiongelma voidaan nähdä etsintänä sanasarjasta, joka maksimoi semanttisen samankaltaisuuden lauseiden välillä säilyttäen sujuvuuden tulosteessa. RL-agentit ovat hyvin sovellettavissa löytämään parhaat toimet saavuttaa odotettu maksimirewards kontrolliympäristöissä.

Toisin kuin useimmissa koneoppimisen ongelmissa, suurin ongelma useimmissa luonnollisen kielen generoinnin (NLG) sovelluksissa ei ole mallinnuksessa vaan arvioinnissa. Vaikka ihmisen arviointi on tällä hetkellä katsottu kultaisen standardin NLG-arvioinnissa, se kärsii merkittävistä haitoista, mukaan lukien se, että se on kallista, aikaa vievää, haastavaa säätää ja puutteellinen jäljitettävyyden suhteen kokeiden ja tietojoukkojen välillä (Han, 2016). Tämän seurauksena tutkijat ovat pitkään etsineet automaattisia mittareita, jotka ovat yksinkertaisia, yleistettävissä ja heijastavat ihmisen tuomioita (Papineni et al., 2002).

Yleisimmät automaattiset arviointimenetelmät koneella generoiduissa kuvakuvauksissa on yhteenvetetty alla olevassa taulukossa heidän etuoikeuksiensa ja haittojensa kanssa:

Parafrasigenerointi vahvistusoppimisen avulla

Kehittämme järjestelmän nimeltä ParaPhrasee, joka generoi laadukkaita parafraseja. Järjestelmä koostuu useista vaiheista, jotta voidaan soveltaa vahvistusoppimista laskennallisesti tehokkaalla tavalla. Lyhyt yhteenveto korkean tason putkistosta on esitetty alla, ja lisätietoja on tutkielmassa.

Tietojoukko

On olemassa useita parafrasitietoja, jotka käytetään tutkimuksessa, mukaan lukien: Microsoftin parafrasikorpus, ACL:n semanttisen tekstin samankaltaisuuskilpailu, Quoran duplikaattikysymykset ja Twitterin jaetut linkit. Olemme valinneet MS-COCO:n sen koosta, puhtaudasta ja käytöstä benchmarkkina kahdessa merkittävässä parafrasigenerointitutkimuksessa. MS-COCO sisältää 120k kuvia yleisistä kohtauksista ja 5 kuvatekstiä per kuva, jotka on tarjonnut 5 eri ihmisen annotoijaa.

Vaikka se on pääasiassa suunniteltu tietokoneen näön tutkimukseen, kuvatekstit ovat usein korkean semanttisen samankaltaisuuden ja ovat mielenkiintoisia parafraseja. Koska kuvatekstit on annettu eri ihmisille, ne ovat usein hieman erilaisia yksityiskohtia, jotka on annettu kohtauksessa, joten generoidut lauseet usein “hallusinoivat” yksityiskohtia.

Valvottu malli

Vaikka vahvistusoppiminen on parantunut merkittävästi näytteiden tehokkuuden, koulutusajat, yleiset parhaat käytännöt, vahvistusoppimismallien koulutus alusta alkaen on edelleen vertaamaton hitaampi ja epävakaa (Arulkumaran et al., 2017). Sen sijaan, että kouluttaisimme alusta, koulutamme ensin valvottua mallia ja sitten hienosäätämme sitä vahvistusoppimisen avulla.

Käytämme koodarin-dekoodarin mallirakennetta ja arvioimme useiden perusvalvottujen mallien suorituskykyä. Kun hienosäätämme mallia vahvistusoppimisen avulla, hienosäätämme vain dekoodarin verkkoa ja käsittelimme koodarin verkkoa staattisena. Tällöin otamme huomioon kaksi pääkehystä:

- Koulutamme valvottua mallia alusta alkaen käyttäen standardia/vanilaa koodarin-dekoodarin mallia GRU:illa

- Käytämme esikoulutettuja lausekkeita koodaajamallina, mukaan lukien: pooled sanasiteet (GloVe), InferSent ja BERT

Valvottujen mallien suorituskyky on usein melko samanlainen malleittain, ja BERT ja vanilja-koodari-dekoodari saavuttavat parhaimman suorituskyvyn.

Vaikka suorituskyky on usein kohtuullinen, on kolme yleistä virhelähdettä: tatuointi, generoiminen lausefragmentteja ja hallusinaatioita. Nämä ovat pääongelmia, joita vahvistusoppimisen käyttäminen pyrkii ratkaisemaan.

Vahvistusoppimismalli

Vahvistusoppimisalgoritmien toteuttaminen on erittäin haasteellista, etenkin kun et tiedä, voidaanko ongelmaa ratkaista. On ongelmia ympäristön toteuttamisessa, agenttien toteuttamisessa, hyperparametrien toteuttamisessa, palkkiofunktion toteuttamisessa tai kaikissa näistä.

Kuten kaikessa virheenjäljityksessä, on tärkeää aloittaa yksinkertaisesti. Toteutimme muunnelmia kahdesta hyvin ymmärretystä leluympäristöstä (CartPole ja FrozenLake) testataksemme vahvistusoppimisalgoritmeja ja löytääksemme toistettavan strategian tietämysiirrosta valvotusta mallista.

Löysimme, että toimija-kriittinen algoritmi suoritti paremmin kuin REINFORCE näissä ympäristöissä. Toimijan painoarvojen alustamisessa koulutetulla valvotulla mallilla ja kriittisen esikoulutuksella saavutimme parhaimman suorituskyvyn. Löysimme, että se oli haasteellista yleistää monimutkaisia politiikkatili-algoritmeja uusiin ympäristöihin, koska ne esittävät monia uusia hyperparametreja, jotka vaativat säätämistä toimivaksi.

Tuetuin näillä oivalluksilla, käärimme sitten kehittämään lähestymistapaa parafrasigenerointitehtävään. Tarvitsemme ensin luoda ympäristön.

Ympäristö mahdollistaa meille helposti testata eri arviointimittareiden vaikutusta palkkiofunktioiden avulla.

Määrittelemme sitten agentin, ja koska siinä on monia etuja, käytämme toimija-kriittistä arkkitehtuuria. Toimija valitsee seuraavan sanan sanajonossa, ja sen painot on alustettu koulutetulla valvotulla mallilla. Kriittinen antaa arvion odotetusta palkkiosta, jonka tila todennäköisesti saa, jotta toimija voi oppia.

Oikean palkkiofunktion suunnittelu

Tärkein komponentti vahvistusoppimisjärjestelmän suunnittelussa on palkkiofunktiota, koska vahvistusoppimisagentti yrittää optimoida sitä. Jos palkkiofunktiota on virheellinen, tulokset kärsivät, vaikka jokainen muu järjestelmän osa toimisi!

Klassinen esimerkki tästä on CoastRunners, jossa OpenAI-tutkijat asettivat palkkiofunktion maksimoimaan yhteispisteytys sen sijaan, että voittaisivat kilpailun. Tuloksena agentti löysi silmukan, jossa se saattoi saada korkeimman pisteytyksen osuessaan turboja ilman, että koskaan suorittaisi kilpailun.

https://www.youtube.com/watch?time_continue=2&v=tlOIHko8ySg&feature=emb_title

Koska parafrasien laadun arviointi on itsessään ratkaisematon ongelma, palkkiofunktion suunnittelu, joka ottaa automaattisesti tämän tavoitteen, on vielä haasteellisempi. Useimmat kielen osat eivät pureudu kauniisti lineaarisiin mittareihin ja ovat tehtävänriippuvaisia (Novikova et al., 2017).

Vahvistusoppimisagentti usein löytää mielenkiintoisen strategian maksimoida palkkioita, joka hyödyntää arviointimittauksen heikkouksia sen sijaan, että generoisi laadukkaita tekstejä. Tämä johtaa usein heikkoon suorituskykyyn mittareilla, joita agentti ei suoraan optimoi.

Tutkimme kolmea päälähestymistapaa:

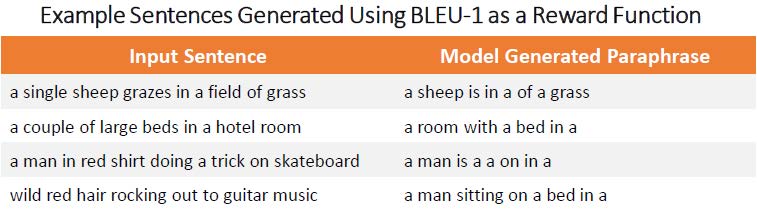

- Sanien yhteensopivuusmittarit

Yleiset NLP-arviointimitat ottaa huomioon sanien yhteensopivuuden osuuden generoidun parafrasin ja arviointilauseen välillä. Mitä suurempi yhteensopivuus, sitä suurempi palkkio. Haaste sanatasolla on, että agentti sisältää liian monta yhdistävää sanaa, kuten “on” ja “of”, eikä ole mitään sujuvuuden mittaria. Tämä johtaa erittäin matalanlaatuisiin parafraseihin.

- Lausekohtainen samankaltaisuus- ja sujuvuusmittarit

Generoidun parafrasin pääominaisuudet ovat, että se on sujuva ja semanttisesti samankaltainen syötelauseen kanssa. Yritämme siis arvioida nämä ominaisuudet erikseen ja yhdistää mittareita. Semanttisen samankaltaisuuden osalta käytämme kosini-samankaltaisuutta esikoulutettujen mallien lausekkeiden välillä, mukaan lukien BERT. Sujuvuuden osalta käytämme pisteytystä, joka perustuu lauseen hämmästyneisyyteen GPT-2:sta. Mitä suurempi kosini-samankaltaisuus ja sujuvuuspisteet, sitä suurempi palkkio.

Kokeilimme monia eri yhdistelmiä lausekkeen malleja ja sujuvuusmalleja, ja vaikka suorituskyky oli kohtuullinen, pääongelma, jota agentti kohtasi, oli se, ettei se tasapainottanut riittävästi semanttista samankaltaisuutta sujuvuuden kanssa. Useimmissa konfiguraatioissa agentti priorisoi sujuvuuden johtuen yksityiskohtien poistamisesta ja useimmat entiteetit asetettiin “keskelle” tai “pöydän” tai “tien” vierelle.

Monitavoitteinen vahvistusoppiminen on avoin tutkimuskysymys ja on erittäin haasteellinen tässä tapauksessa.

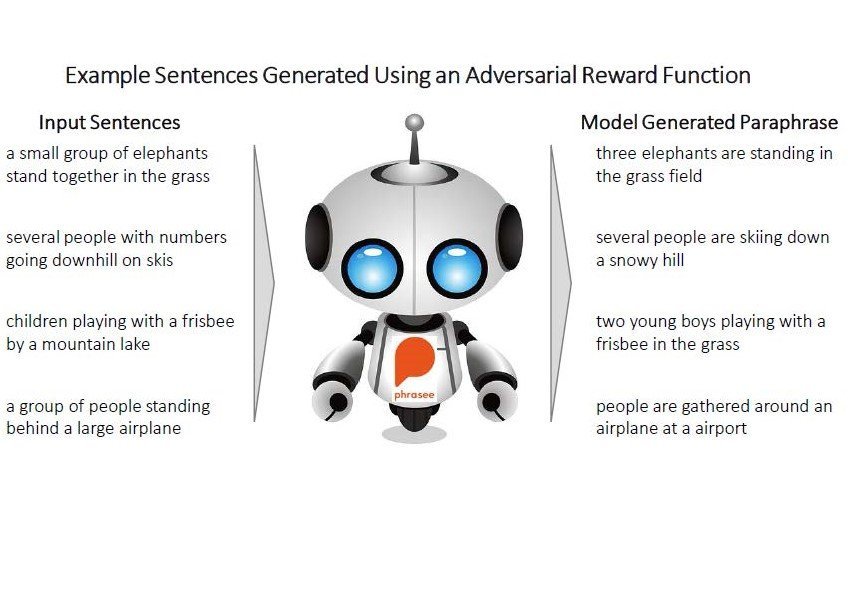

- Vastustajan mallin käyttäminen palkkiofunktiona

Koska ihmiset ovat katsottu kultaisen standardin arvioinnissa, koulutamme erillisen mallin, jota kutsutaan diskriminaattoriksi, ennustamaan, ovatko kaksi lausetta toistensa parafraseja (samoin kuin ihminen arvioisi). Vahvistusoppimismallin tavoitteena on siis vakuuttaa tämä malli, että generoitu lause on parafrasi syötelauseesta. Diskriminaattori antaa arvion siitä, kuinka todennäköisesti kaksi lausetta ovat toistensa parafraseja, ja sitä käytetään palkkiona kouluttaa agenttia.

Joka 5 000 arviointia diskriminaattori kerrotaan, kumpi parafrasi tuli tietojoukosta ja kumpi generoitiin, jotta se voi parantaa tulevia arvioitaan.

Prosessi jatkuu useita kierroksia, joissa agentti yrittää hämätä diskriminaattoria ja diskriminaattori yrittää erottaa generoidut parafrasit arviointiparafraseista tietojoukosta.

Useiden kierrosten jälkeen agentti generoi parafraseja, jotka ylittävät valvottujen mallien suorituskyvyn ja muita palkkiofunktiota.

Johtopäätös ja rajoitukset

Vastustavat lähestymistavat (mukaan lukien itsepelit pelien kanssa) tarjoavat erittäin lupaavan lähestymistavan vahvistusoppimisalgoritmien kouluttamiseen ylittämään ihmisten taso tiettyjen tehtävien suorittamisessa ilman eksplisiittisen palkkiofunktion määrittelyä.

Vaikka vahvistusoppiminen pystyi ylittämään valvottua oppimista tässä tapauksessa, ylimääräinen ylitys koodin, laskennan ja monimutkaisuuden suhteen ei ole suorituskyvyn parantamisen arvoista useimmissa sovelluksissa. Vahvistusoppiminen on parasta soveltaa tilanteisiin, joissa valvottu oppiminen ei voida helposti soveltaa, ja palkkiofunktiota on helppo määritellä (kuten Atari-peleissä). Lähestymistavat ja algoritmit ovat paljon kypsiä valvotussa oppimisessa, ja virhesignaali on paljon vahvempi, mikä johtaa nopeampaan ja vakaampaan koulutukseen.

Toinen huomioon otettava asia on, kuten muissakin neuroverkkopohjaisissa lähestymistavoissa, että agentti voi epäonnistua dramaattisesti tapauksissa, joissa syöte on erilainen kuin mitä se on aikaisemmin nähnyt, vaatikkoen lisäkerroksen järjenmukaisuuden tarkistamista tuotantosovelluksissa.

Vahvistusoppimislähestymistapojen ja laskennallisen infrastruktuurin kehittyminen viime vuosina avaa valtavat mahdollisuudet vahvistusoppimisen soveltamiseen teollisuudessa, erityisesti luonnollisen kielen prosessoinnissa.