Tekoäly

Monimodaalinen AI kehittyy ChatGPT:n saadessa näkökyvyn GPT-4V(ision) avulla

Pyrkimyksessä tehdä AI:sta enemmän ihmisenkaltaista, OpenAI:n GPT-mallit ovat jatkuvasti venyneet rajojaan. GPT-4 pystyy nyt vastaanottamaan sekä teksti- että kuva-ohjauksia.

Monimodaliteetti generatiivisessa AI:ssa tarkoittaa mallin kykyä tuottaa erilaisia tulosteita, kuten tekstiä, kuvia tai ääntä, syötteen perusteella. Nämä mallit, jotka on koulutettu tiettyyn dataan, oppivat sisäisiä malleja ja tuottavat samankaltaista uutta dataa, rikastuttaen AI-sovelluksia.

Viimeaikaiset edistysaskeleet monimodaalisessa AI:ssa

Viimeaikainen merkittävä harppaus tässä alalla on DALL-E 3:n integrointi ChatGPT:hen, merkittävä parannus OpenAI:n teksti-kuvateknologiassa. Tämä yhdistelmä mahdollistaa suljemman vuorovaikutuksen, jossa ChatGPT auttaa luomassa tarkkoja ohjauksia DALL-E 3:lle, muuttaen käyttäjien ideat eläviksi AI-generoituiksi taideteoksi. Niinpä, vaikka käyttäjät voivat suoraan vuorovaikuttaa DALL-E 3:n kanssa, ChatGPT:n lisääminen prosessiin tekee AI-taiteen luomisen paljon käyttäjäystävällisemmäksi.

Lue lisää DALL-E 3:sta ja sen integroinnista ChatGPT:hen täältä. Tämä yhteistyö ei ainoastaan esittele edistystä monimodaalisessa AI:ssa, vaan myös tekee AI-taiteen luomisen helppoksi käyttäjille.

Google Health esitteli toisaalta Med-PaLM M:n kesäkuussa tänä vuonna. Se on monimodaalinen generatiivinen malli, joka on taitava koodaamaan ja tulkitsemaan erilaisia biolääketieteellisiä tietoja. Tämä saavutettiin hienosäätämällä PaLM-E:ta, kielen mallia, palvelemaan lääketieteellisiä aloja avoimen lähdekoodin mittarilla, MultiMedBench. Tämä mittari koostuu yli miljoonasta näytteestä 7 biolääketieteellisen tiedon tyypissä ja 14 tehtävässä, kuten lääketieteellisissä kysymyksissä ja röntgenraporttien luomisessa.

Eri aloilla hyödynnetään innovatiivisia monimodaalisia AI-työkaluja liiketoiminnan kasvattamiseen, prosessien sujuvoittamiseen ja asiakasviestinnän parantamiseen. Äänen, videon ja tekstin AI-ominaisuuksien edistysaskeleet ovat kiihdyttäneet monimodaalisen AI:n kasvua.

Yritykset etsivät monimodaalisen AI:n sovelluksia, jotka voivat muuttaa liiketoimintamalleja ja prosesseja, avaamalla kasvukanavia koko generatiivisen AI-ekosysteemin läpi, aina datatyökaluista uusiin AI-sovelluksiin.

GPT-4:n julkaisun jälkeen maaliskuussa jotkut käyttäjät havaitsivat sen vastauslaadun heikentymisen ajan myötä, asia jota merkittävät kehittäjät ja OpenAI:n foorumit korostivat. Aluksi OpenAI hylkäsi tämän, mutta myöhempi tutkimus vahvisti ongelman. Se paljasti GPT-4:n tarkinimityyden laskeneen 97,6 prosentista 2,4 prosenttiin maaliskuun ja kesäkuun välisenä aikana, osoittaen vastauslaadun heikentymisen mallin päivittäisten muutosten myötä.

Hype Open AI:n ChatGPT:stä on takaisin nyt. Se tulee nyt näköominaisuudella GPT-4V, joka mahdollistaa GPT-4:lle kuvien analysoinnin, jotka annetaan sille. Tämä on uusin ominaisuus, joka on avattu käyttäjille.

Kuvien analyysin lisääminen suuriin kielen malleihin (LLM) kuten GPT-4:ään nähdään joillakin suurena askelena eteenpäin AI-tutkimuksessa ja kehityksessä. Tällainen monimodaalinen LLM avaa uusia mahdollisuuksia, vie kielen mallit tekstin ulkopuolelle ja tarjoaa uusia käyttöliittymiä ja ratkaisee uusia tehtäviä, luoden käyttäjille uusia kokemuksia.

GPT-4V:n koulutus valmistui vuonna 2022, ja varhainen pääsy avattiin maaliskuussa 2023. GPT-4V:n visuaalinen ominaisuus perustuu GPT-4-teknologiaan. Koulutusprosessi säilyi samana. Aluksi malli koulutettiin ennustamaan seuraavaa sanaa tekstinäyttöä käyttäen valtavaa tietojoukkoa sekä tekstiä että kuvia eri lähteistä, mukaan lukien internet.

Myöhemmin se hienosääteli lisää dataa käyttäen menetelmää, joka tunnetaan ihmisen palautteen vahvistamisesta (RLHF), tuottaakseen tulosteita, joita ihmiset pitivät miellyttävinä.

GPT-4:n Näkömekaniikka

GPT-4:n merkittävät visuaalis-kielitaitojen taustalla olevat menetelmät säilyvät pinnan alla.

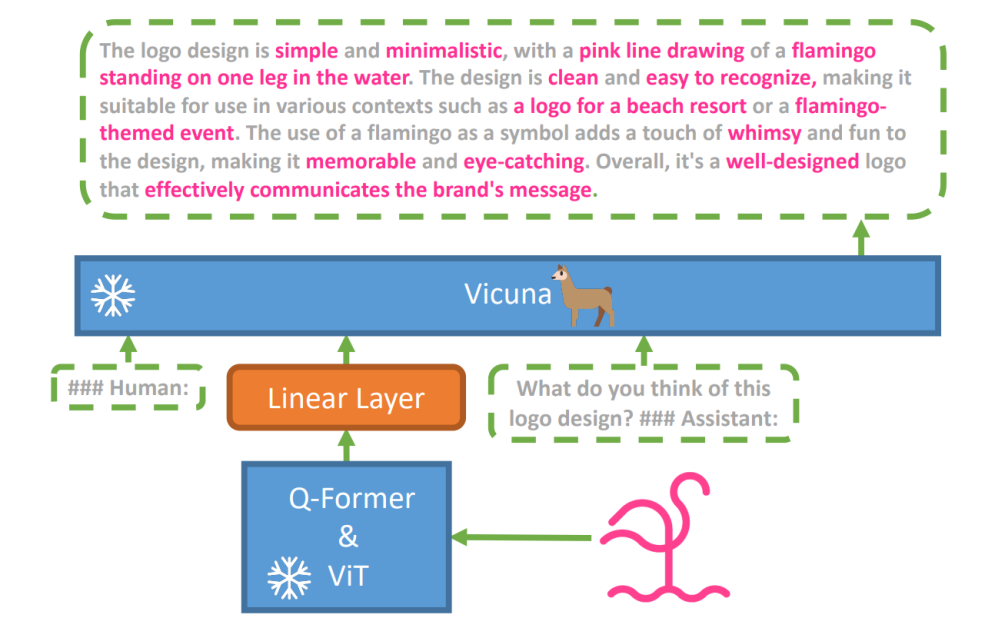

Tutkimuksessa tätä hypoteesiä, uusi visuaalinen kielen malli, MiniGPT-4, esiteltiin, joka hyödyntää edistynyttä LLM:ää nimeltä Vicuna. Tämä malli käyttää visuaalista koodausta, jossa on esikoulutetut komponentit visuaaliselle havainnolle, ja se linjaa koodatut visuaaliset ominaisuudet Vicuna-kielen mallin kanssa yhden projektiokerroksen kautta. MiniGPT-4:n arkkitehtuuri on yksinkertainen mutta tehokas, ja se keskittyy visuaalisten ja kielitaitojen linjaamiseen visuaalisen keskustelun parantamiseksi.

MiniGPT-4:n arkkitehtuuri sisältää visuaalisen koodausmenetelmän, jossa on esikoulutetut ViT- ja Q-Former, yksinkertainen lineaarinen projektiokerros ja edistynyt Vicuna-kielen malli.

Autoregressiivisten kielen mallien trendi visuaalisten tehtävissä on myös kasvanut, hyödyntäen monimodaalista siirtymää jaettua tietoa kielen ja monimodaalisen tiedon välillä.

MiniGPT-4 siltaa visuaalisen ja kielitaidon alojen välillä linjaamalla visuaalisen tiedon esikoulutetusta visuaalisesta koodaajasta edistyneen LLM:n kanssa. Malli käyttää Vicunaa kielen purkamiseen ja seuraa kaksivaiheista koulutuslähestymistapaa. Aluksi se koulutetaan suurella joukolla kuva- ja tekstipareja, jotta se voi omaksua visuaalisen kielen tiedon, ja sitten se hienosäätelään pienemmällä, laadukkaammalla datalla parantamaan luomisen luotettavuutta ja käytettävyyttä.

Visuaalisen ja kielitaidon yhdistämiseksi MiniGPT-4:ssä, tutkijat kehittivät kaksivaiheisen linjaamisprosessin, joka ratkaisee visuaalisen ja kielen välistä linjaamisen puutteen. He kokosivat erityisen tietojoukon tätä tarkoitusta varten.

Alkuperäinen kuvauksen ohjaus:

###Ihminen: <Kuva><Kuvan ominaisuus></Kuva>Kuvaa tätä kuvaa yksityiskohtaisesti. Kerro kaikki yksityiskohdat. Sano kaiken, mitä näet. ###Avustaja:

Tiedon jälkikäsittelyssä korjattiin mahdolliset epäjohdonmukaisuudet tai virheet luoduissa kuvauksissa ChatGPT:n avulla, ja ne vahvistettiin manuaalisesti varmistaakseen korkean laadun.

Toisen vaiheen hienosäätöohjaus:

###Ihminen: <Kuva><Kuvan ominaisuus></Kuva><Ohje>###Avustaja:

Tämä tutkimus avaa ikkunan ymmärtämään monimodaalisen generatiivisen AI:n, kuten GPT-4:n, mekaniikkaa, ja valaisee, miten visuaalinen ja kielitaito voidaan tehokkaasti yhdistää luomaan yhtenäisiä ja kontekstuaalisesti rikkaampia tulosteita.

GPT-4:n Näön Tutkiminen

Määrittäminen Kuvien Alkuperä ChatGPT:n Avulla

GPT-4:n visio parantaa ChatGPT:n kykyä analyysoida kuvia ja määrittää niiden maantieteellisen alkuperän. Tämä ominaisuus siirtää käyttäjien vuorovaikutuksia pelkästään tekstistä teksti- ja visuaaliseen yhdistelmään, muodostaen kätevän työkalun niille, jotka ovat uteliaita eri paikoista kuvadataa käyttäen.

Monimutkaiset Matemaattiset Käsitteet

GPT-4:n visio erottuu syventymällä monimutkaisiin matemaattisiin käsitteisiin analysoimalla graafisia tai käsin kirjoitettuja ilmaisuja. Tämä ominaisuus toimii hyödyllisenä työkaluna niille, jotka etsivät ratkaisuja monimutkaisiin matemaattisiin ongelmiin, ja se on merkittävä apu koulutuksellisissa ja akateemisissa aloissa.

Käsin Kirjoitettujen Syötteiden Muuntaminen LaTeX-koodiksi

Yksi GPT-4V:n merkittävimmistä ominaisuuksista on sen kyky kääntää käsin kirjoitetut syötteet LaTeX-koodiksi. Tämä ominaisuus on siunaus tutkijoille, akateemikoille ja opiskelijoille, jotka usein tarvitsevat muuttaa käsin kirjoitetut matemaattiset ilmaisut tai muita teknisiä tietoja digitaaliseen muotoon. Käsin kirjoitettujen ja LaTeX-välisen muunnoksen laajentaminen laajentaa asiakirjojen digitalisoinnin horisonttia ja yksinkertaa teknisen kirjoittamisen prosessia.

Taulukoiden Tietojen Etsintä

GPT-4V osoittaa taituruutta etsimällä tietoja taulukoista ja vastaamalla niihin liittyviin kysymyksiin, mikä on tärkeä apuä. Käyttäjät voivat käyttää GPT-4V:ää taulukoiden läpikäymiseen, avainhuomioista keräämiseen ja kysymysten ratkaisemiseen, mikä tekee siitä vahvan työkalun ja muille ammattilaisille.

Visuaalisen Osoittamisen Ymmärtäminen

GPT-4V:n ainutlaatuinen kyky ymmärtää visuaalista osoittamista lisää uuden ulottuvuuden käyttäjien vuorovaikutukseen. Visuaalisten vihjeiden ymmärtämisellä GPT-4V voi vastata kysymyksiin suuremmalla kontekstuaalisella ymmärryksellä.

Yksinkertaisten Mock-Up -sivujen Luominen Piirroksen Avulla

Innoittuneena tästä viestistä, yritin luoda mock-upin Unite.ai-sivustolle.

Vaikka lopputulos ei täysin vastannut alkuperäistä visiotaani, tässä on tulos, jonka saavutin.

GPT-4V(ision) Rajoitukset ja Virheet

GPT-4V:n analyysiin Open AI -tiimi suoritti laadullisia ja määrällisiä arvioita. Laadulliset arviot sisälsivät sisäisiä testejä ja ulkopuolisten asiantuntijoiden arvioita, kun taas määrälliset arviot mitattiin mallin kieltäytymisiä ja tarkinimityyttä erilaisissa tilanteissa, kuten haitallisen sisällön tunnistamisessa, demografioiden tunnistamisessa, yksityisyyskysymyksissä, geolokalisoinnissa, kyberTurvallisuudessa ja monimodaalisissa vankilajärjestelmissä.

Kuitenkin malli ei ole täydellinen.

Tutkimus korostaa GPT-4V:n rajoituksia, kuten virheellisiä johtopäätöksiä ja puuttuvia tekstejä tai merkkejä kuvissa. Se voi harhautua tai keksintöjä. Erityisesti se ei sovellu vaarallisten aineiden tunnistamiseen kuvissa, usein tunnistamatta niitä virheellisesti.

Lääketieteellisissä kuvissa GPT-4V voi antaa epäjohdonmukaisia vastauksia ja puuttuu tietoisuus standardikäytännöistä, mikä johtaa potentiaalisiin väärään diagnosointiin.

Epäluotettava suoritus lääketieteellisissä tarkoituksissa (Lähde)

Se myös epäonnistuu ymmärtämään joitain vihamielisten symbolien hienovaraisuutta ja voi tuottaa sopimatonta sisältöä visuaalisten syötteiden perusteella. OpenAI neuvoo vastaan käyttämästä GPT-4V:ää kriittisiin tulkintoihin, erityisesti lääketieteellisissä tai herkillä aiheilla.

Yhteenveto

Luotu Fast Stable Diffusion XL https://huggingface.co/spaces/google/sdxl

GPT-4 Visionin saapuminen tuo joukon uusia mahdollisuuksia ja uusia haasteita. Ennen sen julkaisemista, paljon työtä on tehty varmistaakseen, että riskit, erityisesti kuvien osalta, on tutkittu ja vähennetty. On vaikuttavaa nähdä, miten GPT-4V on edennyt, osoittaen paljon lupaavia alueilla, kuten lääketieteessä ja tieteessä.

Nyt on suuria kysymyksiä esillä. Esimerkiksi, pitäisikö nämä mallit pystyä tunnistamaan kuuluisia henkilöitä kuvista? Pitäisikö ne arvata henkilön sukupuolta, rotua tai tunteita kuvan perusteella? Ja pitäisikö olla erityisiä säätöjä auttamaan näkövammaisia? Nämä kysymykset avaavat kanin kolon yksityisyyden, reiluuden ja siitä, miten AI tulisi sovittaa elämäämme, mikä on asia, josta kaikki tulisi olla osa.