Kumppanuudet

Infineon Technologies ja d-Matrix tekevät yhteistyötä matalan viiveen AI-infran parantamiseksi

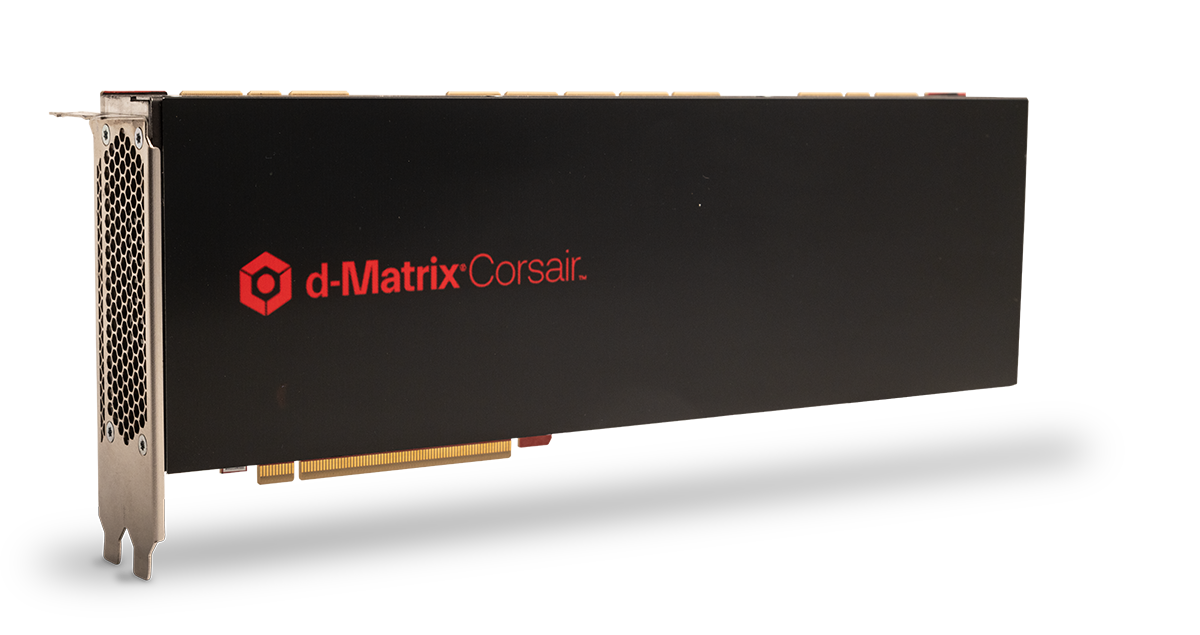

Infineon Technologies on ilmoittanut yhteistyöstä d-Matrixin kanssa, jonka tavoitteena on parantaa AI-inferenssijärjestelmien suorituskykyä ja energiatehokkuutta modernissa datakeskuksissa. Yhteistyö keskittyy d-Matrixin Corsair AI-inferenssikiihdytinplatformin ja Infineonin OptiMOS-kaksoisvaiheisen virtalähteen ympärille, jotka on suunniteltu tukemaan korkeatiheyslaskeymiskoja interaktiivisille AI-työkuormille.

Ilmoitus korostaa kasvavaa muutosta AI-laitteistoalalla. Vaikka suurin osa infrastruktuurin kasvusta viime vuosina on keskittynyt kouluttamaan yhä suurempia AI-malleja, ala on nyt nopeasti laajentumassa inferenssiin – prosessiin, jossa malleja käytetään todellisissa sovelluksissa, kuten chatboteissa, agenteissa, kopioissa, hakutoiminnoissa, rahoitusanalytiikassa ja terveydenhuollon päätöksenteossa. Nämä työkuormat asettavat erilaisia vaatimuksia laitteistolle, erityisesti viiveen, vastausajan ja energiankulutuksen suhteen.

Miksi AI-inferenssi on muuttumassa merkittäväksi laitteistotaistelukentäksi

AI-inferenssi on kehittynyt yhdeksi nopeimmin kasvavista AI-infrastruktuurin osa-alueista, koska interaktiiviset AI-järjestelmät vaativat vastauksia millisekunteina eikä sekunteina. d-Matrix on asettanut Corsairin erityisesti näille työkuormille, korostamalla erittäin matalaa viivettä ja energiatehokasta inferenssiä suurten kielen mallien ja AI-agenttien kanssa.

d-Matrixin mukaan Corsair suunniteltiin digitaalisen muistin laskennan arkkitehtuurin ympärille, jonka tarkoituksena on vähentää muistin pullonkauloja, jotka usein hidastavat generatiivisen AI-inferenssin. Yhtiö väittää, että alusta voi merkittävästi laskea viivettä ja parantaa läpäisyä perinteisiin GPU-keskeisiin inferenssijärjestelmiin verrattuna, erityisesti interaktiivisissa sovelluksissa.

Yhteistyö Infineonin kanssa koskee toista kasvavaa haasteita: virtalähde.

Kun AI-palvelimet jatkavat tiheyden kasvua, virtalähteen toimittaminen kiihdyttimille on muodostunut rajoitteeksi infrastruktuurin skaalautumiselle. Infineonin OptiMOS TDM2254xx -moduulit on suunniteltu pystyvirta-arkkitehtuureja varten, jotka auttavat vähentämään sähköisiä häviöitä ja parantamaan virtatiheyttä kompaktissa palvelinjärjestelmissä.

Siirtymä reaaliaikaisiin AI-järjestelmiin

Yhtiöt esittivät yhteistyön “interaktiivisen AI:n” nousun ympärillä, jossa inferenssijärjestelmien on jatkuvasti generoitava tuloksia erittäin lyhyellä viiveellä. Tähän kuuluvat keskustelualgoritmi, AI-agentit, reaaliaikaiset päättelyjärjestelmät ja sovellukset, jotka vaativat nopeaa tokenin generointia suurista kielen malleista.

d-Matrixin perustaja ja toimitusjohtaja Sid Sheth sanoi, että Corsairin arkkitehtuuri suunniteltiin erityisesti alle 2 millisekunnin tokenin viiveelle, josta on tullut yhä tärkeämpää, kun yritykset siirtävät AI-järjestelmiä kokeilusta asiakaslähtöisiin ympäristöihin.

Laajempi AI-alan on myös alkamassa tunnistaa, että inferenssin infrastruktuuri saattaa kehittyä eri tavoin kuin koulutuksen infrastruktuuri. Vaikka GPU-klusterit hallitsivat generatiivisen AI-laajentumisen ensivaihetta, inferenssi palkitsee yhä enemmän arkkitehtuureja, jotka on optimoitu muistin kaistanleveyden, viiveen, verkkotyön ja energiatehokkuuden ympärille eikä ainoastaan raakasuorituskyvyn.

Energiatehokkuus on muuttumassa keskeiseksi AI-skalaamiselle

Yksi suurimmista rajoitteista hyperskaleerijoille ja AI-pilvipalvelujen tarjoajille on sähkön kysyntä. AI-inferenssityökuormat voivat pyöriä jatkuvasti miljoonien pyyntöjen yli päivässä, mikä tekee operatiivisen tehokkuuden kriittiseksi käyttökustannuksille.

Infineon on laajentanut asemiaan AI-infrastruktuurissa aggressiivisesti puolijohde- ja galliumnitridi (GaN) -teknologioilla. Yhtiö on keskittynyt toimittamaan virtalähdetason AI-kiihdyttimien ja palvelininfrastruktuurin alle.

Yhteistyö d-Matrixin kanssa heijastaa sitä, miten puolijohdeyhtiöt ovat tulevat yhä tiukemmin kytketyiksi AI-kiihdyttinstartupeihin, kun ala etsii vaihtoehtoja perinteisille GPU-pohjaisille arkkitehtuureille.

AI-infrastruktuuri on laajentumassa perinteisten GPUjen ulkopuolelle

Yhteistyö saapuu laajemman kokeiluaallon aikana AI-laitteistossa. Kasvava määrä startupeja kehittää erikoistuneita kiihdyttimiä, jotka on suunniteltu erityisesti inferenssille, muistikeskeiselle laskennalle tai AI-verkkotyölle.

d-Matrix on erottautunut korostamalla laskennan muistissa ja matalan viiveen inferenssijärjestelmiä, jotka on suunniteltu generatiiviselle AI:lle. Yhtiö on myös laajentanut infrastruktuuristrategiaansa kiihdyttinpiirien ulkopuolelle, korostamalla viime aikoina verkkotöitä, koostettavaa infrastruktuuria ja kokonaisjärjestelmän optimointia inferenssiryhmille.

Kun AI-sovellukset tulevat yhä enemmän agenteeratuiksi ja interaktiivisiksi, infrastruktuurin tarjoajien odotetaan panostavan enemmän viiveen vähentämiseen, energiankulutuksen laskemiseen ja järjestelmätasolla tapahtuvan tehokkuuden parantamiseen koko datakeskuksen pinnoilla eikä ainoastaan raakasuorituskyvyn.