Tekoäly

GPUs saattavat olla parempia, ei vain nopeampia, syvien neuroniverkkojen kouluttamisessa

Puolan ja Japanin tutkijat, jotka työskentelevät Sonyn kanssa, ovat löytäneet näyttöä siitä, että koneoppimisjärjestelmät, jotka on koulutettu GPU:illa eivät välttämättä sisällä vähemmän virheitä koulutusprosessin aikana ja tuottavat parempia tuloksia, mikä ristiriitaa yleistä ymmärrystä, että GPU:t suorittavat nämä toiminnot vain nopeammin, eivätkä välttämättä paremmin.

Tutkimus, jonka otsikko on GPU:n epävarmuuden vaikutus ennustavien syvien neuroniverkkojen koulutukseen, on tehty Adam Mickiewicz -yliopiston psykologian ja kognitiivisten tieteiden tiedekunnassa ja kahdessa japanilaisessa yliopistossa yhteistyössä SONY Computer Science Laboratoriesin kanssa.

Tutkimus osoittaa, että ‘epävarmuudet’, joita syvät neuroniverkkorakenteet näyttävät erilaisissa laitteisto- ja ohjelmistokonfiguraatioissa, suosivat kalliimpia (ja yhä harvemmassa) grafiikkaprosessoreita, ja havaittiin testeissä, että syvä neuroniverkko, joka on koulutettu yksinomaan CPU:lla, tuotti korkeamman virheluvun saman määrän epochien (koulutusdatan käsittelykertojen määrä istunnon aikana) aikana.

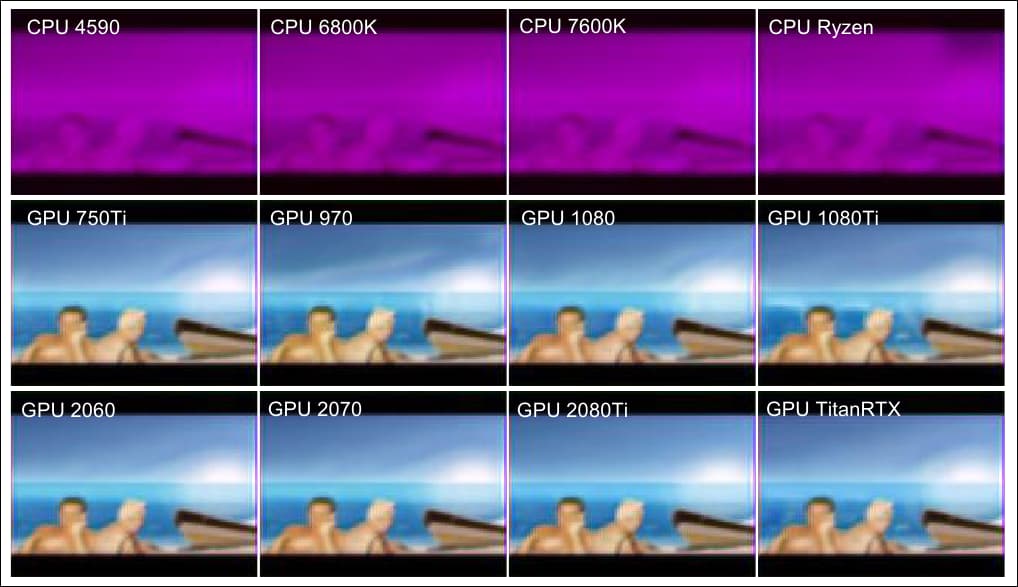

Tässä täydentävässä esimerkissä tutkimuspaperista nähdään (alimmassa rivissä), samanlaatuinen tuloksen laatu, joka saavutetaan erilaisilla GPU:illa, ja (ensimmäisessä rivissä), heikommat tulokset, jotka saavutetaan erilaisilla, muuten erittäin kykyisillä CPU:illa. Lähde: https://arxiv.org/pdf/2109.01451.pdf

Outo ilmiö

Nämä alustavat löydökset eivät sovellu yhdenmukaisesti kaikkiin suosittuihin koneoppimisalgoritmeihin, ja yksinkertaisten autoenkooderiarkkitehtuureiden tapauksessa ilmiö ei näy.

Kuitenkin työ viittaa mahdolliseen ‘pako-nopeuteen’ monimutkaisten neuroniverkkojen koulutuksen tehokkuudelle, jossa samojen toimintojen suorittaminen alhaisemmalla nopeudella ja pitemmillä koulutusajoilla ei saavuta odotettua suorituskyvyn tasausta, mitä matemaattiset iteraatiomenetelmät odottavat.

Tutkijat ehdottavat, että tämä suorituskyvyn ero voi olla tietyn tyyppisten neuroniverkkojen ominaisuus, ja että GPU:n prosessointiin liittyvät epämääräiset tekijät, joita usein nähdään esteenä, joka on lopulta voitettava, voivat tarjota merkittäviä hyötyjä ja voivat lopulta sisällyttää tietoisesti myöhempään järjestelmiin. Tutkimuspaperi viittaa myös siihen, että löydökset voivat tarjota syvemmän ymmärryksen aivojen suorittamaan laskentaan liittyvistä prosesseista.

Tehokkuuden ja tulosten laadun parantamiseen liittyvien ominaisuuksien tunnistaminen GPU:illa pitää sisällään mahdollisuuden saada syvempi ymmärrys ‘mustan laatikon’ -tekoälyarkkitehtuureista ja jopa parantaa CPU:n suorituskykyä – vaikka nykyisin taustalla olevat syyt ovatkin hämäriä.

Autoenkooderi vs. PredNet

Tutkijat käyttivät tutkimuksessaan perusautoenkooderia ja myös Harvardin yliopiston ennustavaa neuroniverkkoa PredNet, joka on tutkimus vuodelta 2016, jossa pyrittiin tutkimaan ja jäljittelemään ihmisaivojen toimintaa.

Molemmat järjestelmät ovat syviä neuroniverkkoja, jotka on suunniteltu syntetisoimaan sopivia kuvia valvomattoman oppimisen avulla (josta puuttuvat tiedot, joista on poistettu merkinnät), vaikka autoenkooderi käsittelee lineaarisesti yhden kuvan kerrallaan, josta seuraava kuva tuotetaan seuraavana kuvana toistuvassa putkessa. Autoenkooderi on koulutettu MNIST -käsinkirjoitustietokannassa.

Tutkijoiden testeissä käytetty autoenkooderi on koulutettu MNIST-tietokannassa, joka koostuu 60 000 koulutuskuvesta, joissa on 28×28 pikseliä, ja 10 000 testikuvaa.

Toisaalta PredNet arvioi monimutkaisia videolähteitä, ja tässä tutkimuksessa se on koulutettu FPSI -tietokannassa, joka sisältää laajan kehon kiinni olevan videomateriaalin Disney Worldista Orlando, Floridasta (Disney oli yksi tutkimuksen yhteistyökumppaneista vuoden 2012 tutkimuksessa).

Kuvasekvenssit FPSI:stä, jotka näyttävät ensimmäisen persoonan näkymää päivästä Disney Worldissa.

Kummassakin arkkitehtuurissa on erilaiset ominaisuudet. Autoenkooderi on suunniteltu kuvien uudelleenmuodostamiseen eikä ennustamaan kohdekertoja. Toisaalta PredNet sisältää neljä kerrosta, joista kunkin muodostavat edustusneuronit, jotka käyttävät konvoluutionaalista pitkän aikavälin muistia (LSTM).

Kerrosten tulokset ovat kontekstuaalisia ennusteita, jotka verrataan kohdearvoon, jotta voidaan tuottaa virhetermi, joka leviää koko verkossa. Molemmat mallit käyttävät valvomatonta oppimista.

Autoenkooderin yksinkertainen, lineaarinen arkkitehtuuri ja PredNetin monimutkaisempi, toistuva verkko.

Molemmat järjestelmät testattiin laajalla valikoimalla laitteisto- ja ohjelmistokonfiguraatioita, mukaan lukien CPU:t ilman GPU:ita (Intel i5-4590, i7-6800K, i5-7600K tai AMD Ryzen-5-3600) ja CPU:t, joissa on GPU (Intel i5-7600K + NVIDIA GTX-750Ti, i5-7600K + GTX-970, i7-6700K + GTX-1080, i7-7700K + GTX-1080Ti, i7-9700 + RTX-2080Ti, i5-7600K + RTX-2060 super, AMD Ryzen-5-3600 + RTX-2070 super tai i5-9400 + Titan-RTX).

Interaktiivinen prosessinäkymä htop käytettiin varmistamaan, että kaikki koulutus tapahtui joko yhdellä säikeellä (Intel i7-6800K:lla), neljällä säikeellä (Intel i5-4590:llä ja i5-7600K:lla) tai kuudella säikeellä (AMD Ryzen-5-3600:lla).

Satulamuodot

Autoenkooderilla keskimääräinen ero kaikissa konfiguraatioissa, sekä cuDNN:llä että ilman, ei ollut merkittävä. PredNetissä tulokset olivat hämmästyttävämpiä, ja niissä havaittiin merkittäviä eroja tappioarvioissa ja laadussa CPU- ja GPU-koulutuksen välillä.

PredNetin keskimääräiset tappiotulokset neljällä CPU:lla ja kahdeksalla GPU:lla, jossa verkko on koulutettu 5000 videokehyksellä 250 erässä, ja keskimääräinen tappio viimeisten 1000 kehyksen (50 erän) aikana. cuDNN on poistettu.

Tutkijat toteavat, että ‘Vaikka mekanismi on epäselvä, näyttää siltä, että GPU-laitteisto kykenee edistämään DNN:n koulutusta.’

Tulokset osoittavat, että GPU:t voivat olla parempia välttämään satulamuotoja – alueita, jotka kuvaavat gradientin laskun pohjaa.

Gradientin laskun pohja on ‘satulamuoto’, josta se on saanut nimensä. Lähde: https://www.pinterest.com.au/pin/436849232581124086/

Satulamuodot, vaikka ne ovat este, on pitkälti hylätty helposti kierrettäviksi optimoinnissa stokastisen gradientin laskun (SGD) suhteen, mutta uusi tutkimus viittaa siihen, että GPU:t voivat olla ainutlaatuisesti varustettu välttämään niitä, ja että satulamuotojen vaikutuksen tulisi ehkä tarkastella uudelleen.