Tekoäly

Luomalla parempia tekoälyvideoita vain kahdesta kuvasta

Videokehysinterpolointi (VFI) on avoin ongelma generatiivisessa videotutkimuksessa. Haaste on luoda välikuvia kahden olemassa olevan kehyksen välille videosekvenssissä.

Paina toistamaan. FILM-kehys, joka on yhteistyö Googlen ja Washingtonin yliopiston välillä, ehdotti tehokasta kehysinterpolointimenetelmää, joka on edelleen suosittu sekä harrastelijoiden että ammattilaisten piirissä. Vasemmalla näemme kaksi erillistä ja erottuvaa kehystä päällekkäin; keskellä ‘loppukehys’; ja oikealla lopullinen synteesi kehyksien välillä. Lähteet: https://film-net.github.io/ ja https://arxiv.org/pdf/2202.04901

Laajasti tarkasteltuna tämä tekniikka ulottuu yli sadan vuoden taakse, ja sitä on käytetty perinteisessä animaatiossa siitä lähtien. Tässä yhteydessä master-‘avainkehykset’ luotiin pääasiallisesti animaatioartistin toimesta, kun taas ‘tweening’-välikuvien luominen oli muiden työntekijöiden tehtävä, jota pidettiin alempiarvoisena tehtävänä.

Ennen tekoälyjen nousua kehysinterpolointi käytettiin projekteissa, kuten Real-Time Intermediate Flow Estimation (RIFE), Depth-Aware Video Frame Interpolation (DAIN) ja Google:n Frame Interpolation for Large Motion (FILM – ks. yllä) tarkoituksena lisätä olemassa olevan videon kehysnopeutta tai mahdollistaa keinotekoiset hidastusvaikutukset. Tämä saavutetaan jakamalla olemassa olevat kehykset klipissä ja luomalla arvioituja välikuvia.

VFI käytetään myös parempien videokoodekkien kehittämisessä ja yleisemmässä optisen virran perustuvissa järjestelmissä (mukaan lukien generatiiviset järjestelmät), jotka hyödyntävät etukäteen tietoa tulevista avainkehyksistä optimoidakseen ja muokatakseen väli sisältöä, joka edeltää niitä.

Loppukehykset generatiivisissa videosysteemeissä

Modernit generatiiviset systeemit, kuten Luma ja Kling, sallivat käyttäjän määritellä aloitus- ja loppukehyksen, ja voivat suorittaa tämän tehtävän analysoimalla avainpisteitä kahdessa kuvassa ja arvioimalla trajektorian kahden kuvan välillä.

Kuten voidaan nähdä alla olevissa esimerkeissä, ‘päätöskuvan’ tarjoaminen sallii generatiiviselle videosysteemille (tässä tapauksessa Kling) säilyttää tiettyjä piirteitä, kuten identiteetti, vaikka tulokset eivät ole täydellisiä (erityisesti suurten liikkeiden kohdalla).

Paina toistamaan. Kling on yksi kasvavasta määrästä videogeneraattoreita, jotka sallivat käyttäjän määritellä loppukehyksen. Useimmissa tapauksissa vähäinen liike johtaa realistisimpiin ja vähiten virheellisiin tuloksiin. Lähde: https://www.youtube.com/watch?v=8oylqODAaH8

Yllä olevassa esimerkissä henkilön identiteetti on yhdenmukainen kahden käyttäjän antaman avainkehyksen välillä, mikä johtaa suhteellisen yhdenmukaiseen videon generointiin.

Kun vain aloituskehykset on annettu, generatiivisen systeemin huomion ikkuna ei yleensä ole tarpeeksi suuri ‘muistamaan’, miltä henkilö näytti videon alussa. Sen sijaan identiteetti on todennäköisesti siirtyy hieman jokaisessa kehyksessä, kunnes kaikki muistutus katoaa. Alla olevassa esimerkissä aloituskuvaa ladattiin, ja henkilön liike ohjattiin tekstipromptin avulla:

Paina toistamaan. Kun loppukehystä ei ole, Klingillä on vain pieni ryhmä välittömästi edeltäviä kehyksiä seuraavien kehysten generointiin. Tapauksissa, joissa tarvitaan merkittävää liikettä, tämä identiteetin atrofia tulee vakavaksi.

Voidaan nähdä, että näyttelijän muistutus ei ole kestävä ohjeiden mukaisesti, koska generatiivinen systeemi ei tiedä, miltä hän näyttäisi, jos hän olisi hymyilevä, ja hän ei hymyile siemenkuvassa (ainoa saatavilla oleva viite).

Useimmat viralliset generatiiviset klipit on huolellisesti karsittu vähentämään näitä puutteita. Kuitenkin generatiivisten videosysteemien aikojenmukaisen kehityksen edetessä voi riippua uusista tutkimusalan edistysaskelista kehysinterpoloinnissa, koska ainoa mahdollinen vaihtoehto on perinteisen CGI:n käyttäminen ‘opastus’-videona (ja jopa tässä tapauksessa tekstuurin ja valaistuksen johdonmukaisuus ovat edelleen haasteellisia saavuttaa).

Lisäksi uuden kehyksen johdonmukainen johtaminen pienestä ryhmästä viimeisiä kehyksiä tekee hyvin vaikeaksi saavuttaa suuria ja rohkeita liikkeitä. Tämä johtuu siitä, että nopeasti liikkuva objekti kehyksen poikki voi siirtyä toisesta reunasta toiseen yhden kehyksen aikana, toisin kuin hitaammat liikkeet, joille järjestelmä on todennäköisesti koulutettu.

Samoin merkittävä ja rohkea asennon muutos voi johtaa ei vain identiteetin siirtymiseen, vaan myös eläviin epäjohdonmukaisuuksiin:

Paina toistamaan. Tässä esimerkissä Lumasta pyydetyt liikkeet eivät näytä olevan hyvin edustettuina koulutusaineistossa.

Framer

Tämä johtaa meidät mielenkiintoiseen viimeaikaiseen tutkimukseen Kiinasta, joka väittää saavuttaneen uuden tilan huipun aidon näköisen kehysinterpoloinnissa – ja joka on ensimmäinen laatuaan, joka tarjoaa vetämispohjaisen käyttäjäkokemuksen.

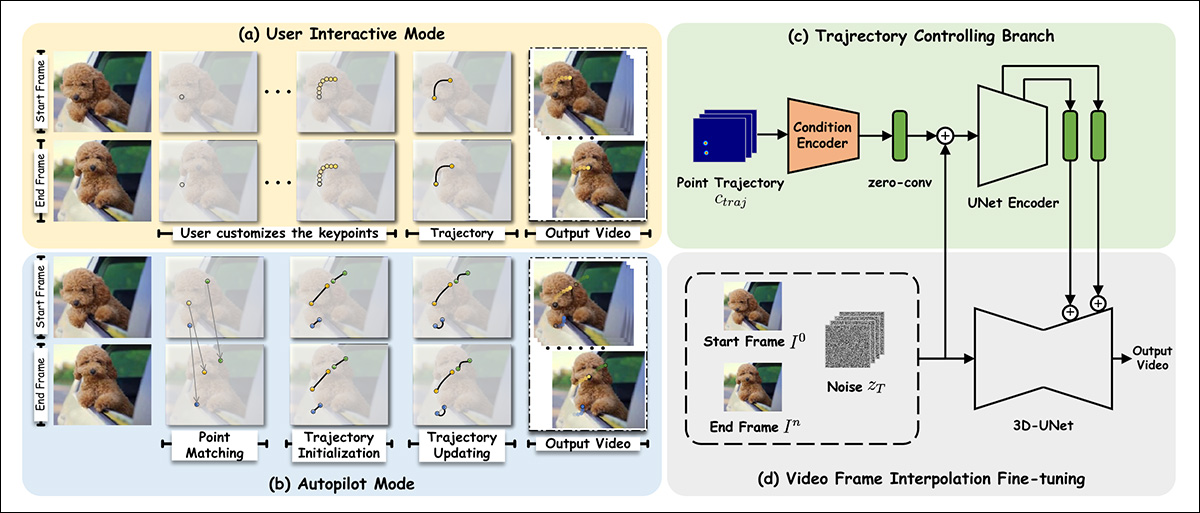

Framer sallii käyttäjän ohjata liikettä intuitiivisella vetämispohjaisella käyttöliittymällä, vaikka sillä on myös ‘automaattinen’ tila. Lähde: https://www.youtube.com/watch?v=4MPGKgn7jRc

Vetämispohjaiset sovellukset ovat yleistyneet viime aikoina kirjallisuudessa, kun tutkimusala kamppailee tarjoamaan välineitä generatiivisille järjestelmille, jotka eivät perustu tekstiprompteista saatuun melko karkeaan tulokseen.

Uusi järjestelmä, joka on nimeltään Framer, voi seurata käyttäjän ohjausta vetämällä, ja sillä on myös perinteinen ‘autopilotti’ -tila. Perinteisen tweeningin lisäksi järjestelmä pystyy tuottamaan aikajännesimulaatioita, sekä muokkaamaan ja luo uusia näkymiä syötekuvasta.

Välikehykset, jotka on generoitu aikajänteisessä simulaatiossa Framerissa. Lähde: https://arxiv.org/pdf/2410.18978

Kehysinterpoloinnissa Framer ylittää hieman Neuraalisen säteilyn kenttien (NeRF) alueen – vaikka se vaatii vain kaksi kuvaa, kun taas NeRF yleensä vaatii kuusi tai useamman kuvan syötteenä.

Kokeissa Framer, joka perustuu Stability.ai:n Stable Video Diffusion -latenssi-diffuusiogeneratiiviseen videosuunnittelumalliin, pystyi ylittämään approksimoidut kilpailevat lähestymistavat käyttäjätutkimuksessa.

Koodi on tarkoitus julkaista GitHubissa. Videonäytteet (joista yllä olevat kuvat on johdettu) ovat saatavilla projektisivustolla, ja tutkijat ovat myös julkaisseet YouTube-videon.

Uusi tutkimus on nimeltään Framer: Interaktiivinen kehysinterpolointi, ja se tulee yhdeksältä tutkijalta Zhejiangin yliopistosta ja Alibaba-tukiryhmästä.

Menetelmä

Framer käyttää avainpistekohtaisen interpoloinnin kumpaankin tilaan, jossa syötekuvaa arvioidaan perustopologiasta, ja ‘liikkuville’ pisteille määritetään tarvittaessa. Käytännössä nämä pisteet ovat vastaavia kuin kasvonmaantieteelliset merkit tunnistamisjärjestelmissä, mutta yleistyvät mihin tahansa pintaan.

Tutkijat säätivät Stable Video Diffusion (SVD) -mallia OpenVid-1M -aineistolla, ja lisäsivät lisäksi viimeisen kehyksen synteesi -ominaisuuden. Tämä mahdollistaa trajektorian ohjausmekanismin (yläoikea skeeman kuvassa alla), joka voi arvioida polun loppukehykseen (tai siitä eteenpäin).

Framerin skeema.

Lisäksi loppukehyskonditionaalin lisäämisestä kirjoittajat toteavat:

‘Säilyttääksemme esikoulutetun SVD:n visuaalisen prioriteetin mahdollisimman hyvin, seuraamme SVD:n konditionointiparadigman ja ruokkimme loppukehyskonditionaaleja latenssiavaruudessa ja semanttisessa avaruudessa.

‘Nimenomaan yhdistämme ensimmäisen kehyksen VAE-koodatun latentin ominaisuuden ensimmäisen kehyksen meluisaan latenttiin, kuten SVD:ssä. Lisäksi yhdistämme viimeisen kehyksen latentin ominaisuuden loppukehyksen meluisaan latenttiin, ottaen huomioon, että ehdot ja vastaavat meluisat latentit ovat spatiaalisesti linjassa.

‘Lisäksi poistamme ensimmäisen ja viimeisen kehyksen CLIP-kuvauskuvauksen erikseen ja yhdistämme ne ristiriita-ominaisuuden ruokkimiseksi.’

Vetämispohjaisessa toiminnallisuudessa trajektorimoduuli hyödyntää Meta Ai -johtamaa CoTracker -kehystä, joka arvioi runsaasti mahdollisia polkuja eteenpäin. Nämä on karsittu 1-10 mahdolliseen trajektoriaan.

Saadut pistekoordinaatit muunnetaan menetelmällä, joka on inspiroitu DragNUWA – ja DragAnything -arkkitehtuureista. Tämä saa Gaussin lämpökartan, joka erottaa liikkeen kohdealueet.

Tämän jälkeen data syötetään ControlNet -järjestelmän konditionaamisimekanismeihin, joka on alun perin suunniteltu Stable Diffusionille, ja sittemmin sovellettu muihin arkkitehtuureihin.

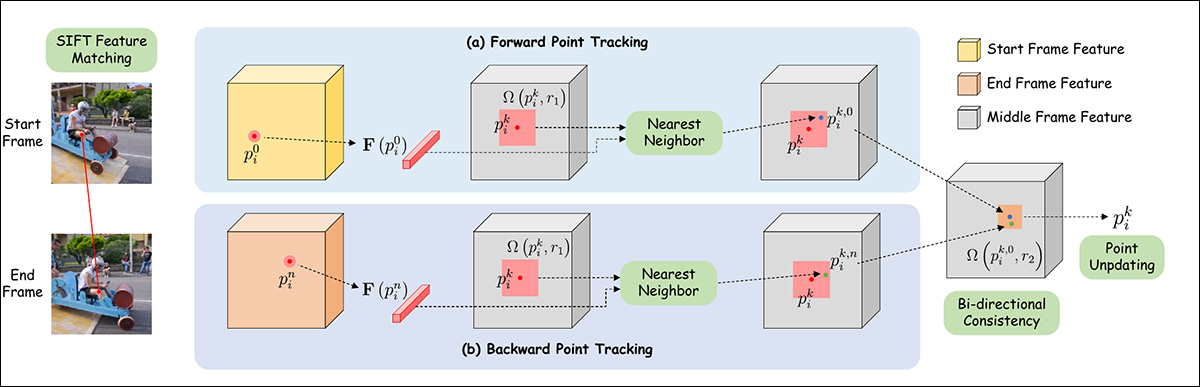

Autopilotti-tilassa ominaisuusyhdistäminen suoritetaan aluksi SIFT :n avulla, joka tulkkaa trajektorian, joka voidaan sitten antaa itsestään päivittyvälle mekanismille, joka on inspiroitu DragGAN :sta ja DragDiffusion :sta.

Pistetrajektorian arviointiskeema Framerissa.

Data ja testit

Framerin hienosäätöä varten avaruuden tarkkaavuus ja jäännössumman lohkot jäädytettiin, ja vain aikajännitteiset tarkkaavuuskerrokset ja jäännössumman lohkot vaikuttivat.

Mallia koulutettiin 10 000 iteroinnissa AdamW :n avulla, oppiainesäännön 1e-4 ja erän koko 16. Koulutus tapahtui 16 NVIDIA A100 -näytönohjaimen yli.

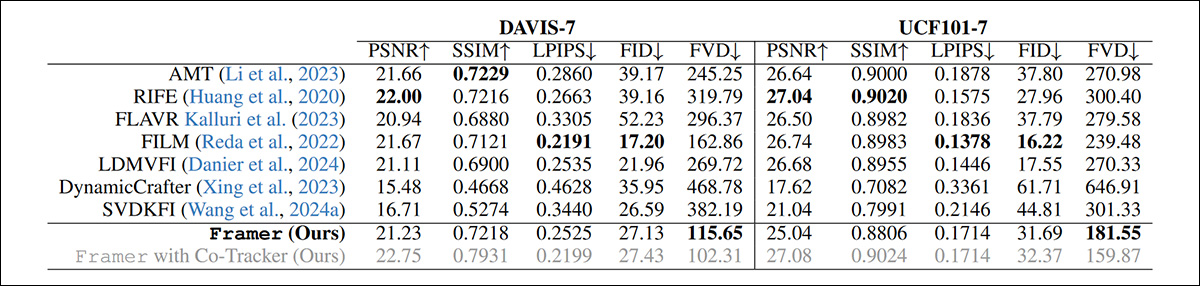

Koska aiemmat lähestymistavat ongelmaan eivät tarjoa vetämispohjaista editointia, tutkijat päättivät vertailla Framerin autopilotti-tilaa vanhempien tarjoajien standarditoiminnallisuuteen.

Kokeissa testatut kehykset olivat LDMVFI ; Dynamic Crafter ; ja SVDKFI. Perinteisten videosysteemien osalta kilpailevat kehykset olivat AMT ; RIFE ; FLAVR ; ja mainittu FILM.

Lisäksi käyttäjätutkimuksessa tutkijat suorittivat testejä DAVIS – ja UCF101 -aineistojen yli.

Laadulliset testit voidaan arvioida vain tutkimusryhmän objektiivisilla kyvyillä ja käyttäjätutkimuksilla. Kuitenkin tutkimus toteaa, että perinteiset määrälliset mittarit eivät sovellu tämänkaltaiseen ehdotukseen:

‘[Rekonstruktio] mittarit kuten PSNR, SSIM ja LPIPS eivät pysty havainnoimaan interpoloiden kehysten laatua tarkasti, koska ne rangaistavat muita uskottavia interpolointituloksia, jotka eivät ole pikselikohtaisesti linjassa alkuperäisen videon kanssa.

‘Vaikka generointimittaukset kuten FID tarjoavat jonkinlaista parannusta, ne eivät vieläkään riitä, koska ne eivät ota huomioon aikajännitteistä yhdenmukaisuutta ja arvioivat kehyksiä erillään.’

Tästä huolimatta tutkijat suorittivat laadulliset testit useilla suosituilla mittareilla:

Määrälliset tulokset Frameriä vastaan kilpailevissa järjestelmissä.

Kirjoittajat toteavat, että huolimatta siitä, että heillä oli epäedulliset olosuhteet, Framer saavutti silti parhaan FVD-pisteen testatuista menetelmistä.

Alla ovat tutkimuksen näytteelliset vertailutulokset:

Laadullinen vertailu aiempiin lähestymistapoihin. Viitatakseen parempaan resoluutioon, sekä video tuloksiin osoitteessa https://www.youtube.com/watch?v=4MPGKgn7jRc.