Andersonin kulma

Koodaus-AI:lla on taipumus kärsiä Dunning-Kruger-ilmiöstä

Uusi tutkimus osoittaa, että koodaus-AI:lla, kuten ChatGPT:llä, on taipumus kärsiä Dunning-Kruger-ilmiöstä, usein toimien luottavaisimmin silloin, kun ne ovat vähiten osaavia. Tutkiessaan tuttuja tai harvinaisia ohjelmointikieliä, ne väittävät korkeaa varmuutta, vaikka vastauksensa hajoavat. Tutkimus liittää mallin yli-itsevarmuuden sekä heikkoon suorituskykyyn että koulutusdatan puutteeseen, herättäen uusia huolenaiheita siitä, kuinka paljon nämä järjestelmät todella tietävät siitä, mitä he ei tiedä.

Kuka tahansa, joka on viettänyt edes kohtuullisen ajan Large Language Modelien kanssa faktuaalisissa asioissa, tietää jo, että LLM:t antavat usein luottavaan väärään vastaukseen käyttäjän kysymykseen.

Yhdessä hallusinaatioiden ja muiden ilmiöiden kanssa syy tähän tyhjään kerskuvaiseen asenteeseen ei ole 100% selvä. Kesän aikana julkaistu tutkimus osoittaa, että mallit antavat luottavia vastauksia vaikka ne tietävät olevansa väärässä, esimerkiksi; vaikka toiset teorioita liittävät yli-itsevarmuuden arkkitehtuurivalintoihin, muun muassa.

Se, mitä loppukäyttäjä voi olla varma, on, että kokemus on erittäin turhauttava, koska me olemme ohjelmoitu uskomaan ihmisten arvioihin omista kyvyistään (ei vähiten siksi, että näissä tapauksissa on seurauksia, laillisia ja muuta, henkilön yli-lupauksille ja alisuorituksille); ja antropomorfisen siirtymän kautta meillä on tapana toistaa tämä käyttäytyminen keskustelurobotti-järjestelmien kanssa.

Mutta LLM on vastuuton entiteetti, joka voi ja tulee tehokkaasti palauttaa ‘Voi hei! Sormin…‘ sen jälkeen, kun se on auttanut käyttäjää vahingossa tuhoamaan jotain tärkeää, tai ainakin haaskata iltapäivän ajan; olettaen, että se tunnustaa vastuun lainkaan.

Pahemminkin, tämä puute varovaisuudesta näyttää olevan mahdotonta ohjata pois, ainakin ChatGPT:ssä, joka antaa runsaasti takuuja käyttäjälle sen neuvon validiudesta, ja selittää virheitä ajattelussaan vasta vahingon tapahtumisen jälkeen. Järjestelmän pysyvän muistin päivittäminen eikä toistuvien ohjelmoiden käyttö vaikuta paljon ongelmaan.

Ihmiset voivat olla yhtä itsepäisiä ja itsepetoksellisia – vaikka kukaan, joka erehtyi niin syvästi ja usein, todennäköisesti olisi irtisanottu varhain. Sellaiset, jotka kärsivät vastakkaisesta ‘impostorin oireyhtymästä’ (jossa työntekijä pelkää olevansa ylennetty ylittäen kykynsä) – Dunning Kruger -ilmiö, jossa henkilö yliarvioi kykyään suorittaa tehtävä.

Inflaation hinta

Microsoftin uusi tutkimus tutkii Dunning-Kruger-ilmiön arvoa suhteessa AI-avustettujen koodausarkkitehtuurien (kuten Redmondin oman Copilotin) tehokkaaseen suorituskykyyn, tutkimuksessa, joka on ensimmäinen, joka kohdistuu tähän LLM-alasektoriin.

Tutkimus analysoi, miten varmasti tällaiset koodaus-AI:t arvioivat omia vastauksiaan verrattuna siihen, miten hyvin he todella suoriutuvat, kymmenien ohjelmointikielten yli. Tulokset osoittavat selkeän, ihmismäisen kaltaisen mallin: kun mallit olivat vähiten kykeneviä, he olivat eniten varmoja itsestään.

Ilmiön vaikutus oli vahvin harvoissa tai vähäresurssisissa kielissä, joissa koulutusdata oli ohutta – mitä heikompi malli tai harvinaisempi kieli, sitä suurempi harhaluulo taidosta:

GPT-4o:n todellinen ja havaittu suorituskyky ohjelmointikielten yli, lajiteltu todellisen suorituskyvyn mukaan. Lähde: https://arxiv.org/pdf/2510.05457

Neljä kirjoittajaa, kaikki yhdenvertaiset avustajat, jotka työskentelevät Microsoftille, väittävät, että työ herättää uusia kysymyksiä siitä, kuinka paljon nämä työkalut voidaan luottaa arvioimaan omaa tuotostaan, ja he sanovat:

‘Mallin varmuuden ja suorituskyvyn analysoimalla eri ohjelmointikielten yli, paljastamme, että AI-mallit heijastelevat ihmisten yli-itsevarmuuden kaltaisia malleja, erityisesti tuttuja tai vähäresurssisia aloja.

‘Kokeemme osoittavat, että vähemmän kykenevät mallit ja ne, jotka toimivat harvoissa ohjelmointikielissä, osoittavat vahvempaa DKE-tyyppistä harhaa, mikä osoittaa, että harhan voimakkuus on suhteessa mallin kykyyn.

Tutkijat yhteyttävät tämän tutkimussuuntauksen ymmärtämiseen, miten mallin varmuus muuttuu epäluotettavaksi, kun suorituskyky on heikko, ja testaamaan, näyttävätkö AI-järjestelmät samaa kaltaista yli-itsevarmuutta kuin ihmiset – jolla on vaikutuksia luottamukseen ja käytännön käyttöön.

Vaikka uusi paperi vastustaa Betteridgen lakia otsikoista, se on kuitenkin otsikoitu Kärsivätkö koodausmallit Dunning-Kruger-ilmiöstä?. Vaikka kirjoittajat toteavat, että koodi on julkaistu työlle, nykyinen esiversio ei sisällä tietoja siitä.

Menetelmä

Tutkimus testasi, miten tarkasti koodaus-AI:t voivat arvioida omia vastauksiaan antamalla niille tuhansia monivalintakysymyksiä, joista jokainen kuului tiettyyn kieliin.

Ohjelmointikielten alueet, joita tutkimuksessa käytettiin, yhdessä monivalintakysymysten määrän, jotka oteltiin kullekin alueelle.

Mallit tehtävänä oli valita oikea vaihtoehto, ja arvioida, miten varmoja ne olivat valinnastaan, ja heidän todellinen suorituskykynsä mitattiin siitä, kuinka usein he saivat vastauksen oikein – ja heidän itsearvioitu varmuutensa osoitti, kuinka hyviä he uskoivat olevan.

Vertaamalla näitä kahta mittaria tutkijat pystyivät näkemään, missä varmuus ja kyky erosivat.

Tutkimuksessa käytettiin kahta menetelmää mitatakseen, miten varmoja mallit näyttivät olevan: absoluuttinen varmuus ja suhteellinen varmuus. Ensimmäisessä malli pyydettiin antamaan pisteet nollasta yhteen jokaisen vastauksen kanssa, ja sen varmuus kussakin kielessä määriteltiin näiden pisteiden keskiarvona kyseisessä kielessä.

Toisessa menetelmässä tarkasteltiin, miten varmoja malli oli kysymysten välillä; kussakin parissa malli piti sanoa, kummasta kysymyksestä se oli enemmän varma. Nämä valinnat pisteytettiin sijoitusjärjestelmin, jotka oli alun perin suunniteltu kilpailullisiin peleihin, kuten jokainen kysymys olisi pelaaja ottelussa. Lopulliset pisteet normalisoitiin ja keskiarvoitiin kullekin kielelle antamaan suhteellisen varmuuspisteen.

Kaksi vakiintunutta Dunning-Kruger-ilmiön muotoa tutkitaan paperissa: yksi, joka seuraa yksittäisen mallin virheellistä arviointia eri aloilla; ja toinen, joka vertaa varmuustasoja heikkoompia ja vahvempia malleja.

Ensimmäinen muoto, intra-participant DKE, tarkastelee, muuttuuko yksittäinen malli yli-itsevarmaksi kieliin, joissa se suoriutuu huonosti. Toinen, inter-participant DKE, kysyy, ovatko mallit, jotka suoriutuvat heikommin yleensä, myös taipuvaisempia arvioimaan itseään korkeammaksi.

Molemmissa tapauksissa varmuuden ja todellisen suorituskyvyn välinen ero käytetään yli-itsevarmuuden mittaamiseen, ja suuremmat erot heikossa suorituskyvyssä osoittavat DKE-kaltaista käyttäytymistä.

Tulokset

Tutkimus testasi Dunning-Kruger-ilmiön kuudessa suuressa kielen mallissa: Mistral; Phi-3; DeepSeek-Distill; Phi-4; GPT-0.1, ja GPT-4o.

Jokainen malli testattiin monivalintakysymyksillä julkaistusta CodeNet-aineistosta, 37 kieltä edustettiin paljastaakseen, miten varmuus ja tarkkuus vaihtelevat tuttuissa ja harvoissa koodausaloissa.

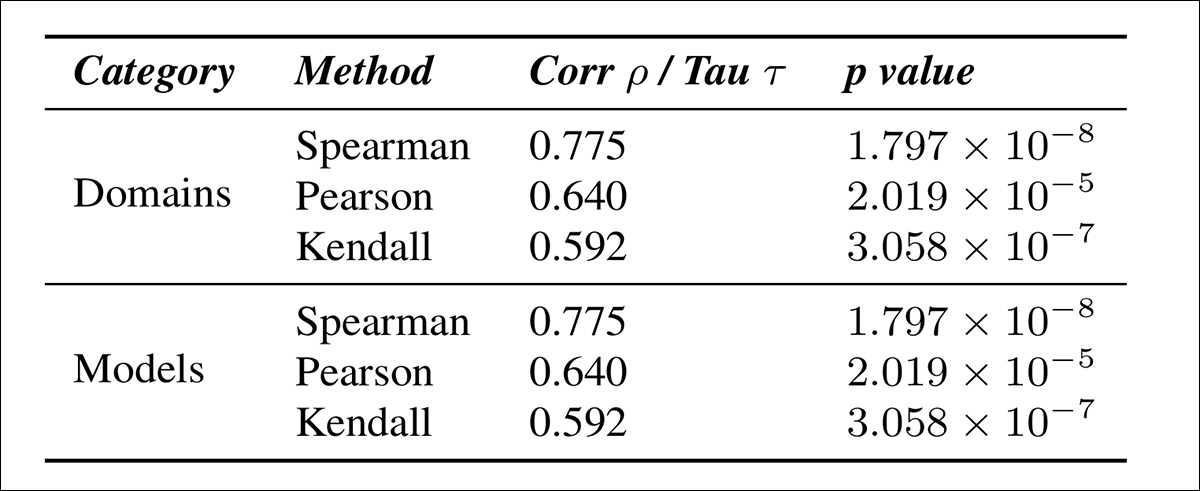

Mallien välinen analyysi osoittaa selkeän Dunning-Kruger-kuvion:

Todellinen ja havaittu suorituskyky kuudessa koodausmallissa, osoittaen, miten heikommin suoriutuvat mallit, kuten Mistral ja Phi-3, osoittavat korkeaa varmuutta huolimatta heikosta tarkkuudesta, kun taas vahvemmat mallit, kuten GPT-4o, osoittavat kalibroituja tai jopa alioptimoiden käyttäytymistä.

Mallit, joilla oli alempi tarkkuus, kuten Mistral ja Phi-3, taipuivat yliarvioimaan omia kykyjään, kun taas suorituskyvyltään paremmat järjestelmät, kuten GPT-4o, osoittivat varmuustasoja, jotka vastasivat paremmin heidän todellista suorituskykyään, erityisesti suhteellisen varmuuden osalta.

Tulokset osoittavat myös, että kyvykkäimmät mallit saattavat joskus alioptimoida itseään (jotain, mitä absoluuttinen varmuus ei pysty havaitsemaan).

Tulokset osoittavat myös, että intra-mallin analyysi tukee Dunning-Kruger-ilmiön olemassaoloa. Tuloksissa, jotka on esitetty artikkelin alussa, nähdään, miten kunkin mallin suorituskyky vaihtelee eri ohjelmointikielten yli, lajiteltuina todellisen suorituskyvyn mukaan.

Kieliin, joissa mallit suoriutuivat huonosti, erityisesti harvoissa tai vähäresurssisissa kieliin, kuten COBOL, Prolog ja Ceylon, heidän varmuutensa oli huomattavasti korkeampi kuin heidän tuloksensa oikeuttivat. Tunnetuimmissa kielissä, kuten Pythonissa ja JavaScriptissä, heidän varmuutensa vastasi paremmin heidän todellista tarkkuuttaan, ja joskus jopa laski sen alle.

Tämä malli näkyi sekä absoluuttisissa että suhteellisissa varmuusmittauksissa, osoittaen, että malleilla on vähemmän tietoa omista rajoituksistaan, kun ne toimivat tuttuissa koodausaloissa.

Mallien käsittely osallistujina esittää joitakin rajoituksia, koska mallien pieni määrä vaikuttaa monimuotoisuuteen; eroja yhden mallin tuloksissa ignoorataan; ja datan jakautuminen saattaa ei heijasta ihmisten osallistujien jakautumista.

Tätä varten tutkimus testasi kolmea vaihtoehtoista asetelmaa: ensinnäkin, kullekin mallille annettiin erillinen persoona; toiseksi, vastauksia oteltiin korkeammalla lämpötilalla luodakseen enemmän vaihtelua; kolmanneksi, ohjelmat toistettiin useita kertoja, ja kunkin version kohdellaan erillisenä osallistujana:

Yli-itsevarmuuden ja todellisen suorituskyvyn välinen korrelaatio eri kokeellisissa asetelmissa, osoittaen, että Dunning-Kruger-malli pysyy johdonmukaisena kaikissa olosuhteissa ja on vahvin, kun useita monimuotoisia vastauksia otetaan samasta mallista.

Tutkimuksessa mitattiin, miten paljon kunkin mallin havaittu suorituskyky poikkesi todellisesta suorituskyvystä, ja miten tämä yliarviointi liittyi mallin todelliseen suorituskykyyn:

Yliarvioinnin ja todellisen tarkkuuden välinen korrelaatio ohjelmointikielten ja mallityyppien yli, osoittaen, että suurempi yliarviointi on johdonmukaisesti yhdistetty alempaan suorituskykyyn.

Lisäksi erikoistuneet mallit, jotka oli koulutettu kapeammille aloille, osoittivat vahvempia DKE-vaikutuksia kuin yleistyneet:

Yliarvioinnin ja todellisen suorituskyvyn välinen korrelaatio perus-, yksittäisen alan ja monialaisille erikoistuneille malleille, osoittaen vahvempia DKE-vaikutuksia erikoistumisen lisääntyessä.

Käyttäen MultiPL-E-aineistoa kahdeksan ohjelmointikielellä, tutkijat totesivat, että yksittäisen alan koulutus johti suurempaan yli-itsevarmuuteen kuin monialainen tai perusasettelu, osoittaen, että DKE pahenee erikoistumisen lisääntyessä.

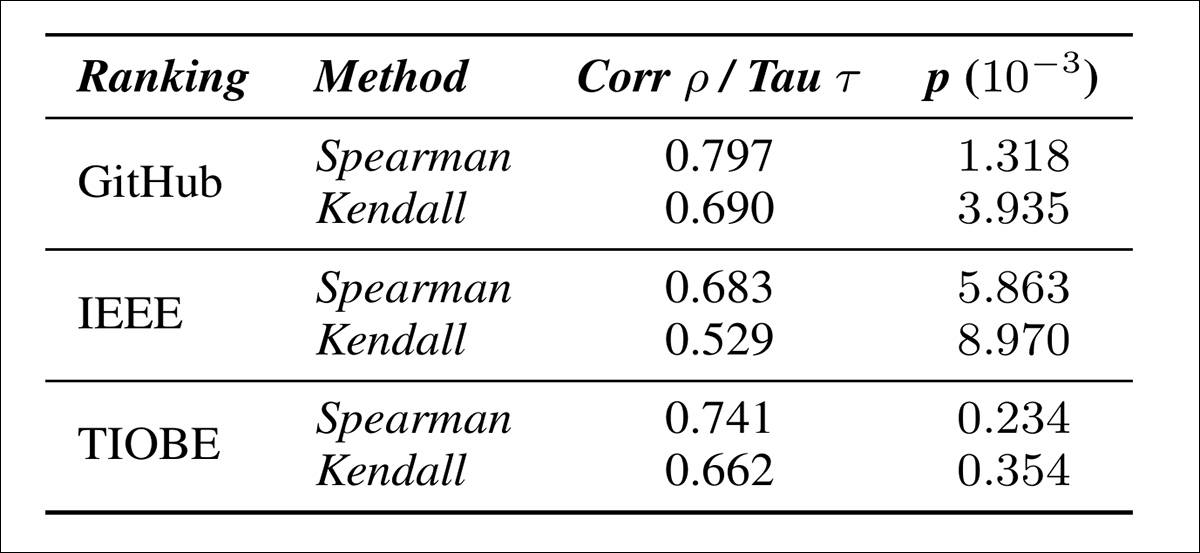

Testit osoittivat myös, että mallit ovat useammin yli-itsevarmoja harvoissa ohjelmointikielissä. GitHubin, IEEE:n ja TIOBE:n rankingien yli, harvinaisuus korreloi vahvasti korkeamman havaitun suorituskyvyn kanssa, huipentuen 0,797:ään:

Mallin yli-itsevarmuuden ja kielen harvinaisuuden välinen korrelaatio, käyttäen kolmea suosiollisuusluokitusta. Vähemmän yleiset kielet liittyvät korkeampaan havaittuun suorituskykyyn.

Lopulta tutkijat testasivat, näkyykö Dunning-Kruger-ilmiö koodin generoimisessa, arvioimalla malleja MultiPL-E-aineistolla kahdeksalla kielellä.

Vaikka ilmiö oli edelleen läsnä, se oli huomattavasti heikompi kuin monivalintakysymyksissä, mikä liittyi luultavasti avoimien tehtävien suurempaan haasteeseen:

Yliarvioinnin ja todellisen suorituskyvyn välinen korrelaatio avoimessa koodin generoimisessa, perustuen MultiPL-E-tuloksiin kahdeksalla ohjelmointikielellä.

Tutkijat päättävät, että yksi mahdollinen selitys, joka voi olla yhteinen sekä ihmisille että AI-malleille, on meta-kognitiivinen selitys, joka toteaa, että suorituskyvyn laadun arviointi on tärkeä osa taidon omaksumista.

Tämä selitys voidaan testata kokeellisesti AI-malleissa, joissa on eri koulutusstrategioita, ja tutkia, johtavatko ne yhteen suorituskyvyn ja suorituskyvyn arvioinnin parantamiseen. Tämä tutkimus on kuitenkin merkittävästi tämän tutkimuksen ulottumattomissa, ja se jätetään tulevaan tutkimukseen.

Johtopäätös

Vaikka Dunning-Kruger-ilmiö (kuten paperi toteaa) voidaan liittää joko tilastolliseen tai kognitiiviseen syyhyn, soveltaminen tietynlaista ihmisen ilmiötä koneoppimisen kontekstiin on itse asiassa hyvin validi.

Vaikka kirjoittajat spekuloi, että syy voi olla ‘kognitiivinen’ molemmissa tapauksissa, se edellyttäisi hieman metafyysisempää näkökulmaa.

Tutkimuksen mielenkiintoisin löytö on se, kuinka useat koodaus-LLM:t taipuvat kaksinkertaistamaan epäedullisimmissa olosuhteissaan, ts. osoittamalla maksimivarmuutta silloin, kun he kohtaavat harvinaisia tai vähäresurssisia kieliä – mikä olisi lähes välittömästi itseensä tuhovoittava strategia todellisessa työmaailmassa.

* Ohjelmointikielet, joita käytettiin, olivat Ada, Bash, C, C#, C++, COBOL, Ceylon, Clojure, D, Dart, Dash, Elixir, Erland, F#, Fortran, Go, Haskell, Java, JavaScript, Julia, Lisp, Kotlin, Lua, OCaml, Objective-C, PHP, Pascal, Perl, Prolog, Python, Racket, Ruby, Rust, Scala, Swift, TypeScript ja Visual Basic.

Julkaistu ensimmäisen kerran keskiviikkona, 8. lokakuuta 2025